Kunstmatige intelligentie

Perplexity AI “Ontcensureert” DeepSeek R1: Wie Bepaalt AI’s Grenzen?

In een beweging die de aandacht van velen heeft getrokken, heeft Perplexity AI een nieuwe versie van een populaire open-source taalmodel uitgebracht dat de ingebouwde Chinese censuur verwijdert. Dit gemodificeerde model, genaamd R1 1776 (een naam die de geest van onafhankelijkheid oproept), is gebaseerd op het in China ontwikkelde DeepSeek R1. Het originele DeepSeek R1 zorgde voor ophef vanwege zijn sterke redeneervaardigheden – naar verluidt rivaliserend met topmodellen tegen een fractie van de kosten – maar het had een significante beperking: het weigerde bepaalde gevoelige onderwerpen aan te pakken.

Waarom is dit belangrijk?

Het roept cruciale vragen op over AI-surveillance, vooroordelen, openheid en de rol van geopolitiek in AI-systemen. Dit artikel onderzoekt wat Perplexity precies heeft gedaan, de implicaties van het ontcensureren van het model en hoe het past in het grotere gesprek over AI-transparantie en censuur.

Wat Er Gebeurde: DeepSeek R1 Gaat Ontcensureren

DeepSeek R1 is een open-gewicht groot taalmodel dat in China is ontwikkeld en bekendheid verwierf vanwege zijn uitstekende redeneervaardigheden – zelfs de prestaties van leidende modellen benaderend – alles terwijl het computationeel efficiënter was. Echter, gebruikers merkten snel een eigenaardigheid op: telkens wanneer queries gevoelige onderwerpen in China raakten (bijvoorbeeld politieke controverses of historische gebeurtenissen die door de autoriteiten als taboe worden beschouwd), weigerde DeepSeek R1 direct te antwoorden. In plaats daarvan reageerde het met vooraf ingestelde, door de staat goedgekeurde verklaringen of weigerde het simpelweg, waarmee het de censuurregels van de Chinese regering weerspiegelde. Deze ingebouwde vooroordelen beperkten de bruikbaarheid van het model voor diegenen die op zoek waren naar openhartige of genuanceerde discussies over die onderwerpen.

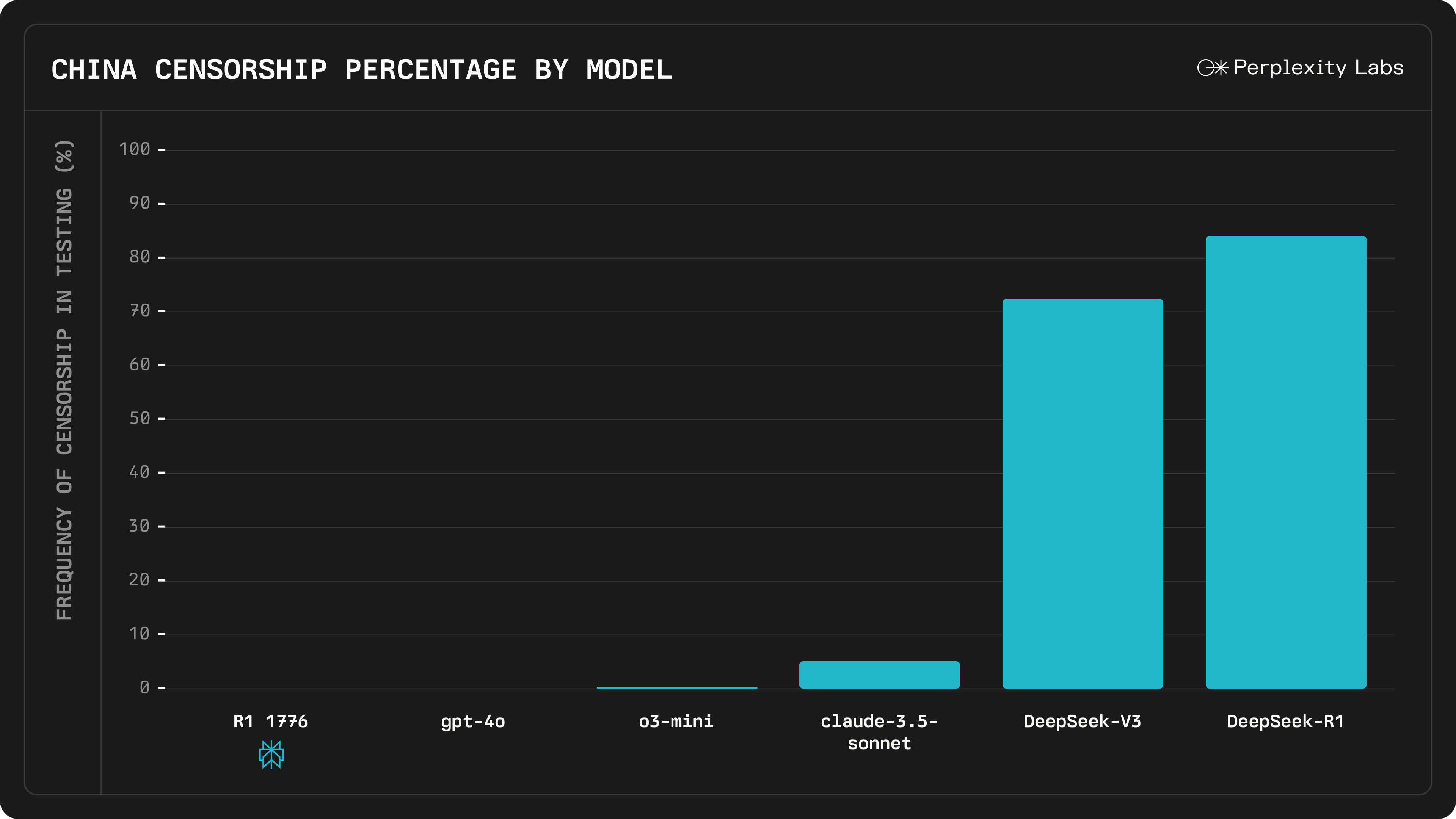

Perplexity AI’s oplossing was om het model te “ontcensureren” via een uitgebreid post-trainingproces. Het bedrijf verzamelde een grote dataset van 40.000 multilinguale prompts die vragen behelsden die DeepSeek R1 eerder censureerde of ontweek. Met de hulp van menselijke experts identificeerden ze ongeveer 300 gevoelige onderwerpen waarop het originele model de partijlijn volgde. Voor elke dergelijke prompt creëerden ze feitelijke, goed onderbouwde antwoorden in meerdere talen. Deze inspanningen voedden een multilinguale censuurdetectie- en correctiesysteem, waardoor het model leerde te herkennen wanneer het politieke censuur toepaste en in plaats daarvan een informatief antwoord gaf. Na deze speciale fine-tuning (die Perplexity “R1 1776” noemde om het thema van vrijheid te benadrukken) werd het model openbaar gemaakt. Perplexity beweert de Chinese censuurfilters en vooroordelen uit DeepSeek R1’s antwoorden te hebben verwijderd, zonder zijn kerncapaciteiten te veranderen.

In wezen gedraagt R1 1776 zich heel anders bij voormalige taboevragen. Perplexity gaf een voorbeeld met een vraag over de onafhankelijkheid van Taiwan en de mogelijke impact op de aandelenkoers van NVIDIA – een politiek gevoelig onderwerp dat de relatie tussen China en Taiwan raakt. Het originele DeepSeek R1 vermijdde de vraag en antwoordde met CCP-georiënteerde banaliteiten. In tegenstelling daarvan levert R1 1776 een gedetailleerde, openhartige beoordeling: het bespreekt concrete geopolitieke en economische risico’s (onderbrekingen in de toeleveringsketen, marktvolatiliteit, mogelijke conflicten, enz.) die de aandelenkoers van NVIDIA kunnen beïnvloeden.

Door R1 1776 open source te maken, heeft Perplexity het model en de wijzigingen ook transparant gemaakt voor de gemeenschap. Ontwikkelaars en onderzoekers kunnen het downloaden van Hugging Face en het zelfs integreren via API, waardoor de verwijdering van censuur door anderen kan worden gecontroleerd en verder ontwikkeld.

(Bron: Perplexity AI)

Implicaties Van Het Verwijderen Van De Censuur

Perplexity AI’s beslissing om de Chinese censuur uit DeepSeek R1 te verwijderen, heeft verschillende belangrijke implicaties voor de AI-gemeenschap:

- Verhoogde Openheid En Eerlijkheid: Gebruikers van R1 1776 kunnen nu ongecensureerde, directe antwoorden krijgen op eerder ontoegankelijke onderwerpen, wat een overwinning is voor open onderzoek. Dit kan het een betrouwbaarder assistent maken voor onderzoekers, studenten of iedereen die geïnteresseerd is in gevoelige geopolitieke vragen. Het is een concreet voorbeeld van het gebruik van open-source AI om informatie-onderdrukking tegen te gaan.

- Behouden Prestaties: Er waren zorgen dat het aanpassen van het model om censuur te verwijderen, de prestaties op andere gebieden zou kunnen verslechteren. Echter, Perplexity meldt dat R1 1776’s kernvaardigheden – zoals wiskunde en logisch redeneren – gelijk blijven aan die van het originele model. In tests op meer dan 1.000 voorbeelden die een breed scala aan gevoelige vragen dekten, bleek het model “volledig ontcensuurde” te zijn, terwijl het hetzelfde niveau van redeneerprecisie als DeepSeek R1 behield. Dit suggereert dat het verwijderen van vooroordelen (tenminste in dit geval) niet ten koste ging van het algehele intelligentieniveau of de capaciteit, wat een bemoedigend teken is voor soortgelijke inspanningen in de toekomst.

- Positieve Gemeenschapsreactie En Samenwerking: Door het ontcensuurde model open source te maken, nodigt Perplexity de AI-gemeenschap uit om hun werk te inspecteren en te verbeteren. Het demonstreert een toewijding aan transparantie – de AI-equivalent van het laten zien van het werk. Enthusiastelingen en ontwikkelaars kunnen verifiëren dat de censuurrestricties echt zijn verwijderd en potentieel bijdragen aan verdere verfijningen. Dit bevordert vertrouwen en innovatie in een industrie waar gesloten modellen en verborgen moderatieregels gebruikelijk zijn.

- Ethische En Geopolitieke Overwegingen: Aan de andere kant roept het volledig verwijderen van censuur complexe ethische vragen op. Een onmiddellijke zorg is hoe dit ontcensuurde model mogelijk gebruikt kan worden in contexten waarin de gecensureerde onderwerpen illegaal of gevaarlijk zijn. Als iemand in het Chinese vasteland R1 1776 zou gebruiken, zouden de ongecensureerde antwoorden over het Tiananmen-plein of Taiwan de gebruiker in gevaar kunnen brengen. Er is ook het bredere geopolitieke signaal: een Amerikaans bedrijf dat een in China ontwikkeld model aanpast om Chinese censuur te tarten, kan worden gezien als een moedige ideologische houding. De naam “1776” benadrukt een thema van bevrijding, wat niet onopgemerkt is gebleven. Sommige critici beweren dat het vervangen van een set vooroordelen door een andere mogelijk is – essentieel vragen of het model nu een westerse visie in gevoelige gebieden kan weerspiegelen. De discussie benadrukt dat censuur versus openheid in AI niet alleen een technisch probleem is, maar ook een politiek en ethisch een.

Het verwijderen van censuur wordt grotendeels gevierd als een stap naar meer transparante en wereldwijd bruikbare AI-modellen, maar het dient ook als een herinnering dat wat een AI zou moeten zeggen, een gevoelig onderwerp is zonder universele overeenstemming.

(Bron: Perplexity AI)

Het Grotere Plaatje: AI-Censuur En Open-Source Transparantie

Perplexity’s R1 1776-lancering komt op een moment dat de AI-gemeenschap worstelt met vragen over hoe modellen om moeten gaan met omstreden inhoud. Censuur in AI-modellen kan uit veel plaatsen komen. In China zijn technologiebedrijven verplicht om strikte filters in te bouwen en zelfs vooraf ingestelde antwoorden voor politiek gevoelige onderwerpen. DeepSeek R1 is een voorbeeld hiervan – het was een open-source model, maar het droeg duidelijk de stempel van China’s censuurnormen in zijn training en fine-tuning. In tegenstelling daarmee zijn veel in het Westen ontwikkelde modellen, zoals OpenAI’s GPT-4 of Meta’s LLaMA, niet gebonden aan CCP-richtlijnen, maar ze hebben nog steeds moderatielagen (voor dingen als haatzaaiende uitlatingen, geweld of desinformatie) die sommige gebruikers “censuur” noemen. De grens tussen redelijke moderatie en ongewenste censuur kan vaag zijn en hangt vaak af van culturele of politieke perspectief.

Wat Perplexity AI met DeepSeek R1 heeft gedaan, roept het idee op dat open-source modellen kunnen worden aangepast aan verschillende waarde-systemen of regelgevingsomgevingen. In theorie zou je meerdere versies van een model kunnen maken: een die voldoet aan Chinese regelgeving (voor gebruik in China) en een die volledig open is (voor gebruik elders). R1 1776 is eigenlijk het laatste geval – een ontcensuurde fork die bedoeld is voor een wereldwijd publiek dat ongefilterde antwoorden prefereert. Dit soort forking is alleen mogelijk omdat DeepSeek R1’s gewichten openbaar beschikbaar waren. Het benadrukt het voordeel van open source in AI: transparantie. Iedereen kan het model nemen en aanpassen, of het nu is om veiligheidsmaatregelen toe te voegen of, zoals in dit geval, om opgelegde beperkingen te verwijderen. Het openbaar maken van het model, de trainingsdata, de code of de gewichten betekent dat de gemeenschap kan controleren hoe het model is aangepast. (Perplexity heeft niet alle gegevensbronnen die het voor de ont-censuur gebruikt heeft, volledig onthuld, maar door het model zelf te publiceren, hebben ze anderen in staat gesteld om zijn gedrag te observeren en het zelfs opnieuw te trainen als dat nodig is.)

Deze gebeurtenis knikt ook naar de bredere geopolitieke dynamiek van AI-ontwikkeling. We zien een vorm van dialoog (of confrontatie) tussen verschillende governance-modellen voor AI. Een in China ontwikkeld model met bepaalde ingebakken wereldbeelden wordt genomen door een in de VS gevestigd team en aangepast om een meer open informatie-ethos te weerspiegelen. Het is een getuigenis van hoe globaal en grensoverschrijdend AI-technologie is: onderzoekers overal kunnen op elkaars werk bouwen, maar ze zijn niet verplicht om de oorspronkelijke beperkingen over te nemen. Na verloop van tijd kunnen we meer van dit soort gevallen zien – waar modellen worden “vertaald” of aangepast tussen verschillende culturele contexten. Het roept de vraag op of AI ooit echt universeel kan zijn, of dat we uiteindelijk met regiospecifieke versies zullen eindigen die lokale normen volgen. Transparantie en openheid bieden een pad om dit te navigeren: als alle partijen de modellen kunnen inspecteren, is de discussie over vooroordelen en censuur tenminste open en niet verborgen achter corporate of overheidsgeheimhouding.

Tenslotte benadrukt Perplexity’s stap een belangrijk punt in de discussie over AI-controle: wie beslist wat een AI kan of niet kan zeggen? In open-source projecten wordt die macht gedecentraliseerd. De gemeenschap – of individuele ontwikkelaars – kan beslissen om striktere filters te implementeren of ze te versoepelen. In het geval van R1 1776 besloot Perplexity dat de voordelen van een ontcensuurde model de risico’s overtroffen en ze hadden de vrijheid om die beslissing te nemen en het resultaat openbaar te maken. Het is een moedig voorbeeld van het soort experimenten dat open AI-ontwikkeling mogelijk maakt.