Andersons hoek

Op zoek naar ‘Uilen en Hagedissen’ in het publiek van een adverteerder

Aangezien de online reclamemarkt naar verwachting 740,3 miljard USD heeft uitgegeven in 2023, is het gemakkelijk te begrijpen waarom reclamebedrijven aanzienlijke middelen investeren in deze specifieke tak van computer vision-onderzoek.

Hoewel de branche geïsoleerd en beschermend is, publiceert ze af en toe studies die hinten op geavanceerder, propriëtair werk in gezichts- en oogbewegingsherkenning – waaronder leeftijdsherkenning, centraal voor demografische analytische statistieken:

Het schatten van de leeftijd in een reclamecontext is van belang voor adverteerders die mogelijk een bepaalde leeftijdsdemografische doelgroep aanstrelen. In dit experimentele voorbeeld van automatische gezichtsleeftijdschatting wordt de leeftijd van artiest Bob Dylan gevolgd over de jaren. Bron: https://arxiv.org/pdf/1906.03625

Deze studies, die zelden in openbare repositories zoals Arxiv verschijnen, gebruiken legitiem geworven deelnemers als basis voor AI-gedreven analyse die ernaar streeft te bepalen in hoeverre en op welke manier de kijker zich verhoudt tot een reclame.

Dlib’s Histogram of Oriented Gradients (HoG) wordt vaak gebruikt in gezichtsschattingsystemen. Bron: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Dierlijk instinct

In dit verband is de reclamebranche natuurlijk geïnteresseerd in het bepalen van valse positieven (gelegenheden waarbij een analytisch systeem de acties van een onderwerp verkeerd interpreteert) en in het vaststellen van duidelijke criteria voor wanneer de persoon die naar hun commercials kijkt, niet volledig betrokken is bij de inhoud.

Wat betreft schermgebaseerde reclame, richten studies zich meestal op twee problemen in twee omgevingen. De omgevingen zijn ‘desktop’ of ‘mobile’, elk met zijn eigen kenmerken die een op maat gemaakte oplossing voor het volgen van de kijker vereisen; en de problemen – vanuit het oogpunt van de adverteerder – worden vertegenwoordigd door uilen- en hagedisgedrag – de neiging van kijkers om niet volledig aandacht te besteden aan een reclame die voor hen staat.

Voorbeelden van ‘uilen’ en ‘hagedis’ gedrag in een onderwerp van een reclameonderzoeksproject. Bron: https://arxiv.org/pdf/1508.04028

Als je wegkijkt van de bedoelde reclame met je hele hoofd, is dit ‘uilen’ gedrag; als je hoofdpositie statisch is, maar je ogen afdwalen van het scherm, is dit ‘hagedis’ gedrag. In termen van analyse en testen van nieuwe reclame’s onder gecontroleerde omstandigheden, zijn dit essentiële acties voor een systeem om te kunnen vastleggen.

Een nieuw artikel van SmartEye’s Affectiva-acquisitie richt zich op deze kwesties, met een architectuur die verschillende bestaande kaders combineert om een samengestelde en geconcateneerde set functies te bieden voor alle vereiste voorwaarden en mogelijke reacties – en om te kunnen bepalen of een kijker verveeld, geëngageerd of op een of andere manier verwijderd is van de inhoud die de adverteerder hem wil laten zien.

Voorbeelden van ware en valse positieven die worden gedetecteerd door het nieuwe aandachtsysteem voor verschillende afleidingsignalen, afzonderlijk getoond voor desktop- en mobiele apparaten. Bron: https://arxiv.org/pdf/2504.06237

De auteurs verklaren*:

‘Beperkt onderzoek heeft zich gericht op het monitoren van aandacht tijdens online reclame. Terwijl deze studies zich richtten op het schatten van hoofdpositie of oogrichting om gevallen van afgeleide blik te identificeren, negeren ze kritieke parameters zoals apparaattype (desktop of mobiel), camera-plaatsing ten opzichte van het scherm en schermgrootte. Deze factoren beïnvloeden aandachtdetectie aanzienlijk.

‘In dit artikel stellen we een architectuur voor aandachtdetectie voor die het detecteren van verschillende afleiders omvat, waaronder zowel het uilen- als het hagedisgedrag van het wegkijken van het scherm, spreken, slaperigheid (door gapen en langdurige oogsluiting) en het onbeheerd laten van schermen.

‘In tegenstelling tot eerdere benaderingen, combineert onze methode apparaatspecifieke functies zoals apparaattype, camera-plaatsing, schermgrootte (voor desktops) en camera-oriëntatie (voor mobiele apparaten) met de ruwe blikschattingswaarde om de nauwkeurigheid van aandachtdetectie te verbeteren.’

Het nieuwe onderzoek heet Monitoring Viewer Attention During Online Ads en komt van vier onderzoekers bij Affectiva.

Methode en gegevens

Grotendeels vanwege de geheimhouding en gesloten aard van dergelijke systemen, vergelijkt het nieuwe artikel de benadering van de auteurs niet rechtstreeks met die van concurrenten, maar presenteert het zijn bevindingen uitsluitend als ablatie-studies; evenmin houdt het artikel zich aan het gebruikelijke formaat van Computer Vision-literatuur. Daarom zullen we naar het onderzoek kijken zoals het wordt gepresenteerd.

De auteurs benadrukken dat slechts een beperkt aantal studies zich specifiek heeft gericht op aandachtdetectie in de context van online reclame. In de AFFDEX SDK, die real-time multi-face recognition biedt, wordt aandacht afgeleid uit hoofdpositie, met deelnemers die als aandachtloos worden gelabeld als hun hoofdhoek een bepaalde drempel overschrijdt.

Een voorbeeld uit de AFFDEX SDK, een Affectiva-systeem dat hoofdpositie gebruikt als indicator van aandacht. Bron: https://www.youtube.com/watch?v=c2CWb5jHmbY

In de 2019-samenwerking Automatic Measurement of Visual Attention to Video Content using Deep Learning, werd een dataset van ongeveer 28.000 deelnemers geannoteerd voor verschillende aandachtloze gedragingen, waaronder wegkijken, ogen sluiten of deelnemen aan niet-gerelateerde activiteiten, en een CNN-LSTM-model getraind om aandacht te detecteren uit gezichtsuitdrukking over tijd.

Uit het artikel van 2019, een voorbeeld dat voorspelde aandachtsstaten illustreert voor een kijker die video-inhoud bekijkt. Bron: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Echter, de auteurs merken op dat deze eerdere inspanningen geen rekening hielden met apparaatspecifieke factoren, zoals of de deelnemer een desktop- of mobiel apparaat gebruikte; noch hebben ze rekening gehouden met schermgrootte of camera-plaatsing. Bovendien richt het AFFDEX-systeem zich alleen op het identificeren van blikafleiding en laat het andere bronnen van afleiding buiten beschouwing, terwijl de 2019-studie een bredere reeks gedragingen probeert te detecteren – maar het gebruik van een enkele ondiepe CNN kan, zoals het artikel stelt, ontoereikend zijn geweest voor deze taak.

De auteurs merken op dat sommige van de meest populaire onderzoeken op dit gebied niet zijn geoptimaliseerd voor ad-testen, die andere behoeften hebben in vergelijking met domeinen zoals rijden of onderwijs – waar camera-plaatsing en -kalibratie meestal van tevoren zijn vastgesteld, in plaats van ongekalibreerde instellingen te gebruiken, en binnen de beperkte blikbereik van desktop- en mobiele apparaten te opereren.

Daarom hebben ze een architectuur ontwikkeld voor het detecteren van kijkeraandacht tijdens online reclame, die twee commerciële toolkits combineert: AFFDEX 2.0 en SmartEye SDK.

Voorbeelden van gezichtsanalyse uit AFFDEX 2.0. Bron: https://arxiv.org/pdf/2202.12059

Deze eerdere werken extraheren lage-niveaukenmerken zoals gezichtsuitdrukkingen, hoofdpositie en blikrichting. Deze kenmerken worden vervolgens verwerkt om hogere-niveau-indicatoren te produceren, waaronder blikpositie op het scherm; gapen; en spreken.

Het systeem identificeert vier afleidingstypen: blik van het scherm af; slaperigheid,; spreken; en onbeheerde schermen. Het systeem past ook blikanalyse aan op basis van het apparaattype (desktop of mobiel).

Gegevenssets: Blik

De auteurs gebruikten vier gegevenssets om het aandachtdetectiesysteem te trainen en te evalueren: drie die zich individueel richten op blikgedrag, spreken en gapen; en een vierde die is afgeleid van echte ad-testsessies met een mengeling van afleidingstypen.

Vanwege de specifieke vereisten van het onderzoek, werden aangepaste gegevenssets voor elk van deze categorieën gemaakt. Alle gegevenssets werden uit een propriëtaire repository gehaald met miljoenen opgenomen sessies van deelnemers die naar reclame keken in thuissituaties of op het werk, met een webgebaseerde instelling, met geïnformeerde toestemming – en vanwege de beperkingen van die toestemmingsovereenkomsten, verklaren de auteurs dat de gegevenssets voor het nieuwe onderzoek niet openbaar gemaakt kunnen worden.

Om de blikgegevensset te construeren, werden deelnemers gevraagd om een bewegende stip over verschillende punten op het scherm te volgen, waaronder de randen, en vervolgens weg te kijken van het scherm in vier richtingen (omhoog, omlaag, links en rechts) met de sequentie herhaald drie keer. Op deze manier werd de relatie tussen opname en dekking vastgesteld:

Schermopnames van de blikvideo-stimulus op (a) desktop- en (b) mobiele apparaten. De eerste en derde kaders tonen instructies om een bewegende stip te volgen, terwijl de tweede en vierde deelnemers aansporen om weg te kijken van het scherm.

De bewegende-stipsegmenten werden gelabeld als aandachtig, en de af-schermsegmenten als aandachtloos, waardoor een gelabelde gegevensset van zowel positieve als negatieve voorbeelden ontstond.

Elke video duurde ongeveer 160 seconden, met afzonderlijke versies gemaakt voor desktop- en mobiele platforms, elk met resoluties van 1920×1080 en 608×1080, respectievelijk.

In totaal werden 609 video’s verzameld, waarvan 322 voor desktop en 287 voor mobiel. Labels werden automatisch toegepast op basis van de video-inhoud, en de gegevensset gesplitst in 158 trainingsvoorbeelden en 451 voor testen.

Gegevenssets: Spreken

In deze context is een van de criteria die ‘aandachtloosheid’ definiëren wanneer iemand langer dan een seconde spreekt (wat een momentopname kan zijn, of zelfs een hoest).

Aangezien de gecontroleerde omgeving geen audio opneemt of analyseert, wordt spreken afgeleid door de interne beweging van geschatte gezichtskenmerken te observeren. Daarom hebben de auteurs een gegevensset gebaseerd op uitsluitend visuele input gemaakt, afgeleid van hun interne repository, en verdeeld in twee delen: het eerste bevatte ongeveer 5.500 video’s, elk handmatig gelabeld door drie annotators als spreken of niet spreken (waarvan 4.400 werden gebruikt voor training en validatie, en 1.100 voor testen).

Het tweede deel bestond uit 16.000 sessies die automatisch waren gelabeld op basis van sessietype: 10.500 sessies toonden deelnemers die zwijgend naar reclame keken, en 5.500 sessies toonden deelnemers die meningen over merken uitdrukte.

Gegevenssets: Gapen

Hoewel sommige ‘gapen’-gegevenssets bestaan, waaronder YawDD en Driver Fatigue, beweren de auteurs dat geen van deze geschikt is voor ad-testscenario’s, omdat ze ofwel gesimuleerde gapen bevatten ofwel gezichtsvervormingen die verward kunnen worden met angst of andere, niet-gapende acties.

Daarom hebben de auteurs 735 video’s uit hun interne collectie gebruikt, waarbij sessies werden geselecteerd die waarschijnlijk een kaakval bevatten dat langer dan een seconde duurde. Elke video werd handmatig gelabeld door drie annotators als actief of inactief gapen. Slechts 2,6 procent van de kaders bevatte actief gapen, waardoor een klasse-ongelijkheid ontstond, en de gegevensset werd gesplitst in 670 trainingsvideo’s en 65 voor testen.

Gegevenssets: Afleiding

De afleidinggegevensset werd ook afgeleid van de auteurs’ ad-testrepository, waar deelnemers daadwerkelijke reclame hadden bekeken zonder toegewezen taken. In totaal werden 520 sessies (193 op mobiel en 327 op desktop-omgevingen) willekeurig geselecteerd en handmatig gelabeld door drie annotators als aandachtig of aandachtloos.

Aandachtloos gedrag omvatte blik van het scherm af, spreken, slaperigheid en onbeheerde schermen. De sessies omvatten diverse regio’s over de hele wereld, met desktop-opnames vaker voorkomend vanwege de flexibele webcam-plaatsing.

Aandachtsmodellen

Het voorgestelde aandachtsmodel verwerkt lage-niveauvisuele kenmerken, namelijk gezichtsuitdrukkingen; hoofdpositie; en blikrichting – geëxtraheerd via de eerder genoemde AFFDEX 2.0 en SmartEye SDK.

Deze worden vervolgens omgezet in hogere-niveau-indicatoren, waarbij elke afleider wordt behandeld door een afzonderlijke binaire classificator getraind op zijn eigen gegevensset voor onafhankelijke optimalisatie en evaluatie.

Schema voor het voorgestelde monitoren van aandacht.

De blikmodel bepaalt of de kijker naar of weg van het scherm kijkt met behulp van genormaliseerde blikcoördinaten, met afzonderlijke kalibratie voor desktop- en mobiele apparaten. Dit proces wordt ondersteund door een lineaire Support Vector Machine (SVM), getraind op ruimtelijke en temporele kenmerken, die een geheugvenster incorporeert om snelle blikverschuivingen te gladstellen.

Om spreken zonder audio te detecteren, gebruikte het systeem mondregio’s en een 3D-CNN getraind op zowel conversatie- als niet-conversatievideosegmenten. Labels werden toegewezen op basis van sessietype, met temporele gladstelling die valse positieven reduceerde die konden voortkomen uit korte mondbewegingen.

Gapen werd gedetecteerd met behulp van volledige gezichtsafbeeldingen, om bredere gezichtsbeweging te kunnen vastleggen, met een 3D-CNN getraind op handmatig gelabelde kaders (hoewel de taak werd bemoeilijkt door de lage frequentie van gapen in natuurlijke kijkgedrag en door de gelijkenis met andere uitdrukkingen).

Schermverlating werd geïdentificeerd door het ontbreken van een gezicht of extreme hoofdpositie, met voorspellingen gedaan door een beslissingsboom.

Definitieve aandachtsstatus werd bepaald met behulp van een vaste regel: als een module aandachtloosheid detecteerde, werd de kijker gemarkeerd als aandachtloos – een benadering die gevoeligheid prioriteert en afzonderlijk is afgesteld voor desktop- en mobiele contexten.

Tests

Zoals eerder vermeld, volgen de tests een ablatieve methode, waarbij componenten worden verwijderd en het effect op het resultaat wordt genoteerd.

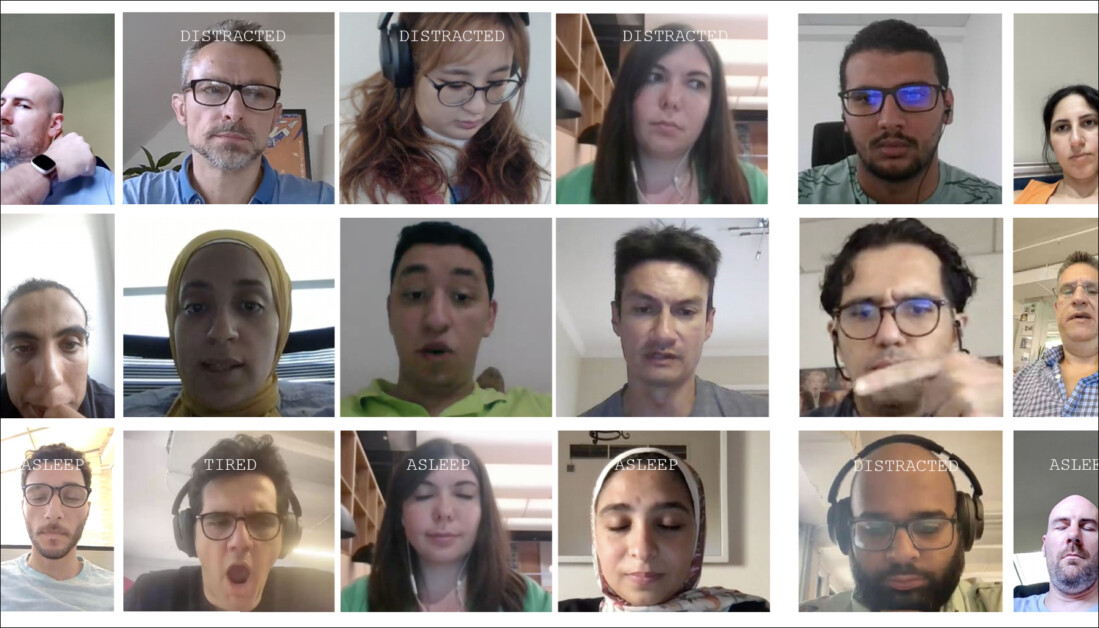

Verschillende categorieën van waargenomen aandachtloosheid geïdentificeerd in de studie.

Het blikmodel identificeerde af-schermgedrag via drie belangrijke stappen: normaliseren van ruwe blikschattingswaarden, fijnafstemmen van de uitvoer en schatting van schermgrootte voor desktopapparaten.

Om de belangrijkheid van elke component te begrijpen, verwijderden de auteurs ze afzonderlijk en evalueerden de prestaties op 226 desktop- en 225 mobiele video’s afgeleid van twee gegevenssets. De resultaten, gemeten door G-mean en F1 scores, worden hieronder weergegeven:

Resultaten die de prestaties van het volledige blikmodel aantonen, naast versies met afzonderlijke verwerkingsstappen verwijderd.

In alle gevallen daalde de prestatie wanneer een stap werd weggelaten. Normalisatie bleek vooral waardevol op desktops, waar camera-plaatsing meer varieert dan op mobiele apparaten.

De studie beoordeelde ook hoe visuele kenmerken mobiele camera-oriëntatie voorspelden: gezichtslocatie, hoofdpositie en oogblik scoorden 0,75, 0,74 en 0,60, terwijl hun combinatie 0,91 bereikte, waardoor – zoals de auteurs stellen – het voordeel van het integreren van meerdere signalen werd aangetoond.

Het sprekenmodel, getraind op verticale lipafstand, bereikte een ROC-AUC van 0,97 op de handmatig gelabelde testset en 0,96 op de grotere automatisch gelabelde gegevensset, wat een consistente prestatie aantoont over beide.

Het gapenmodel bereikte een ROC-AUC van 96,6 procent met behulp van alleen de mondaspectverhouding, wat verbeterde tot 97,5 procent toen het werd gecombineerd met actie-eenheidvoorspellingen van AFFDEX 2.0.

Het onbeheerde-schermmodel classificeerde momenten als aandachtloos wanneer zowel AFFDEX 2.0 als SmartEye geen gezicht konden detecteren voor meer dan een seconde. Om de geldigheid hiervan te beoordelen, hebben de auteurs alle dergelijke geen-gezichtsgebeurtenissen in de echte afleidinggegevensset handmatig geannoteerd, waarbij de onderliggende oorzaak van elke activatie werd geïdentificeerd. Dubieuze gevallen (zoals camera-obstructie of video-distorsie) werden uit de analyse uitgesloten.

Zoals te zien is in de resultaatentabel hieronder, waren slechts 27 procent van de ‘geen-gezicht’-activaties te wijten aan gebruikers die fysiek het scherm verlieten.

Uiteenlopende redenen die zijn verkregen voor het niet vinden van een gezicht, in bepaalde gevallen.

Het artikel stelt:

‘Ondanks dat onbeheerde schermen slechts 27% van de gevallen vormen die het geen-gezichtsignaal activeren, werd het geactiveerd om andere redenen die aandachtloosheid aanduiden, zoals deelnemers die met een extreme hoek van het scherm wegkijken, overmatige beweging maken of hun gezicht aanzienlijk bedekken met een voorwerp/hand.’

In de laatste van de kwantitatieve tests, evalueerden de auteurs hoe het progressief toevoegen van verschillende afleidingsignalen – blik van het scherm af (via blik en hoofdpositie), slaperigheid, spreken en onbeheerde schermen – de algehele prestatie van hun aandachtsmodel beïnvloedde.

De testen werden uitgevoerd op twee gegevenssets: de echte afleidinggegevensset en een testsubset van de blikgegevensset. G-mean en F1-scores werden gebruikt om de prestatie te meten (hoewel slaperigheid en spreken werden uitgesloten van de blikgegevenssetanalyse vanwege hun beperkte relevantie in deze context).

Zoals hieronder te zien is, verbeterde aandachtdetectie consistent naarmate meer afleidingstypen werden toegevoegd, met blik van het scherm af als de meest voorkomende afleider, die de sterkste basislijn bood.

Het effect van het toevoegen van diverse afleidingsignalen aan de architectuur.

Over deze resultaten stelt het artikel:

‘Uit de resultaten kunnen we allereerst concluderen dat de integratie van alle afleidingsignalen bijdraagt aan verbeterde aandachtdetectie.

‘Ten tweede is de verbetering in aandachtdetectie consistent over zowel desktop- als mobiele apparaten. Ten derde laten de mobiele sessies in de echte gegevensset aanzienlijke hoofdbewegingen zien wanneer ze wegkijken, die gemakkelijk worden gedetecteerd, waardoor een betere prestatie ontstaat voor mobiele apparaten in vergelijking met desktops. Ten vierde heeft het toevoegen van het slaperigheidssignaal een relatief geringe verbetering in vergelijking met andere signalen, aangezien het meestal zelden voorkomt.

‘Ten slotte heeft het onbeheerde-scherm-signaal een relatief grotere verbetering op mobiele apparaten in vergelijking met desktops, aangezien mobiele apparaten gemakkelijk onbeheerd kunnen worden gelaten.’

De auteurs vergeleken hun model ook met AFFDEX 1.0, een eerder systeem dat in ad-testen werd gebruikt – en zelfs het hoofdgebaseerde blikdetectiemodel van het huidige model overtrof AFFDEX 1.0 op beide apparaattypen:

‘Dit is een resultaat van het incorporeren van hoofdbewegingen in zowel de yaw- als de pitchrichting, evenals het normaliseren van de hoofdpositie om kleine veranderingen te verrekenen. De uitgesproken hoofdbewegingen in de echte mobiele gegevensset hebben ervoor gezorgd dat ons hoofdmodel soortgelijk presteert als AFFDEX 1.0.’

De auteurs sluiten het artikel af met een (misschien enigszins perfunctoire) kwalitatieve testronde, hieronder weergegeven.

Voorbeelden van uitvoer van het aandachtsmodel over desktop- en mobiele apparaten, waarbij elke rij voorbeelden toont van ware en valse positieven voor verschillende afleidingstypen.

De auteurs stellen:

‘De resultaten geven aan dat ons model verschillende afleiders effectief detecteert in ongecontroleerde omgevingen. Het kan echter soms valse positieven produceren in bepaalde randgevallen, zoals extreme hoofdkanteling bij het behouden van de blik op het scherm, enkele mondbedekkingen, overmatig wazige ogen of sterk verdonkerde gezichtsbeelden. ‘

Conclusie

Hoewel de resultaten een gemeten maar betekenisvolle vooruitgang vertegenwoordigen ten opzichte van eerdere studies, ligt de diepere waarde van het onderzoek in de blik die het biedt op de aanhoudende drang om toegang te krijgen tot de interne toestand van de kijker. Hoewel de gegevens met toestemming zijn verzameld, wijst de methodologie naar toekomstige kaders die zich kunnen uitstrekken tot voorbij gestructureerde, marktonderzoeksomgevingen.

Deze enigszins paranoïde conclusie wordt nog versterkt door de geïsoleerde, beperkte en zorgvuldig beschermde aard van deze specifieke tak van onderzoek.

* Mijn conversie van de inline-citaten van de auteurs naar hyperlinks.

Eerst gepubliceerd op woensdag 9 april 2025