Kunstmatige intelligentie

Het benutten van menselijke aandacht kan AI-gegenereerde afbeeldingen verbeteren

Nieuw onderzoek uit China heeft een methode voorgesteld om de kwaliteit van afbeeldingen gegenereerd door Latent Diffusion Models (LDM’s) zoals Stable Diffusion te verbeteren.

De methode richt zich op het optimaliseren van de opvallende gebieden van een afbeelding – gebieden die het meest waarschijnlijk menselijke aandacht trekken.

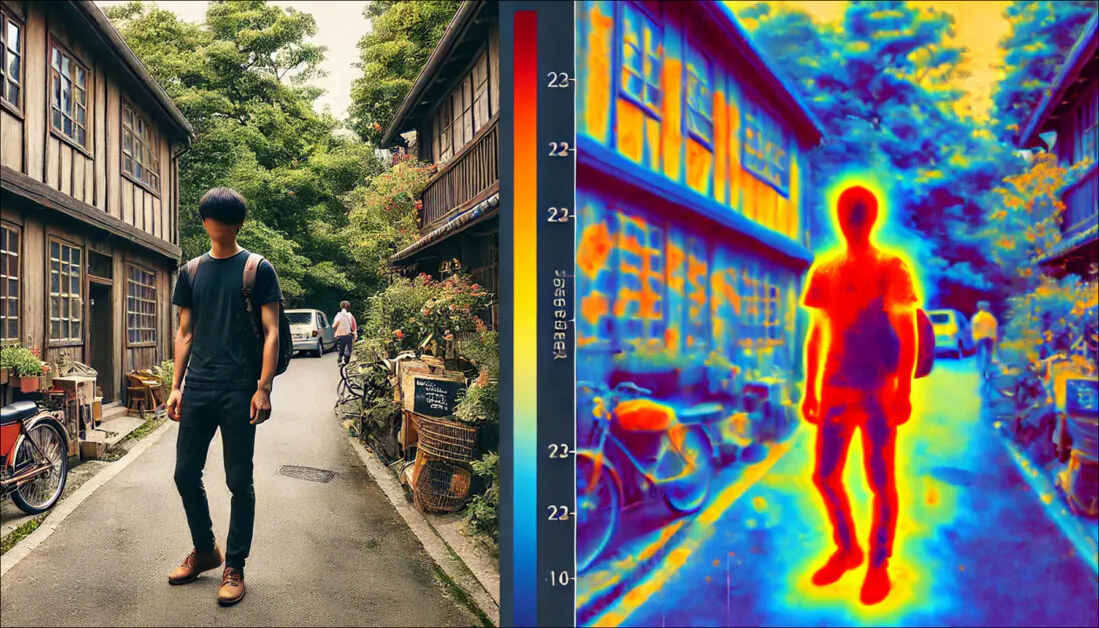

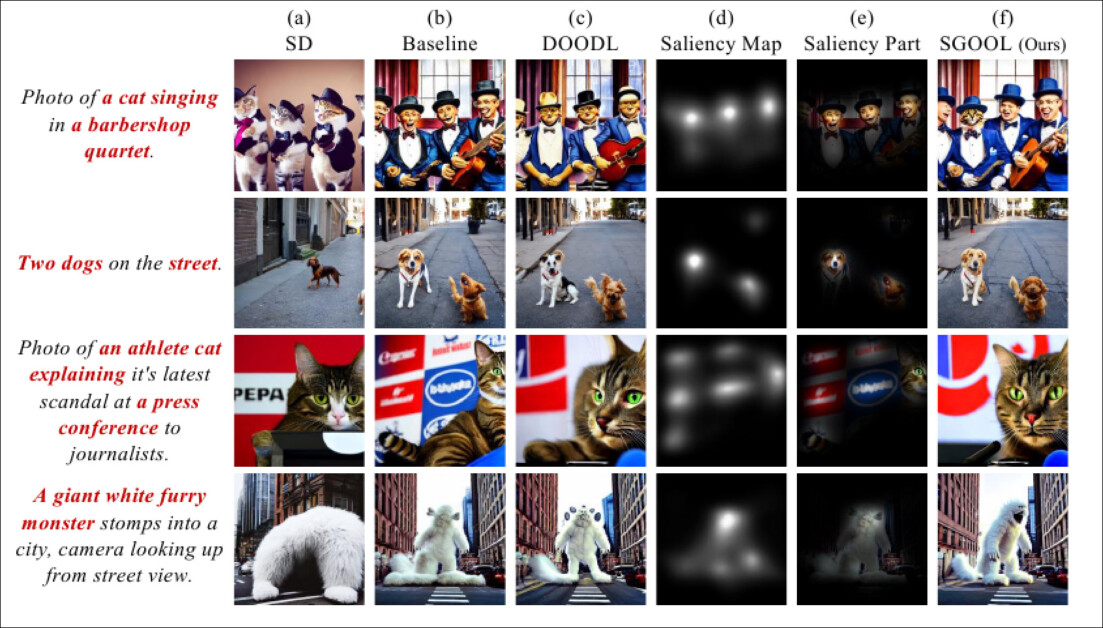

Het nieuwe onderzoek heeft aangetoond dat saliency-kaarten (vierde kolom van links) kunnen worden gebruikt als filter, of ‘masker’, voor het sturen van de locus van aandacht in denoising-processen naar gebieden van de afbeelding die mensen het meest waarschijnlijk zullen opmerken. Bron: https://arxiv.org/pdf/2410.10257

Traditionele methoden optimaliseren de hele afbeelding uniform, terwijl de nieuwe aanpak een saliency-detector gebruikt om meer ‘belangrijke’ gebieden te identificeren en prioriteit te geven, net zoals mensen doen.

In kwantitatieve en kwalitatieve tests was de methode van de onderzoekers in staat om eerder diffusion-gebaseerde modellen te overtreffen, zowel in termen van afbeeldingskwaliteit als trouw aan tekstprompts.

De nieuwe aanpak scoorde ook het beste in een menselijke perceptietest met 100 deelnemers.

Natuurlijke selectie

Saliency, de mogelijkheid om informatie in de echte wereld en in afbeeldingen te prioriteren, is een essentieel onderdeel van het menselijk gezichtsvermogen.

Een eenvoudig voorbeeld hiervan is de toegenomen aandacht voor detail die klassieke kunst toekent aan belangrijke gebieden van een schilderij, zoals het gezicht in een portret, of de masten van een schip in een zee-gebaseerd onderwerp; in dergelijke voorbeelden convergeert de aandacht van de kunstenaar naar het centrale onderwerp, waardoor bredere details zoals een portretachtergrond of de verre golven van een storm schetsmatiger en meer algemeen vertegenwoordigd zijn dan gedetailleerd.

Gebaseerd op menselijke studies, zijn er machine learning-methoden ontwikkeld in de afgelopen decade die deze menselijke locus van interesse in elke afbeelding kunnen repliceren of ten minste benaderen.

Objectsegmentatie (semantische segmentatie) kan helpen bij het identificeren van facetten van een afbeelding en het ontwikkelen van overeenkomstige saliency-kaarten. Bron: https://arxiv.org/pdf/1312.6034

In de loop van onderzoeksliteratuur is de meest populaire saliency-kaartdetector in de afgelopen vijf jaar de 2016 Gradient-weighted Class Activation Mapping (Grad-CAM) initiatief, dat later evolueerde naar het verbeterde Grad-CAM++ systeem, onder andere varianten en verfijningen.

Grad-CAM gebruikt de gradientactivatie van een semantisch token (zoals ‘hond’ of ‘kat’) om een visuele kaart te produceren van waar het concept of annotatie waarschijnlijk in de afbeelding wordt weergegeven.

Voorbeelden uit het oorspronkelijke Grad-CAM-paper. In de tweede kolom individueert guided backpropagation alle bijdragegebieden. In de derde kolom worden de semantische kaarten getekend voor de twee concepten ‘hond’ en ‘kat’. De vierde kolom vertegenwoordigt de concatenatie van de twee voorgaande inferenties. De vijfde, de occlusie (masker) kaart die overeenkomt met de inferentie; en ten slotte, in de zesde kolom, Grad-CAM visualiseert een ResNet-18-laag. Bron: https://arxiv.org/pdf/1610.02391

Menselijke enquêtes over de resultaten die met deze methoden zijn behaald, hebben een overeenkomst aangetoond tussen deze wiskundige individuatie van sleutelinteressepunten in een afbeelding en menselijke aandacht (bij het scannen van de afbeelding).

SGOOL

Het nieuwe paper overweegt wat saliency kan bijdragen aan tekst-naar-afbeelding (en, potentieel, tekst-naar-video) systemen zoals Stable Diffusion en Flux.

Wanneer een gebruikers tekstprompt wordt geïnterpreteerd, onderzoeken Latent Diffusion Models hun getrainde latent ruimte voor geleerde visuele concepten die overeenkomen met de woorden of zinnen die worden gebruikt. Ze parsen deze gevonden datapunten vervolgens door een denoising proces, waarbij willekeurig ruis langzaam evolueert naar een creatieve interpretatie van de gebruikers tekstprompt.

Op dit punt geeft het model gelijke aandacht aan elk onderdeel van de afbeelding. Sinds de popularisering van diffusiemodellen in 2022, met de lancering van OpenAI’s beschikbare Dall-E afbeeldingengeneratoren, en de daaropvolgende open-sourcing van Stability.ai’s Stable Diffusion framework, hebben gebruikers ontdekt dat ‘essentiële’ secties van een afbeelding vaak onderbediend zijn.

Aangezien in een typische afbeelding van een mens, het gezicht van de persoon (dat van maximale importantie is voor de kijker) waarschijnlijk niet meer dan 10-35% van de totale afbeelding in beslag neemt, werkt deze democratische methode van aandachtsverdeling tegen zowel de aard van menselijke perceptie als de geschiedenis van kunst en fotografie.

Wanneer de knopen op iemands spijkerbroek evenveel rekenkracht krijgen als hun ogen, kan de toewijzing van resources non-optimaal worden genoemd.

Daarom gebruikt de nieuwe methode die door de auteurs wordt voorgesteld, getiteld Saliency Guided Optimization of Diffusion Latents (SGOOL), een saliency mapper om meer aandacht te vestigen op verwaarloosde gebieden van een afbeelding, en wijdt minder resources toe aan secties die waarschijnlijk aan de periferie van de aandacht van de kijker zullen blijven.

Methode

De SGOOL-pijplijn omvat afbeeldingsgeneratie, saliency-mapping en optimalisatie, waarbij de totale afbeelding en de saliency-geraffineerde afbeelding gezamenlijk worden verwerkt.

Conceptueel schema voor SGOOL.

De latent embeddings van het diffusiemodel worden direct geoptimaliseerd met fine-tuning, waardoor de noodzaak om een specifiek model te trainen wordt verwijderd. Stanford University’s Denoising Diffusion Implicit Model (DDIM) sampling methode, bekend bij gebruikers van Stable Diffusion, wordt aangepast om de secundaire informatie die door saliency-kaarten wordt verstrekt te incorporeren.

Het paper vermeldt:

‘We gebruiken eerst een saliency-detector om het menselijk visueel aandachtsysteem te imiteren en de opvallende gebieden te markeren. Om hertrainen van een extra model te vermijden, optimaliseren we onze methode direct de diffusie-latenten.

‘Bovendien gebruikt SGOOL een omkeerbare diffusieproces en schenkt het de voordelen van constante geheugenuitvoering. Daarom wordt onze methode een parameter-efficiënte en plug-and-play fine-tuning methode. Uitgebreide experimenten zijn uitgevoerd met meerdere metrics en menselijke evaluatie.’

Aangezien deze methode meerdere iteraties van het denoising-proces vereist, hebben de auteurs de Direct Optimization Of Diffusion Latents (DOODL) framework aangenomen, dat een omkeerbare diffusie proces biedt – hoewel het nog steeds aandacht besteedt aan de gehele afbeelding.

Om gebieden van menselijke interesse te definiëren, hebben de onderzoekers de University of Dundee’s 2022 TransalNet framework gebruikt.

Voorbeelden van saliency-detectie uit het 2022 TransalNet-project. Bron: https://discovery.dundee.ac.uk/ws/portalfiles/portal/89737376/1_s2.0_S0925231222004714_main.pdf

De opvallende gebieden die door TransalNet werden verwerkt, werden vervolgens geknipt om conclusieve saliency-secties te genereren die waarschijnlijk het meest interessant zullen zijn voor echte mensen.

Het verschil tussen de gebruikerstekst en de afbeelding moet worden overwogen, in termen van het definiëren van een verliesfunctie die kan bepalen of het proces werkt. Hiervoor werd een versie van OpenAI’s Contrastive Language–Image Pre-training (CLIP) – inmiddels een hoofdonderdeel van de beeldsynthesesector – gebruikt, samen met de overweging van de geschatte semantische afstand tussen de tekstprompt en de globale (niet-saliency) afbeeldinguitvoer.

De auteurs beweren:

‘[Onze] finale verliesfunctie houdt rekening met de relaties tussen saliency-delen en de globale afbeelding tegelijk, wat helpt om lokale details en globale consistentie in het generatieproces in evenwicht te brengen.

‘Deze saliency-geïnformeerde verliesfunctie wordt gebruikt om de beeldlatenten te optimaliseren. De gradiënten worden berekend op de geruisde [latent] en gebruikt om het conditioneringseffect van de invoerprompt op zowel saliënte als globale aspecten van de oorspronkelijk gegenereerde afbeelding te versterken.’

Gegevens en tests

Om SGOOL te testen, hebben de auteurs een ‘vanille’ distributie van Stable Diffusion V1.4 (aangeduid als ‘SD’ in testresultaten) en Stable Diffusion met CLIP-guidance (aangeduid als ‘baseline’ in resultaten) gebruikt.

Het systeem werd geëvalueerd tegen drie openbare datasets: CommonSyntacticProcesses (CSP), DrawBench, en DailyDallE*.

De laatste bevat 99 uitgebreide prompts van een kunstenaar die in een van de blogposts van OpenAI wordt gefeatured, terwijl DrawBench 200 prompts biedt in 11 categorieën. CSP bestaat uit 52 prompts op basis van acht diverse grammaticale gevallen.

Voor SD, baseline en SGOOL werden in de tests de CLIP-model gebruikt over ViT/B-32 om de afbeelding en tekst embeddings te genereren. Dezelfde prompt en random seed werd gebruikt. De uitvoergrootte was 256×256, en de standaardgewichten en instellingen van TransalNet werden gebruikt.

Naast de CLIP-score-metric, werd een geschatte Human Preference Score (HPS) gebruikt, naast een real-world studie met 100 deelnemers.

Kwantitatieve resultaten die SGOOL vergelijken met eerdere configuraties.

Met betrekking tot de kwantitatieve resultaten die in de bovenstaande tabel worden weergegeven, vermeldt het paper:

‘[Ons] model overtreft significant SD en Baseline op alle datasets onder zowel CLIP-score als HPS-metrics. De gemiddelde resultaten van ons model op CLIP-score en HPS zijn 3,05 en 0,0029 hoger dan de tweede plaats, respectievelijk.’

De auteurs schatten verder de boxplots van de HPS en CLIP-scores in relatie tot de eerdere benaderingen:

Boxplots voor de HPS en CLIP-scores die in de tests zijn behaald.

Zij merken op:

‘Het kan worden gezien dat ons model de andere modellen overtreft, wat aangeeft dat ons model beter in staat is om afbeeldingen te genereren die consistent zijn met de prompts.

‘Echter, in de boxplot is het niet gemakkelijk om de vergelijking te visualiseren vanwege de grootte van deze evaluatiemetric op [0, 1]. Daarom gaan we verder met het ploten van de overeenkomstige staafdiagrammen.

‘Het kan worden gezien dat SGOOL SD en Baseline overtreft op alle datasets onder zowel CLIP-score als HPS-metrics. De kwantitatieve resultaten demonstreren dat ons model meer semantisch consistente en menselijk-geprefereerde afbeeldingen kan genereren.’

De onderzoekers merken op dat terwijl het baseline-model in staat is om de kwaliteit van de afbeeldinguitvoer te verbeteren, het geen rekening houdt met de opvallende gebieden van de afbeelding. Zij beweren dat SGOOL, door een compromis te bereiken tussen globale en opvallende beeldevaluatie, betere afbeeldingen behaalt.

In kwalitatieve (geautomatiseerde) vergelijkingen werd het aantal optimalisaties ingesteld op 50 voor SGOOL en DOODL.

Kwalitatieve resultaten voor de tests. Raadpleeg het bronpaper voor betere definitie.

Hierbij merken de auteurs op:

‘In de [eerste rij], zijn de onderwerpen van de prompt “een kat die zingt” en “een barbershop kwartet”. Er zijn vier katten in de afbeelding gegenereerd door SD, en de inhoud van de afbeelding is slecht uitgelijnd met de prompt.

‘De kat wordt genegeerd in de afbeelding gegenereerd door Baseline, en er is een gebrek aan detail in de weergave van het gezicht en de details in de afbeelding. DOODL probeert een afbeelding te genereren die consistent is met de prompt.

‘Echter, omdat DOODL de globale afbeelding rechtstreeks optimaliseert, worden de personen in de afbeelding geoptimaliseerd naar de kat.’

Zij merken verder op dat SGOOL, in tegenstelling, afbeeldingen genereert die meer consistent zijn met de oorspronkelijke prompt.

In de menselijke perceptietest beoordeelden 100 vrijwilligers testafbeeldingen voor kwaliteit en semantische consistentie (d.w.z. hoe goed ze overeenkwamen met hun bron-tekstprompts). De deelnemers hadden onbeperkte tijd om hun keuzes te maken.

Resultaten voor de menselijke perceptietest.

Zoals het paper opmerkt, is de methode van de auteurs aanzienlijk bevoroordeeld boven de eerdere benaderingen.

Conclusie

Niet lang nadat de tekortkomingen die in dit paper worden aangepakt, duidelijk werden in lokale installaties van Stable Diffusion, ontstonden verschillende maatwerkmethoden (zoals After Detailer) om het systeem te dwingen extra aandacht te besteden aan gebieden die van groter menselijk belang waren.

Echter, deze soort benadering vereist dat het diffusiesysteem eerst door zijn normale proces gaat van het toepassen van gelijke aandacht aan elk onderdeel van de afbeelding, met de toegenomen werkzaamheden die als een extra stap worden uitgevoerd.

Het bewijs uit SGOOL suggereert dat het toepassen van basispsychologie van de mens op de prioritering van afbeeldingssecties de initiële inferentie aanzienlijk kan verbeteren, zonder post-processing stappen.

* Het paper biedt dezelfde link voor dit als voor CommonSyntacticProcesses.

Eerst gepubliceerd op woensdag, 16 oktober 2024