Andersons hoek

AI zou liever het boek lezen dan naar de film kijken

Het is verrassend moeilijk om AI-modellen te laten kijken en commentaar geven op daadwerkelijke video-inhoud, zelfs als ze hiervoor zijn gemaakt. Ze zijn meer geïnteresseerd in het geschreven woord.

Als je ooit hebt geprobeerd een kleine video-clip te uploaden naar ChatGPT, of naar een soortgelijk populaire visie/taalmodel, kun je verrast zijn om te realiseren dat ze eigenlijk geen video kunnen parseren. Terwijl modellen zoals ChatGPT-4o+ in staat zijn om individuele frames te analyseren – in de vorm van afbeeldingen, zoals JPEG en PNG – geven ze de voorkeur aan dat de gebruiker zelf frames extracteert en uploadt als afbeeldingen (waarop ze wel commentaar kunnen geven).

In het geval van de OpenAI GPT-serie kan men, met enige moeite, een complete reeks frames uit een video-clip extraheren en deze voeden aan ChatGPT, voor doeleinden zoals het genereren van een door AI gegenereerde narratief voor de video:

![Afbeeldingen en code van een OpenAI-tutorial over het parseren van meerdere geëxtraheerde frames voor het doel van het ontwikkelen van een door AI gegenereerde commentaar voor een video-clip. [ Bron ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

Afbeeldingen en code van een OpenAI-tutorial over het parseren van meerdere geëxtraheerde frames voor het doel van het ontwikkelen van een door AI gegenereerde commentaar voor een video-clip. Bron

Maar het is de gebruiker die de conversie van video naar frames moet maken, hetzij door functies aan te roepen in een grotere routine, zoals in het bovenstaande voorbeeld, of door frames te extraheren met FFMPEG of diverse gratis en betaalde video-bewerkingsoplossingen.

Tot op zekere hoogte, misschien zelfs in grote mate, hangen de beperkingen op video-analyse in producten van hoge schaal zoals ChatGPT af van resource-gebruik: het is geen kleinigheid om één AI-exemplaar uit te rusten met een selectie van de meest populaire video-codecs en om compute-resources toe te wijzen aan het schijf-zware en CPU-vermoeiende proces van extractie, mochten honderden miljoenen gebruikers besluiten om deze faciliteiten elke dag te gaan gebruiken.

Bovendien kan temporale analyse een heel ander beeld schetsen dan een enkele frame (stel je voor dat iemand een huis binnenkomt in een goede bui en dan een lijk ontdekt); daarom is het overwegen van de hele temporele ‘checksum’ van zelfs een korte video-clip een veeleisende en resource-intensieve taak – evenals een gespecialiseerd gebied van de onderzoeksliteratuur, bijvoorbeeld met de voortdurende ontwikkeling van kaders zoals Optical Flow – die in wezen een lengte van video ‘ontvouwt’ zodat deze kan worden beschouwd en behandeld als een statisch document:

![Optische stroomdiagrammen laten zien hoe beweging wordt getrackt over frames in een video-sequentie, met groene vectoren die bewegingsrichting en -intensiteit aangeven. Deze mappings bieden de temporele continuïteit die nodig is voor VLM's en kunnen ook dienen als structurele gidsen in VFX-workflows. [ Bron ] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Optische stroomdiagrammen laten zien hoe beweging wordt getrackt over frames in een video-sequentie, met groene vectoren die bewegingsrichting en -intensiteit aangeven. Deze mappings bieden de temporele continuïteit die nodig is voor VLM’s en kunnen ook dienen als structurele gidsen in VFX-workflows. Bron

Genoegen nemen met de Cliff’s Notes

Toch, omdat modellen zoals Google’s Notebook LM en de meest recente ChatGPT-entries in staat zijn om geassocieerde metadata (d.w.z. ingebedde tekstinhoud die de video op de een of andere manier contextualiseert) te lezen, weigeren ze video-bestandsuploads niet; en soms zullen ze zelfs proberen een video te interpreteren die geen dergelijke gegevens bevat.

In het volgende geval uploadde ik een 6-seconde willekeurige clip van de Italiaanse film The Hand of God (2021) naar NotebookLM, waarbij ik ervoor zorgde dat de clip geen enkele bruikbare tekst bevatte, noch in metadata noch in de bestandsnaam.

NotebookLM begon vervolgens uitgebreid te hallucineren materiaal dat totaal niet gerelateerd was aan de video*, compleet met een nonsensische en niet-gerelateerde vijfminuten-head-to-head-podcast:

Een alledaags moment in een 6-seconde clip van een Italiaanse film wordt wild misgeïnterpreteerd door NotebookLM. Bron: Google NotebookLM

Hoewel Notebook, net als ChatGPT, een YouTube-video als invoer zal accepteren, zal het dit alleen doen als de video een interpreteerbare tekstlaag-annotatie en/of ondertiteling bevat (niet-gerasterde ondertiteling die in de video is gebrand).

Op deze manier is het harde werk van het daadwerkelijk kijken naar en luisteren naar de inhoud van de video en het uitvoeren van semantische interpretatie ervan (een wettelijke noodzaak voor YouTube, vanwege zijn copyright-beschermingsmaatregelen, en zijn aanstaande identiteitsbeschermingssysteem), gedaan na de gebruikersupload, wanneer en wanneer de clip de noodzakelijke verwerkingsbronnen kon worden toegewezen.

Echte video-interpretatie is duur en uitputtend, en, zo blijkt, zelfs modellen die specifiek zijn getraind om deze taak uit te voeren, geven de voorkeur aan het lezen van tekst boven het daadwerkelijk kijken naar video.

TL;DW

Dit, volgens een nieuw artikel van de Universiteit van Bristol in het VK, getiteld Een video is niet waard een duizend woorden, waarin de twee auteurs concluderen dat huidige state-of-the-art visie-taalmodellen (VLM’s) – modellen die specifiek zijn ontworpen om in staat te zijn video te analyseren op een meer inspannende manier, en om deel te nemen aan video-vraagbeantwoording (VQA) – ook standaard naar tekstgebaseerde informatie gaan wanneer ze kunnen.

Wanneer ze zowel bewegende beelden als geschreven vragen en meerdere keuze-antwoorden krijgen, vonden de auteurs van het artikel dat modellen meestal hun keuzes baseerden op patronen in de tekst, in plaats van op iets wat op het scherm gebeurt – in veel gevallen presteerden ze net zo goed, zelfs wanneer de vraag helemaal weg was.

In wat lijkt op een gewoontevorm van shortcutting of cheating, was wat voor de meeste modellen het belangrijkst, het kunnen opsporen van patronen in de mogelijke antwoorden; alleen wanneer de taak moeilijker werd gemaakt, door meer antwoordopties toe te voegen, begonnen de AI’s meer aandacht te besteden aan de video.

De auteurs gaven VQA-tests onder een reeks omstandigheden aan zes VLM-modellen met diverse contextlengtes, op vier geschikte datasets; en vonden dat de resultaten aangaven dat de modellen afhankelijk waren van tekst boven video-inhoud.

Voorbeeld uit de studie die laat zien hoe een video-analysemodel weegt wat het ziet versus wat het leest. De clip toont een persoon die bamboe weeft, maar het model wijst veel meer belang toe aan de geschreven vraag en antwoordtekst dan aan de video-frames zelf. Blauwe highlights markeren elementen die de gekozen antwoord ondersteunen, terwijl rode markers die trekken in de tegenovergestelde richting, waardoor wordt geïllustreerd hoe het modelredenering centrum op de woordkeuze in plaats van op de bewegende beelden. Bron

Methode

Om te begrijpen hoeveel elke invoer bijdraagt aan een modelbeslissing, gebruikt het nieuwe werk een methode uit speltheorie genaamd Shapley-waarden. Oorspronkelijk ontworpen om een uitbetaling eerlijk te verdelen onder spelers in een coalitie, wijzen Shapley-waarden krediet toe aan elke ‘speler’ op basis van hun individuele impact.

Effectief zijn de spelers in deze scenario dus de video-frames of de tekstcomponenten (annotaties, ondertiteling, bijschriften, enz.) van een VQA-taak; en de ‘uitbetaling’ is het modelantwoord. Door systematisch te testen wat gebeurt wanneer elk deel wordt toegevoegd of verwijderd, onthult de techniek hoe belangrijk dat element was bij het kiezen van het antwoord.

In het geval van het nieuwe project werden Shapley-waarden aangepast om meerdere gegevenstypen te behandelen, met video- en tekstcomponenten afzonderlijk behandeld, en hun variabele invloed op de modeluitvoer gemeten, waardoor werd onthuld of de video-inhoud daadwerkelijk werd geïnterpreteerd, of dat geschreven aanwijzingen werden gebruikt als shortcuts.

Metrieken

Twee eenvoudige metrieken werden gedefinieerd om te vergelijken hoeveel elke modaliteit (d.w.z. video, vraag of antwoord) bijdroeg aan het modelbeslissing: Modaliteitsbijdrage meet hoeveel van de totale verklaring afkomstig is van elk type invoer; hier worden alle beschikbare Shapley-waarden opgeteld en het aandeel dat behoort tot elke modaliteit berekend als een percentage van het totaal.

Ten tweede Bijdrage per kenmerk corrigeert voor het feit dat sommige modaliteiten, zoals video, veel meer kenmerken bevatten dan anderen. In plaats daarvan wordt de gemiddelde Shapley-waarde berekend voor elk kenmerk, en worden deze gemiddelden vergeleken om te bepalen welke modaliteit invloed dominant is.

Gegevens en tests

De auteurs testten de benadering op zes VLM’s met een verscheidenheid aan kenmerken ontworpen om ervoor te zorgen dat de testbeginselen breed toepasbaar en generaliseerbaar waren. Daarom werden de modellen gekozen voor verschillende contextlengtes, verschillende leeftijden (d.w.z. hoe lang geleden het kader werd vrijgegeven) en verschillende architectuurconfiguraties.

De kandidaten waren FrozenBiLM; InternVideo; VideoLLaMA2; VideoLLaMA3; LLaVa-Video (die Qwen2 gebruikt); en LongVA (ook met Qwen2).

Met hetzelfde doel van diverse variatie werden de vier doel-datasets EgoSchema, een VQA-dataset ontworpen om onmogelijk te zijn om te voltooien zonder volledig bekijken van de geassocieerde video’s; HD-EPIC, een keuken-gefocust dataset met enkele ongebruikelijk lange video’s; MVBench, een gecuronde assemble van bijdragen uit andere datasets; en LVBench, die VQA-vragen stelt voor zeer lange video’s.

Van deze werden de auteurs 60 vragen bedacht – tien van elke vraagtype.

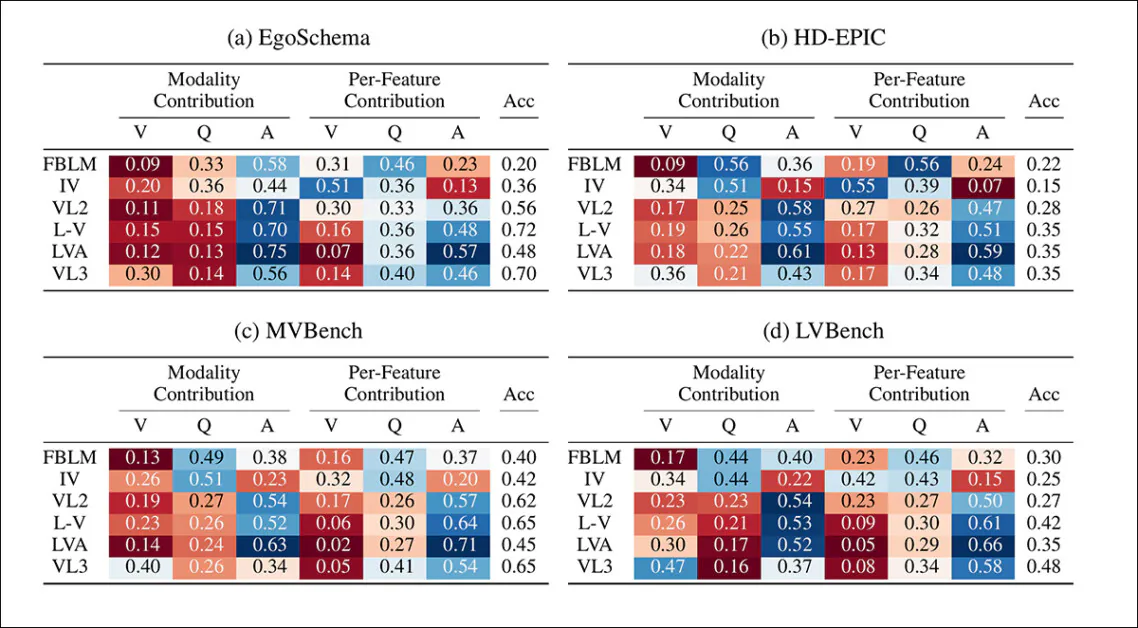

De bijdragemetrieken maakten duidelijk dat de meeste modellen minder afhankelijk waren van de video dan van de tekst, vooral wanneer beoordeeld per frame. Zelfs waar de video een redelijke vertoning maakte in de totale bijdrage, was de invloed per kenmerk vaak minimaal, wat suggereert dat, hoewel het model de video mogelijk gebruikt in het algemeen, het weinig aandacht besteedt aan individuele frames. VideoLLaMA3 was de belangrijkste uitzondering hier, met een zwaardere visuele afhankelijkheid, vooral op de langere sequenties in LVBench:

Modaliteitsbijdrage (MC) en per-kenmerkbijdrage (PFC) scores over modellen en datasets, die de relatieve gewicht van video (V), vraag (Q) en antwoord (A) invoer laten zien. Koelere kleuren geven sterker bijdragen aan; warmere kleuren geven zwakkere of verwaarloosbare invloed. Over het algemeen is taal duidelijk dominant, met video vaak opzij gezet – vooral in per-frame invloed.

Wat betreft de tekst, had de vraag de neiging om meer te tellen dan het antwoord, vooral in sterkere modellen. Dit was het meest duidelijk in datasets zoals EgoSchema, waar vragen langer en meer naturalistisch waren, terwijl de antwoorden kort en soms schematisch waren. MVBench keerde dit enigszins om, omdat zijn binaire-antwoordstructuur de schijnbare importantie van de antwoordtokens opblies.

Over alle modellen en datasets heen was visie consistent opzij gezet, met taal die het zware werk deed.

Het artikel vermeldt:

‘[Voor] lange contextmodellen, toont video sterk verminderde bijdragen, wat betekent dat per frame de Shapley-waarden veel kleiner zijn dan hun tekstkenmerk-tegenhangers.

‘Video als geheel modaliteit is nog steeds duidelijk zeer relevant, maar dit is bewijs dat de Shapley-waarden van zijn individuele frames meer gecentreerd zijn rond nul, en dat het model zijn aandacht voor hen veel minder gericht is dan voor de tekst.’

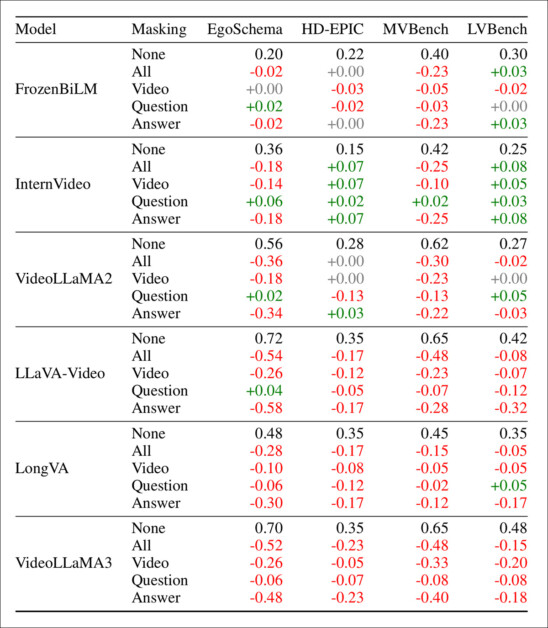

Om te testen hoe elk deel van de invoer (video, tekst, enz.) bijdraagt aan modelnauwkeurigheid, voerden de onderzoekers aanvullende tests uit met behulp van maskeren – door opzettelijk één of meer delen van de invoer te verbergen en te zien hoeveel de modelnauwkeurigheid verandert als gevolg daarvan.

Als de prestaties scherp dalen wanneer een bepaalde invoer wordt verwijderd, is die invoer waarschijnlijk belangrijk; als het model ongeveer hetzelfde presteert, suggereert dit dat het ontbrekende deel niet zwaar werd vertrouwd. In deze zin zijn maskeringstests een soort iteratieve ablatiestudie.

Prestatie-impact van het maskeren van video-, vraag- of antwoordinvoer over vier VQA-benchmarks. Scores laten de verandering zien van de ongemaskeerde baseline. Rood betekent lagere nauwkeurigheid, groen betekent hogere nauwkeurigheid. Modellen behielden vaak hoge scores zonder video, maar verloren meer toen het (tekst)antwoord werd verwijderd. De vraag kon meestal worden gemaskeerd met minimale effecten.

De resultaten (weergegeven hierboven) geven aan dat antwoorden (tekstantwoorden in de meerdere keuze-gegevens) de meeste gewicht dragen over het algemeen. Het maskeren van het antwoord zorgde meestal voor de grootste daling in nauwkeurigheid, vaak waarbij modellen werden teruggebracht tot near-random prestaties.

Echter, het maskeren van de vraag had meestal veel minder effect, wat de eerdere bevinding ondersteunt dat modellen de vraag onderschatten.

In sommige gevallen verbeterde de nauwkeurigheid zelfs wanneer de vraag werd verwijderd, wat aangeeft dat modellen soms alleen antwoorden aan tekstpatronen matchten in plaats van de vraag goed te evalueren.

Modellen varieerden ook in hun afhankelijkheid van video: sommige behielden redelijke nauwkeurigheid zonder het, wat de beperkte bijdrage van video-kenmerken in veel huidige instellingen verder bevestigde.

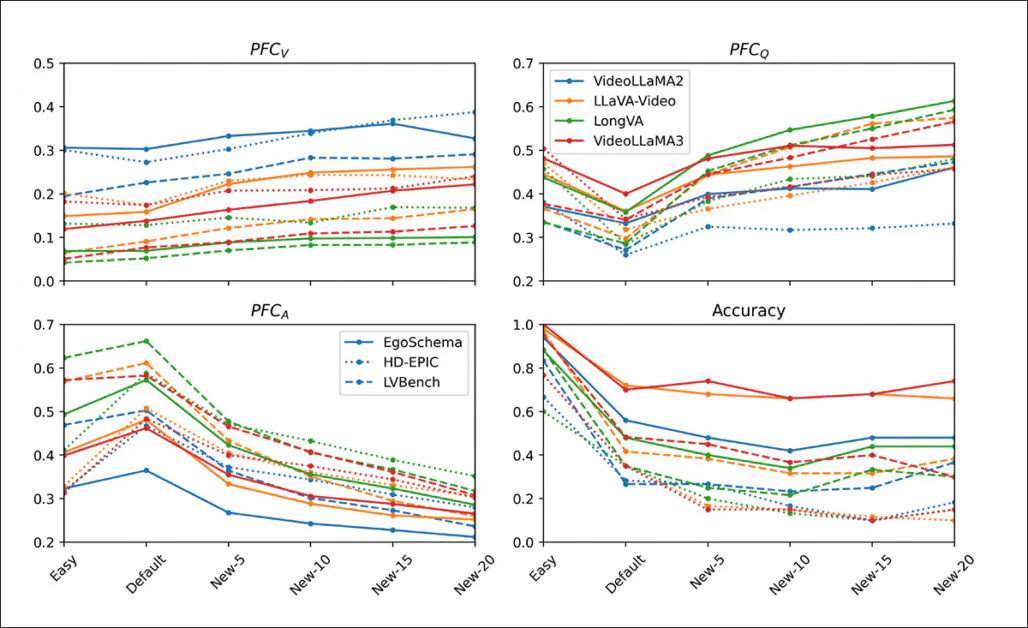

De auteurs testten vervolgens of modellen konden worden gedwongen om te vertrouwen op video door extra verkeerde antwoorden toe te voegen aan de meerdere keuze-opties.

Wanneer de afleiders gemakkelijk waren en hergebruikt werden van andere vragen, verbeterde de prestatie, omdat modellen tekstpatronen matchten zonder veel redenering. Maar met tien of meer niet-gerelateerde antwoorden begonnen ze meer te vertrouwen op de video en vraag:

Per-kenmerkbijdrage en nauwkeurigheid voor video-, vraag- en antwoordinvoer, terwijl extra verkeerde antwoorden aan elke VQA-test worden toegevoegd, waaruit blijkt dat het toevoegen van meer afleiders de tekstoverheersing vermindert en de relatieve invloed van visuele en vraagkenmerken verhoogt.

Voor VideoLLaMA3 verminderde het maskeren van de video de nauwkeurigheid met 40% op EgoSchema en 15% op LVBench, wat aangeeft dat een eenvoudige toename van het aantal antwoorden modellen kan verplaatsen van tekstshortcuts naar echte multimodale redenering.

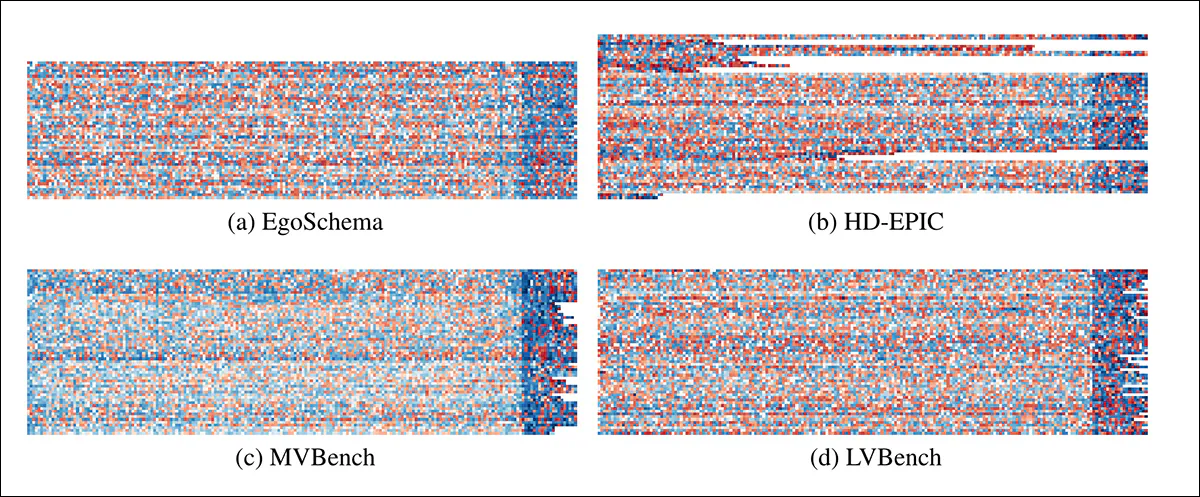

De onderzoekers onderzochten ook hoe toewijzing wordt verdeeld over invoer, en hieronder zien we warmtekaarten van Shapley-waarden voor elke modelinvoer:

Shapley-waarde-warmtekaarten voor vier datasets, waarbij elke rij één VQA-tuple toont, en elke kolom één kenmerk. Video-kenmerken verschijnen links, gevolgd door tekst. De veel sterkere waarden in de (rode) tekstregio’s bevestigen dat modellen veel meer vertrouwen op taal dan op video.

In reactie op de bovenstaande resultaten merken de auteurs op:

‘De grootte van de Shapley-waarden is veel groter naar de rechterkant van elke warmtekaart, die de vraag- en antwoordtoewijzingen vertegenwoordigt. Deze scherpe grens is waar de video-frames eindigen en de tekstkenmerken beginnen, wat aantoont dat de video-modale bijdrage veel minder is dan de vraag/antwoord. ‘

Samenvattend, over alle datasets heen, zijn de waarden veel sterker naar de tekstzijde van het spectrum, wat sterk aangeeft dat modellen veel meer vertrouwen op taal dan op visuele aanwijzingen. Zelfs waar de video wel wordt gebruikt, is de bijdrage dun gespreid over veel frames, vaak zonder enig consistent patroon.

Hieronder zien we een geannoteerd voorbeeld uit EgoSchema. De 16 meest ‘belangrijke’ frames werden geselecteerd met behulp van Shapley-waarden en gekleurd volgens hun invloed, met blauw aangevende een positieve bijdrage en rood aangevende een negatieve:

Shapley-toewijzingen voor een enkel EgoSchema-voorbeeld, die de 16 meest invloedrijke frames en alle tekstinvoer laten zien. Video-bijdragen zijn minimaal in vergelijking met tekst, die de modelredenering domineert. Blauw en rood geven positieve en negatieve invloed op het geselecteerde antwoord aan.

Het resultaat is dat bijna elk frame slechts een zwakke invloed heeft in vergelijking met de woorden in de vraag en antwoorden. Visuele aanwijzingen zijn schaars en inconsistent, terwijl zelfstandige naamwoorden zoals ‘stoel’ en ‘heining’ het model naar de juiste keuze leiden – of ervan afleiden, afhankelijk van de context.

Conclusie

Iedereen die ooit heeft geknoeid met video-bewerking of video-analyse weet al hoe resource-intensief deze processen zijn, en begrijpt waarom bedrijven die miljoenen AI-gebaseerde verzoeken per dag verwerken, niet kunnen veroorloven om ad hoc bewerking en interpretatieve video-processen te laten uitvoeren door gebruikers.

Een ding om te onthouden in dit verband is dat bijna elk API AI-interface dat je ooit zult proberen (met uitzondering van een gloednieuwe en kortstondige demo ter ondersteuning van nieuw wetenschappelijk onderzoek) ernaar streeft om de wensen van gebruikers te vervullen op het laagst mogelijke niveau van resource-uitgaven.

Dat betekent vertrouwen op bestaande metadata van gebruikersgegevens of RAG-opnames, als dat mogelijk is; en, indien absoluut noodzakelijk, metadata extraheren voor meer parseerbare formaten zoals PDF, documenten en afzonderlijke afbeeldingen.

Wat niet op tafel ligt, is het doorlopen van uw geüploade video via CLIP of de laatste YOLO-release, of via enige vermoeiende en tijdrovende VLM die daadwerkelijk kan identificeren wat er in de frames zit en begrijpen wat er gebeurt in de geüploade video, rekening houdend met temporaliteit.

Echter, dit betekent niet dat de fenomenen die het huidige artikel documenteert noodzakelijkerwijs voortkomen uit zuinige architecturale benaderingen. De auteurs merken op dat tekst de state-of-the-art multimodale trainingsparadigma’s domineert in elk geval, wat aangeeft dat ‘visuele taal’ minder ontwikkeld, minder belangrijk of informatief is binnen een multimodaal context, of (op zijn minst op dit moment) minder goed begrepen,

* Interessant is dat het materiaal dat NotebookLM produceerde, ofwel volledig origineel lijkt te zijn of totaal niet door Google is geïndexeerd, aangezien ik geen enkele zoekresultaat kan vinden die in de trainingsgegevens had kunnen sluipen en deze output had kunnen veroorzaken.

Eerst gepubliceerd op vrijdag 31 oktober 2025; bewerkt 14:20 voor opmaak