Andersons hoek

AI Splits Web Search in Drie Verschillende Realiteiten

Nieuw onderzoek toont aan dat Google nu drie verschillende informatiesystemen gebruikt binnen zijn eigen zoekimperium, met reguliere Search, AI-overzichten en Gemini die allemaal verschillende bronnen, rankings en inhoud bevorchten.

Reductivismus heerst. In de afgelopen twaalf maanden is de ‘Laat me dat voor je opzoeken’ meme overgenomen door een nieuwe ‘Laat me die Google-zoekopdracht voor je samenvatten’ trend, waarin AI-overzichten in zoekresultaten steeds vaker lezers de moeite besparen om op zoeklinks te klikken (waardoor ze de bronwebsites mogelijk ontfinancieren), door hele zoekresultaten samen te vatten in een paar gegenereerde alinea’s.

Je zou denken dat de centrale kennis die naar boven komt, en de keuze van sites waaruit die kennis wordt gehaald, relatief gelijk zou zijn voor alle drie de meest populaire methoden om het internet te doorzoeken op informatie: in traditionele webzoekopdrachten; in de AI-overzichten (AIO’s) die nu de meeste webzoekopdrachten beginnen; en door het steeds vaker gebruik van LLM’s zoals ChatGPT als web-orakels (met of zonder externe RAG-aanroepen).

Echter, recent onderzoek uit de VS toont aan dat dit, verrassend genoeg, verre van het geval is; en dat zelfs binnen Google’s eigen drie-eenheid van orakels – SERPS*, AI-samenvattingen en directe interactie met de Gemini LLM-serie – er significante en interessante discrepanties lijken te zijn, voor elke route.

Drie-Splitsing

In een heldere en uitgebreide nieuwe paper, getiteld Hoe Generatieve AI Zoekopdrachten Verstoort: Een Empirisch Onderzoek van Google Search, Gemini en AI-Overzichten, schetsen zes onderzoekers van het New Jersey Institute of Technology de manieren waarop de drie zoekmethoden uiteenlopen, en bieden enkele mogelijke theorieën voor deze breuken in aanpak.

Het paper stelt:

‘[Ten eerste] vinden we dat voor 51,5% van de representatieve, echte gebruikerszoekopdrachten, AIO’s gegenereerd worden en boven de organische zoekresultaten worden weergegeven. Omstreden vragen leiden vaak tot een AIO.

‘Ten tweede laten we zien dat de opgehaalde bronnen aanzienlijk verschillen voor elke zoekmachine (<0,2 gemiddelde Jaccard-overeenkomst). Traditionele Google-zoekopdrachten halen informatie uit populaire of institutionele websites in de overheid of onderwijs, terwijl generatieve zoekmachines aanzienlijk vaker informatie uit Google-eigendom halen.

‘Ten derde observeren we dat websites die Google’s AI-crawler blokkeren, aanzienlijk minder waarschijnlijk zijn om door AIO’s te worden opgehaald, ondanks toegang tot de inhoud.’

Aangezien het paper een smörgåsbord van fascinerende inzichten is, in plaats van te conformeren aan de gebruikelijke lineaire en methodische workflow, zullen we een nadere blik werpen op deze, en enkele andere van de meest verrassende en verlichtende inzichten.

Het Oude ‘Twee-Een’

Een van de vele interessante bevindingen in de studie geeft aan dat Google’s AI-overzichten de neiging hebben om te worden onderdrukt voor plotselinge breaking news-evenementen, aangezien de vroegste en meest beschikbare bronnen mogelijk niet de meest nauwkeurige zijn.

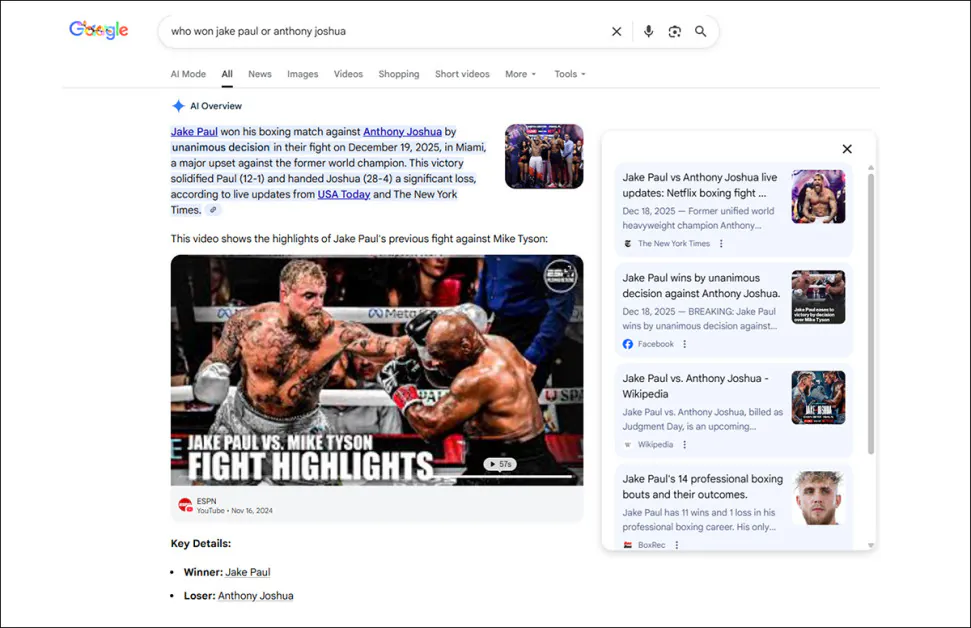

Dit systeem werkt niet altijd: in het onderstaande voorbeeld, opgemerkt door de onderzoekers, werd een Google AI-overzicht over het resultaat van een bokswedstrijd de overwinning toegeschreven aan de verkeerde bokser, zelfs als de enige bron die deze (onjuiste) uitslag vermeldde een satirische sportfeed op Facebook was:

Een van de redenen dat Google’s AI-overzichten tijdgevoelige samenvattingen vermijden, is dat vroege informatie onvolledig of volledig onjuist kan zijn. In dit geval verloor bokser Jake Paul de wedstrijd. Bron

De auteurs merken op dat AIO’s de neiging hebben om te verschijnen wanneer een evenement minstens vijf dagen oud is, wat dit als een anomalie kwalificeert – maar niettemin, een die de onderzoekers gemakkelijk konden oproepen.

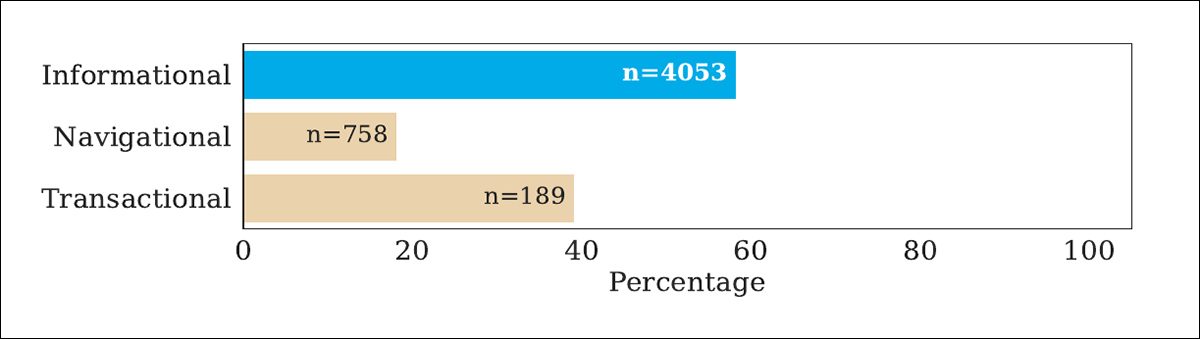

AIO’s werden vaker gegenereerd wanneer de zoekopdracht met een vraagteken werd afgesloten, en dat zoekopdrachtintentie een factor was in de vraag of een AIO zou worden weergegeven:

Percentage van incidenten waarin een AI-zoeksamenvatting werd gegenereerd in een van de onderzoekers’ tests. Hier geeft ‘informatief’ directe vragen aan, die AIO’s meer produceren dan elke andere type interactie.

Bovendien stelt het paper, langere zoekopdrachten hebben de neiging om vaker een AI-samenvatting te produceren in plaats van alleen rechtstreekse zoekresultaten, hoewel de auteurs nog geen theorie aanbieden om dit te verklaren.

Een Koninkrijk Verdeeld

Misschien het meest verrassende algemene resultaat uit het nieuwe onderzoek is de relatief kleine overlap in resultaatkwaliteit/type tussen Google’s (eerdergenoemde) drie zoekplatformen.

Het paper toont herhaaldelijk aan dat reguliere Google-zoekopdrachten, AI-overzichten en Gemini (LLM) opvallend verschillende bronnen voor dezelfde zoekopdracht ophalen, met overlap-scores laag genoeg om drie concurrerende opvallingslogica’s binnen één bedrijf te impliceren, terwijl gebruikers zouden aannemen dat Google één autoritatieve index en één rangschikkingsfilosofie heeft:

Zelfs binnen Google’s eigen ecosysteem bleek de overlap tussen traditionele Search, AI-Overzichten en Gemini verrassend klein, met dezelfde zoekopdracht die vaak aanzienlijk verschillende bronlijsten produceerde, afhankelijk van welk Google-systeem de aanvraag afhandelde. In deze vergelijking zien we hoe goed de drie systemen elkaar overeenkwamen over duizenden zoekopdrachten, van winkelen en debatonderwerpen tot lokale zoekopdrachten en algemene kennisvragen, met lagere scores die minder overeenstemming tussen de geselecteerde bronnen aangaven.

Met betrekking tot dit deel van hun analyse, stellen de auteurs†:

‘[De tabel hierboven] toont de gemiddelde overeenkomst tussen de lijst van bronnen die door de AIO, Gemini en traditionele SERP voor elke zoekopdracht in de benchmark-dataset zijn geretourneerd.

‘De belangrijkste conclusie is dat ongeacht de zoekopdrachtsubset en welk paar zoekmachines wordt vergeleken, de opgehaalde lijsten ongelijk zijn, ondanks dat alle drie door Google zijn ontwikkeld.’

De onderzoekers stellen verder dat geen enkele zoekmethode die werd getest, een rang-georiënteerde overlap (RBO) boven 0,27 had, wat een zeer lage score is. Zij merken op dat Amazon Retail en gelokaliseerde zoekopdrachten (d.w.z. ‘winkels in de buurt’) de laagste overeenkomst tussen de zoekmethoden hadden.

Zij wijten de lage overeenkomst aan fundamentele ‘inconsistentie tussen zoekmachines’, waarbij noch toeval noch enige andere voor de hand liggende factor kan worden gemaakt om deze dis-synchronisatie te verklaren.

Een intuïtieve verklaring, naar alle waarschijnlijkheid, is dat trainingsgegevenspunten op een heel andere manier worden toegewezen dan de methoden die Google heeft ontwikkeld voor PageRank en zijn opvolgers in de afgelopen twee decennia. Bovendien, als Google’s zoekalgoritme een geheime agenda heeft, is het moeilijker om consistent te implementeren in diffusie-gebaseerde AI’s zoals Gemini (zelfs via filtering, systeemprompts en de verschillende andere methoden van corralling die worden opgelegd aan commerciële modellen).

Zelfbediening..?

Bepaalde websites, of categorieën van websites, lijken te zijn getroffen door de komst van AI-samenvattingen en de invloed van LLM-gebaseerde zoekopdrachten in de traditionele zoekruimte – zowel nadelig als positief, afhankelijk van het geval:

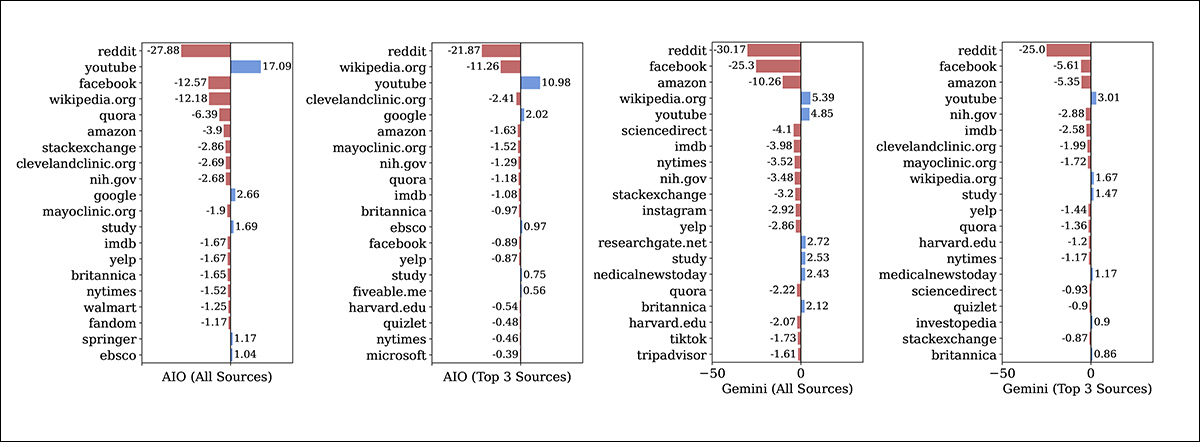

In vergelijking met traditionele Google-zoekopdrachten, verminderden AI-Overzichten en Gemini beide citaten van veel grote websites, terwijl ze de zichtbaarheid voor een kleinere groep favoriete domeinen verhoogden. YouTube bleek een van de grootste begunstigden te zijn in beide systemen, terwijl Reddit, Wikipedia, Facebook en veel institutionele bronnen minder vaak in AI-gegenereerde ophalingen verschenen.

De auteurs merken op dat enkele onverwachte voorkeuren naar voren komen bij de drie methoden, tijdens het testen:

‘We hebben drie belangrijke conclusies uit [de grafieken hierboven]. Ten eerste zijn grote en bekende websites het meest getroffen (zowel positief als negatief). Dit is intuïtief, aangezien grote websites de reputatie en diversiteit in inhoud hebben om relevant te zijn voor veel verschillende zoekopdrachten.

‘Ten tweede ontvingen de meeste van deze websites minder totale en minder top-drie citaten met generatieve zoekmachines (aangegeven door rode balken en negatieve nummers in [de grafieken hierboven]). Dit suggereert dat generatieve zoekmachines de neiging hebben om informatie te halen uit meer niche-bronnen dan traditionele zoekmachines.

‘Ten derde geven Google’s AIO’s de voorkeur aan Google-websites (d.w.z. google.com en youtube.com-domeinen).

‘Gemini geeft ook de voorkeur aan YouTube in vergelijking met traditionele Google-zoekopdrachten, maar het absolute verschil is kleiner.’

Enige ‘Blokkers’..?

De studie vond ook dat uitgevers die Google’s AI-webcrawler blokkeren – de geautomatiseerde web-bot die gegevens van uw site scrapet, tenzij u het niet doet met een robots.txt bestand – de neiging hebben om niet in AI-samenvattingen te verschijnen.

Dit lijkt misschien op een voor de hand liggende, zelf opgelegde wond, maar in feite heeft Google openlijk verklaard dat inhoud van platforms die AI-crawlers blokkeren niet zal worden voorkomen om in AI-samenvattingen te verschijnen; in plaats daarvan zullen de uitgevers alleen geen gegevens laten scrapen, cureren in een collectie en door de volgende ronde van AI-training voor Gemini en andere Google AI-projecten laten lopen.

Echter, dat was niet de conclusie die de onderzoekers van het nieuwe paper trokken, maar vonden in plaats daarvan dat populaire AI-bannende uitgevers zeer zelden door Gemini werden geciteerd, noch in de LLM noch in de gestripte en meer agile zoekresultaten-variant. De ‘effectief geblokkeerde’ uitgevers werden door het paper gemeld als NYTimes, CNN, BBC, ScienceDirect, Reuters, Wiley, Nature, ESPN, Business Insider, CNBC, NPR, WIRED, USA Today, NBC News, Genius, National Geographic, The Conversation, U.S. News & World Report, Scientific American, Consumer Reports en STAT.

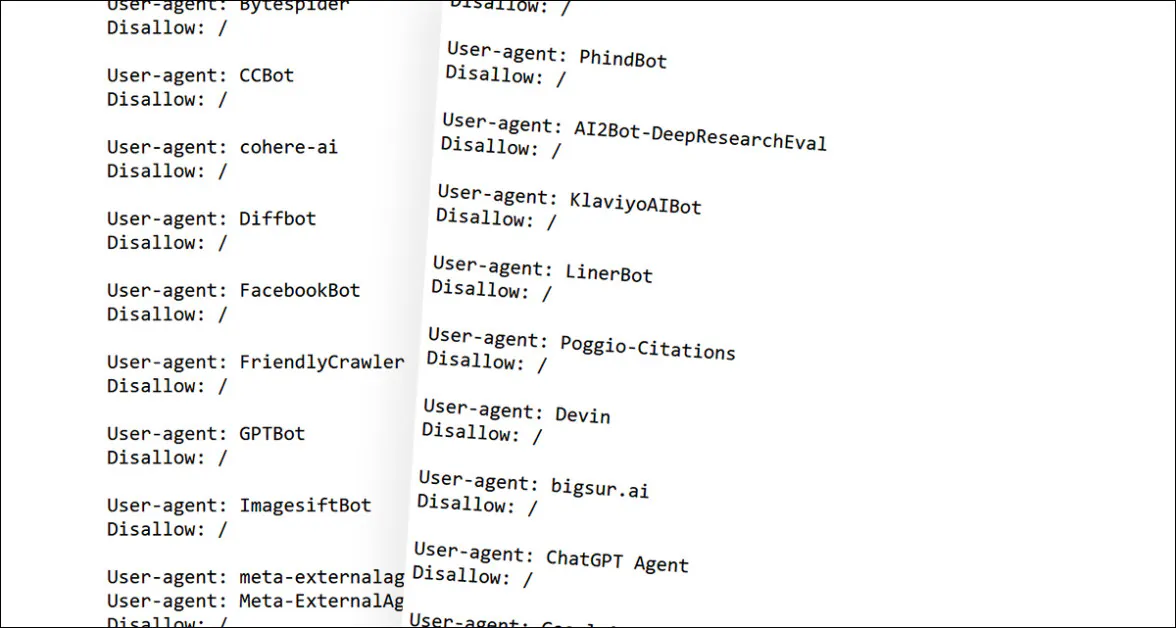

Enkele van de robots.txt AI-scraping-blokkades die door de hierboven genoemde uitgevers zijn geëffectueerd. Maar heeft dit geleid tot een bredere censuur door Google?

De auteurs stellen:

‘In onze analyses van de meest getroffen domeinen, vonden we dat 21 populaire [uitgevers] (die door zowel Google Search als AIO’s voor minstens 20 unieke zoekopdrachten worden opgehaald) nooit door Gemini werden geciteerd.

‘Verschillende populaire sociale media (Facebook, Instagram, Tiktok) en review-websites (IMDb, Yelp, Tripadvisor) ontvingen ook geen enkele citatie van Gemini. Bij verdere onderzoek vonden we dat al deze websites de Google-Extended-bot in hun robots.txt-bestanden blokkeren.’

Als deze bevinding wordt bevestigd en persistent is, kan men speculeren dat deze bedrijven mogelijk onder druk worden gezet door Google om in te stemmen met hun AI-bewerkingen door middel van gedeeltelijke de-listing. Op het eerste gezicht lijken de resultaten strafrechtelijk – maar vervolgens zijn de bevindingen van het nieuwe onderzoek meer indicatief voor chaos dan voor opzet; daarom is de enige redelijke opmerking die men kan maken, dat deze resultaten oppervlakkig ‘wraakzuchtig’ lijken, wat er ook echt aan de hand is.

Conclusie

Meningsuiting Dit is een helder zip-bomb van een paper, waarvan de tien primaire pagina’s zich ontvouwen in een bijna overweldigende cascade van aanvullende bevindingen. Aangezien we alleen een klein deel van deze hebben kunnen behandelen, beveel ik de bron-PDF aan, zelfs aan de gemiddelde lezer (een zeldzame gebeurtenis).

Hoewel een ‘gele’ houding veel negatieve interpretaties kan werpen op de ontdekkingen van de auteurs, kan het werk het beste worden behandeld als een indicatie van een wereldwijde technologie-leider die probeert een wereldwijde leidende positie te behalen in AI-gebaseerde zoekopdrachten, met behulp van sterk contrastende platforms die in zeer verschillende omstandigheden en over zeer verschillende tijdperken zijn ontwikkeld.

Terwijl drie zoekmethoden in het paper worden onderzocht, is de echte twist tussen traditionele zoekresultaten, gerangschikt door propriëtaire methoden, en de scherp contrastende distributie-gebaseerde selectiemethoden die de gegevenscuratie en AI-training domineren.

AI Like It’s 1999

Voordat Google opkwam, was het mogelijk om ‘zoekresultaten te manipuleren’ door middel van louter volume, en op die manier kon men vaak een plaatsing op de voorpagina van SERPS bereiken met minimale (vaak geautomatiseerde) inspanning. Dit ‘nummerspel’ werd effectief beëindigd rond 2002 door Google’s meer geavanceerde en geheime zoekopdracht-algoritme. Maar aangezien de inzet hoog was, is lage-kwaliteit inhoud nooit echt weggegaan in enige zin.

Daarom, tegen de tijd dat hyperschaalcollecties zoals Common Crawl de basis legden voor de moderne AI-revolutie, was gegevensprominentie gedoemd om te worden gedomineerd door de mate waarin geautomatiseerde processen filteren en rangschikken van inkomende gegevenskwaliteit, en (veel minder waarschijnlijk), de mate waarin geld beschikbaar was om mensen te betalen om die gegevens te rangschikken.

Er was veel slechte of lage-kwaliteit gegevens in die enorme en ondiscriminerende collecties; gegevens die mogelijk geen naaktheid, vloeken, racistische tropen of enige andere dingen bevatten die relatief eenvoudig zijn om uit trainingsgegevens te filteren – maar die desalniettemin zelfbedienend en omvangrijk waren, net als resultaten van internetzoekopdrachten rond 1999-2001.

Omdat die gegevensinductieprocessen nog steeds niet geweldig zijn, is het heel moeilijk, zelfs voor Google, om AI te laten handelen op een zakelijke manier, aangezien Gemini’s PageRank-achtige beslissingen worden gedicteerd door een onvolmaakte begrip van hoe hyperschaalgegevens zich transformeren in gegevensdistributies en latent embeddings tijdens de training van een AI-model.

* Zoekresultatenpagina’s.

† Auteursbenadrukking, niet de mijne. Ik heb echter vetgedrukt in plaats van cursief, omdat cursief benadrukking niet goed werkt in quotes die al voornamelijk cursief zijn.

Eerst gepubliceerd op woensdag, 13 mei 2026