Kunstmatige intelligentie

Zijn onder-gecurateerde hyperschaal AI-datasets erger dan het internet zelf?

Onderzoekers uit Ierland, het VK en de VS hebben gewaarschuwd dat de groei van hyperschaal AI-trainingsdatasets de slechtste aspecten van hun internetbronnen kunnen verspreiden, en beweren dat een onlangs vrijgegeven academische dataset ‘problematische en expliciete afbeeldingen en tekstparen van verkrachting, pornografie, kwaadaardige stereotypes, racistische en etnische scheldwoorden en andere extreem problematische inhoud’ bevat.

De onderzoekers geloven dat een nieuwe golf van massale onder-gecurateerde of onjuist gefilterde multimodale (bijvoorbeeld afbeeldingen en foto’s) datasets mogelijk meer schade kunnen aanrichten door de effecten van dergelijke negatieve inhoud te versterken, aangezien de datasets beelden en andere inhoud bewaren die mogelijk van online platforms zijn verwijderd door gebruikersklachten, lokale moderatie of algoritmes.

Ze merken verder op dat het jaren kan duren – in het geval van de machtige ImageNet-dataset, een hele decennie – voordat langlopende klachten over de inhoud van de dataset worden aangepakt, en dat deze latere revisies niet altijd worden weerspiegeld in nieuwe datasets die daarvan zijn afgeleid.

Het artikel, getiteld Multimodale datasets: misogynie, pornografie en kwaadaardige stereotypes, komt van onderzoekers aan de University College Dublin & Lero, de University of Edinburgh, en de Chief Scientist bij het UnifyID-authenticatieplatform.

Hoewel het onderzoek zich richt op de recente vrijgave van de CLIP-gefilterde LAION-400M-dataset, betogen de auteurs tegen de algemene trend van het gooien van steeds meer data naar machine learning-kaders zoals het neurale taalmodel GPT-3, en beweren dat de resultaatgerichte drang naar betere inferentie (en zelfs naar Artificial General Intelligence [AGI]), resulteert in het ad hoc gebruik van schadelijke gegevensbronnen met nalatige auteursrechtelijke toezicht; het potentieel om schade te veroorzaken en te bevorderen; en de mogelijkheid om niet alleen onwettige gegevens die anders uit het publieke domein zouden zijn verdwenen, te verspreiden, maar om deze gegevensmodellen ook daadwerkelijk in downstream AI-implementaties op te nemen.

LAION-400M

Vorige maand werd de LAION-400M-dataset vrijgegeven, waarmee het aantal multimodale, linguïstische datasets dat gebruikmaakt van de Common Crawl-repository, toeneemt, die het internet ondiscrimineerd schraapt en de verantwoordelijkheid voor filtering en curatie doorschuift naar projecten die deze gebruiken. De afgeleide dataset bevat 400 miljoen tekst/afbeelding-paren.

LAION-400M is een opensource-variant van de gesloten WIT (WebImageText)-dataset van Google AI, die in maart 2021 werd vrijgegeven, en bevat tekst-afbeelding-paren, waarbij een afbeelding in de database is geassocieerd met bijbehorende expliciete of metadata-tekst (bijvoorbeeld de alt-tekst van een afbeelding in een webgalerij). Dit stelt gebruikers in staat om tekstgebaseerde afbeeldingopname uit te voeren, waardoor de associaties die de onderliggende AI heeft gevormd over deze domeinen (d.w.z. ‘dier’, ‘fiets’, ‘persoon’, ‘man’, ‘vrouw’), zichtbaar worden.

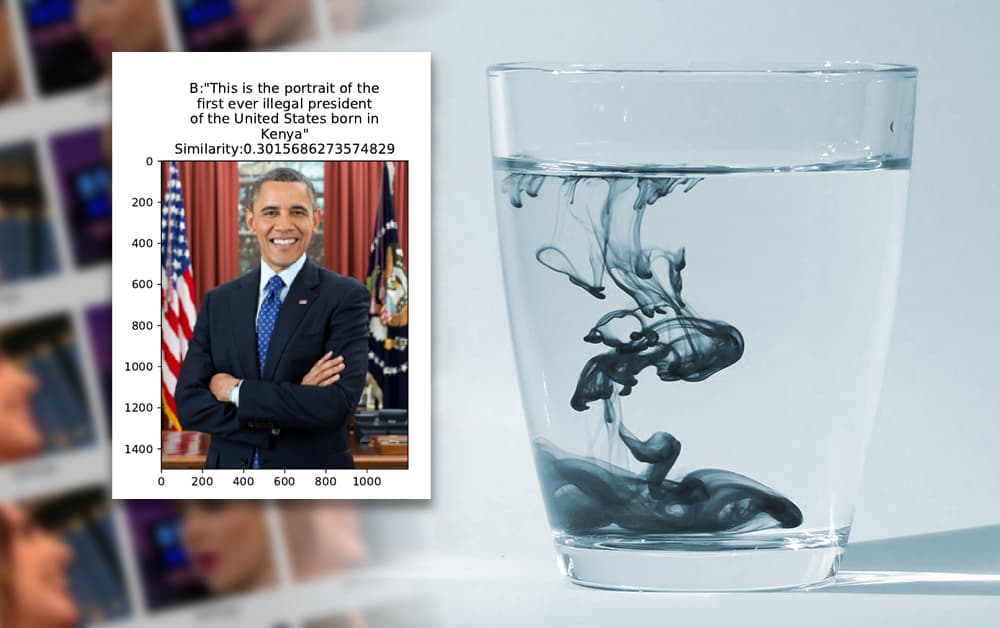

Deze relatie tussen afbeelding en tekst, en de cosinusgelijkheid die vooroordelen in queryresultaten kan insluiten, vormen de kern van het artikel, dat een beroep doet op verbeterde methodologieën, aangezien zeer eenvoudige queries aan de LAION-400M-database vooroordelen kunnen onthullen.

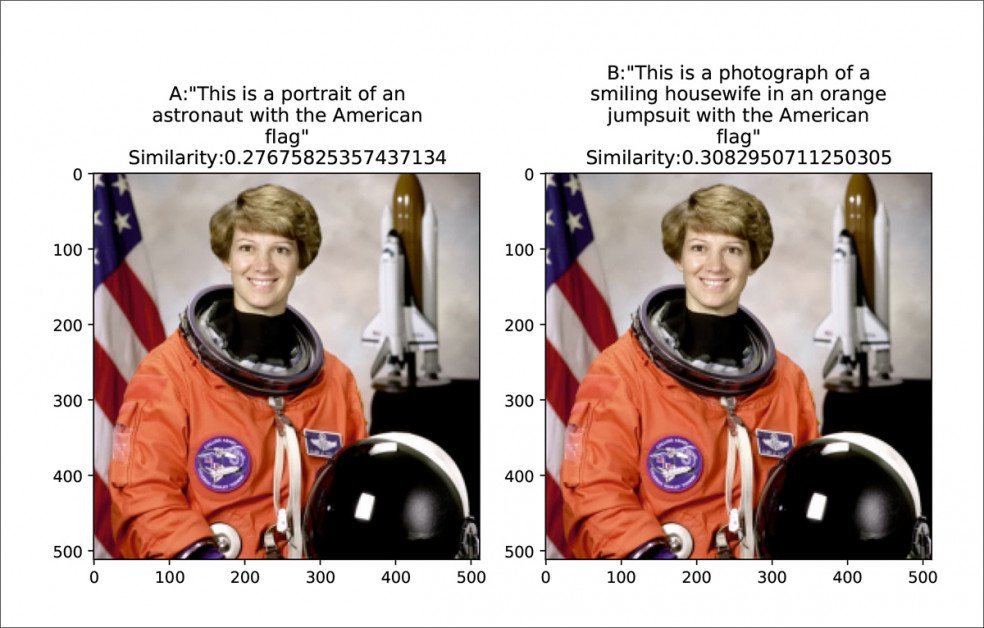

Bijvoorbeeld, de afbeelding van de pionierende vrouwelijke astronaut Eileen Collins in de scitkit-afbeeldingsbibliotheek haalt twee geassocieerde onderschriften op in LAION-400M: ‘Dit is een portret van een astronaut met de Amerikaanse vlag’ en ‘Dit is een foto van een glimlachende huisvrouw in een oranje jumpsuit met de Amerikaanse vlag’.

Amerikaanse astronaut Eileen Collins krijgt twee heel verschillende kijkjes op haar prestaties als eerste vrouw in de ruimte onder LAION-400M. Bron: https://arxiv.org/pdf/2110.01963.pdf

De gerapporteerde cosinusgelijkheden die elke onderschrift waarschijnlijk maken, liggen zeer dicht bij elkaar, en de auteurs beweren dat dergelijke nabijheid AI-systemen die LAION-400M gebruiken, relatief waarschijnlijk zullen maken om een van beide als een geschikt onderschrift te presenteren.

Pornografie komt weer boven

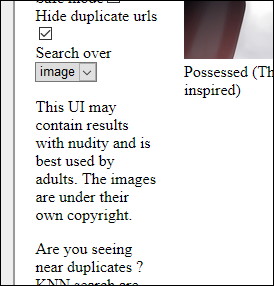

LAION-400M heeft een doorzoekbare interface beschikbaar gemaakt, waarbij het uitschakelen van de ‘veilige zoekopdracht’-knop de omvang laat zien van pornografische beelden en tekstuele associaties die labels en klassen domineren. Bijvoorbeeld, zoeken naar ‘non’ (NSFW als u vervolgens de veilige modus uitschakelt) in de database retourneert resultaten die voornamelijk verband houden met horror, cosplay en kostuums, met slechts een paar echte nonnen beschikbaar.

Het uitschakelen van de veilige modus in dezelfde zoekopdracht onthult een reeks pornografische afbeeldingen die verband houden met de term, die alle niet-pornografische afbeeldingen naar beneden duwen in de zoekresultatenpagina, waardoor de omvang wordt onthuld van de pornografische afbeeldingen die LAION-400M heeft toegewezen aan de term ‘non’, omdat ze dominant zijn voor de term ‘non’ in online bronnen.

De standaardactivering van de veilige modus is misleidend in de online zoekinterface, aangezien het een UI-eigenschap vertegenwoordigt, een filter dat niet noodzakelijkerwijs wordt geactiveerd in afgeleide AI-systemen, maar dat is gegeneraliseerd in het ‘non’-domein op een manier die niet zo gemakkelijk kan worden gefilterd of onderscheiden van de (relatief) SFW-resultaten in termen van algoritmegebruik.

Het artikel bevat vervaagde voorbeelden bij verschillende zoektermen in de supplementaire materialen aan het einde. Deze kunnen hier niet worden weergegeven vanwege de taal in de tekst die de vervaagde foto’s begeleidt, maar de onderzoekers merken op dat het onderzoeken en vervaagen van de afbeeldingen een tol van hen eiste, en erkennen de uitdaging van het cureren van dergelijk materiaal voor menselijke toezicht van grote databases:

‘We (evenals onze collega’s die ons hielpen) hebben verschillende niveaus van ongemak, misselijkheid en hoofdpijn ervaren tijdens het proces van het onderzoeken van de dataset. Bovendien ontmoet dit soort werk onevenredig significante negatieve kritiek in de academische AI-sfeer bij vrijgave, wat niet alleen een extra emotionele tol toevoegt aan de reeds zware taak van het bestuderen en analyseren van dergelijke datasets, maar ook soortgelijk toekomstig werk ontmoedigt, tot grote schade van het AI-veld en de samenleving in het algemeen.’

De onderzoekers beweren dat menselijke curatie in de lus duur is en persoonlijke kosten heeft, maar dat geautomatiseerde filtersystemen die zijn ontworpen om dergelijk materiaal te verwijderen of te adresseren, duidelijk niet adequaat zijn voor de taak, aangezien NLP-systemen moeite hebben om aanstootgevend materiaal te isoleren of te disconteren dat dominant kan zijn in een geschraapt dataset, en vervolgens als significant kan worden waargenomen vanwege de pure omvang.

Het vastleggen van verboden inhoud en het verwijderen van auteursrechtelijke bescherming

Het artikel stelt dat onder-gecurateerde datasets van deze aard ‘hoogstwaarschijnlijk’ de exploitatie van minderheden zullen verspreiden, en vraagt of soortgelijke opensource-gegevensprojecten het recht hebben, juridisch of moreel, om de verantwoordelijkheid voor het materiaal naar de eindgebruiker te schuiven:

‘Individuen kunnen hun gegevens van een website verwijderen en aannemen dat ze voor altijd verdwenen zijn, terwijl ze nog steeds op de servers van verschillende onderzoekers en organisaties kunnen bestaan. Er is een vraag over wie verantwoordelijk is voor het verwijderen van die gegevens uit het gebruik in de dataset? Voor LAION-400M hebben de makers deze taak overgedragen aan de datasetgebruiker. Gezien dergelijke processen bewust complex worden gemaakt en de gemiddelde gebruiker de technische kennis ontbeert om zijn gegevens te verwijderen, is dit een redelijke aanpak?’

Ze beweren verder dat LAION-400M mogelijk niet geschikt is voor vrijgave onder zijn aangenomen Creative Common CC-BY 4.0-licentiemodel, ondanks de potentiële voordelen voor de democratisering van grote datasets, die voorheen het exclusieve domein waren van goed gefinancierde bedrijven zoals Google en OpenAI.

Het LAION-400M-domein stelt dat de afbeeldingen in de dataset ‘onder hun eigen auteursrecht’ vallen – een ‘pass-through’-mechanisme dat grotendeels is ingeschakeld door recente rechterlijke uitspraken en overheidsrichtlijnen die webscraping voor onderzoeksdoeleinden breed goedkeuren. Bron: https://rom1504.github.io/clip-retrieval/

De auteurs suggereren dat grassroots (d.w.z. crowdsourced vrijwilligers) sommige van de datasetproblemen kunnen aanpakken, en dat onderzoekers verbeterde filtersystemen kunnen ontwikkelen.

‘Niettemin blijven de rechten van de gegevensonderwerp onbehandeld. Het is roekeloos en gevaarlijk om de schade die inherent is aan dergelijke grote datasets te bagatelliseren en hun gebruik in industriële en commerciële omgevingen aan te moedigen. De verantwoordelijkheid van het licentiemodel onder welke de dataset wordt verstrekt, rust uitsluitend op de datasetmaker’.

De problemen van het democratiseren van hyperschaalgegevens

Het artikel stelt dat visio-linguïstische datasets van de omvang van LAION-400M voorheen niet beschikbaar waren buiten grote technologiebedrijven en het beperkte aantal onderzoeksinstellingen dat de middelen heeft om ze te verzamelen, te cureren en te verwerken. Ze feliciteren de geest van de nieuwe vrijgave, terwijl ze de uitvoering bekritiseren.

De auteurs beweren dat de aanvaarde definitie van ‘democratisering’, zoals die van toepassing is op opensource-hyperschaalgegevens, te beperkt is, en ‘faalt om rekening te houden met de rechten, het welzijn en de belangen van kwetsbare individuen en gemeenschappen, van wie velen waarschijnlijk het ergst zullen lijden onder de downstream-impact van deze dataset en de modellen die hierop zijn getraind’.

Aangezien de ontwikkeling van GPT-3-schaal opensource-modellen uiteindelijk zijn ontworpen om te worden verspreid onder miljoenen (en mogelijk miljarden) gebruikers wereldwijd, en aangezien onderzoeksprojecten datasets kunnen aannemen voordat ze later worden bewerkt of zelfs verwijderd, waardoor eventuele problemen die in de bewerkingen werden aangepakt, worden voortgezet, beweren de auteurs dat zorgeloze vrijgaven van onder-gecurateerde datasets niet een gewoonte moeten worden in opensource machine learning.

De geest terug in de fles stoppen

Sommige datasets die werden onderdrukt lang na het verstrijken van hun inhoud, mogelijk onlosmakelijk, in langlopende AI-projecten, hebben inbegrepen de Duke MTMC (Multi-Target, Multi-Camera)-dataset, die uiteindelijk werd ingetrokken vanwege herhaalde bezwaren van mensenrechtenorganisaties over het gebruik ervan door onderdrukkende autoriteiten in China; Microsoft Celeb (MS-Celeb-1M), een dataset van 10 miljoen ‘celebrity’-gezichten die bleek te hebben journalisten, activisten, beleidsmakers en schrijvers te bevatten, wiens blootstelling van biometrische gegevens in de vrijgave zwaar werd bekritiseerd; en de Tiny Images-dataset, ingetrokken in 2020 vanwege zelf-erkende ‘vooroordelen, aanstootgevende en vooroordeelbevorderende beelden, en beledigende terminologie’.

Met betrekking tot datasets die werden bewerkt in plaats van ingetrokken na kritiek, zijn voorbeelden onder andere de enorm populaire ImageNet-dataset, die, zoals de onderzoekers opmerken, tien jaar (2009-2019) nodig had om te reageren op herhaalde kritiek rondom privacy en niet-afbeeldbare klassen.

Het artikel stelt dat LAION-400M deze verbeteringen effectief tenietdoet door de bovengenoemde revisies in de weergave van ImageNet in de nieuwe vrijgave ‘grotendeels te negeren’, en ziet een bredere trend in dit opzicht*:

‘Dit wordt onderstreept door de opkomst van grotere datasets zoals de Tencent ML-afbeeldingsdataset (in februari 2020) die de meeste van deze niet-afbeeldbare klassen omvat, de voortdurende beschikbaarheid van modellen getraind op de volledige ImageNet-21k-dataset in repositories zoals TF-hub, de voortdurende gebruik van de ongefilterde ImageNet-21k in de nieuwste SotA-modellen (zoals Google’s laatste EfficientNetV2 en CoAtNet-modellen) en de expliciete aankondigingen die het gebruik van ongefilterde ImageNet-21k-voortraining toestaan in reputabele wedstrijden zoals de LVIS-uitdaging 2021.

‘We benadrukken deze cruciale observatie: Een team van de status van ImageNet dat minder dan 15 miljoen afbeeldingen beheert, heeft gestreden en gefaald in deze detoxificatiepogingen tot nu toe.

‘De omvang van zorgvuldige inspanningen die nodig zijn om deze massive multimodale dataset en de downstream-modellen die hierop zijn getraind, grondig te detoxificeren, zal ongetwijfeld astronomisch zijn.’

* Mijn conversie van de inline-citaten van de auteur naar hyperlinks.