인공지능

ST-NeRF: 비디오 합성 위한 컴포지팅 및 편집

중국 연구 컨소시엄은 개발한 기법으로 지난 1년 동안 가장 인기 있는 이미지 합성 연구 분야 중 하나인 Neural Radiance Fields (NeRF)에 편집 및 컴포지팅 기능을 제공한다. 시스템은 ST-NeRF (Spatio-Temporal Coherent Neural Radiance Field)라고 불린다.

아래 이미지에서 물리적인 카메라 패닝으로 보이는 것은 실제로 사용자가 4D 공간에 존재하는 비디오 콘텐츠의 관점을 스크롤하는 것이다. 사람들의 동작은 180도 반경의 어느 부분에서든지 볼 수 있다.

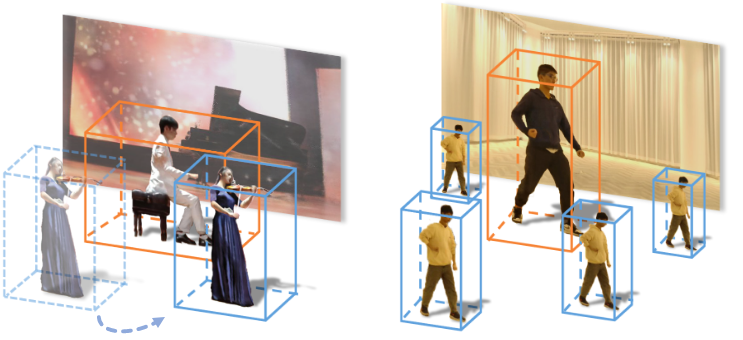

비디오 내의 각 요소는 별도로 캡처된 요소로, 동적으로 탐색할 수 있는 일관된 장면으로 컴포지트된다.

요소들은 장면 내에서 자유롭게 복제하거나 크기를 조정할 수 있다:

또한, 각 요소의 시간적 행동을 쉽게 변경할 수 있다. 느리게 하거나, 반대로 재생하거나, 다양한 방법으로 조작할 수 있다. 이는 필터 아키텍처와 매우 높은 수준의 해석 가능성을 열어준다.

두 개의 별도 NeRF 요소가 동일한 장면에서 다른 속도로 실행된다. 출처: https://www.youtube.com/watch?v=Wp4HfOwFGP4

수행자나 환경을 로토스코핑하거나, 수행자가 의도된 장면의 contexto 없이 무작위로 움직임을 실행할 필요가 없다. 대신, 16개의 비디오 카메라를 사용하여 180도 범위의 자연스러운 장면을 캡처한다:

위에 표시된 세 요소, 두 사람과 환경,는 별도로 표시되며, 설명을 위해만 사용된다. 각 요소는 교체할 수 있으며, 각 요소는 개별 캡처 타임라인의 이전 또는 이후 시점에 장면에 삽입할 수 있다.

ST-NeRF는 Neural Radiance Fields (NeRF) 연구에 대한 혁신이다. NeRF는 기계 학습 프레임워크로, 여러 관점의 캡처를 광범위한 훈련을 통해 탐색 가능한 가상 공간으로 합성한다(단일 관점 캡처도 NeRF 연구의 하위 분야이다).

Neural Radiance Fields는 여러 캡처 관점을 하나의 일관된 탐색 가능한 3D 공간으로 결합한다. 비디오(이미지가 아닌)를 사용하는 경우, 필요한 렌더링 리소스는 종종 상당하다. 출처: https://www.matthewtancik.com/nerf

NeRF에 대한 관심은 지난 9개월 동안剧적으로 증가했으며, Reddit에서 관리하는 리스트는 현재 60개의 프로젝트를 나열하고 있다.

원래 NeRF 논문의 몇 가지 분기만 표시한다. 출처: https://crossminds.ai/graphlist/nerf-neural-radiance-fields-ai-research-graph-60708936c8663c4cfa875fc2/

경제적인 훈련

이 논문은 상하이 테크 대학교와 DGene Digital Technology의 연구자 간의 협력으로, Open Review에서热烈한 환영을 받았다.

ST-NeRF는 이전의 ML 기반 탐색 가능한 비디오 공간에 대한 여러 가지 혁신을 제공한다. 가장 중요한 것은 16개의 카메라만으로도 매우 사실적인 결과를 제공한다. 페이스북의 DyNeRF는 2개의 카메라만 더 사용하지만, 탐색 가능한 아크가 훨씬 제한적이다.

페이스북의 DyNeRF 환경의 예, 이동 범위가 제한적이며, 장면을 재구성하기 위해 더 많은 카메라가 필요하다. 출처: https://neural-3d-video.github.io

DyNeRF는 또한 편집 및 컴포지팅 기능이 없으며, 특히 계산 리소스에 대한 비용이 많이 든다. 반면에, 중국의 연구자들은 자신의 데이터에 대한 훈련 비용이 약 900~3,000달러라고 밝혔으며, 이는 DVDGAN과 같은 최첨단 비디오 생성 모델의 30,000달러에 비해 상당히 저렴하다.

검토자들은 또한 ST-NeRF가 동작 학습과 이미지 합성의 과정을 분리하는 주요 혁신을 이루었다고 지적했다. 이 분리는 편집 및 컴포지팅을 가능하게 하며, 이전의 접근 방식은 제한적이고 선형적이었다.

16개의 카메라는 매우 제한적인 배열이지만, 연구자들은 추후 작업에서 정적 배경을 미리 스캔하고, 더 많은 데이터 기반의 장면 모델링 접근 방식을 사용하여 이 숫자를 더 줄이기를 희망한다. 또한, 최근 NeRF 연구에서 새로운 혁신인 재조명 기능을 통합하기를 희망한다.

ST-NeRF의 한계

학술적 CS 논문에서 새로운 시스템의 실제 사용 가능성을 폐기하는 마지막 문단을 고려하면, 연구자들이 인정한 ST-NeRF의 한계는异常하다.

그들은 현재 시스템이 장면 내의 특정 객체를 개별적으로 식별하고 렌더링할 수 없다고 관찰한다. 이는 사람을 인식하기 위한 시스템으로 설계되었기 때문이다. 그러나 YOLO와 같은 프레임워크를 사용하여 쉽게 해결할 수 있다.

연구자들은 또한 현재 느린 동작을 생성할 수 없다고 지적하지만, 기존의 프레임 보간법 인 DAIN 및 RIFE를 사용하여 이를 구현하는 데에는 거의 장애물이 없다.

NeRF 구현과 컴퓨터 비전 연구의 많은 분야에서와 마찬가지로, ST-NeRF는 심각한 occlusion의 경우에 실패할 수 있다. 여기서 주제는 일시적으로 다른 사람이나 객체에 의해 가려질 수 있으며, 연속적으로 추적하거나 정확하게 재취득하기가 어렵다. 이러한 어려움은 업스트림 솔루션을 기다려야 할 수 있다. 한편, 연구자들은 이러한 가려진 프레임에서 수동 개입이 필요하다고 인정한다.

마지막으로, 연구자들은 현재的人 segmentation 절차가 색상 차이를 기반으로 하기 때문에, 두 사람을 하나의 분할 블록으로 잘못 결합할 수 있다고 지적한다. 이는 ST-NeRF에만 국한된 것이 아니라, 사용되는 라이브러리에 내재된 한계이며, 광류 분석 및 기타 새로운 기술을 통해 해결할 수 있을 것이다.

최초로 게시된 날짜는 2021년 5월 7일이다.