인공지능

컴퓨터 비전에서 ‘합쳐진’ 인간 분리

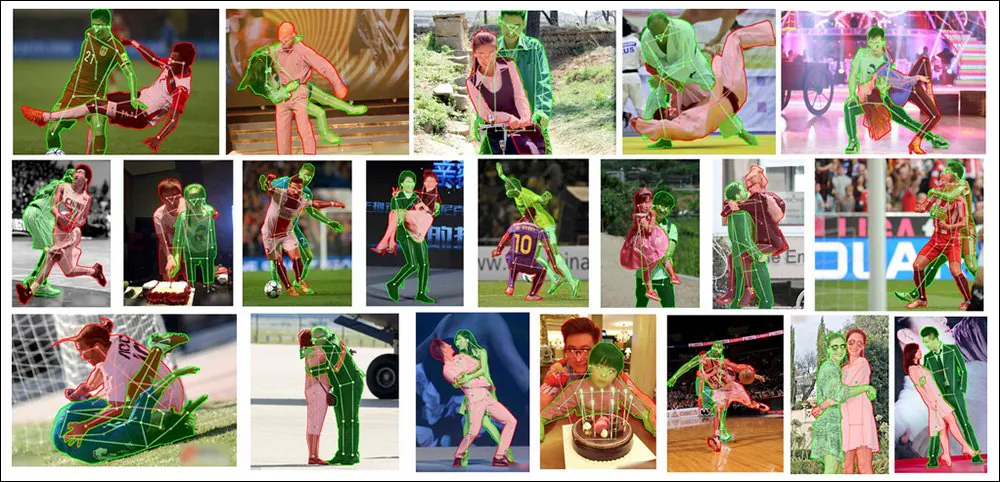

현대자동차그룹 신기술센터에서 발표한 새로운 논문은 컴퓨터 비전에서 ‘합쳐진’ 인간을 분리하는 방법을 제시한다. 즉, 객체 인식 프레임워크가 다른 사람과 너무 가까이 있는 사람(예:拥抱 동작 또는 뒤에 서 있는 자세)을 발견했으며, 두 사람을 구별할 수 없어 단일 사람 또는 엔티티로 혼동하는 경우를 말한다.

Two become one, but that’s a not a good thing in semantic segmentation. Here we see the paper’s new system achieving state-of-the-art results on individuation of intertwined people in complex and challenging images. Source: https://arxiv.org/pdf/2210.03686.pdf

이 문제는 최근 몇 년 동안 연구 커뮤니티에서 많은 주목을 받았다. 이 문제를 해결하는 것은 텍스트-이미지 시스템(예: Stable Diffusion)에서 인간 인식 개선을 가능하게 할 수 있다. 이러한 시스템은 종종 사람들을 가까이 배치해야 하는 프롬프트 포즈에서 사람들을 함께 결합한다.

Embrace the horror – text-to-image models such as DALL-E 2 and Stable Diffusion (both featured above) struggle to represent people in very close proximity to each other.

생성 모델(예: DALL-E 2 및 Stable Diffusion)은 현재 객체 인식이나 의미론적 분할을 사용하지 않는다(최소한 DALL-E 2의 경우에는 닫힌 소스이므로). 이러한 끔찍한 인간 포르만토는 업스트림 방법을 적용하여 해결할 수 없다. 왜냐하면 상태 오프 더 아트 객체 인식 라이브러리 및 리소스는 사람들을 분리하는 데 생성 모델만큼 좋지 않기 때문이다.

이 문제를 해결하기 위해 새로운 논문 – 제목 Humans need not label more humans: Occlusion Copy & Paste for Occluded Human Instance Segmentation – 최근 ‘컷 앤 페스트’ 접근 방식을 반영하여 반도체 데이터를 개선하여 새로운 최적의 성능을 달성한다. 이는 가장 어려운 소스 자료에 대해서도 그렇다.

The new Occlusion Copy & Paste methodology currently leads the field even against prior frameworks and approaches that address the challenge in elaborate and more dedicated ways, such as specifically modeling for occlusion.

Cut That Out!

수정된 방법 – Occlusion Copy & Paste – 2021년 Simple Copy-Paste 논문에서 파생되었다. 이 논문은 구글 리서치가 주도했으며, 다양한 소스 훈련 이미지에 추출된 객체와 사람을 겹치면 이미지 인식 시스템이 각 인스턴스를 분리하는 능력이 향상될 수 있음을 제안했다.

From the 2021 Google Research-led paper ‘Simple Copy-Paste is a Strong Data Augmentation Method for Instance Segmentation’, we see elements from one photo ‘migrating’ to other photos, with the objective of training a better image recognition model. Source: https://arxiv.org/pdf/2012.07177.pdf

새로운 버전은 이 자동화된 알고리즘 ‘리패스팅’에 제한과 매개변수를 추가한다. 이는 이미지의 잠재적 후보자로 가득 찬 ‘바구니’를 상상하는 과정이다. 이는 여러 가지 주요 요인에 따라 진행된다.

The conceptual workflow for OC&P.

Controlling the Elements

그 제한 요소에는 확률이 포함된다. 즉, 컷과 페스트가 발생할 확률을 말한다. 이는 프로세스가 항상 발생하지는 않도록 보장한다. 이는 데이터 증강을 저해하는效果을 낳을 수 있다. 또 다른 요소는 이미지의 수이다. 즉, 바구니에 있는 이미지의 수를 말한다. 이미지의 수가 많으면 인스턴스의 다양성이 향상될 수 있지만, 전처리 시간이 길어질 수 있다. 또한 범위가 있다. 즉, 몇 개의 이미지를 호스트 이미지에 붙여 넣을지를 결정한다.

후자의 경우, 논문은 ‘우리는 충분한 오คล루젼이 발생해야 하지만, 너무 많은 오คล루젼은 이미지의 클러터링을 증가시켜 학습에 해가 될 수 있다.’라고 말한다.

OC&P의 다른 두 가지 혁신은 타겟팅된 붙여넣기와 증강된 인스턴스 붙여넣기이다.

타겟팅된 붙여넣기는 새 요소가 기존 인스턴스 근처의 대상 이미지에착陆하도록 보장한다. 이전 접근 방식에서는 새 요소가 이미지 경계 내에서만 제한되었으며, 컨텍스트를 고려하지 않았다.

Though this ‘paste in’, with targeted pasting, is obvious to the human eye, both OC&P and its predecessor have found that increased visual authenticity is not necessarily important, and could even be a liability (see ‘Reality Bites’ below).

증강된 인스턴스 붙여넣기는 붙여넣은 인스턴스가 특정한外観을 보여주지 않도록 보장한다. 이는 시스템에 의해 분류될 수 있으며, 일반화 및 적용성을 방해할 수 있다. 증강된 붙여넣기는 밝기 및 선명도, 크기 및 회전, 채도 등을 포함한 시각적 요인을 조절한다.

From the supplementary materials for the new paper: adding OC&P to existing recognition frameworks is fairly trivial, and results in superior individuation of people in very close confines. Source: https://arxiv.org/src/2210.03686v1/anc/OcclusionCopyPaste_Supplementary.pdf

또한 OC&P는 붙여넣은 인스턴스의 최소 크기를 조정한다. 예를 들어, 대규모 군중 장면에서 한 사람의 이미지를 추출하여 다른 이미지에 붙여넣을 수 있지만, 이러한 경우 픽셀의 수가 작아 인식에 도움이 되지 않을 수 있다. 따라서 시스템은 대상 이미지의 등화된 측면 길이의 비율에 따라 최소 크기를 적용한다.

さらに, OC&P는 스케일-어웨어 붙여넣기를 실시한다. 즉, 붙여넣기 대상과 유사한 주제를 찾는 것 외에도, 대상 이미지의 바운딩 박스의 크기를 고려한다. 그러나 이것은 사람들에게 실제적인 이미지를 생성하지는 않는다. 그러나 훈련 중에 도움이 되는 의미론적으로 적절한 요소를 근처에 조립한다.

Reality Bites

OC&P의 이전 작업과 현재 구현 모두에서, 실제성 또는 최종 ‘montaged’ 이미지의 ‘photoreality’에 대한 가치는 낮다. 이것은 실제 배포에서 시스템이 훈련에 사용된 요소를 만날 수 없을 정도로 전적으로 다다주의로 떨어지지 않도록 하는 것이 중요하다. 그러나 두 가지 이니셔티브 모두 실제성의显著한 증가가 추가로 필요하지 않으며, 실제로 반생산적일 수 있다는 것을 발견했다.

From the new paper’s supplementary material: examples of augmented images with ‘random blending’. Though these scenes may look hallucinogenic to a person, they nonetheless have similar subjects thrown together; though the occlusions are fantastical to the human eye, the nature of a potential occlusion can’t be known in advance, and is impossible to train for – therefore, such bizarre ‘cut offs’ of form are enough to force the trained system to seek out and recognize partial target subjects, without needing to develop elaborate Photoshop-style methodologies to make the scenes more plausible.

Data and Tests

테스트 단계에서, 시스템은 person 클래스의 MS COCO 데이터셋으로 훈련되었다. 이는 64,115개의 이미지에 걸쳐 262,465개의 인간 예시를 특징으로 한다. 그러나 더 나은 품질의 마스크를 얻으려면, 이미지에도 LVIS 마스크 주석이 추가되었다.

Released in 2019, LVIS, from Facebook research, is a voluminous dataset for Large Vocabulary Instance Segmentation. Source: https://arxiv.org/pdf/1908.03195.pdf

연구자들은 OC&P를 OCHuman(Occluded Human) 벤치마크에 대하여 평가했다. 이는 많은 수의 오클루전된 인간 이미지를 처리하는 시스템의 능력을 평가하기 위한 것이다.

Examples from the OCHuman dataset, introduced in support of the Pose2Seg detection project in 2018. This initiative sought to derive improved semantic segmentation of people by using their stance and pose as a semantic delimiter for the pixels representing their bodies. Source: https://github.com/liruilong940607/OCHumanApi

OCHuman 벤치마크는 완전히 주석이 달려 있지 않기 때문에, 연구자들은 완전히 주석이 달린 예시만을 포함하는 하위 집합을 생성했다. 이를 OCHumanFL이라고 한다. 이는 검증을 위해 1,113개의 이미지에 걸쳐 2,240개의 사람 인스턴스와, 테스트를 위해 951개의 실제 이미지에 걸쳐 1,923개의 인스턴스를 포함한다. 원래와 새로 구축된 집합 모두를 테스트했으며, 주요 지표는 평균 정밀도(mean Average Precision, mAP)였다.

일관성을 위해, 아키텍처는 Mask R-CNN과 ResNet-50 백본, 그리고 피라미드 네트워크로 구성되었다. 후자는 정확도와 훈련 속도 간의 합리적인 妥協点을 제공한다.

연구자들은 이전에 유사한 상황에서 업스트림 ImageNet의 영향이 유해할 수 있음을 주목했다. 따라서 전체 시스템은 4개의 NVIDIA V100 GPU에서 스크래치에서 훈련되었으며, 훈련은 75 에포크 동안 진행되었으며, 초기화 매개변수는 Facebook의 2021년 Detectron 2를 따랐다.

Results

위에서 언급한 결과 외에도, MMDetection(그리고 관련 모델 3개)에 대한 테스트 결과는 OC&P의 복잡한 포즈에서 인간을 식별하는 능력에서 명확한 리드를 보였다.

PoSeg와 Pose2Seg를 능가하는 것 외에도, 이 논문의 가장 두드러진 성과 중 하나는 bahwa 시스템이 기존 프레임워크에 제네릭으로 적용될 수 있다는 것이다. 이는 테스트에서 그것과 경쟁한 모델(본 문서 시작 부분의 첫 번째 결과 상자에서 비교 참조)을 포함한다.

논문은 다음과 같이 결론을 내린다:

‘우리의 접근 방식의 주요 이점은 bahwa 그것이 쉽게 적용될 수 있다는 것이다. 모델이나 다른 모델 중심의 개선과 함께. 깊은 학습 분야가 빠르게 발전하는 상황에서, 모든 훈련의 다른 측면과高度互換性을 가진 접근 방식을 갖는 것이 모두에게 유리하다. 우리는 이 접근 방식을 모델 중심의 개선과 통합하여 효과적으로 오클루전된 사람 인스턴스 분할을 해결하는 것을 미래의 작업으로 남긴다.’

Potential for Improving Text-to-Image Synthesis

첫 저자 Evan Ling은 Unite.AI에 보낸 이메일에서, OC&P의 주요 이점은 원래 마스크 레이블을 유지하고 새로운 상황에서 무료로 새로운 가치를 얻을 수 있다는 것이다. 즉, 이미지를 붙여넣은 이미지에서 그렇다.

인간의 의미론적 분할은 사람들을 개별화하는 데 어려움을 겪는 모델(예: Stable Diffusion)의 어려움과密接하게 관련되어 있다. 그러나 의미론적 레이블링 문화가 이러한 모델에서 발생하는 끔찍한 인간 렌더링에 미치는 영향은 매우 업스트림에 있다.

Stable Diffusion의 생성力を 구성하는 LAION 5B 하위 집합 이미지에는 객체 수준의 레이블(바운딩 박스 및 인스턴스 마스크 등)이 포함되지 않는다. 즉, CLIP 아키텍처는 이미지와 데이터베이스 콘텐츠에서 렌더링을 구성하는 데 bénéfice를 얻었을 수 있지만, LAION 이미지에는 이러한 인스턴스화가 없다. 대신, LAION 이미지에는 무료 레이블이 있다. 즉, 이미지에서 웹에서 스크레이핑할 때 관련된 메타데이터 및 캡션 등에서 파생된 레이블이다.

‘하지만 그렇지 않으면,’ Ling은 말한다. ‘OC&P와 유사한 일부 증강은 텍스트-이미지 생성 모델 훈련 중에 사용될 수 있다. 그러나 나는 이미지의 실제성이 훈련에 문제가 될 수 있다고 생각한다.

‘우리의 연구에서 우리는 ‘완벽한’ 실제성이 일반적으로 감독 인스턴스 분할에 필요하지 않음을 보여주었다. 그러나 텍스트-이미지 생성 모델 훈련의 경우, 특히 출력이高度 실제적이어야 하는 경우, 실제성이 문제가 될 수 있다. 이 경우, 증강된 이미지의 실제성을 ‘완벽하게’ 하는 데 더 많은 작업이 필요할 수 있다.’

CLIP은 이미 의미론적 분할을 위한 다중 모달 도구로 사용되고 있다. 이는 개선된 사람 인식 및 개별화 시스템(예: OC&P)이 궁극적으로 임의로 거부하는 ‘합쳐진’ 및 왜곡된 인간 표현을 필터링하거나 분류기로 개발될 수 있음을 시사한다. 이는 현재 Stable Diffusion에서 어려운 작업이다. 왜냐하면 Stable Diffusion는どこ에서 실수를했는지 이해하는 능력이 없기 때문이다(만약 그런 능력이 있다면, 처음부터 실수를하지 않았을 것이다).

Just one of a number of projects currently utilizing OpenAI’s CLIP framework – the heart of DALL-E 2 and Stable Diffusion – for semantic segmentation. Source: https://openaccess.thecvf.com/content/CVPR2022/papers/Wang_CRIS_CLIP-Driven_Referring_Image_Segmentation_CVPR_2022_paper.pdf

‘또 다른 질문은,’ Ling은 제안한다. ‘오클루전된 인간 이미지를 훈련 중에 생성 모델에 제공하는 것만으로 충분할까? 모델 아키텍처의 보완적인 설계 없이 오클루전된 사람 인스턴스 분할의 문제를 완화할 수 있을까? 그것은 쉽게 대답할 수 없는 질문이다. 텍스트-이미지 생성 모델 훈련 중에 인스턴스 수준의 지침(인스턴스 마스크와 같은 인스턴스 수준 레이블을 통해)을 제공하는 방법을 보는 것은 확실히 흥미로울 것이다.’