인공지능

MagicDance: 현실적인 인간 댄스 비디오 생성

컴퓨터 비전은 AI 산업에서 가장 논의되는 분야 중 하나로, 다양한 실시간 작업에 걸쳐서 잠재적인 응용 프로그램을 가지고 있습니다. 최근 몇 년 동안, 컴퓨터 비전 프레임워크는 빠르게 발전하여, 현대적인 모델이 실시간 시나리오에서 얼굴 특징, 객체, 그리고 더 많은 것을 분석할 수 있게 되었습니다. 이러한 능력에도 불구하고, 인간 동작 전송은 컴퓨터 비전 모델에 대한 형idable한 도전으로 남아 있습니다. 이 작업은 소스 이미지 또는 비디오에서 타겟 이미지 또는 비디오로 얼굴 및 몸 동작을 재지정하는 것을 포함합니다. 인간 동작 전송은 이미지 또는 비디오 스타일링, 멀티미디어 콘텐츠 편집, 디지털 인간 합성, 그리고 thậm chí 지각 기반 프레임워크를 위한 데이터 생성을 위한 컴퓨터 비전 모델에서 널리 사용됩니다.

이 기사에서, 우리는 MagicDance에 초점을 맞추고 있습니다. MagicDance는 인간 동작 전송을 혁신하기 위해 설계된 확산 기반 모델입니다. MagicDance 프레임워크는 특히 2D 인간 얼굴 표현과 동작을 도전적인 인간 댄스 비디오에 전송하는 것을 목표로 합니다. 그 목표는 원래의 정체성을 유지하면서 특정 타겟 정체성을 위한 새로운 포즈 시퀸스 구동 댄스 비디오를 생성하는 것입니다. MagicDance 프레임워크는 인간 동작 해제와 피부 톤, 얼굴 표현, 의류와 같은 외모 요인에 초점을 맞춘 2단계 훈련 전략을 사용합니다. 우리는 MagicDance 프레임워크, 그 구조, 기능, 그리고 다른 최첨단 인간 동작 전송 프레임워크와 비교한 성능을 탐구할 것입니다.,让我們 시작해 보겠습니다.

MagicDance : 현실적인 인간 동작 전송

위에서 언급한 대로, 인간 동작 전송은 컴퓨터 비전 작업 중 가장 복잡한 작업 중 하나입니다. 그것은 소스 이미지 또는 비디오에서 타겟 이미지 또는 비디오로 인간 동작과 표현을 전송하는 데涉及된 복잡성 때문입니다. 전통적으로, 컴퓨터 비전 프레임워크는 타겟 데이터셋에서 얼굴 표현과 몸 포즈를 위한 작업 특정 생성 모델을 훈련함으로써 인간 동작 전송을 달성했습니다. 이러한 생성 모델은 GAN 또는 생성적 적대적 네트워크를 포함합니다. 생성 모델을 훈련하고 사용하면 어떤 경우에는 만족할 만한 결과를 제공하지만, 일반적으로 두 가지 주요 제한 사항이 있습니다.

- 그들은 이미지 워핑 구성 요소를 많이 의존하기 때문에, 종종 소스 이미지에서 보이지 않는 몸 부분을 보간하는 데 어려움을 겪습니다. 이것은 관점의 변화 또는 자체 오clusion으로 인해 발생할 수 있습니다.

- 그들은 외부에서 소스된 이미지에 일반화할 수 없기 때문에, 특히 실시간 시나리오에서 그들의 응용 프로그램이 제한됩니다.

현대 확산 모델은 다양한 조건에서 예외적인 이미지 생성 능력을展示했습니다. 확산 모델은 웹 규모의 이미지 데이터셋에서 학습함으로써, 비디오 생성 및 이미지 inpainting과 같은 다운스트림 작업에서 강력한 시각을 제공할 수 있습니다. 그들의 능력으로 인해, 확산 모델은 인간 동작 전송 작업에 이상적인 선택일 수 있습니다. 확산 모델은 인간 동작 전송에 구현할 수 있지만, 생성된 콘텐츠의 품질, 정체성 보존, 또는 모델 설계 및 훈련 전략의 제한으로 인해 시간적 불일치와 같은 일부 제한 사항이 있습니다. 또한, 확산 기반 모델은 GAN 프레임워크와 비교하여 일반화 가능성에서 знач적인 이점을 보여주지 않습니다.

확산 및 GAN 기반 프레임워크에서 인간 동작 전송 작업에서 발생하는 장애를 극복하기 위해, 개발자들은 MagicDance를 도입했습니다. MagicDance는 확산 프레임워크의 잠재력을 인간 동작 전송에 활용하도록 설계된 새로운 프레임워크입니다. MagicDance는 이전에 없는 정체성 보존, 우수한 시각적 품질, 및 도메인 일반화 가능성을 제공합니다. MagicDance 프레임워크의 핵심 개념은 문제를 두 가지 단계로 나누는 것입니다. 외모 제어와 동작 제어, 두 가지 능력은 이미지 확산 프레임워크가 정확한 동작 전송 출력을 제공하기 위해 필요한 것입니다.

위의 그림은 MagicDance 프레임워크의 개요를 제공하며, MagicDance 프레임워크가 안정적인 확산 모델을 사용하고, 외모 제어 모델 및 포즈 제어 네트워크와 같은 두 가지 추가 구성 요소를 배포한다는 것을 알 수 있습니다. 외모 제어 모델은 참조 이미지에서 안정적인 확산 모델에 대한 외모 지침을 제공하는 반면, 포즈 제어 네트워크는 조건부 이미지 또는 비디오에서 확산 모델에 대한 표현/포즈 지침을 제공합니다. 프레임워크는 또한 이러한 하위 모듈을 효과적으로 학습하기 위해 다단계 훈련 전략을 사용합니다.

요약하면, MagicDance 프레임워크는

- 외모 해제 및 포즈 제어를 포함한 새로운 및 효과적인 프레임워크입니다.

- MagicDance 프레임워크는 포즈 조건 입력 및 참조 이미지 또는 비디오의 제어하에 현실적인 인간 얼굴 표현 및 인간 동작을 생성할 수 있습니다.

- MagicDance 프레임워크는 안정적인 확산 UNet 프레임워크에 대한 정확한 지침을 제공하는 다중 소스 주의 모듈을 도입하여 외모 일관성 있는 인간 콘텐츠를 생성하도록 설계되었습니다.

- MagicDance 프레임워크는 안정적인 확산 프레임워크의 편리한 확장 또는 플러그인으로 사용할 수 있으며, 추가적인 매개변수 미세 조정을 요구하지 않기 때문에 기존 모델 가중치를 호환합니다.

또한, MagicDance 프레임워크는 외모 및 동작 일반화 모두에서 예외적인 일반화 능력을 보여줍니다.

- 외모 일반화 : MagicDance 프레임워크는 다양한 외모를 생성하는 능력에서 우수한 능력을 보여줍니다.

- 동작 일반화 : MagicDance 프레임워크는 또한 다양한 동작을 생성할 수 있는 능력을 가지고 있습니다.

MagicDance : 목표 및 구조

실제 인간 또는 스타일화된 이미지의 참조 이미지가 주어졌을 때, MagicDance 프레임워크의 주요 목표는 입력 및 포즈 입력 {P, F}에 조건부된 출력 이미지를 생성하는 것입니다. 여기서 P는 인간 포즈 스켈레톤을 나타내고, F는 얼굴 랜드마크를 나타냅니다. 생성된 출력 이미지는 참조 이미지의 외모 및 정체성을 유지하면서, 포즈 및 표현을 정의하는 포즈 입력을 유지해야 합니다.

구조

훈련 중, MagicDance 프레임워크는 동일한 참조 비디오에서 참조 이미지 및 포즈 입력을 사용하여 지면 진실을 재구성하는 프레임 재구성 작업으로 훈련됩니다. 테스트 중에 동작 전송을 달성하기 위해, 포즈 입력 및 참조 이미지는 다른 소스에서 가져옵니다.

MagicDance 프레임워크의 전체 구조는 4가지 범주로 나눌 수 있습니다. 예비 단계, 외모 제어 사전 훈련, 외모 분리 포즈 제어, 및 동작 모듈입니다.

예비 단계

잠재 확산 모델 또는 LDM은 고유하게 설계된 확산 모델로, 오토인코더의 사용을 통해 잠재 공간에서 작동하며, 안정적인 확산 프레임워크는 이러한 LDM의 주목할 만한 예입니다. 안정적인 확산 프레임워크는 벡터 양자화-변분 오토인코더 및 시간 U-Net 아키텍처를 사용합니다. 안정적인 확산 모델은 텍스트 입력을 처리하기 위해 CLIP 기반 트랜스포머를 사용하여 텍스트 입력을 임베딩으로 변환합니다. 안정적인 확산 프레임워크의 훈련 단계는 모델을 텍스트 조건 및 입력 이미지와 노출시키고, 이미지를 잠재 표현으로 인코딩하고, 미리 정의된 확산 단계 시퀀스를 적용합니다. 결과 시퀀스는 표준 정규 분포를 제공하는 노이즈가 있는 잠재 표현을 제공합니다.

외모 제어 사전 훈련

원래 ControlNet 프레임워크의 주요 문제는 공간적으로 변하는 동작에서 외모를 일관되게 제어할 수 없다는 것입니다. 그러나 MagicDance 프레임워크의 외모 제어 사전 훈련 모듈은 외모를 제어하기 위한 보조 분기로서 설계되었습니다. 텍스트 입력에 의존하는 대신, 전체 모듈은 참조 이미지의 외모 속성에서 외모를 제어하기 위한 지침을 제공하는 데 중점을 둡니다.

외모 분리 포즈 제어

출력 이미지에서 포즈를 제어하는 간단한 해결책은 사전 훈련된 ControlNet 모델을 사전 훈련된 외모 제어 모델과 직접 통합하는 것입니다. 그러나 이러한 통합은 외모 독립적 포즈 제어에서 어려움을 겪을 수 있으며, 입력 포즈와 생성된 포즈 사이의 불일치를 초래할 수 있습니다. 이러한 불일치를 해결하기 위해, MagicDance 프레임워크는 사전 훈련된 외모 제어 모델과 함께 포즈 제어 네트워크 모델을 공동으로 미세 조정합니다.

동작 모듈

외모 분리 포즈 제어 네트워크와 외모 제어 모델이 함께 작동할 때, 정확한 이미지에서 동작 전송을 달성할 수 있습니다. 그러나 이것은 시간적 불일치를 초래할 수 있습니다. 시간적 일관성을 보장하기 위해, 프레임워크는 기본 안정적인 확산 UNet 아키텍처에 추가적인 동작 모듈을 통합합니다.

MagicDance : 사전 훈련 및 데이터셋

사전 훈련을 위해, MagicDance 프레임워크는 10초에서 15초 사이의 길이의 단일 인간이 춤추는 350개 이상의 댄스 비디오로 구성된 TikTok 데이터셋을 사용합니다. MagicDance 프레임워크는 각 비디오를 30 FPS에서 추출하고, 각 프레임에 OpenPose를 실행하여 포즈 스켈레톤, 손 포즈, 및 얼굴 랜드마크를 추론합니다.

사전 훈련을 위해, 외모 제어 모델은 64의 배치 크기에서 8개의 NVIDIA A100 GPU에서 10,000 스텝으로 사전 훈련되며, 이미지 크기는 512 x 512입니다. 이후, 외모 제어 모델과 포즈 제어 모델을 공동으로 미세 조정하여 16의 배치 크기에서 20,000 스텝으로 훈련합니다. 훈련 중, MagicDance 프레임워크는 두 개의 프레임을 임의로 샘플링하여 타겟과 참조로 사용합니다. 이미지들은 동일한 위치와 높이에서 자릅니다. 평가 중, 모델은 중앙에서 이미지들을 자릅니다.

MagicDance : 결과

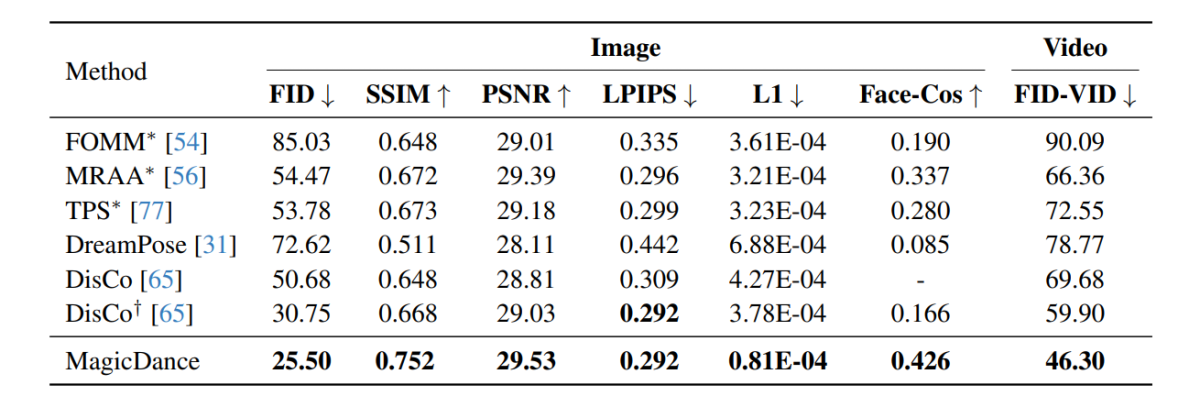

MagicDance 프레임워크에 대한 실험 결과는 다음 이미지를 통해 보여집니다. MagicDance 프레임워크는 인간 동작 전송에서 Disco 및 DreamPose와 같은 기존 프레임워크를 모든 지표에서 능가합니다. 이름 앞에 “*”가 있는 프레임워크는 타겟 이미지를 직접 입력으로 사용하며, 다른 프레임워크보다 더 많은 정보를 포함합니다.

MagicDance 프레임워크는 0.426의 얼굴 코사인 점수를 달성하여, Disco 프레임워크보다 156.62% 개선되고, DreamPose 프레임워크보다 거의 400% 증가합니다. 이러한 결과는 MagicDance 프레임워크가 정체성 정보를 보존하는 데 강력한 능력을 가지고 있으며, 성능의显著한 향상은 MagicDance 프레임워크가 기존 최첨단 방법보다 우수함을 나타냅니다.

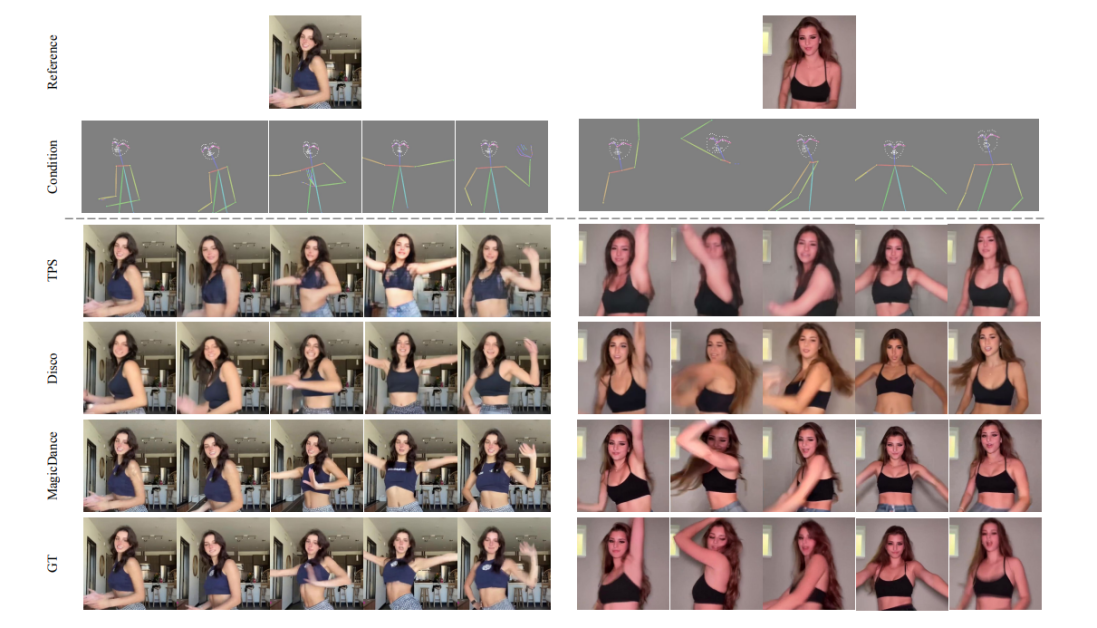

다음 그림은 MagicDance, Disco, 및 TPS 프레임워크 사이의 인간 비디오 생성 품질을 비교합니다. 결과를 관찰하면, GT, Disco, 및 TPS 프레임워크에서 생성된 결과는 일관되지 않은 인간 포즈 정체성 및 얼굴 표현을 나타냅니다.

또한, 다음 이미지는 TikTok 데이터셋에서 얼굴 표현 및 인간 포즈 전송의 시각화를 보여줍니다. MagicDance 프레임워크는 다양한 얼굴 랜드마크 및 포즈 스켈레톤 입력에서 현실적인 및 생생한 표현 및 동작을 생성할 수 있으며, 참조 입력 이미지의 정체성 정보를 정확하게 보존합니다.

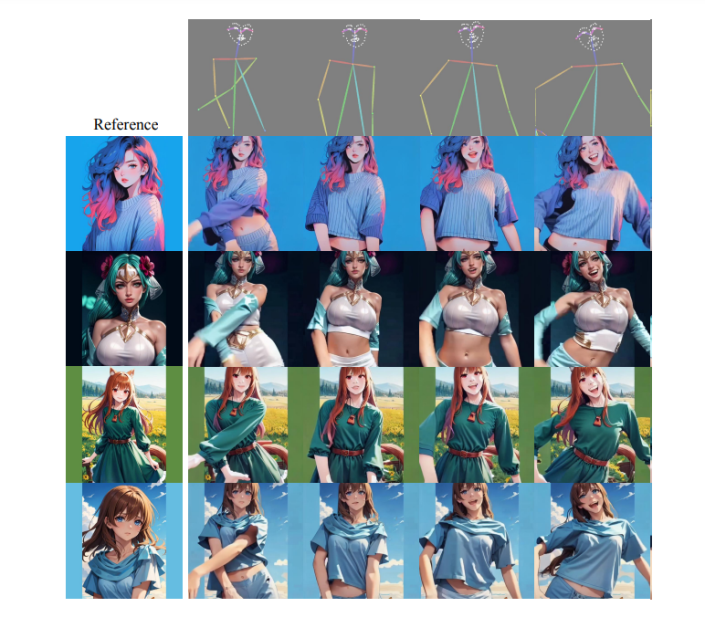

MagicDance 프레임워크는 또한 보이지 않는 포즈 및 스타일의 외부 참조 이미지에 대한 예외적인 일반화 능력을 보여줍니다. 이러한 결과는 다음 이미지를 통해 보여집니다.

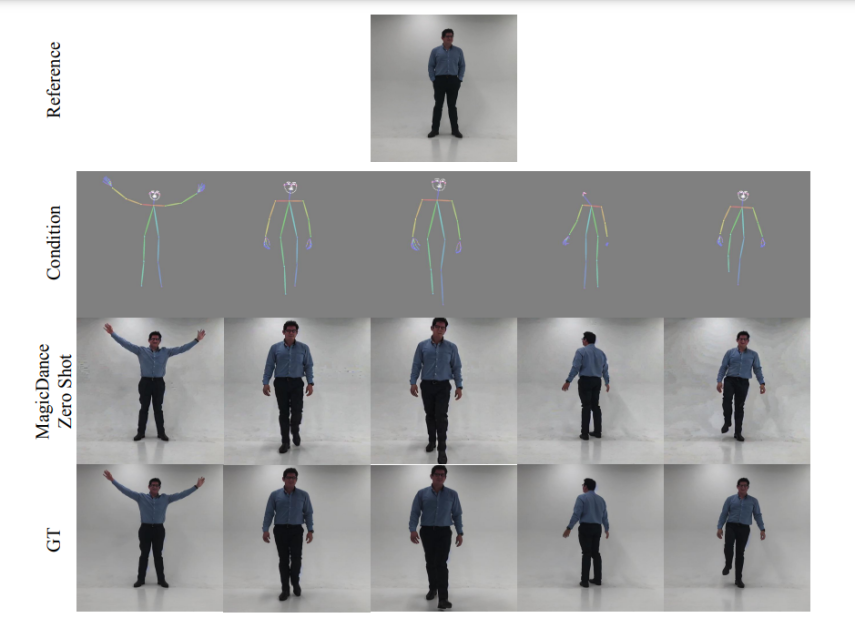

다음 이미지는 MagicDance 프레임워크의 얼굴 표현 전송 및 제로샷 인간 동작의 시각화 능력을 보여줍니다. MagicDance 프레임워크는 야생 인간 동작에 완벽하게 일반화됩니다.

MagicDance : 제한 사항

OpenPose는 MagicDance 프레임워크의 중요한 구성 요소입니다. 그것은 포즈 제어에 중요한 역할을 하며, 생성된 이미지의 품질과 시간적 일관성을 크게影响합니다. 그러나 MagicDance 프레임워크는 여전히 부분적으로 보이는 객체 또는 빠른 동작을 가진 이미지에서 얼굴 랜드마크 및 포즈 스켈레톤을 정확하게 감지하는 데 어려움을 겪을 수 있습니다. 이러한 문제는 생성된 이미지에 아티팩트를 초래할 수 있습니다.

결론

이 기사에서, 우리는 MagicDance에 대해 논의했습니다. MagicDance는 인간 동작 전송을 혁신하기 위해 설계된 확산 기반 모델입니다. MagicDance 프레임워크는 2D 인간 얼굴 표현 및 동작을 도전적인 인간 댄스 비디오에 전송하도록 설계되었습니다. 그 목표는 원래의 정체성을 유지하면서 특정 타겟 정체성을 위한 새로운 포즈 시퀸스 구동 댄스 비디오를 생성하는 것입니다. MagicDance 프레임워크는 인간 동작 해제 및 피부 톤, 얼굴 표현, 의류와 같은 외모 요인에 초점을 맞춘 2단계 훈련 전략을 사용합니다. MagicDance는 새로운 접근 방식으로 현실적인 인간 비디오 생성을 위한 얼굴 및 동작 표현 전송을 제공하며, 일관된 야생 애니메이션 생성을 ermög합니다. MagicDance 프레임워크는 또한 복잡한 동작 시퀸스 및 다양한 인간 정체성에 대한 예외적인 일반화 능력을 보여줍니다.

MagicDance는 AI 지원 동작 전송 및 비디오 생성 분야에서 선도적인 위치를 차지합니다.