파트너십

인피네온 테크놀로지스와 d-매트릭스, 저지연 AI 인프라에 협력

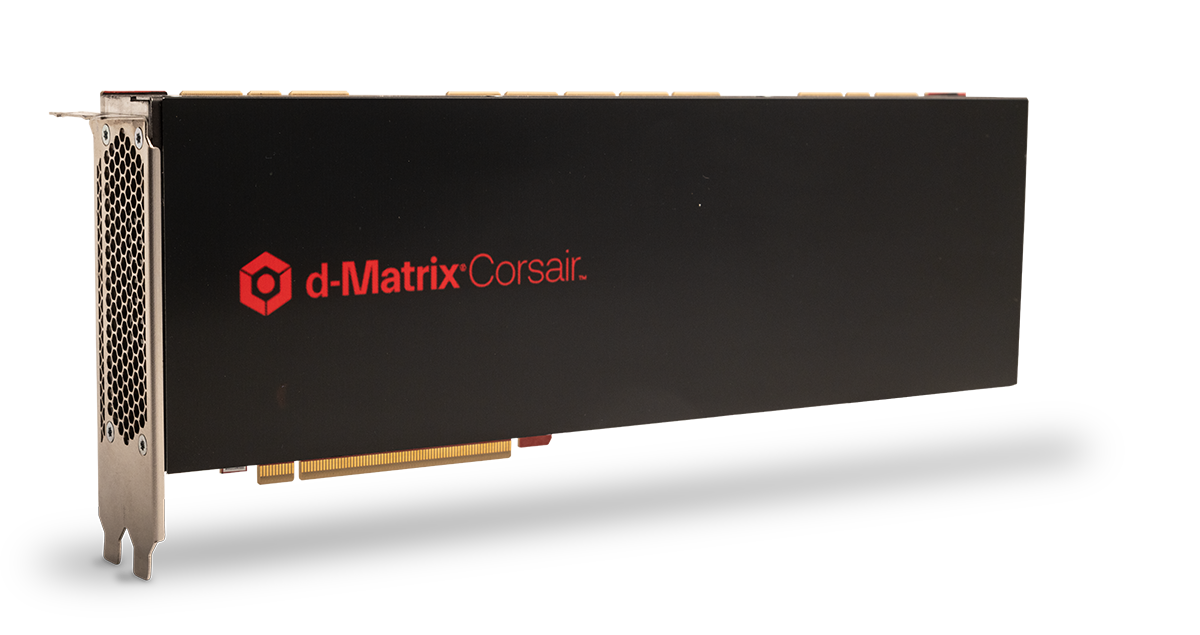

인피네온 테크놀로지스는 협력을 발표했으며, 이는 현대 데이터 센터에서 사용되는 AI 추론 시스템의 성능과 에너지 효율성을 개선하기 위한 d-매트릭스와의 협력입니다. 이 협력은 d-매트릭스의 코르세어 AI 추론 가속기 플랫폼과 인피네온의 옵티모스 듀얼 페이즈 전원 모듈을 중심으로 진행되며, 이는 상호작용형 AI 워크로드를 위한 고밀도 컴퓨팅 환경을 지원하기 위한 것입니다.

이 발표는 AI 하드웨어 산업 내에서 증가하고 있는 변화를 강조합니다. 최근 몇 년 동안의 인프라 붐은 주로 점점 더 큰 AI 모델을 훈련하는 데 중점을 두었지만, 산업은 이제 빠르게 추론으로 확장되고 있습니다. 즉, 챗봇, 에이전트형 AI 시스템, 조종사, 검색, 금융 분석, 의료 의사 결정 지원과 같은 실제 응용 프로그램에서 모델을 실행하는 과정입니다. 이러한 워크로드는 하드웨어에 대해 대기 시간, 응답성, 전력 소비와 관련하여 다른 요구를 가합니다.

AI 추론이 주요 하드웨어 전투가 되는 이유

AI 추론은 대화형 AI 시스템이 밀리초 단위의 응답을 요구하기 때문에 AI 인프라 시장에서 가장 빠르게 성장하는 부문 중 하나로 나타났습니다. d-매트릭스는 이러한 워크로드를 위해 코르세어를 특별히 위치시켰으며, 대규모 언어 모델과 AI 에이전트를 위한 초저지연 및 에너지 효율적인 추론을 강조합니다.

d-매트릭스에 따르면, 코르세어는 디지털 인-메모리 컴퓨팅 아키텍처로 설계되었으며, 이는 생성형 AI 추론을 느리게 하는 메모리 병목 현상을 줄이는 것을 목표로 합니다. 이 회사는 이 플랫폼이 전통적인 GPU 중심의 추론 시스템과 비교하여 대기 시간을 크게 줄이고 처리량을 개선할 수 있다고 주장합니다. 특히 대화형 응용 프로그램에서 그렇습니다.

인피네온과의 협력은 또 다른 중요하게 증가하는 도전을 해결합니다. 즉, 전원 공급입니다.

AI 서버가 밀도에 따라 증가함에 따라, 가속기에게 효율적으로 전원을 공급하는 것은 인프라 확장의 제한 요소가 되었습니다. 인피네온의 OptiMOS TDM2254xx 모듈은 전기적 손실을 줄이고 컴팩트한 서버 시스템 내에서 전력 밀도를 개선하는 데 도움이 되는 수직 전원 공급 아키텍처를 위한 것입니다.

실시간 AI 시스템으로의 전환

이 회사는 협력을 “대화형 AI”의 부상과 관련시켰습니다. 여기서 추론 시스템은 매우 낮은 지연으로 지속적으로 출력을 생성해야 합니다. 이것은 대화형 AI, AI 에이전트, 실시간 추론 시스템 및 대규모 언어 모델에서 빠른 토큰 생성을 요구하는 응용 프로그램을 포함합니다.

d-매트릭스 설립자이자 CEO인 시드 셰스는 코르세어의 아키텍처가 2 밀리초 미만의 토큰 지연을 위해 특별히 설계되었으며, 이는 기업이 AI 시스템을 실험에서 고객에게 직접 노출시키는 환경으로 이동함에 따라 점점 더 중요한 지표가 되고 있다고 말했습니다.

더 넓은 AI 산업은 또한 추론 인프라가 훈련 인프라와 다르게 발전할 수 있다는 것을 인식하기 시작했습니다. 생성형 AI의 첫 번째 확장 단계에서 GPU 클러스터가 지배적이었지만, 추론은 원시 컴퓨팅 능력만큼 메모리 대역폭, 대기 시간, 네트워킹 및 에너지 효율성을 최적화된 아키텍처를 보상합니다.

전력 효율성이 AI 확장의 핵심으로 부상

하이퍼스케일러와 AI 클라우드 제공업체가 직면하는 가장 큰 제약 중 하나는 전기 수요입니다. AI 추론 워크로드는 하루에 수백만 개의 요청을 처리할 수 있으므로 운영 효율성이 배포 비용에 결정적입니다.

인피네온은 실리콘, 실리콘 카바이드(SiC), 갈륨 질화물(GaN)을 기반으로 하는 반도체 기술을 통해 AI 인프라 내에서 자신의 위치를 확대해 왔습니다. 이 회사는 점점 더 AI 가속기와 서버 인프라 아래의 전원 공급 레이어를 공급하는 데 집중하고 있습니다.

d-매트릭스와의 협력은 반도체 회사들이 AI 가속기 스타트업과 더 긴밀하게 통합되는 방식에 대해 반영합니다. 산업은 기존의 GPU 중심 아키텍처에 대한 대안을 찾고 있습니다.

AI 인프라가 전통적인 GPU를 넘어서 확장

이 협력은 AI 하드웨어에서 더广泛한 실험의 물결 도중에도 도착했습니다. 점점 더 많은 스타트업이 추론, 메모리 중심 컴퓨팅 또는 AI 네트워킹을 위한 전문 가속기를 개발하고 있습니다.

d-매트릭스는 컴퓨팅-인-메모리 기술과 저지연 추론 시스템에 대한 강조를 통해 차별화되었습니다. 이는 생성형 AI를 위한 것입니다. 이 회사는 또한 가속기 칩만이 아닌, 최근에는 네트워킹, 구성 가능한 인프라 및 추론 클러스터를 위한 전체 시스템 최적화를 강조했습니다.

AI 응용 프로그램이 점점 더 에이전트형이고 대화형이 되는 경우, 인프라 제공업체는 원시 처리 능력만큼 지연을 줄이고 에너지 소비를 낮추고 전체 데이터 센터 스택에서 시스템 수준의 효율성을 개선하는 데 더 큰 중점을 두어야 합니다.