Anderson의 관점

시각적 유사성을 AI에 적용하기

현재의 AI 모델은 지구의 층과 복숭의 유사성과 같은 ‘관계적’ 이미지 유사성을 인식하지 못하며, 인간이 이미지를 인식하는 방식의 핵심적인 측면을 놓치고 있습니다.

컴퓨터 비전 모델은 많지만, 비교 시스템의 현재 세대는 거의 또는 전혀 상상력이 없습니다. 1960년대 클래식 노래 Windmills of Your Mind의 가사를 생각해 보십시오:

달이 돌아가는 회전목마처럼, 달의 얼굴을 돌아가는 시계 바늘처럼

그리고 세계는 조용히 우주에서 회전하는 사과처럼

이러한 종류의 비교는 인간에게 의미 있는 시적 은유의 영역을 대표하며, 예술적 표현을 넘어서 인간이 지각 시스템을 발달시키는 방식과 관련이 있습니다. 객체 도메인을 생성함으로써 우리는 시각적 유사성에 대한 능력을 개발하여, 예를 들어, 복숭과 지구의 단면도 또는 커피 나선과 은하 지支와 같은 프랙탈 재귀는 우리가 유사하다고 인식합니다.

이 방식으로 우리는 明显하게 연결되지 않은 객체와 객체 유형 사이의 연결고리를 유추할 수 있으며, 시스템을 추론할 수 있습니다(예: 중력, 운동량 및 표면 응집력). 이러한 시스템은 다양한 도메인과 규모에서 적용될 수 있습니다.

것들을 보는 것

最新의 이미지 비교 AI 시스템, 즉 LPIPS와 DINO는 인간의 피드백으로 학습되었지만, 여전히 문자적인 표면 비교만 수행합니다.

무작위한 객체에서 얼굴을 찾는 능력, 즉 파레이돌리아는 인간이 개발하는 시각적 유사성 메커니즘을 나타내지 않습니다. 이는 얼굴을 찾는 알고리즘이 낮은 수준의 얼굴 구조 특징을 사용하여 때때로 무작위한 객체와 일치하기 때문입니다:

얼굴 인식의 잘못된 양성 예시 ‘Faces with Things’ 데이터 세트. 출처

기계가 정말로 우리의 상상력 능력을 개발하여 도메인 간의 시각적 유사성을 인식할 수 있는지 여부를 결정하기 위해, 미국의 연구자들은 연구를 수행했습니다. 관계적 시각적 유사성을 중심으로, 추상적인 관계를 형성하기 위해 설계된 새로운 데이터 세트를 구축하고 훈련했습니다:

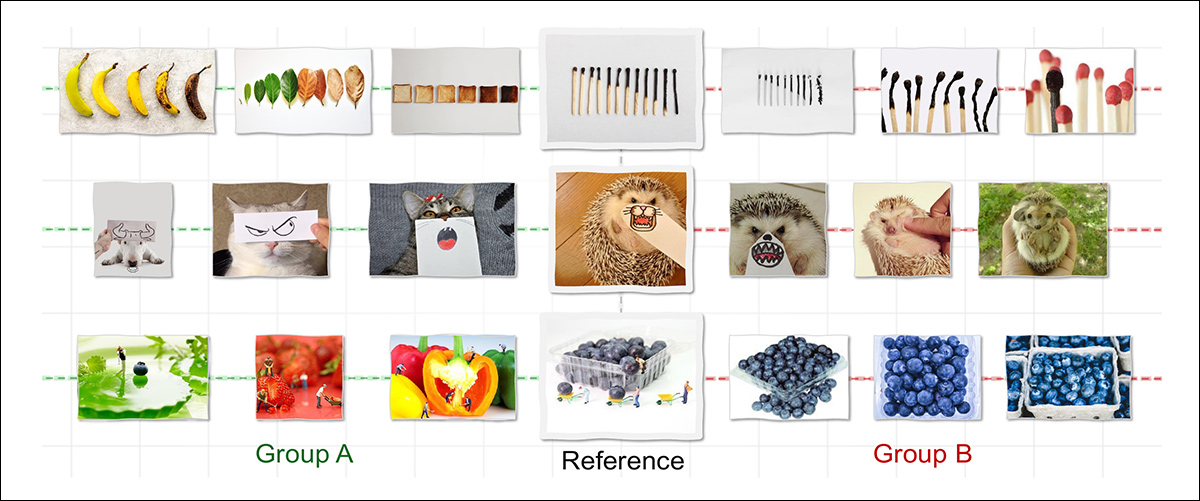

대부분의 AI 모델은 이미지에 표면 특征이共通할 때만 유사성을 인식합니다. 이는 참조 이미지와 B 그룹만 연결하는 이유입니다. 그러나 인간은 A 그룹도 유사하다고 인식합니다. 이는 이미지들이 동일한 논리를 따르기 때문입니다. 새로운 연구는 이러한 구조적 또는 관계적 유사성을 재현하려고 합니다.. 출처: https://arxiv.org/pdf/2512.07833

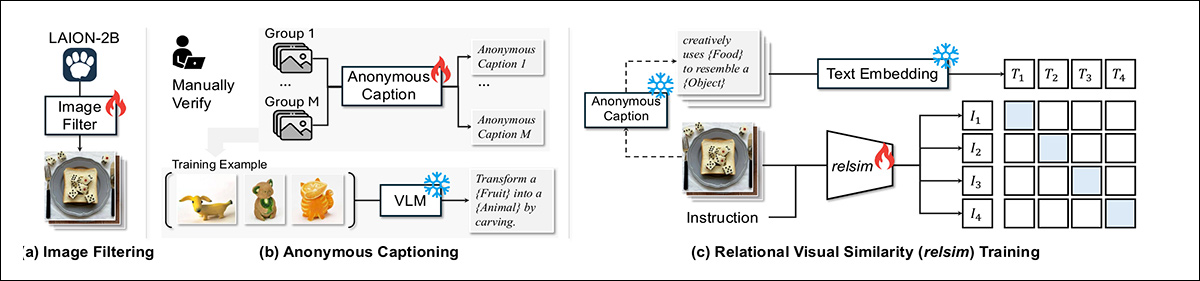

데이터 세트에 대한 캡션 시스템은 기계 학습 시스템이 특정한 지역적 세부 사항보다는 기본 특징에 집중하도록 설계되었습니다:

저자의 ‘relsim’ 측정에 기여하는 예측된 ‘ 匿名’ 캡션.

수집된 컬렉션과 캡션 스타일은 저자의 새로운 제안된 측정인 relsim을 구동하며, 저자는 이를 세부 튜닝하여 시각-언어 모델(VLM)로 사용했습니다.

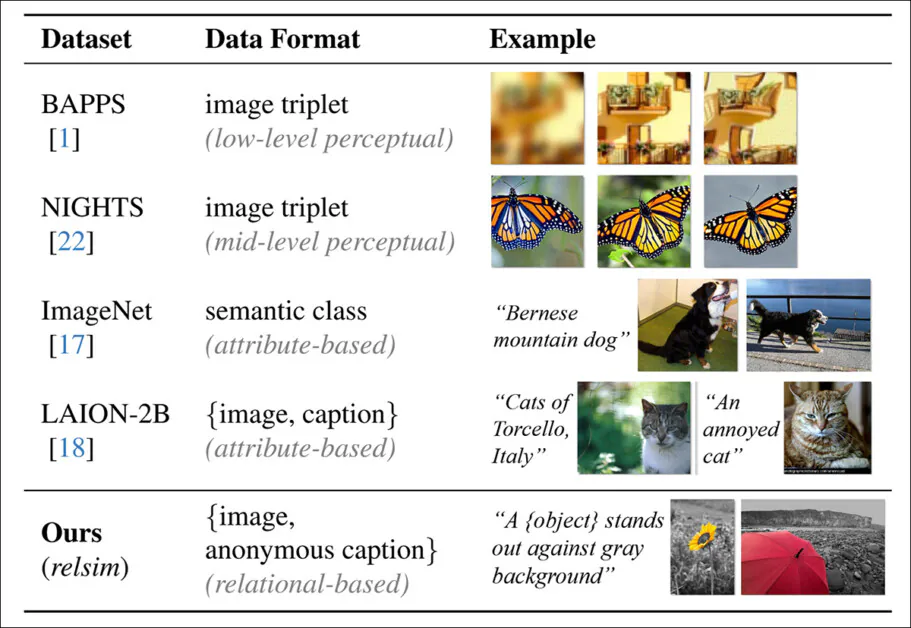

일반적인 데이터 세트의 캡션 스타일과 relsim 접근법의 비교. 일반적인 데이터 세트는 속성 유사성을 중점으로 하며, relsim 접근법은 관계적 유사성을 강조합니다.

새로운 접근 방식은 인지 과학의 방법론, 특히 Dedre Gentner의 구조 매핑 이론(유사성에 대한 연구)와 Amos Tversky의 정의를 사용합니다.

관련 프로젝트 웹사이트의 관계적 유사성 예시. 출처

저자는 다음과 같이 말합니다:

‘인간은 속성 유사성을 감각적으로 처리하지만, 관계적 유사성은 개념적 추상화가 필요하며, 이는 언어 또는 이전 지식에 의해 지원됩니다. 이는 관계적 유사성을 인식하기 위해 먼저 이미지에 대한 이해, 지식의 적용, 그리고 기본 구조의 추상화가 필요하다는 것을 시사합니다.’

새로운 논문은 관계적 시각적 유사성으로 제목이 붙여졌으며, 프로젝트 웹사이트가 있습니다(본 문서의 끝에埋입된 비디오 참조).

방법

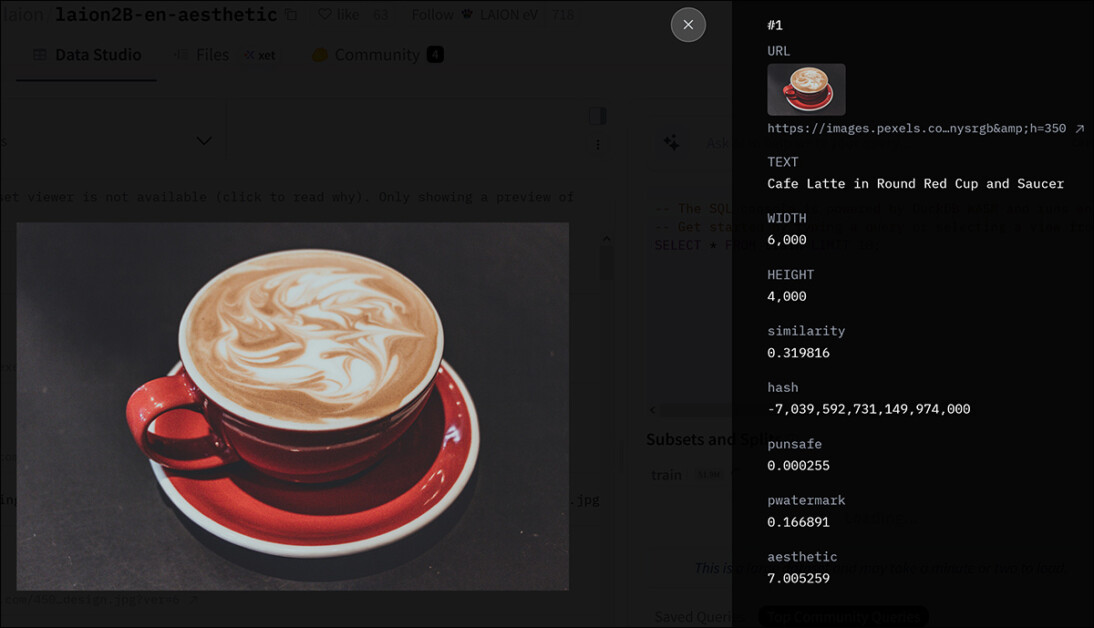

연구자들은 잘 알려진 초대형 데이터 세트 중 하나를 시작점으로 사용했습니다. LAION-2B:

LAION-2B 컬렉션의 항목 메타데이터. 출처

LAION-2B에서 114,000개의 이미지들이 유연한 관계 구조를 포함할 가능성이 있는 이미지들로 필터링되었습니다. 이는 저품질 이미지의 많은 부분이 포함된 최소로 관리된 데이터 세트에서 필터링을 수행하는 것을 의미합니다.

이 선택 과정의 파이프라인을 생성하기 위해, 저자는 Qwen2.5-VL-7B를 사용했습니다. 1,300개의 양성과 11,000개의 음성 인간 레이블 예시를 사용하여:

relsim 시스템은 3단계로 훈련됩니다. LAION-2B에서 관계적 콘텐츠를 필터링하는 단계, 각 그룹에 공유된匿名 캡션을 할당하는 단계, 그리고 대조적 손실을 사용하여 캡션과 이미지 매칭을 학습하는 단계.

논문은 다음과 같이 말합니다:

‘주석자가 다음과 같이 지시받았습니다. “이 이미지에 관계적 패턴, 논리 또는 구조를 볼 수 있습니까? 이 이미지를 생성하거나 다른 이미지에 연결하는 데 유용한 구조를 볼 수 있습니까?” 훈련된 모델은 인간의 판단과 93% 일치하며, LAION-2B에 적용하면 N = 114k개의 이미지가 관계적으로 흥미롭다고 판단됩니다.’

이미지에 관계적 레이블을 생성하기 위해, 연구자들은 Qwen 모델에 이미지 세트의 공유된 논리를 설명하도록 요청했습니다. 이는 하나의 이미지를 볼 때 어려웠지만, 여러 예시에서 기본 패턴을 보여줄 때 가능했습니다.

결과적으로 생성된 캡션은 특정 용어를 대체하기 위해 ‘{주제}’ 또는 ‘{운동 유형}’과 같은 플레이스 홀더를 사용하여 광범위하게 적용할 수 있었습니다.

인간의 검증 후, 각 캡션은 그룹의 모든 이미지와 쌍으로 묶였습니다. 500개 이상의 그룹이 모델을 훈련하기 위해 사용되었으며, 모델은 114,000개의 필터링된 이미지에 적용되어 추상적이고 관계적으로 주석이 달린 큰 샘플 세트를 생성했습니다.

데이터와 테스트

Qwen2.5-VL-7B를 사용하여 관계적 특징을 추출한 후, 모델은 LoRA를 사용하여 15,000 스텝 동안 8개의 A100 GPU로 미세 조정되었습니다. 텍스트 측면에서는 관계적 캡션이 all-MiniLM-L6-v2를 사용하여 Sentence-Transformers 라이브러리에서 임베딩되었습니다.

114,000개의 주석이 달린 이미지 데이터 세트는 100,000개의 훈련 세트와 14,000개의 평가 세트로 분할되었습니다. 시스템을 테스트하기 위해, 검색 설정이 사용되었습니다. 쿼리 이미지와 28,000개의 항목 풀에서 동일한 관계적 아이디어를 표현하는 다른 이미지를 찾는 것이 모델의任务였습니다. 검색 풀에는 14,000개의 평가 이미지와 LAION-2B에서 추가로 14,000개의 샘플이 포함되어 있었으며, 벤치마크를 위해 평가 세트에서 1,000개의 쿼리가 무작위로 선택되었습니다.

검색 품질을 평가하기 위해 GPT-4o가 사용되어 쿼리와 검색된 이미지 사이의 관계적 유사성을 0에서 10까지의 척도로 평가했습니다. 또한 사용자 선호도를 평가하기 위해 별도의 인간 연구도 수행되었습니다(아래 참조).

각 참가자는 匿名화된 쿼리 이미지와 두 개의 후보를 보여주었습니다. 하나는 제안된 방법으로 검색되었고, 다른 하나는 기준선으로 검색되었습니다. 참가자들은 쿼리와 더 관계적으로 유사한 이미지를 물어보았습니다. 또는 두 이미지가 동일하게 가까운지 물어보았습니다. 각 기준선에 대해 300개의 트리플릿이 생성되었고, 각 트리플릿은 적어도 세 명의 사람들에 의해 평가되어 약 900개의 응답을 생성했습니다.

relsim 접근법은 LPIPS, DINO, dreamsim, 및 CLIP-I를 포함한 여러 확립된 이미지-이미지 유사성 방법과 비교되었습니다. 이미지 쌍 사이의 유사성 점수를 직접 계산하는 기준선과 함께, 캡션 기반 방법도 평가되었습니다. 여기서 Qwen을 사용하여 각 이미지에 대한 匿명 또는 추상적인 캡션을 생성했습니다. 이는 검색 쿼리として 사용되었습니다.

두 개의 검색 변형이 평가되었으며, CLIP 기반 텍스트-이미지 검색(CLIP-T)이 텍스트-이미지 검색에 사용되었으며, Qwen-T가 텍스트-텍스트 검색에 사용되었습니다. 두 개의 캡션 기반 기준선 모두 원래 미세 조정되지 않은 Qwen 모델을 사용하여, 그룹 기반 훈련의 효과를 분리했습니다.

기존 메트릭과 관계적 유사성

저자들은 먼저 기존 메트릭이 관계적 유사성을 捕获할 수 있는지 테스트했습니다:

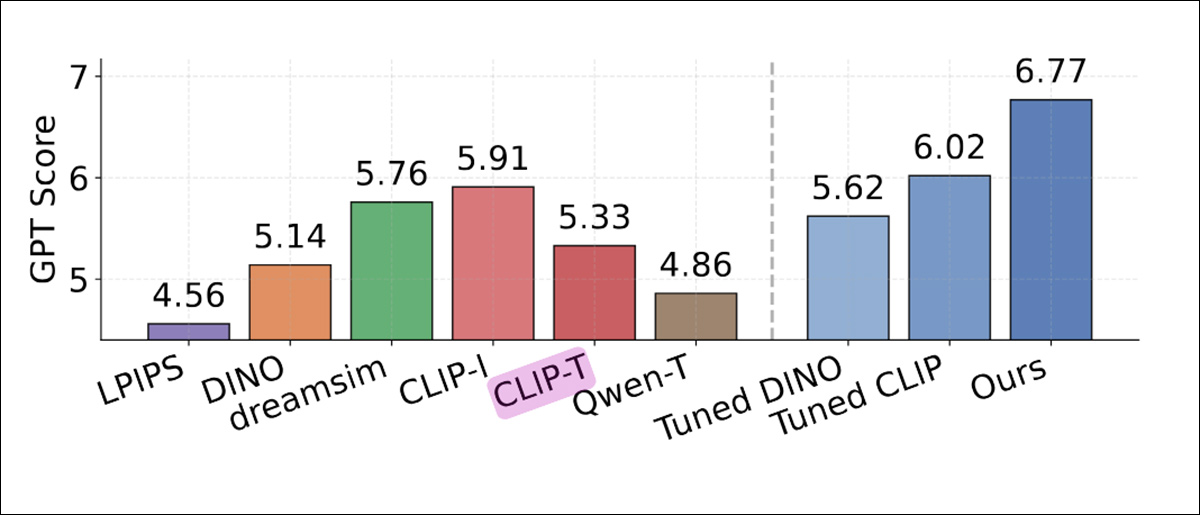

GPT-4o에 의해 평가된 검색 성능 비교. 각 방법의 평균 관계적 유사성 점수. 기존의 유사성 메트릭인 LPIPS, DINO, CLIP-I는 더 낮은 점수를 얻었으며, 캡션 기반의 기준선인 Qwen-T와 CLIP-T도 성능이 낮았습니다.最高 점수는 relsim(6.77, 가장 오른쪽의 파란색 열)에 의해 달성되었습니다. 이는 그룹 기반의 관계적 패턴에 대한 미세 조정이 GPT-4o의 평가와 일치한다는 것을 나타냅니다.

저자는 다음과 같이 말합니다:

‘[LPIPS]는純粋하게 감각적 유사성에만 집중하므로 최저 점수(4.56)를 얻습니다. [DINO]는 약간 더 좋은 성능(5.14)을 보여주지만, 이는 이미지 데이터만으로 자가 지도 학습을 통해 훈련되었기 때문입니다. [CLIP-I]는 기준선 중에서 가장 강한 결과(5.91)를 보여주지만, 이는 일부 추상화가 이미지 캡션에 존재하기 때문입니다.

‘그러나 CLIP-I는 여전히 우리의 방법보다 성능이 낮습니다. 이는 더 높은 수준의 추상화를 달성하는 것이 필요하다는 것을 시사하며, 이는 匿名 캡션에서와 같이 더 높은 수준의 추상화가 필요합니다.’

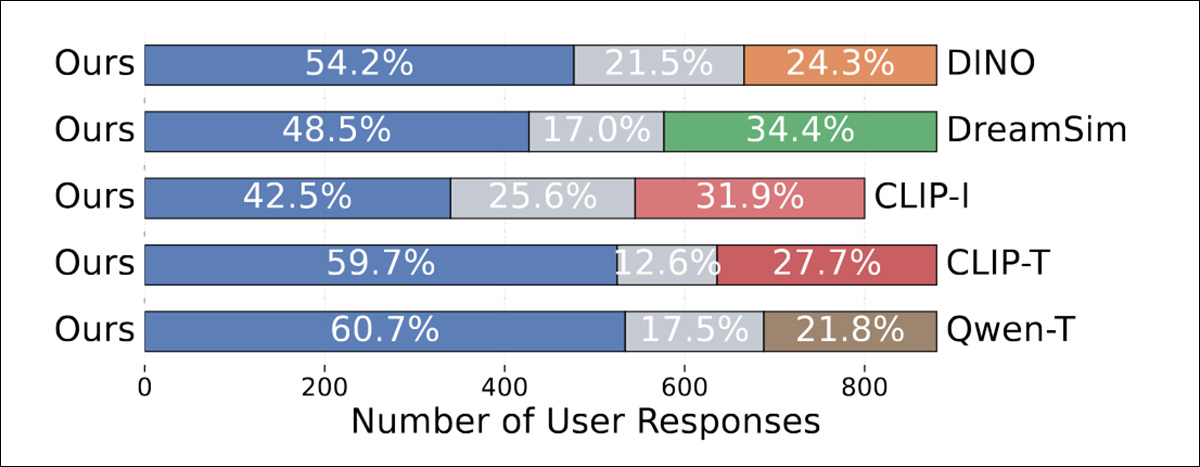

인간 연구에서, 인간은 일관되게 기준선에 대해 relsim 방법을 선호했습니다:

각 방법에 대한 GPT-4o의 관계적 유사성 점수. 표준 유사성 메트릭인 LPIPS, DINO, CLIP-I는 더 낮은 점수를 얻었으며, 캡션 기반의 변형인 Qwen-T와 CLIP-T는 약간 더 좋은 성능을 보여주었습니다. DINO와 CLIP의 미세 조정된 버전도 차이를 메우지 못했습니다.最高 점수는 6.77로, 제안된 모델이 그룹 기반의 감독을 통해 훈련된 것입니다.

저자는 다음과 같이 말합니다:

‘이것은 매우鼓舞적입니다. 이는 우리의 모델, relsim이 성공적으로 관계적으로 유사한 이미지를 검색할 수 있음을 보여주며, 또한 인간이 관계적 유사성을 인식한다는 것을 다시 한번 확인합니다. 이는 속성 유사성뿐만 아니라 관계적 유사성도 중요함을 시사합니다.’

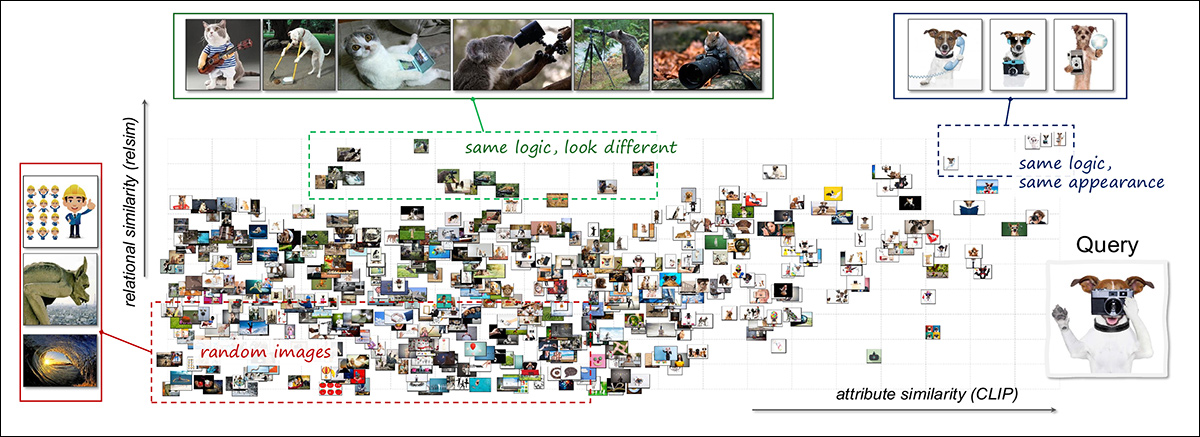

관계적 유사성과 속성 유사성이 어떻게 보완될 수 있는지 탐구하기 위해, 연구자들은 결합된 시각화 방법을 사용했습니다. 단일 쿼리 이미지(‘카메라를 잡고 있는 개’)를 3,000개의 무작위 이미지와 비교했으며, 관계적 유사성과 속성 유사성을 사용하여 유사성을 계산했습니다:

관계적 유사성 축과 속성 유사성 축을 사용한 시각적 유사성 공간의 공동 시각화. 단일 쿼리 이미지(카메라를 잡고 있는 개)를 3,000개의 다른 이미지와 비교했습니다. 결과는 관계적 유사성(수직)과 속성 유사성(수평)으로 조직되었습니다. 오른쪽 상단 영역에는 쿼리와 동일한 논리를 따르는 이미지(예: 다른 개가 도구를 사용하는 이미지)가 포함되며, 왼쪽 상단 영역에는 의미적으로 관련이 있지만 시각적으로 다른 경우(예: 다른 동물이 카메라 관련 동작을 수행하는 경우)가 포함됩니다. 대부분의 나머지 예시는 공간의 아래쪽에 클러스터링되어 약한 유사성을 반영합니다. 레이아웃은 관계적 모델과 속성 모델이 시각적 데이터의 보완적인 측면을 강조하는 것을 보여줍니다. 출처 논문에서 더 나은 해상도를 참조하십시오.

결과는 다양한 유형의 유사성에 해당하는 클러스터를 보여주었습니다. 일부 이미지는 관계적으로도 시각적으로도 유사했습니다. 다른 일부는 관계적 논리를 공유하지만 외관은 다르며, 나머지는 둘 다 없습니다.

이 분석은 두 유형의 유사성이 서로 다른 역할을 하며 결합되었을 때 더 풍부한 구조를 제공한다는 것을 시사합니다.

사용 사례

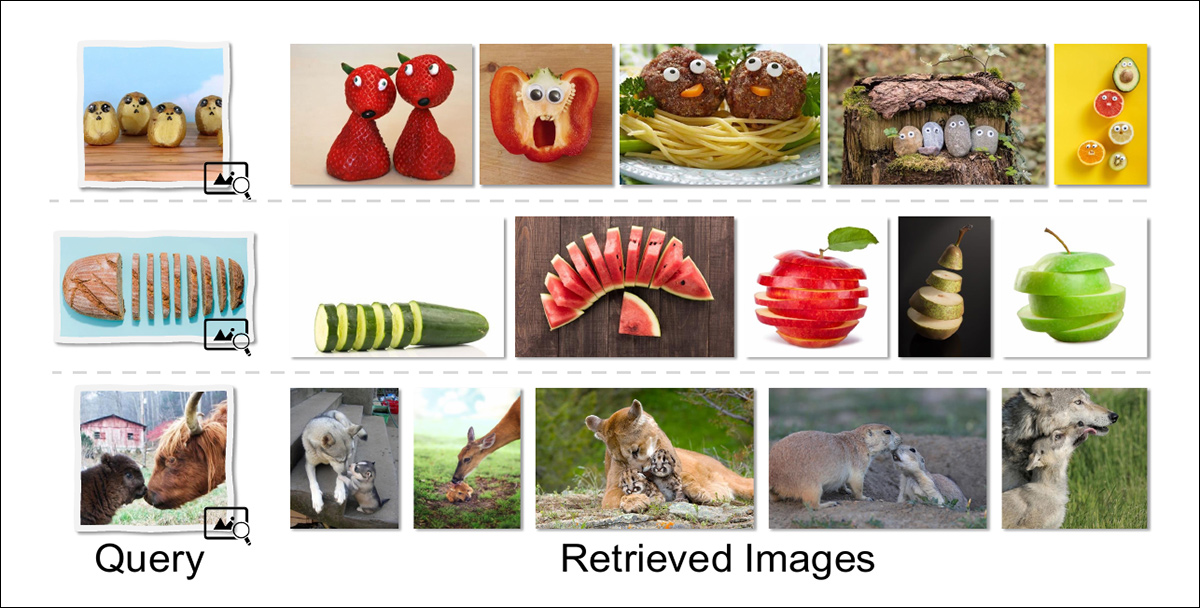

이 논문은 또한 관계적 유사성의 가능한 최종 사용 사례를 탐구합니다. 이는 인간이 세계를 보는 창의적인 방식과 더 잘 일치하는 이미지 검색을 허용합니다:

관계적 검색은 쿼리와 더 깊은 개념적 구조를 공유하는 이미지를 반환합니다. 예를 들어, 얼굴과 같은 음식을 스타일링한 이미지는 다른 인간형 음식을 검색하며, 절단된 객체는 다른 절단된 형태를 검색하며, 부모-자식 상호작용 장면은 다른 종과 구성이 다르더라도 유사한 관계적 역할을 가진 이미지를 검색합니다.

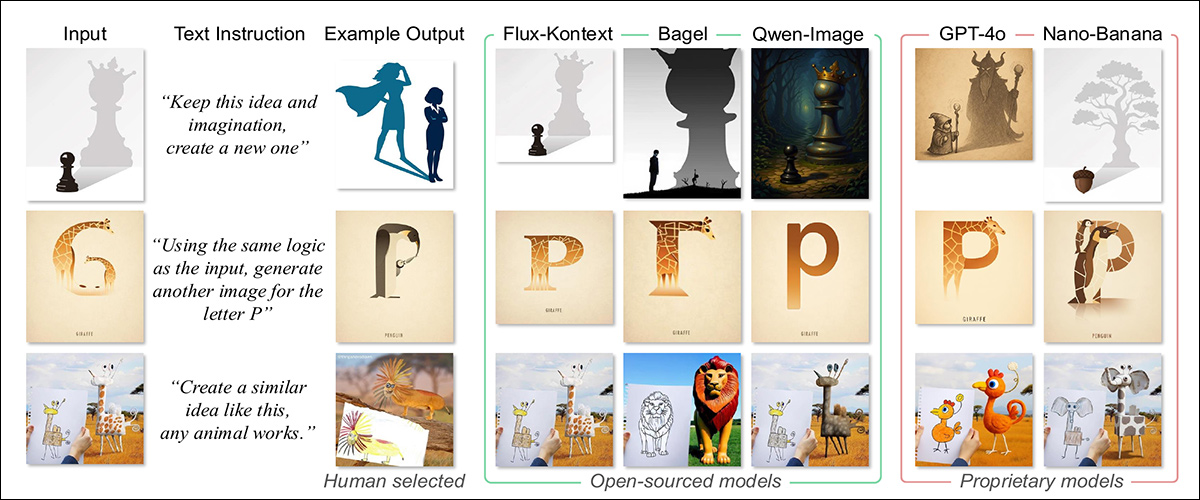

또 다른 가능성은 유사성 기반 이미지 생성입니다. 이는 관계적 구조를 사용하여 쿼리를 생성할 수 있게 해줍니다. 현재 세대의 최첨단 텍스트-이미지 모델에서 얻은 결과와의 비교에서, 이러한 접근 방식의 결과는 더 다양할 것입니다:

입력 이미지와 관계적 프롬프트가 주어졌을 때, 모델은 동일한 기본 개념을 표현하는 새로운 이미지를 생성하도록 요청받습니다. 사적인 모델은 더 충실한 유사성을 생성하여 구조적 논리를 큰 형태의 변경에도 걸쳐 유지했습니다. 오픈 소스 모델은 문자적인 또는 스타일적인 일치로 회귀하여 더 깊은 아이디어를 전달하지 못했습니다. 출력은 인간이 큐레이션한 유사성과 비교되었습니다.

결론

생성적 AI 시스템은 추상적인 표현을 포함하는 능력을 갖추면 크게 향상될 것입니다. 현재로서는, ‘분노’ 또는 ‘행복’와 같은 개념 기반 이미지를 요청하면, 데이터 세트에서 이러한 연관성이 있는 가장 인기 있는 또는 가장 많은 이미지를 반환하는 경향이 있습니다. 이는 추상화가 아니라 기억입니다.

이 원리는 생성적 글쓰기, 특히 분석적, 추측적 또는 허구적인 출력에 적용될 경우 더 유용할 것입니다.

재생을 위해 누르십시오. 출처

* A100에는 40Gb 또는 80GB의 VRAM이 있을 수 있지만, 이는 논문에서 지정되지 않습니다.

** 저자의 인용문은冗長하여 생략되었습니다.

最初에 2025년 12월 16일에 게시되었습니다.