人工知能

Mistral AI: Llama2を超える新たなベンチマークをオープンソースの領域で設定

大規模言語モデル(LLM)は、ChatGPTのような優れたパフォーマーにより、最近注目を集めています。MetaがLlamaモデルを導入したことで、オープンソースLLMへの関心が再び高まりました。目標は、GPT-4などのトップティアモデルと同等のパフォーマンスを持つ、コスト効率の高いオープンソースLLMを作成することでした。

このコスト効率と効率性の組み合わせは、研究者と開発者にとって新たな機会を提供し、自然言語処理の技術的進歩の新たな時代の幕開けとなりました。

最近、ジェネレーティブAIスタートアップは資金調達で成功を収めています。Togetherは2000万ドルを調達し、オープンソースAIを構築することを目指しています。Anthropicは4億5000万ドルを調達し、CohereはGoogle Cloudと提携し、2億7000万ドルを調達しました。

Mistral 7B: サイズと利用可能性

Mistral AIは、パリを拠点とし、GoogleのDeepMindとMetaの卒業生によって共同設立されました。彼らは最初の大規模言語モデル、Mistral 7Bを発表しました。このモデルは、GitHubから誰でも簡単にダウンロードでき、また13.4ギガバイトのトレントでも利用可能です。

このスタートアップは、製品をリリースする前に、記録的なシード資金を調達することに成功しました。Mistral AIの最初のモデルは、7億パラメータのモデルで、すべてのテストでLlama 2 13Bを上回り、Llama 1 34Bを多くの指標で上回りました。

Mistral 7Bは、Llama 2などの他のモデルと比較して、同等または優れた機能を提供しますが、計算オーバーヘッドは少ないです。GPT-4などの基礎モデルはより優れたパフォーマンスを発揮しますが、コストが高く、API経由でのみアクセス可能であるため、ユーザーフレンドリーではありません。

コーディングタスクでは、Mistral 7BはCodeLlama 7Bと互角に戦います。さらに、13.4 GBのコンパクトなサイズで、標準マシンで実行できます。

また、Mistral 7B Instructは、Hugging Faceの指示データセットに特化して調整されており、優れたパフォーマンスを発揮しています。MT-Benchでは他の7Bモデルを上回り、13Bのチャットモデルと肩を並べています。

Hugging Face Mistral 7B Example

パフォーマンスベンチマーク

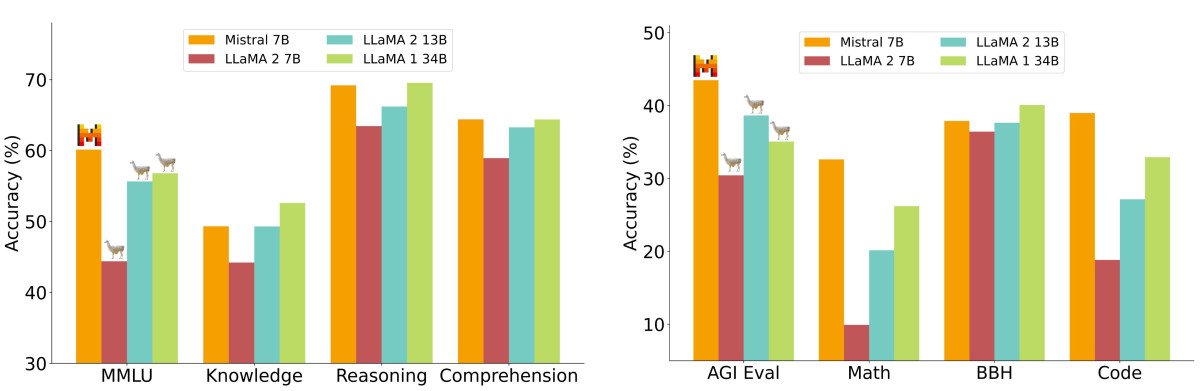

詳細なパフォーマンス分析では、Mistral 7BはLlama 2ファミリーモデルと比較されました。結果は明確でした。Mistral 7Bは、すべてのベンチマークでLlama 2 13Bを大幅に上回りました。実際、Llama 34Bのパフォーマンスに匹敵し、特にコードと推論のベンチマークで優れています。

ベンチマークは、コモンセンス推論、世界の知識、読解力、数学、コードなど、複数のカテゴリに分けられました。特に注目すべき観察は、Mistral 7Bのコストパフォーマンスメトリック、つまり「等価モデルサイズ」でした。推論と理解の分野で、Mistral 7Bは、3倍のサイズのLlama 2モデルと同等のパフォーマンスを示し、メモリの節約とスループットの向上を示唆しました。ただし、知識のベンチマークでは、Mistral 7BはLlama 2 13Bと密接に一致しましたが、これはパラメーターの制限による知識の圧縮の影響である可能性があります。

何がMistral 7Bモデルを他の言語モデルと比較して優れているのでしょうか?

アテンションメカニズムの簡素化

アテンションメカニズムの細かい点は技術的ですが、その基本的な考え方は比較的簡単です。書籍を読み、重要な文章を強調することを想像してみてください。これは、アテンションメカニズムが「強調」またはシーケンス内の特定のデータポイントに重要性を付ける方法に似ています。

言語モデルでは、これらのメカニズムにより、モデルは入力データの最も関連性の高い部分に焦点を当て、出力が一貫性があり、コンテキストに正確であることを保証します。

標準的なトランスフォーマーでは、アテンションスコアは次の式で計算されます。

この式には、QとKの行列乗算という重要なステップが含まれます。この課題は、シーケンスの長さが増加すると、両方の行列も同様に拡大し、計算コストの高いプロセスになるためです。この拡張性の問題は、標準的なトランスフォーマーが遅い原因の1つです、特に長いシーケンスを扱う場合。

マルチクエリーアテンション(MQA)は、1つの「キー値」ヘッドを使用して高速化しますが、品質を犠牲にします。では、MQAの高速性とマルチヘッドアテンションの品質を組み合わせることはできないのでしょうか。那はグループ化クエリーアテンション(GQA)が登場する場所です。

グループ化クエリーアテンション(GQA)

GQAは、妥協点の解決策です。1つまたは複数の「キー値」ヘッドを使用するのではなく、それらをグループ化します。この方法で、GQAはマルチヘッドアテンションに近いパフォーマンスを実現しながら、MQAの高速性を維持します。Mistralのようなモデルでは、これは品質を妥協することなく効率的なパフォーマンスを意味します。

スライディングウィンドウアテンション(SWA)

スライディングウィンドウは、シーケンスのアテンションを処理する別の方法です。この方法では、シーケンス内の各トークンの周囲に固定サイズのアテンションウィンドウを使用します。複数の層がこのウィンドウアテンションを積み重ねることで、上位層は最終的に入力全体の情報を包含する、より広い視野を得ることになります。このメカニズムは、コンボリューショナルニューラルネットワーク(CNN)で見られる受容野に類似しています。

一方、Longformerモデルの「ディレイテッドスライディングウィンドウアテンション」は、スライディングウィンドウ法と概念的に似ていますが、行列のいくつかの対角線のみを計算します。この変更により、メモリ使用量は二乗ではなく線形に増加し、長いシーケンスを扱う場合に効率的な方法になります。

Mistral AIの透明性 vs. 分散化の安全性に関する懸念

Mistral AIは、声明で透明性を強調しました。「トリックはありません。独自のデータはありません。」しかし、現在利用可能な唯一のモデルである「Mistral-7B-v0.1」は、事前トレーニングされたベースモデルであるため、モデレーションなしで任意のクエリに対して応答を生成できます。これにより、潜在的な安全性に関する懸念が生じます。GPTやLlamaのようなモデルには、応答するタイミングを判断するメカニズムがありますが、Mistralの完全に分散化された性質は、悪意のある行為者によって悪用される可能性があります。

しかし、大規模言語モデルの分散化には利点があります。悪用される可能性はありますが、人々はその力を社会のために利用し、知識をすべての人にアクセス可能にすることができます。

展開の柔軟性

注目すべき点は、Mistral 7BがApache 2.0ライセンスの下で利用可能であるということです。これは、個人または大規模企業、または政府機関など、誰でも利用可能であることを意味します。必要なのは、実行するための適切なシステム、またはクラウドリソースへの投資です。

MITライセンスやCC BY-SA-4.0ライセンスなどの他のライセンスは、よりシンプルです。Apache 2.0ライセンスは、大規模な取り組みに適した堅牢な基盤を提供します。

最終的な考え

オープンソースの大規模言語モデル、Mistral 7Bの台頭は、AI業界の重要な変化を示しています。高品質の言語モデルをより広いオーディエンスにアクセス可能にします。Mistral AIの革新的なアプローチ、グループ化クエリーアテンションやスライディングウィンドウアテンションは、品質を妥協することなく効率的なパフォーマンスを約束します。

Mistralの分散化された性質は特定の課題を提起しますが、その柔軟性とオープンソースライセンスは、AIの民主化の可能性を強調しています。景色が変化するにつれて、焦点は、これらのモデルの力を倫理的配慮や安全性のメカニズムとバランスさせることに移ります。

Mistralの次のステップは?7Bモデルはただの始まりでした。チームはすぐにさらに大きなモデルをリリースすることを目指しています。如果これらの新しいモデルが7Bのパフォーマンスに匹敵する場合、Mistralは業界のトッププレイヤーとして急速に台頭する可能性があります。