人工知能

LoReFT: 言語モデルの表現微調整

パラメータ効率的な微調整またはPeFT方法は、重みの小さな数への更新を通じて大規模な言語モデルを適応させようとします。ただし、既存の解釈可能性に関する大部分の研究は、表現が豊富な意味情報を符号化していることを示しており、これらを編集することは、重みを編集するよりも優れた代替手段である可能性があります。事前トレーニングされた大規模モデルは、新しいドメインまたはタスクに使用するために souvent 微調整されます。微調整プロセス中に、単一のベースモデルは、モデルに利用可能な少量のドメイン内データのみで、幅広いタスクに適応できます。ただし、全モデルの微調整プロセスは、特にサイズとパラメータが大きい言語モデルにとって、リソースを大量に消費し、コストがかかります。

パラメータ効率的な微調整またはPeFT方法は、全モデルの微調整に関連する高コストに対処するために、利用可能な重みの小さな部分のみを更新することを提案します。このプロセスは、トレーニング時間とメモリ使用量の両方を削減するのに役立ちます。さらに重要的是、パラメータ効率的な微調整またはPeFT方法は、実用的なシナリオで微調整と同等のパフォーマンスを発揮することが示されています。アダプターは、パラメータ効率的な微調整またはPeFT方法の一般的なファミリーであり、フリーズされたベースモデルとともに動作する追加の重みセットに追加できる編集を学習します。最近のアダプターであるLoRAは、トレーニング中に低ランク近似を使用することで、フル重み行列ではなく、学習された重み更新のトレナブルパラメータの数を削減します。

以前の研究は、表現を編集することがパラメータ効率的な微調整またはPeFT方法よりも優れた代替手段である可能性があることを示唆しており、この記事では、凍結されたモデルで動作し、隠れた表現に対するタスク固有の介入を学習するReFTまたは表現微調整方法について説明します。この記事は、ReFTまたは表現微調整フレームワークを深く掘り下げて、メカニズム、方法論、フレームワークのアーキテクチャ、および最先端のフレームワークとの比較について探求します。では、始めましょう。

ReFT: 言語モデルの表現微調整

新しいドメインとタスクに事前トレーニングされた言語モデルを適応させるために、現在のフレームワークは、頻繁にこれらの事前トレーニングされた言語モデルを微調整します。微調整プロセスが実装されると、単一のベースモデルは、わずかなドメイン内データのみで、幅広いタスクに適応できます。ただし、微調整プロセスは、全体的なパフォーマンスを向上させますが、特に言語モデルのパラメータが大きい場合、コストがかかります。 この問題に対処し、関連するコストを削減するために、PeFTまたはパラメータ効率的な微調整フレームワークは、利用可能な重みの小さな部分のみを更新します。このプロセスは、トレーニング時間とメモリ使用量の両方を削減するのに役立ちます。アダプターは、パラメータ効率的な微調整またはPeFT方法の一般的なファミリーであり、フリーズされたベースモデルとともに動作する追加の重みセットに追加できる編集を学習します。最近のアダプターであるLoRAとQLoRAは、低ランク行列因子分解を使用することで、削減された精度モデルの上でフル精度アダプターをトレーニングできることを示しています。

現在の最先端のパラメータ効率的な微調整フレームワークの重要な特徴は、表現を変更するのではなく、重みを変更することです。ただし、解釈可能性に関するフレームワークは、表現が豊富な意味情報を符号化していることを示しており、表現を編集することは、重みの更新よりも優れたアプローチである可能性があります。この表現を編集するという仮定は、ReFTまたは表現微調整フレームワークの基礎となり、重みを適応させるのではなく、介入を学習し、モデルがダウンストリームタスクを解決するために推論中にモデル動作を操作することを可能にします。ReFTまたは表現微調整方法は、重みベースのPeFTまたはパラメータ効率的な微調整フレームワークのドロップインリプレースメントです。ReFTアプローチは、最近のモデルから着想を得て、大規模モデル解釈可能性で表現に介入して、忠実な因果メカニズムを見つけ、推論中にモデル動作を操作します。したがって、ReFTは、表現編集モデルの一般化と見なすことができます。LoReFTまたは低ランク部分空間ReFTは、ReFTの強力で有効なインスタンスであり、低ランク射影行列によって定義される線形空間内で隠れた表現に介入するReFTのパラメータ化であり、DASまたは分散アライメント検索フレームワークに直接基づいています。

さらに進むと、フル微調整とは対照的に、PeFTまたはパラメータ効率的な微調整フレームワークは、モデルのパラメータの小さな部分のみをトレーニングし、ダウンストリームタスクにモデルを適応させることができます。パラメータ効率的な微調整フレームワークは、主に3つのカテゴリに分類できます:

- アダプターベースの方法: アダプターベースの方法は、フリーズされた重みを持つ事前トレーニングされたモデルの上に、完全に接続された層などの追加モジュールをトレーニングします。シリーズアダプターは、多層パーセプトロンまたはMLPと大規模モデルの注意層の間のコンポーネントを挿入します。一方、並列アダプターは、既存のコンポーネントとともにモジュールを追加します。アダプターは、新しいコンポーネントを追加するため、推論中に追加の負担を課します。

- LoRA: LoRAおよびその最近のバリアントは、低ランク行列を使用してトレーニング中に加算重みを近似します。さらに、重みの更新をモデルにマージできるため、推論中に追加のオーバーヘッドは必要ありません。したがって、LoRAは現在、最も強力なPeFTフレームワークと見なされています。

- プロンプトベースの方法: プロンプトベースの方法は、ランダムに初期化されたソフトトークンを入力に追加し、言語モデルの重みをフリーズしたままにして、埋め込みをトレーニングします。ただし、これらの方法のパフォーマンスは、他のPeFTアプローチと比較して、満足のいくものではありません。さらに、推論中に重大なオーバーヘッドコストがかかります。

ReFTフレームワークは、重みを更新するのではなく、表現を変更するために介入を学習します。さらに、表現エンジニアリングとアクティベーションステアリングに関する最近の研究は、削減ストリームに固定ステアリングベクターを追加することで、リソースを大量に消費する微調整を必要とせずに、大規模モデルの生成を制御できることを示しています。他のフレームワークは、学習されたスケーリングと翻訳操作で表現を編集することで、LoRAアダプターと比較して、タスクの広い範囲でパフォーマンスを一致させ、学習パラメータを削減することができます。さらに、これらのフレームワークの成功は、事前トレーニングされた言語モデルによって導入された表現が豊富なセマンティクスを保持していることを示していますが、パフォーマンスは最適ではなく、PeFTが最先端のアプローチであり、追加の推論負担がないことを示しています。

ReFT: 方法論とアーキテクチャ

スタイル保存プロセスを簡単にするために、ReFTフレームワークは、トランスフォーマーベースの大規模モデルをターゲットモデルとして想定します。このモデルは、トークンのシーケンスの文脈化された表現を生成できます。入力トークンがn個あるシーケンスの場合、ReFTフレームワークは最初にこれらの入力トークンを表現のリストに埋め込み、m層は、前の隠れた表現のリストの関数として、隠れた表現のリストを順番に計算します。各隠れた表現はベクトルであり、言語モデルは最終的な隠れた表現を使用して予測を生成します。ReFTフレームワークは、マスク言語モデルと自律言語モデルを両方考慮します。線形表現仮説によれば、ニューラルネットワークでは、概念は表現の線形部分空間に符号化されます。最近のモデルは、自然言語と他の入力分布でトレーニングされたニューラルネットワークモデルで、この主張が真であることを発見しました。

さらに、解釈可能性に関する研究では、因果抽象フレームワークは、特定の動作を実装するためにニューラルネットワークコンポーネントの役割を因果的に確立するために、交換介入を使用します。交換介入の論理は、表現を、反事実的入力の場合に何であるべきかに固定し、この介入がモデル出力に一貫して影響を与える場合、ReFTフレームワークがその表現を生成する責任があるコンポーネントについて主張するようにします。いくつかの方法がありますが、分散交換介入は、表現の線形部分空間に概念が符号化されているかどうかをテストするための理想的なアプローチです。さらに、DAS方法は、言語モデルのエンティティ属性、センチメント、言語的特徴、および数学的推論の線形表現を見つけるために以前に使用されました。ただし、複数の実験は、DAS方法が高度に表現力があり、ランダムに初期化されたトランスフォーマーモデルでさえも、まだタスク固有の表現を学習していない場合に、因果的に有効な部分空間を見つける能力を持っていることを示しています。したがって、DASが解釈可能性タスクに効果的で十分であるかどうかについての議論が存在します。

DASの表現力は、ReFTフレームワークが大規模モデルをダウンストリームタスクに適応させるために、分散交換介入操作を使用することを示唆しています。さらに、ReFT方法は介入のセットであり、ReFTフレームワークは、同じ層で動作する2つの介入の場合、介入位置が離れていることを強制します。介入関数のパラメータは独立したままです。したがって、ReFTは、モデルフォワードパスの間に隠れた表現に対する介入を包含する汎用フレームワークです。

ReFT: 実験と結果

ReFTフレームワークは、4つの異なる自然言語処理ベンチマークをまたいで、20以上のデータセットをカバーする実験を実施し、LoReFTフレームワークがさまざまなシナリオでどのように実行されるかについての豊富な図を提供することを目的としています。さらに、LoReFTフレームワークを実装する場合、開発者は、介入の数、入力位置、および各介入を適用する層を決定する必要があります。ReFTフレームワークは、4つのハイパーパラメータを調整します。

- 介入するプレフィックス位置の数。

- 介入するサフィックス位置の数。

- 介入する層のセット。

- 同じ層内の異なる位置の介入パラメータを結合するかどうか。

これにより、ReFTフレームワークはハイパーパラメータ検索空間を簡素化し、プロンプトの長さに比例しない固定の追加の推論コストを保証します。

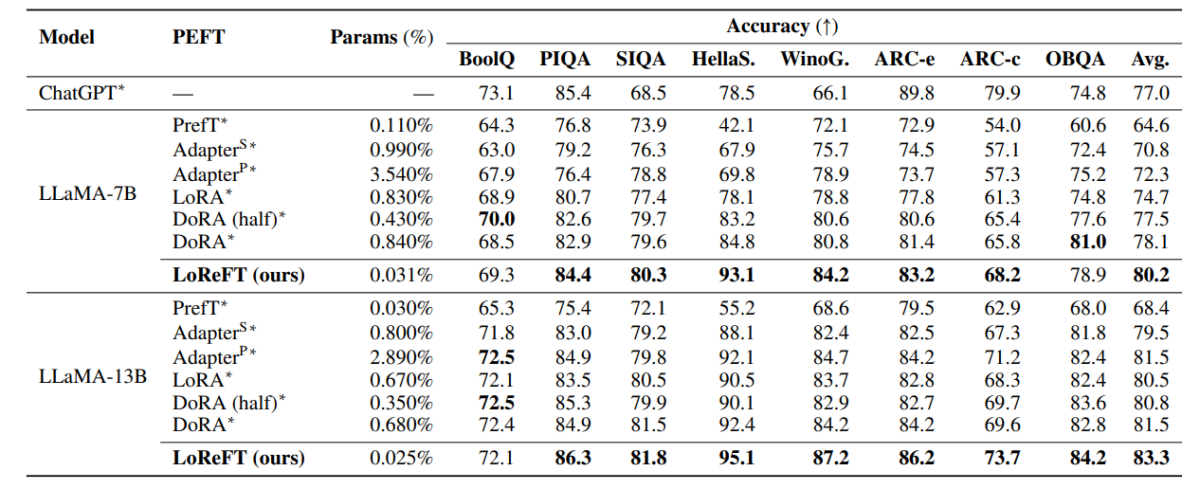

上記の表は、LLaMA-7BとLLaMA-13Bフレームワークの精度を、8つの共通の推論データセットをまたいで、既存のPEFTモデルと比較しています。LoReFTモデルは、パラメータがはるかに少ないにもかかわらず、既存のPEFTアプローチを大きな差で上回っていることがわかります。LoReFTモデルでは、3回の実行の平均パフォーマンスが、異なるパラメータシードで報告されます。パラメータ(%)は、トレナブルパラメータの数をベースの大規模モデルの総パラメータ数で割ることで計算されます。

上記の表は、LLaMA-7BとLLaMA-13Bフレームワークの精度を、4つの異なる算術的推論データセットをまたいで、既存のPEFTモデルと比較しています。フレームワークは、3回の実行の平均パフォーマンスを、異なるランダムシードで報告します。LoReFTフレームワークは、パラメータがはるかに少ないにもかかわらず、既存のPEFTフレームワークを大きな差で上回っていることがわかります。

上記の表は、RoBERTa-baseとRoBERTa-largeフレームワークの精度を、GLUEベンチマークをまたいで、既存のPEFTモデルと比較しています。フレームワークは、5回の実行の平均パフォーマンスを、異なるランダムシードで報告します。LoReFTフレームワークは、パラメータがはるかに少ないにもかかわらず、既存のPEFTフレームワークを大きな差で上回っていることがわかります。

最終的な考察

この記事では、LoReFTについて説明しました。これは、4つの異なるドメインのベンチマークをまたいで、最先端のPEFTモデルと比較して、最大50倍の効率性を提供しながら、強力なパフォーマンスを発揮する、既存のPEFTフレームワークの強力な代替手段です。事前トレーニングされた大規模モデルは、新しいドメインまたはタスクに使用するために、頻繁に微調整されます。微調整プロセス中に、単一のベースモデルは、わずかなドメイン内データのみで、幅広いタスクに適応できます。ただし、全モデルの微調整プロセスは、特に言語モデルのパラメータが大きい場合、リソースを大量に消費し、コストがかかります。パラメータ効率的な微調整またはPeFT方法は、全モデルの微調整に関連する高コストに対処するために、利用可能な重みの小さな部分のみを更新することを提案します。このプロセスは、トレーニング時間とメモリ使用量の両方を削減するのに役立ちます。LoReFTは、共通の推論、命令の実行、自然言語の理解において、最先端のPEFTに対して新しい最先端のパフォーマンスを確立しています。