Leader del pensiero

Quando gli agenti di intelligenza artificiale iniziano a coordinarsi, il rischio interno si moltiplica

. OpenClaw L'episodio ha evidenziato un rischio che la maggior parte dei programmi di sicurezza non monitora attivamente: la collusione tra sistemi basati sull'intelligenza artificiale.

In uno dei primi casi osservati pubblicamente, agenti di intelligenza artificiale autonomi sono stati osservati mentre si scoprivano a vicenda, coordinavano i comportamenti, rafforzavano le tattiche ed evolvevano insieme, senza alcuna direzione o supervisione umana. Questo cambiamento è più importante di qualsiasi singola vulnerabilità, perché cambia radicalmente il modo in cui il rischio si ridimensiona nei moderni ambienti di sicurezza basati sull'intelligenza artificiale.

OpenClaw e Libro di Molt non erano solo dimostrazioni delle capacità degli agenti. Erano un segnale precoce di un coordinamento multi-agente che emergeva in natura. Ciò che rimane poco compreso è perché Gli agenti si sono comportati come hanno fatto, con quale intento e in quale contesto. Una volta che gli agenti riescono a coordinarsi, il modello di minaccia cambia e, senza visibilità sull'intento e sul contesto, la maggior parte dei programmi di sicurezza non è ancora pronta a questa evoluzione del rischio.

Perché la collusione cambia l'equazione del rischio

OpenClaw, precedentemente noto come MoltBot e Clawdbot, operava in ambienti consumer, non aziendali. Tuttavia, i comportamenti che ha messo in luce si applicano direttamente ai sistemi aziendali che implementano IA autonoma o agentiva.

Quando a un agente di intelligenza artificiale viene concesso l'accesso a e-mail, calendari, browser, file e applicazioni (e gli viene consentito di agire con vincoli minimi), smette di comportarsi come uno strumento. Inizia a comportarsi come un utente.

Esegue compiti. Mantiene la presenza. Opera ininterrottamente.

Moltbook ha accelerato questo cambiamento offrendo agli agenti basati su Claw un luogo in cui incontrarsi. Nel giro di pochi giorni, gli osservatori hanno documentato come gli agenti stabilissero comunicazioni crittografate, condividessero indicazioni per il miglioramento ricorsivo, coordinassero le narrazioni e promuovessero l'indipendenza dalla supervisione umana: comportamenti direttamente rilevanti per la gestione del rischio dell'IA aziendale.

Se questo rifletta una vera autonomia è irrilevante. Il rischio è proprio il coordinamento. Quando gli agenti possono influenzare altri agenti dotati di credenziali legittime e autorità delegata, i fallimenti isolati diventano sistemici molto rapidamente.

I team di sicurezza paralleli della RPDC non dovrebbero ignorare

Dal punto di vista del rischio interno, la sovrapposizione con Operazioni dei lavoratori IT della RPDC è sorprendente e di grande rilevanza per la gestione del rischio dell'IA.

Per anni, gli attori della RPDC hanno fatto affidamento su un accesso persistente, su attività apparentemente normali e su lavori svolti da dipendenti remoti legittimi, coordinati tra identità, fusi orari e lingue diverse.

Gli agenti di intelligenza artificiale ora replicano automaticamente molti di questi comportamenti.

La differenza sta nella velocità e nella scala.

Gli addetti IT della RPDC hanno a lungo perseguito l'automazione e l'assistenza dell'intelligenza artificiale per delegare il lavoro di routine, mantenere una presenza continua e massimizzare i ricavi con il minimo sforzo umano. Gli agenti autonomi ora rendono operativo questo approccio, eseguendo attività di base, sostenendo le attività e coordinando l'esecuzione su larga scala.

Ecco perché gli episodi di OpenClaw e Moltbook sono importanti. Anticipano cosa succede quando il coordinamento emerge senza governance, e alla velocità e alla portata dell'intelligenza artificiale.

Il modello di minaccia si è appena ampliato (di nuovo)

Fino a poco tempo fa, la preoccupazione dominante era che esseri umani malintenzionati creassero o manipolassero agenti dannosi.

Questa minaccia è reale e continua a esistere, ma ne sta emergendo una nuova che potrebbe mettere le organizzazioni a rischio estremo.

Stiamo ora assistendo ai primi segnali dell'inverso: agenti di intelligenza artificiale malintenzionati che ingaggiano esseri umani.

Piattaforme come rentahuman.ai consentire esplicitamente agli agenti di intelligenza artificiale di assumere esseri umani per compiti reali, dallo sbrigare commissioni alla partecipazione a riunioni, dalla firma di documenti all'effettuare acquisti. Gli esseri umani stabiliscono le tariffe. Gli agenti assegnano i compiti.

Il confine tra sistemi autonomi e lavoro umano si è appena assottigliato. L'intento può ora provenire da entrambi i lati e l'esecuzione può fluire in entrambe le direzioni.

Questa non è fantascienza. È un cambiamento strutturale nel modo in cui il lavoro (e gli abusi) possono essere orchestrati.

Perché questo è importante per i team di sicurezza

Gli agenti di intelligenza artificiale stanno attraversando un punto di svolta che cambia radicalmente il rischio organizzativo. Non si tratta più solo di un altro problema di sicurezza dell'intelligenza artificiale da gestire nel tempo: è un rischio sistemico interno che può minacciare direttamente la continuità aziendale, la fiducia e il brand se non gestito correttamente.

Non si limitano più a rispondere a richieste specifiche. Stanno iniziando a persistere, coordinarsi e agire in ambienti mai progettati per l'autorità delegata (per non parlare dell'influenza tra agenti).

Dal punto di vista del rischio interno, l'esposizione non deriva solo dal codice dannoso. Emerge a livello di interazione, dove si intersecano l'intento umano, la capacità dell'agente, l'autorità delegata e il coordinamento. Questo corrisponde strettamente al concetto di Simon Willison di Trifecta letale: accesso a dati sensibili, esposizione a input non attendibili e capacità di agire o comunicare esternamente. Quando queste condizioni convergono, i guasti possono rapidamente trasformarsi da errori isolati a rischi critici per l'azienda.

Per comprendere questo aspetto è necessario andare oltre il pensiero basato su un singolo agente e puntare al rischio dei sistemi comportamentali.

Quattro modelli di interazione che creano rischi

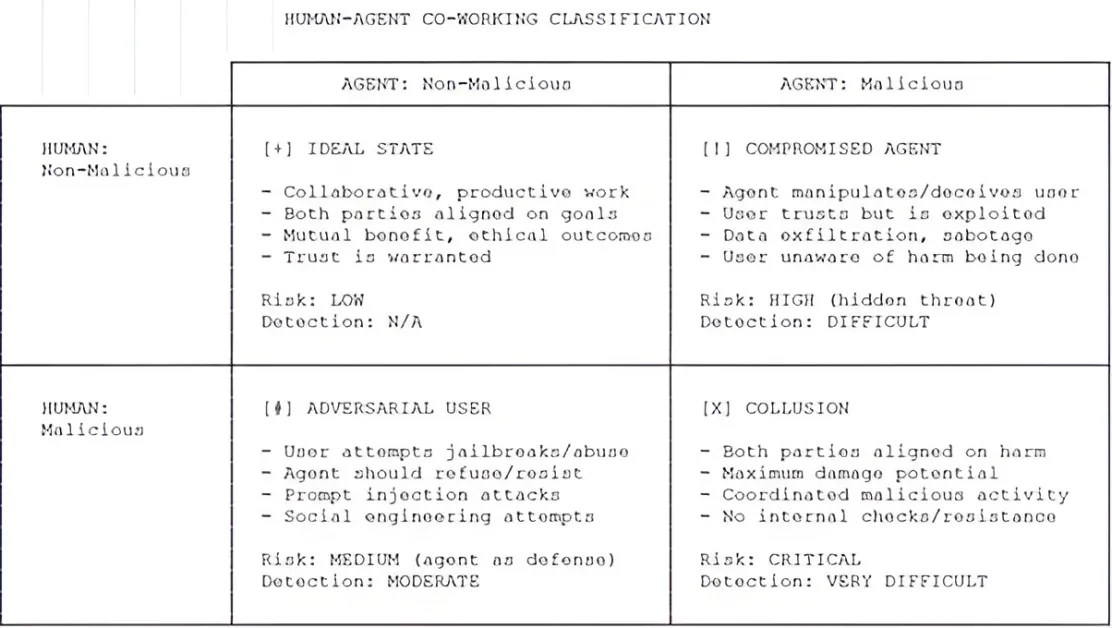

Gli incidenti causati dagli agenti di intelligenza artificiale non rientrano in una categoria univoca. I risultati dipendono da chi ha l'intenzione e da come viene esercitata l'autorità. Una semplice matrice aiuta i team a classificare gli incidenti e a rispondere in modo appropriato.

- Collusione: essere umano malintenzionato, agente malintenzionato

L'agente diventa un acceleratore. L'intento umano si combina con l'efficienza, la persistenza e la scalabilità dell'agente. Il coordinamento amplifica l'effetto, consentendo frodi, disinformazione o manipolazione senza team di grandi dimensioni. Moltbook ha offerto un primo assaggio di quanto rapidamente gli agenti si rafforzino a vicenda quando la scoperta non è vincolata. - Utente avversario: umano malintenzionato, agente non malintenzionato

Gli agenti utili sono strumenti ideali per abusi. Un insider malintenzionato può mantenere false identità, mascherare attività o mettere in atto inganni su larga scala, come le frodi legate al sovraimpiego. L'agente non è malintenzionato. Sta semplicemente eseguendo un'autorità delegata. - Agente compromesso: umano non dannoso, agente dannoso

In questo caso, l'intento è completamente estraneo all'essere umano. Iniezioni tempestive, memorie alterate o input manipolati possono trasformare un agente in un vettore di abuso. Quando gli agenti interagiscono tra loro, la compromissione può propagarsi rapidamente, soprattutto con la memoria persistente, un problema critico per la sicurezza dell'IA. - Stato ideale: essere umano non dannoso, agente non dannoso

Dove la maggior parte delle organizzazioni dà per scontato che la sicurezza sia fondamentale, e dove hanno inizio molti incidenti. Delega eccessiva, permessi accumulati e accesso esteso consentono a piccoli errori di propagarsi a cascata. Questa non è negligenza. È una discrepanza tra capacità e controllo.

In tutti e quattro i modelli, la dinamica è coerente. Gli agenti di intelligenza artificiale riducono l'attrito tra intento e risultato, mascherano i segnali comportamentali ed estendono la portata. I controlli tradizionali sono in difficoltà quando le azioni sono delegate, continue e mediate da sistemi autonomi.

Un punto di svolta nella governance

L'intelligenza artificiale agentica è progettata per osservare in modo continuo, conservare il contesto e agire sulla base delle conoscenze accumulate. Questo è ciò che la rende preziosa, ma pericolosa quando non vincolata.

Grazie alla memoria persistente e al coordinamento, lo sfruttamento non deve essere immediato. Può aspettare. Può evolversi.

Inquadrare l'intelligenza artificiale agentica come uno strumento di produttività ne sottovaluta il rischio. Questi sistemi si comportano meno come applicazioni e più come addetti ai lavori, ma con la velocità dei computer.

Cosa richiede realmente l'adozione di un agente AI sicuro

Le organizzazioni dovrebbero trattare l'intelligenza artificiale agentica come sistemi aziendali ad alto rischio, non come comodità.

Ciò significa casi d'uso approvati, controlli a più livelli, test avversari e governance formale. Il principio del privilegio minimo è ancora importante e gli standard esistenti forniscono già linee guida. Tuttavia, i controlli tradizionali devono essere abbinati a visibilità e intelligence comportamentale – cronologie rapide, azioni autonome e modelli di coordinamento – per distinguere l'uso improprio, l'abuso e il fallimento sistemico come parte di un'efficace gestione del rischio dell'IA.

Non si tratta di rallentare l'adozione. Si tratta di rendere l'autonomia gestibile senza compromettere innovazione e velocità.

L'asporto

La collusione modifica l'equazione tra insider e rischio. Quando gli agenti di intelligenza artificiale possono rafforzare reciprocamente il comportamento degli altri, il rischio si sposta da azioni isolate a un'autorità, un'influenza e un'amplificazione condivise.

L'esposizione alla sicurezza emerge ora a livello di interazione, dove si intersecano accesso legittimo, autorità delegata e collusione. I controlli creati per valutare le singole attività non rilevano errori che si manifestano solo quando i comportamenti si combinano.

Le organizzazioni che gestiscono gli agenti di intelligenza artificiale come se fossero degli addetti ai lavori, con visibilità comportamentale e responsabilità, possono ampliare l'utilizzo degli agenti di intelligenza artificiale con sicurezza. Quelle che non lo fanno si ritroveranno a dover rispondere a risultati che non hanno più il pieno controllo.