Leader di pensiero

Cosa ogni scienziato dei dati dovrebbe sapere sui Graph Transformer e il loro impatto sui dati strutturati

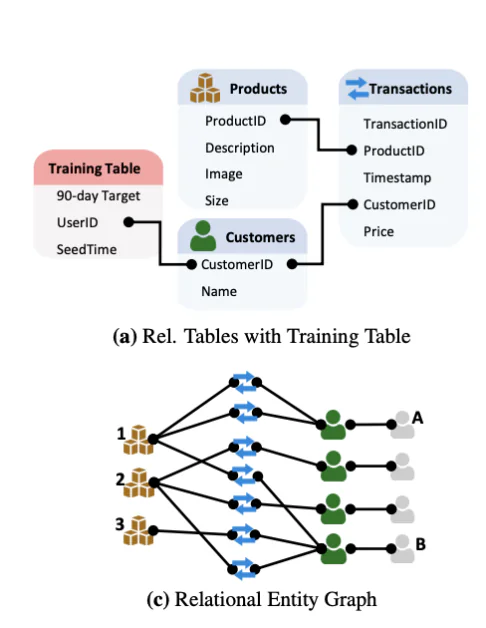

Ho co-creato le Graph Neural Networks mentre ero a Stanford. Ho riconosciuto fin da subito che questa tecnologia era incredibilmente potente. Ogni punto di dati, ogni osservazione, ogni pezzo di conoscenza non esiste in isolamento; fa parte di un grafico collegato ad altri pezzi di conoscenza. Importante, la maggior parte dei dati aziendali di valore, spesso archiviati come tabelle nei database e nei magazzini di dati, può essere naturalmente rappresentata come un grafico. Sfruttare questa struttura relazionale è fondamentale per costruire modelli di intelligenza artificiale accurate e non allucinanti.

Le reti neurali dei grafici (GNN) hanno introdotto architetture di passaggio di messaggi che potevano ragionare sui grafici catturando le connessioni tra pezzi di conoscenza. Ma proprio come i Transformer hanno trasformato la comprensione del linguaggio, una nuova classe di modelli, Graph Transformer, sta portando guadagni simili ai dati basati su grafici. Questi modelli combinano la flessibilità dei meccanismi di attenzione con priori strutturali del grafico per modellare relazioni complesse più efficacemente dei loro predecessori GNN.

Perché i grafici necessitano di più del passaggio di messaggi

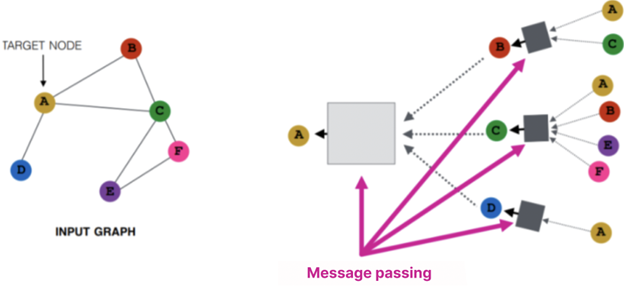

Le reti neurali dei grafici tradizionali (GNN) si basano sul passaggio di messaggi, un processo in cui ogni nodo aggiorna il suo stato interno aggregando informazioni dai suoi vicini. Pensalo come ogni nodo che scambia riassunti con nodi vicini, quindi utilizza quei riassunti per raffinare la sua comprensione. Su più livelli, ciò consente alle informazioni di propagarsi attraverso il grafico.

Mentre è potente per l’apprendimento di modelli locali, il passaggio di messaggi ha limitazioni importanti:

- Sovrappressione: poiché le informazioni vengono aggregate su molti salti, possono diventare compresse, perdendo dettagli significativi. Ciò è particolarmente problematico nelle GNN profonde.

- Contesto limitato: il passaggio di messaggi standard non può catturare facilmente dipendenze a lungo raggio senza molti livelli, il che aumenta la complessità e il rumore.

- Espressività: molte strutture di grafico non possono essere differenziate utilizzando solo informazioni del vicinato locale, limitando le prestazioni del modello su attività che richiedono distinzioni strutturali fini.

È qui che entrano in gioco i Graph Transformer. Sostituendo o integrando il passaggio di messaggi con meccanismi di attenzione, consentono a ogni nodo di attendere direttamente ad altri (anche distanti) in base a importanza appresa. Il risultato è rappresentazioni più ricche, migliore scalabilità e la capacità di ragionare su strutture complesse in modo più flessibile.

Dalle GNN ai Graph Transformer

Il modello Transformer originale, introdotto nel paper iconico, Attention Is All You Need, è stato progettato per modellare relazioni tra token in una sequenza. Il suo successo si trova nell’auto-attenzione, un meccanismo che consente a ogni input di considerare ogni altro input, ponderato da rilevanza appresa.

Graph Transformer adattano questo paradigma consentendo ai nodi di attendere non solo ai loro vicini, ma a qualsiasi nodo nel grafico, sia attraverso un’attenzione completamente connessa che attraverso un approccio ibrido che bilancia segnali globali e locali. La sfida è introdurre una nozione di struttura in un modello progettato per sequenze non strutturate.

Codici di posizione specifici del grafico

A differenza del testo, i grafici non hanno un ordine intrinseco, rendendo codici di posizione, che si riferiscono a tecniche per iniettare informazioni strutturali o di localizzazione in un modello, non banali. I Graph Transformer affrontano questo con vari metodi:

- Autovalori di Laplace: derivati dalla matrice di Laplace del grafico, forniscono un embedding spettrale che cattura la struttura globale.

- Passeggiate casuali: catturano la probabilità di attraversare da un nodo all’altro in più salti.

- Codici strutturali: includono metriche di distanza, gradi di nodo o tipi di bordo.

Questi codici di posizione, sia spettrali, probabilistici che strutturali, danno ai Graph Transformer un modo per comprendere dove ogni nodo si trova all’interno del grafico più ampio. Questa consapevolezza strutturale è essenziale per consentire ai meccanismi di attenzione di operare in modo significativo su dati irregolari e non ordinati, permettendo infine al modello di catturare relazioni che sarebbero invisibili a metodi più semplici e puramente locali.

Implementazioni e casi d’uso nel mondo reale

Portare i Graph Transformer in produzione richiede un’infrastruttura in grado di scalare a dimensioni di dati del mondo reale. Librerie come PyTorch Geometric (PyG) stanno rendendo ciò possibile. Costruito su PyTorch, PyG fornisce un framework modulare per implementare GNN e Graph Transformer su una gamma di applicazioni, dalla modellazione di molecole ai sistemi di raccomandazione. Supporta l’addestramento in mini-lotti su molti piccoli grafici e un singolo grande grafico, con supporto multi-GPU e torch.compile, rendendolo adatto per flussi di lavoro di ricerca e aziendali.

Questi strumenti stanno già alimentando una vasta gamma di applicazioni nel mondo reale. Nella scoperta di farmaci, i Graph Transformer aiutano a prevedere le proprietà molecolari modellando le interazioni atomiche come grafici. Nell’ottimizzazione della logistica e della catena di approvvigionamento, possono rappresentare e ragionare su reti dinamiche di spedizioni, magazzini e percorsi. Le aziende di e-commerce li utilizzano per migliorare le raccomandazioni comprendendo il comportamento di acquisto e di navigazione dei prodotti come grafici relazionali. E nella sicurezza informatica, i modelli basati su grafici vengono utilizzati per rilevare anomalie analizzando modelli di accesso, topologia di rete e sequenze di eventi.

In ciascuna di queste impostazioni, la capacità di apprendere da strutture complesse e interconnesse, senza affidarsi solo a funzionalità create manualmente, si sta rivelando un grande vantaggio.

Considerazioni tecniche

Nonostante il loro potenziale, i Graph Transformer presentano scelte di ingegneria reali. L’auto-attenzione completa scala quadraticamente con il numero di nodi, rendendo l’efficienza della memoria e del calcolo una preoccupazione principale, soprattutto per grafici grandi o densi. Molti grafici del mondo reale hanno anche bordi direzionali, introducendo asimmetrie che complicano la codifica delle informazioni strutturali. E nei dispiegamenti pratici, gli input sono raramente uniformi: combinare dati strutturati come grafici con testo, serie temporali o immagini richiede scelte architettoniche accurate e una robusta pre-elaborazione dei dati.

Queste sfide non sono insormontabili, ma richiedono una progettazione del sistema pensata, soprattutto quando si transita da prototipi di ricerca a modelli pronti per la produzione.

Cosa c’è dopo: LLM incontra Grafici

Una direzione di ricerca importante è l’integrazione di grandi modelli linguistici (LLM) con strutture di grafico. Questi sistemi ibridi utilizzano LLM per codificare il contesto testuale o estrarre entità, quindi ancorare quelle informazioni in un grafico per il ragionamento e la presa di decisioni.

In biologia, ciò ha alimentato strumenti come AlphaFold. Nell’AI aziendale, consente sistemi di supporto clienti che combinano documentazione e grafici comportamentali. I Graph Transformer stanno giocando un ruolo crescente nell’abilitare gli agenti di intelligenza artificiale a prendere decisioni più intelligenti e azionabili consentendo loro di ragionare su rappresentazioni di stato strutturate e priorizzare interazioni dinamicamente. Questa fusione aiuta gli agenti a comprendere meglio le relazioni gerarchiche, a tenere traccia delle dipendenze nel tempo e ad adattare il loro comportamento in ambienti complessi.

Il campo è ancora emergente, ma il potenziale è significativo.

Conclusione

I Graph Transformer non sono solo la prossima iterazione delle GNN; rappresentano una convergenza di attenzione, struttura e scalabilità. Che tu stia lavorando nel settore finanziario, nelle scienze della vita o nei sistemi di raccomandazione, il messaggio è chiaro: i tuoi dati formano un grafico, quindi i tuoi modelli dovrebbero fare lo stesso.