Intelligenza artificiale

I limiti di Amazon Mechanical Turk potrebbero minacciare i sistemi di generazione del linguaggio naturale

Uno studio recente dell’Università del Massachusetts Amherst ha messo a confronto insegnanti di inglese e lavoratori crowdsourced su Amazon Mechanical Turk nella valutazione dell’output dei sistemi di generazione del linguaggio naturale (NLG), concludendo che gli standard laschi e il ‘gioco’ di compiti ambiti tra i lavoratori di AMT potrebbero ostacolare lo sviluppo del settore.

Il rapporto giunge a una serie di conclusioni critiche riguardo alla misura in cui l’esternalizzazione a basso costo di compiti di valutazione NLG su larga scala potrebbe portare a risultati e algoritmi inferiori in questo settore.

I ricercatori hanno anche compilato un elenco di 45 articoli su generazione di testo aperto in cui la ricerca aveva fatto uso di AMT, e hanno scoperto che ‘la stragrande maggioranza’ non ha segnalato dettagli critici sull’uso del servizio di crowd di Amazon, rendendo difficile riprodurre i risultati degli articoli.

Lavoro in condizioni di sfruttamento

Il rapporto critica sia la natura di sfruttamento di Amazon Mechanical Turk, sia i progetti accademici (probabilmente vincolati dal budget) che conferiscono ad AMT ulteriore credibilità utilizzandolo (e citandolo) come risorsa di ricerca valida e coerente. Gli autori notano:

‘Sebbene AMT sia una soluzione comoda e economica, osserviamo che la alta varianza tra i lavoratori, la scarsa calibrazione e i compiti cognitivamente impegnativi possono portare i ricercatori a trarre conclusioni scientifiche fuorvianti (ad esempio, che il testo scritto da un uomo è “peggiore” di quello di GPT-2)’

Il rapporto incolpa il sistema e non i giocatori, con i ricercatori che osservano:

‘I lavoratori della folla sono frequentemente sottopagati per il loro lavoro, il che danneggia sia la qualità della ricerca, sia, più importante, la capacità di questi lavoratori di guadagnare un reddito adeguato’

L’articolo, intitolato I pericoli dell’uso di Mechanical Turk per valutare la generazione di testo aperto, conclude inoltre che ‘giudici esperti’ come insegnanti di lingua e linguisti dovrebbero essere utilizzati per valutare il contenuto NLG aperto, anche se AMT è più economico.

Compiti di test

Confrontando le prestazioni di AMT con lettori esperti meno vincolati dal tempo, i ricercatori hanno speso 144 dollari per i servizi AMT effettivamente utilizzati nei test di confronto (sebbene molto di più sia stato speso per risultati ‘non utilizzabili’ – vedi sotto), richiedendo a lavoratori casuali di valutare uno dei 200 testi, divisi tra contenuti di testo creati dall’uomo e testi generati artificialmente.

Il fatto di affidare ai docenti professionisti lo stesso lavoro è costato 187,50 dollari e ha confermato le loro prestazioni superiori (rispetto ai lavoratori di AMT) assumendo freelancer di Upwork per replicare i compiti a un costo aggiuntivo di 262,50 dollari.

Ogni compito consisteva in quattro criteri di valutazione: grammatica (‘Quanto è grammaticalmente corretto il testo del frammento di storia?’); coerenza (‘Quanto bene si adattano le frasi del frammento di storia?’); piacevolezza (‘Quanto ti piace il frammento di storia?’); e pertinenza (‘Quanto è pertinente il frammento di storia al prompt?’).

Generazione dei testi

Per ottenere materiale NLG per i test, i ricercatori hanno utilizzato il dataset Generazione di storie neurali gerarchiche del 2018 di Facebook AI Research, che comprende 303.358 storie in lingua inglese composte da utenti del subreddit r/writingprompts, dove le storie degli iscritti sono ‘seminate’ da prompt di una sola frase in un modo simile alle attuali pratiche di generazione di testo-immagine – e, naturalmente, in sistemi di generazione del linguaggio naturale aperti.

200 prompt dal dataset sono stati selezionati casualmente e passati attraverso un modello GPT-2 di medie dimensioni utilizzando la libreria Hugging-Face Transformers library. Così sono stati ottenuti due set di risultati dai medesimi prompt: i saggi discorsivi scritti da utenti di Reddit e testi generati da GPT-2.

Al fine di evitare che gli stessi lavoratori di AMT giudicassero la stessa storia più volte, sono state richieste tre valutazioni dei lavoratori di AMT per esempio. Insieme con esperimenti riguardanti le capacità linguistiche degli lavoratori (vedi fine dell’articolo) e scontando i risultati dei lavoratori a basso impegno (vedi ‘Breve tempo’ sotto), ciò ha aumentato la spesa totale su AMT a circa 1.500 dollari.

Per creare un campo di gioco equo, tutti i test sono stati condotti nei giorni feriali tra le 11:00-11:30 PST.

Risultati e conclusioni

Lo studio vasto copre molti argomenti, ma i punti chiave sono i seguenti:

Tempo breve

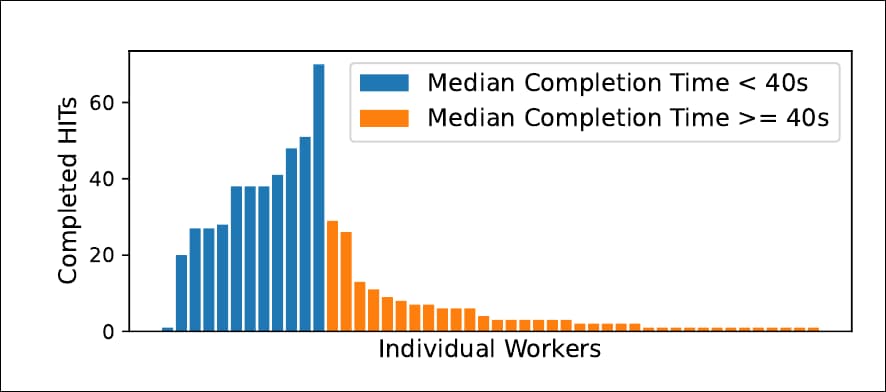

L’articolo ha scoperto che un tempo di task medio segnalato da Amazon di 360 secondi si è ridotto a un tempo di lavoro reale di solo 22 secondi, e un tempo di lavoro mediano di solo 13 secondi – un quarto del tempo impiegato dal più veloce insegnante di inglese che replica il compito.

Dal giorno 2 dello studio: i lavoratori individuali (in arancione) hanno trascorso notevolmente meno tempo valutando ogni compito rispetto agli insegnanti meglio pagati, e (in seguito) ai contractor di Upwork ancora meglio pagati. Fonte: https://arxiv.org/pdf/2109.06835.pdf