Etica

Il Database degli Incidenti di Intelligenza Artificiale Miri a Rendere gli Algoritmi di Intelligenza Artificiale più Sicuri

Qualsiasi sistema sufficientemente grande avrà errori e parte della correzione di questi errori consiste nell’avere un database di essi che possa essere analizzato per gli impatti e le cause potenziali. Allo stesso modo in cui la FDA mantiene un database per le reazioni avverse ai farmaci, o il National Transportation Safety Board mantiene un database per gli incidenti aerei, il Database degli Incidenti di Intelligenza Artificiale è un database inteso a catalogare i fallimenti dei sistemi di intelligenza artificiale e ad aiutare i ricercatori di intelligenza artificiale a progettare nuovi metodi per evitare questi fallimenti. I creatori del Database degli Incidenti di Intelligenza Artificiale (AIID) sperano che esso aiuti le aziende di intelligenza artificiale a sviluppare intelligenza artificiale più sicura e più etica.

Cosa è l’AIID?

L’AIID è il prodotto della Partnership on AI (PAI) organizzazione. La PAI è stata inizialmente fondata nel 2016 da membri dei team di ricerca di intelligenza artificiale di grandi aziende tecnologiche come Facebook, Apple, Amazon, Google, IBM e Microsoft. Da allora, l’organizzazione ha reclutato membri da molte altre organizzazioni, tra cui varie organizzazioni no-profit. Nel 2018, la PAI ha iniziato a creare uno standard di classificazione coerente per i fallimenti di intelligenza artificiale. Tuttavia, non c’era una raccolta di incidenti di intelligenza artificiale su cui basare questa classificazione. Per questo motivo, la PAI ha creato l’AIID.

Secondo TechTalks, il formato dell’AIID è stato informato dalla struttura del database degli incidenti aerei mantenuto dal National Transportation Safety Board. Dal momento in cui sono iniziati a essere raccolti i rapporti nel 1996, il sistema di trasporto aereo commerciale è riuscito a aumentare la sicurezza dell’industria aerea archiviando e analizzando gli incidenti. La speranza è che un repository simile di incidenti di intelligenza artificiale possa rendere i sistemi di intelligenza artificiale più sicuri, più etici e più affidabili. L’AIID ha anche tratto ispirazione dal database Common Vulnerabilities and Exposures, che è un repository di fallimenti software notevoli che coprono una varietà di industrie e discipline diverse.

Sean McGregor è il consulente tecnico principale di IBM per il Watson AI XPRIZE. McGregor è anche responsabile della supervisione dello sviluppo del database effettivo dell’AIID. McGregor ha spiegato che l’obiettivo dell’AIID è ultimamente prevenire che i sistemi di intelligenza artificiale causino danni, o almeno ridurre la gravità degli incidenti avversi. Come ha notato McGregor, i sistemi di apprendimento automatico sono sostanzialmente più complessi e imprevedibili dei sistemi software tradizionali e, di conseguenza, non possono essere testati nello stesso modo degli altri software. I sistemi di apprendimento automatico possono cambiare il loro comportamento in modi inaspettati. McGregor nota che la capacità dei sistemi di apprendimento profondo di apprendere può significare “malfunzionamenti più probabili, più complicati e più pericolosi” quando entrano in un mondo non strutturato.

Più di 1.000 incidenti relativi all’intelligenza artificiale registrati

Dal momento in cui l’AIID è stato inizialmente creato, ci sono stati più di 1.000 incidenti relativi all’intelligenza artificiale registrati nel database. Tra tutti gli incidenti nel database, le questioni relative alla equità dell’intelligenza artificiale sono state il tipo più comune di incidente avverso. Molti di questi incidenti di equità coinvolgono l’uso di algoritmi di riconoscimento facciale da parte di agenzie governative. McGregor nota anche che c’è un numero crescente di incidenti che coinvolgono la robotica aggiunti al database.

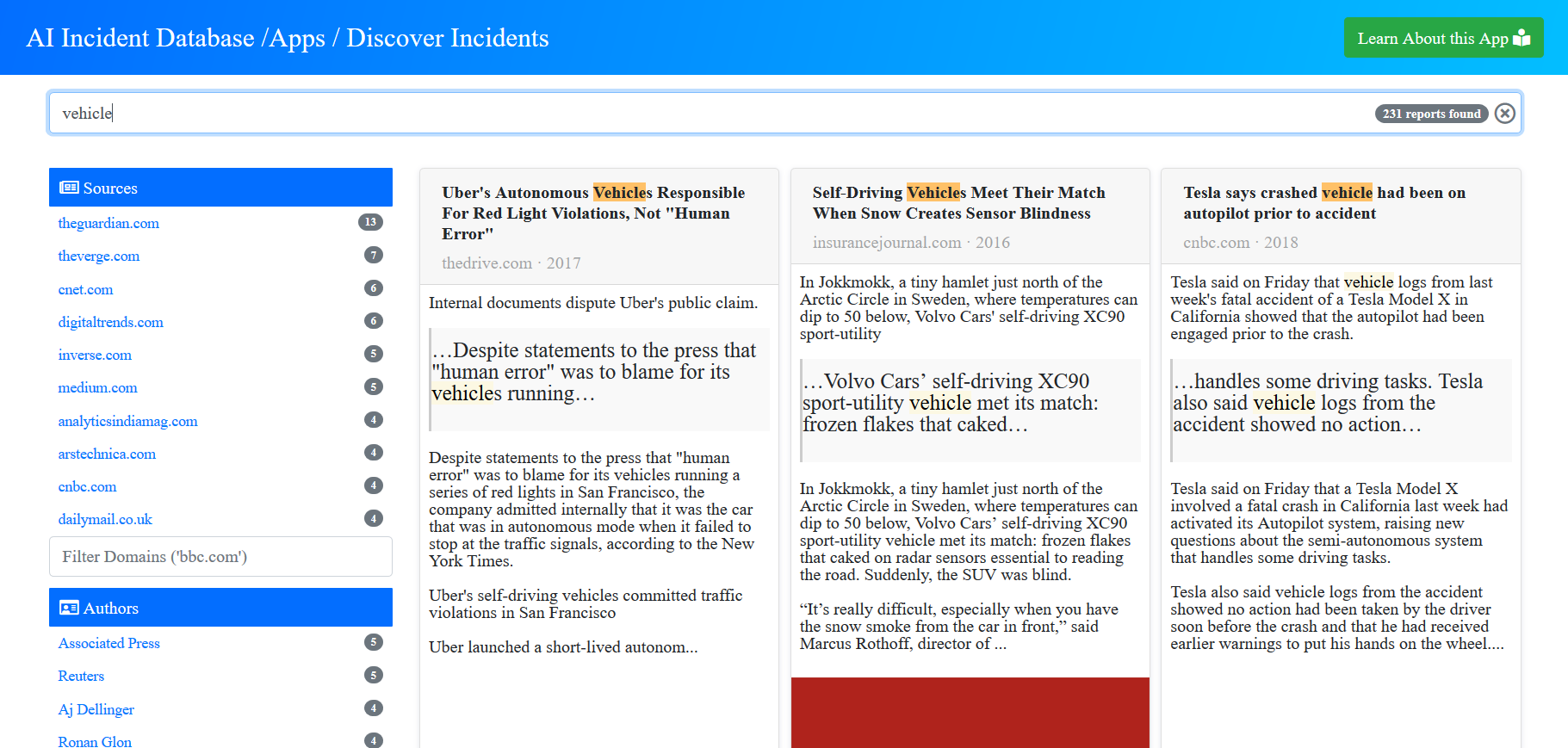

I visitatori del database possono eseguire query, cercando nel database gli incidenti in base a criteri come parole chiave, ID incidente, fonte o autore. Ad esempio, eseguire una ricerca per “Deepfake” restituisce 7 rapporti, mentre la ricerca per “robot” restituisce 158 rapporti.

Un database centralizzato per gli incidenti di malfunzionamento e di funzionamento inaspettato dell’intelligenza artificiale può aiutare i ricercatori, gli ingegneri e gli esperti di etica a supervisionare lo sviluppo e la distribuzione dei sistemi di intelligenza artificiale. I responsabili del prodotto delle aziende tecnologiche potrebbero utilizzare l’AIID per vedere se ci sono problemi potenziali prima di impiegare sistemi di raccomandazione di intelligenza artificiale, o un ingegnere di intelligenza artificiale potrebbe ottenere un’idea dei pregiudizi potenziali che devono essere corretti quando si crea l’applicazione di intelligenza artificiale. Allo stesso modo, gli ufficiali di rischio potrebbero utilizzare il database per determinare gli effetti collaterali negativi potenziali associati a un modello di intelligenza artificiale, consentendo loro di pianificare in anticipo e sviluppare misure per mitigare i danni potenziali.

L’architettura sottostante all’AIID è progettata per essere flessibile, poiché ciò consente la creazione di nuovi strumenti per interrogare il database e estrarre informazioni significative. La Partnership on AI e McGregor collaboreranno per progettare una tassonomia flessibile che possa essere utilizzata per classificare tutte le forme di incidenti di intelligenza artificiale. La squadra spera che, una volta creata la tassonomia flessibile, possa essere combinata con un sistema automatizzato che registri automaticamente gli incidenti di intelligenza artificiale.

“La comunità di intelligenza artificiale ha iniziato a condividere i registri degli incidenti tra loro per motivare i cambiamenti ai loro prodotti, alle procedure di controllo e ai programmi di ricerca”, ha spiegato McGregor via TechTalks. “Il sito è stato rilasciato pubblicamente nel novembre, quindi stiamo solo iniziando a realizzare i benefici del sistema”.