Intelligenza artificiale

StyleTTS 2: Sintesi vocale umano-macchina con grandi modelli linguistici di sintesi vocale

Grazie all’aumento di approcci di sintesi vocale naturale e sintetica, uno dei principali risultati che l’industria dell’AI ha raggiunto negli ultimi anni è stato quello di sintetizzare efficacemente framework di testo-vocale con potenziali applicazioni in diversi settori, tra cui audiolibri, assistenti virtuali, narrazioni vocali e molto altro, con alcuni modelli all’avanguardia che forniscono prestazioni e efficienza a livello umano in una vasta gamma di attività legate alla sintesi vocale. Tuttavia, nonostante le loro prestazioni solide, c’è ancora spazio per il miglioramento delle attività grazie alla sintesi vocale espressiva e diversificata, alla richiesta di una grande quantità di dati di formazione per ottimizzare i framework di testo-vocale zero-shot e alla robustezza per i testi fuori distribuzione (OOD) che portano gli sviluppatori a lavorare su un framework di testo-vocale più robusto e accessibile.

In questo articolo, parleremo di StyleTTS-2, un framework di testo-vocale robusto e innovativo costruito sulle fondamenta del framework StyleTTS, e che mira a presentare il prossimo passo verso sistemi di sintesi vocale all’avanguardia. Il framework StyleTTS2 modella gli stili di sintesi vocale come variabili casuali latenti e utilizza un modello di diffusione probabilistico per campionare questi stili di sintesi vocale o variabili casuali, consentendo così al framework StyleTTS2 di sintetizzare sintesi vocali realistiche senza utilizzare input audio di riferimento. Grazie all’approccio, il framework StyleTTS2 è in grado di fornire risultati migliori e mostra un’alta efficienza rispetto ai framework di sintesi vocale attuali, ma è anche in grado di sfruttare la sintesi vocale diversificata offerta dai framework di diffusione. Discuteremo il framework StyleTTS2 in maggiore dettaglio e parleremo della sua architettura e metodologia, esaminando anche i risultati raggiunti dal framework. Quindi, iniziamo.

StyleTTS2 per la sintesi testo-vocale: un’introduzione

StyleTTS2 è un modello di sintesi testo-vocale innovativo che rappresenta il prossimo passo verso la costruzione di framework di sintesi vocale a livello umano, e si basa sul modello StyleTTS, un modello generativo di sintesi vocale basato su stili. Il framework StyleTTS2 modella gli stili di sintesi vocale come variabili casuali latenti e utilizza un modello di diffusione probabilistico per campionare questi stili di sintesi vocale o variabili casuali, consentendo così al framework StyleTTS2 di sintetizzare sintesi vocali realistiche senza utilizzare input audio di riferimento. La modellazione degli stili come variabili casuali latenti è ciò che distingue il framework StyleTTS2 dal suo predecessore, il framework StyleTTS, e mira a generare lo stile di sintesi vocale più adatto al testo di input senza necessità di un input audio di riferimento, e riesce a raggiungere diffusione latente efficace sfruttando le capacità di sintesi vocale diversificata offerte dai modelli di diffusione. Inoltre, il framework StyleTTS2 utilizza anche un modello linguistico di sintesi vocale pre-addestrato come discriminatore, come il framework WavLM, e lo accoppia con un approccio di modellazione della durata differenziale innovativo per addestrare il framework end-to-end, generando così sintesi vocali con una maggiore naturalità. Grazie all’approccio che segue, il framework StyleTTS2 supera i framework di sintesi vocale attuali per le attività di generazione di sintesi vocale e rappresenta uno dei framework più efficienti per l’addestramento di modelli di sintesi vocale su larga scala in ambiente zero-shot per attività di adattamento del parlante.

Proseguendo, per fornire una sintesi testo-vocale a livello umano, il framework StyleTTs2 incorpora le conoscenze dagli studi esistenti, tra cui modelli di diffusione per la sintesi vocale e modelli linguistici di sintesi vocale su larga scala. I modelli di diffusione vengono solitamente utilizzati per le attività di sintesi vocale grazie alle loro capacità di controllo fine della sintesi vocale e alle capacità di campionamento della sintesi vocale diversificata. Tuttavia, i modelli di diffusione non sono così efficienti come i framework non iterativi basati su GAN e un motivo principale è la necessità di campionare rappresentazioni latenti, forme d’onda e mel-spettrogrammi in modo iterativo fino alla durata del target della sintesi vocale.

D’altra parte, gli studi recenti sui modelli linguistici di sintesi vocale su larga scala hanno indicato la loro capacità di migliorare la qualità della generazione di sintesi vocale e di adattarsi bene al parlante. I modelli linguistici di sintesi vocale su larga scala convertono solitamente l’input del testo in rappresentazioni quantizzate o continue derivate da framework di sintesi vocale pre-addestrati per le attività di ricostruzione della sintesi vocale. Tuttavia, le caratteristiche di questi modelli linguistici non sono ottimizzate direttamente per la sintesi vocale. Al contrario, il framework StyleTTS2 sfrutta le conoscenze acquisite dai modelli linguistici su larga scala utilizzando l’addestramento avversario per sintetizzare le caratteristiche dei modelli linguistici senza utilizzare mappe dello spazio latente, e quindi imparando uno spazio latente ottimizzato per la sintesi vocale direttamente.

StyleTTS2: Architettura e Metodologia

Al suo nucleo, il StyleTTS2 è costruito sul suo predecessore, il framework StyleTTS, che è un framework di testo-vocale non autoregressivo che utilizza un encoder di stile per derivare un vettore di stile dall’audio di riferimento, consentendo così la generazione di sintesi vocali naturali ed espressive. Il vettore di stile utilizzato nel framework StyleTTS viene incorporato direttamente nell’encoder, nella durata e nei predictor utilizzando l’AdaIN o la normalizzazione delle istanze adattiva, consentendo così al modello StyleTTS di generare output di sintesi vocale con prosodia, durata ed emozioni variabili. Il framework StyleTTS consiste di 8 modelli in totale, divisi in tre categorie

- Modelli acustici o sistema di generazione di sintesi vocale con un encoder di stile, un encoder di testo e un decoder di sintesi vocale.

- Sistema di previsione testo-vocale che utilizza predictor di prosodia e durata.

- Sistema di utilità che include un allineatore di testo, un estrattore di pitch e un discriminatore per l’addestramento.

Grazie al suo approccio, il framework StyleTTS fornisce prestazioni all’avanguardia relative alla sintesi vocale controllabile e diversificata. Tuttavia, questa prestazione ha i suoi svantaggi, come la degradazione della qualità del campione, le limitazioni espressive e la dipendenza dalle applicazioni di sintesi vocale in tempo reale.

Migliorando il framework StyleTTS, il modello StyleTTS2 produce una sintesi testo-vocale espressiva migliorata con una prestazione fuori distribuzione migliorata e una qualità a livello umano. Il framework StyleTTS2 utilizza un processo di addestramento end-to-end che ottimizza i diversi componenti con l’addestramento avversario e la sintesi diretta delle forme d’onda congiuntamente. A differenza del framework StyleTTS, il framework StyleTTS2 modella lo stile di sintesi vocale come una variabile latente e lo campiona tramite modelli di diffusione, generando così campioni di sintesi vocale diversificati senza utilizzare un input audio di riferimento. Vediamo questi componenti in maggiore dettaglio.

Addestramento end-to-end per l’interferenza

Nel framework StyleTTS2, viene utilizzato un approccio di addestramento end-to-end per ottimizzare i diversi componenti di testo-vocale per l’interferenza senza dover fare affidamento su componenti fissi. Il framework StyleTTS2 raggiunge ciò modificando il decoder per generare la forma d’onda direttamente dal vettore di stile, dalle curve di pitch ed energia e dalle rappresentazioni allineate. Il framework quindi rimuove l’ultimo livello di proiezione del decoder e lo sostituisce con un decoder di forma d’onda. Il framework StyleTTS2 utilizza due encoder: un decoder basato su HifiGAN per generare la forma d’onda direttamente e un decoder basato su iSTFT per produrre fase e magnitudine che vengono convertite in forme d’onda per un’interferenza e un addestramento più veloci.

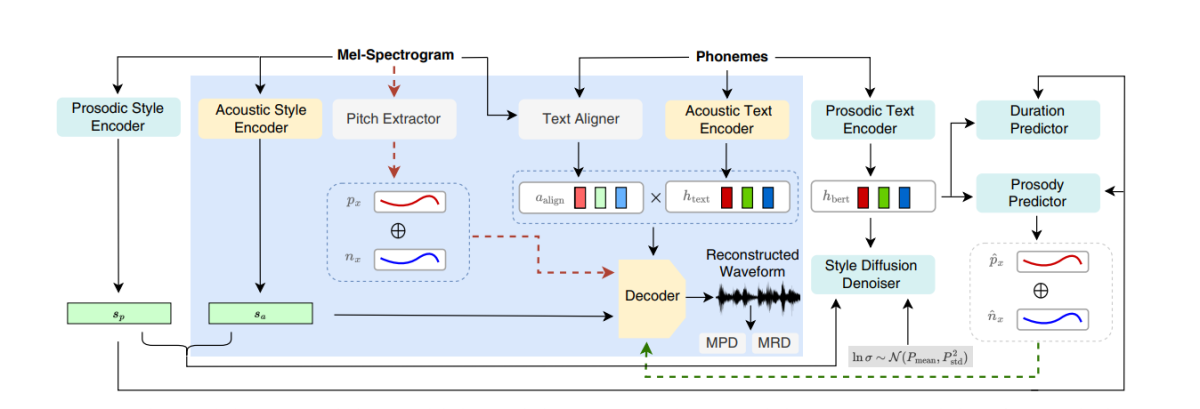

La figura sopra rappresenta i modelli acustici utilizzati per l’addestramento pre-iniziale e congiunto. Per ridurre il tempo di addestramento, i moduli vengono ottimizzati nella fase di pre-addestramento, seguiti dall’ottimizzazione di tutti i componenti tranne l’estrattore di pitch durante l’addestramento congiunto. Il motivo per cui l’addestramento congiunto non ottimizza l’estrattore di pitch è che viene utilizzato per fornire la verità di pitch per le curve di pitch.

La figura sopra rappresenta l’addestramento avversario del modello linguistico di sintesi vocale e l’interferenza con il framework WavLM pre-addestrato ma non pre-ottimizzato. Il processo differisce da quello menzionato sopra in quanto può accettare input di testo variabili ma accumula i gradienti per aggiornare i parametri in ogni batch.

Diffusione di stile

Il framework StyleTTS2 mira a modellare la sintesi vocale come una distribuzione condizionale attraverso una variabile latente che segue la distribuzione condizionale, e questa variabile è chiamata stile di sintesi vocale generalizzato, e rappresenta qualsiasi caratteristica nel campione di sintesi vocale al di là dell’ambito del contenuto fonetico, tra cui lo stress lessicale, la prosodia, la velocità di parlato e persino le transizioni di formante.

Discriminatori del modello linguistico di sintesi vocale

I modelli linguistici di sintesi vocale sono noti per le loro capacità generali di codificare informazioni preziose su una vasta gamma di aspetti semantici e acustici, e le rappresentazioni dei modelli linguistici sono tradizionalmente in grado di mimare la percezione umana per valutare la qualità della sintesi vocale generata. Il framework StyleTTS2 utilizza un approccio di addestramento avversario per sfruttare la capacità degli encoder dei modelli linguistici di eseguire attività generative, e impiega un framework WavLM a 12 livelli come discriminatore. Questo approccio consente al framework di abilitare l’addestramento su testi fuori distribuzione (OOD) che possono aiutare a migliorare le prestazioni. Inoltre, per prevenire problemi di overfitting, il framework campiona testi OOD e in-distribuzione con probabilità uguali.

Modellazione della durata differenziabile

Tradizionalmente, un predictor di durata viene utilizzato nei framework di testo-vocale che produce durate di fonemi, ma i metodi di upsampling che questi predictor di durata utilizzano spesso bloccano il flusso del gradiente durante il processo di addestramento end-to-end, e il framework NaturalSpeech impiega un upsampler basato sull’attenzione per la conversione testo-vocale a livello umano. Tuttavia, il framework StyleTTS2 trova questo approccio instabile durante l’addestramento avversario perché il framework StyleTTS2 si addestra utilizzando l’upsampling differenziabile con l’addestramento avversario senza la perdita di termini aggiuntivi a causa della mancanza di allineamento a causa delle deviazioni. Sebbene utilizzare un approccio di warping temporale dinamico morbido possa aiutare a mitigare questo mancanza di allineamento, utilizzarlo non è solo computazionalmente costoso, ma la sua stabilità è anche una preoccupazione quando si lavora con obiettivi avversari o attività di ricostruzione della melodia. Pertanto, per raggiungere prestazioni a livello umano con l’addestramento avversario e stabilizzare il processo di addestramento, il framework StyleTTC2 utilizza un approccio di upsampling non parametrico. L’upsampling gaussiano è un approccio di upsampling non parametrico popolare per la conversione delle durate previste, sebbene abbia le sue limitazioni grazie alla lunghezza fissa dei kernel gaussiani predefiniti. Questa limitazione per l’upsampling gaussiano limita la sua capacità di modellare allineamenti con lunghezze diverse.

Per affrontare questa limitazione, il framework StyleTTC2 propone di utilizzare un nuovo approccio di upsampling non parametrico senza ulteriore addestramento, e in grado di gestire lunghezze di allineamento variabili. Per ogni fonema, il framework StyleTTC2 modella l’allineamento come una variabile casuale, e indica l’indice del frame di sintesi vocale con cui il fonema si allinea.

Addestramento e valutazione del modello

Il framework StyleTTC2 viene addestrato e sperimentato su tre dataset: VCTK, LibriTTS e LJSpeech. Il componente a parlante singolo del framework StyleTTS2 viene addestrato utilizzando il dataset LJSpeech che contiene circa 13.000+ campioni audio divisi in 12.500 campioni di addestramento, 100 campioni di convalida e circa 500 campioni di test, con un tempo di esecuzione totale di circa 24 ore. Il componente multi-parlante del framework viene addestrato sul dataset VCTK che consiste di oltre 44.000 clip audio con oltre 100 parlanti nativi con accenti variabili, e viene diviso in 43.500 campioni di addestramento, 100 campioni di convalida e circa 500 campioni di test. Infine, per dotare il framework delle capacità di adattamento zero-shot, il framework viene addestrato sul dataset combinato LibriTTS che consiste di clip audio per un totale di circa 250 ore di audio con oltre 1.150 parlanti individuali. Per valutare le sue prestazioni, il modello impiega due metriche: MOS-N o Punteggio di opinione medio di naturalità, e MOS-S o Punteggio di opinione medio di somiglianza.

Risultati

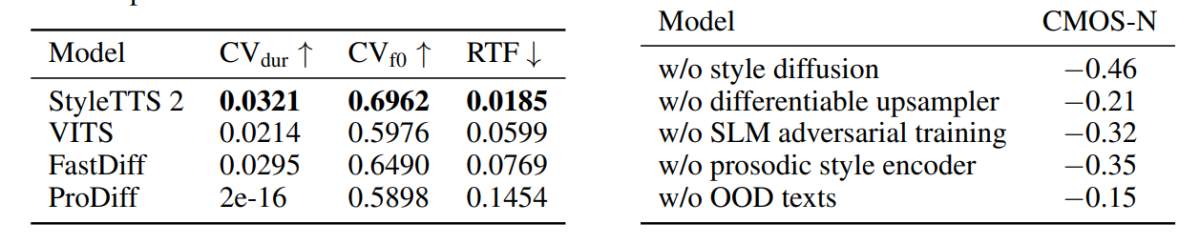

L’approccio e la metodologia utilizzati nel framework StyleTTS2 sono dimostrati dalle sue prestazioni, poiché il modello supera diversi framework di sintesi vocale all’avanguardia, in particolare nel dataset NaturalSpeech, e stabilisce un nuovo standard per il dataset. Inoltre, il framework StyleTTS2 supera il framework VITS all’avanguardia nel dataset VCTK, e i risultati sono mostrati nella figura seguente.

Il modello StyleTTS2 supera anche i modelli precedenti nel dataset LJSpeech, e non mostra alcun grado di degrado della qualità sui testi fuori distribuzione (OOD) come mostrato dai framework precedenti sulle stesse metriche. Inoltre, in ambiente zero-shot, il modello StyleTTC2 supera il framework esistente Vall-E in termini di naturalità, sebbene sia indietro in termini di somiglianza. Tuttavia, è importante notare che il framework StyleTTS2 è in grado di raggiungere prestazioni competitive nonostante sia stato addestrato solo su 245 ore di campioni audio quando confrontato con oltre 60k ore di addestramento per il framework Vall-E, dimostrando così che il framework StyleTTC2 è un’alternativa efficiente in termini di dati ai metodi di pre-addestramento esistenti come quelli utilizzati nel framework Vall-E.

Proseguendo, a causa della mancanza di dati audio etichettati con emozioni, il framework StyleTTC2 utilizza il modello GPT-4 per generare oltre 500 istanze in diverse emozioni per la visualizzazione dei vettori di stile che il framework crea utilizzando il suo processo di diffusione.

Nella prima figura, gli stili emotivi in risposta ai sentimenti del testo di input sono illustrati dai vettori di stile del modello LJSpeech, e dimostra la capacità del framework StyleTTC2 di sintetizzare sintesi vocali espressive con emozioni variabili. La seconda figura mostra cluster distinti per ciascuno dei cinque parlanti individuali, mostrando così una vasta gamma di diversità derivata da un singolo file audio. La figura finale mostra un cluster lasco di emozioni del parlante 1, e rivela che, nonostante alcune sovrapposizioni, i cluster basati sulle emozioni sono prominenti, indicando così la possibilità di manipolare il tono emotivo di un parlante indipendentemente dal campione audio di riferimento e dal suo tono di input. Nonostante utilizzi un approccio basato sulla diffusione, il framework StyleTTS2 riesce a superare i framework esistenti all’avanguardia, tra cui VITS, ProDiff e FastDiff.

Pensieri finali

In questo articolo, abbiamo parlato di StyleTTS2, un framework di testo-vocale innovativo e robusto costruito sulle fondamenta del framework StyleTTS, e che mira a presentare il prossimo passo verso sistemi di sintesi vocale all’avanguardia. Il framework StyleTTS2 modella gli stili di sintesi vocale come variabili casuali latenti e utilizza un modello di diffusione probabilistico per campionare questi stili di sintesi vocale o variabili casuali, consentendo così al framework StyleTTS2 di sintetizzare sintesi vocali realistiche senza utilizzare input audio di riferimento. Il framework StyleTTS2 utilizza la diffusione di stile e i discriminatori del modello linguistico per raggiungere prestazioni a livello umano nelle attività di testo-vocale, e riesce a superare i framework esistenti all’avanguardia in una vasta gamma di attività di sintesi vocale.