interviste

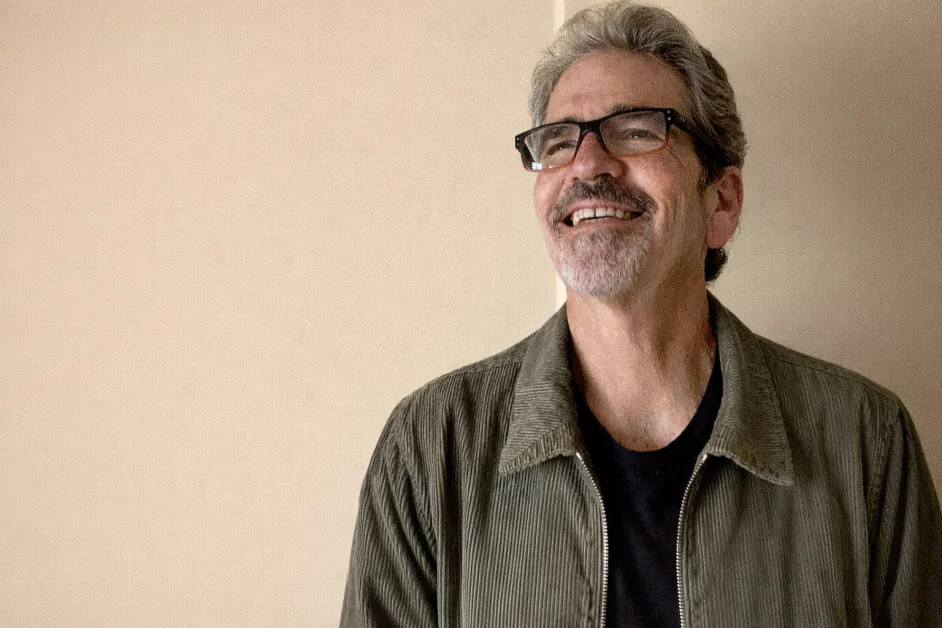

Steve Nemzer, Direttore Senior, Crescita e Innovazione nell'IA, TELUS Digital – Serie di interviste

Steve NemzerNemzer, Senior Director, AI Growth & Innovation di TELUS Digital, guida iniziative incentrate sul progresso dei dati di addestramento e dell'infrastruttura per i sistemi di intelligenza artificiale di nuova generazione. Il suo lavoro comprende lo sviluppo di dataset per modelli di ricerca approfondita, ambienti di apprendimento per rinforzo, dati di modelli globali, iniziative di IA sovrana e framework di mitigazione del rischio IA, con una forte enfasi sulle pratiche di IA responsabile, come affrontare i bias nei dataset e supportare condizioni di lavoro eque per gli addestratori di IA. All'inizio della sua carriera, Nemzer ha fondato VeriTest Labs, aiutando i leader tecnologici emergenti, tra cui Microsoft, Intel, Oracle e Sun Microsystems, a costruire fiorenti ecosistemi di software di terze parti prima che l'azienda venisse acquisita da Lionbridge.

TELUS Digital è un'azienda globale di servizi tecnologici che aiuta le organizzazioni a progettare, costruire e gestire piattaforme digitali e soluzioni basate sull'intelligenza artificiale. Operando in decine di paesi, l'azienda fornisce servizi come dati di addestramento e annotazione per l'IA, ingegneria di prodotti digitali e gestione dell'esperienza del cliente. Le sue piattaforme e i suoi servizi supportano le imprese di diversi settori, tra cui tecnologia, finanza, sanità, telecomunicazioni e videogiochi, nella modernizzazione delle operazioni e nell'implementazione di funzionalità avanzate di intelligenza artificiale.

Considerata la tua esperienza nel campo dei test di intelligenza artificiale, della convalida dei dati e dell'implementazione responsabile, come vedi il passaggio dall'IA generativa basata sul linguaggio ai modelli del mondo reale che mirano a ragionare su situazioni e risultati del mondo reale, in particolare nel tuo attuale ruolo in TELUS Digital?

I modelli linguistici di grandi dimensioni (LLM) sono fondamentalmente sistemi di predizione di pattern. Generano risposte prevedendo il token successivo sulla base di pattern appresi da grandi corpus statici. Sebbene questo possa sembrare un ragionamento, il modello in realtà non modella come le azioni cambiano lo stato del mondo.

I modelli del mondo adottano un approccio diverso. Invece di prevedere la parola o il token successivo, mirano a prevedere lo stato successivo di un sistema modellando le transizioni di stato. Ciò consente ai sistemi di simulare come gli ambienti si evolvono in risposta alle azioni. In pratica, questo apre la strada al ragionamento ipotetico, in cui un modello può valutare diversi possibili risultati prima di prendere una decisione. Per i sistemi interattivi, questo può supportare un processo decisionale e una pianificazione più affidabili.

Questo cambiamento modifica anche il nostro modo di pensare all'implementazione responsabile. Con i sistemi di intelligenza artificiale generativa tradizionali, gran parte dell'attenzione si è concentrata su problematiche come pregiudizi e allucinazioni. Man mano che i modelli si evolvono verso il ragionamento su ambienti e azioni, altri rischi diventano più rilevanti.

Ad esempio, le organizzazioni devono considerare il divario "da simulazione a realtà", in cui i comportamenti appresi in ambienti simulati potrebbero non tradursi in modo preciso in condizioni reali. Anche lo spostamento della distribuzione diventa una preoccupazione fondamentale, poiché gli ambienti che i modelli incontrano durante l'implementazione potrebbero differire dai dati su cui sono stati addestrati.

È qui che i test e la validazione diventano cruciali, e questo è un aspetto fondamentale del mio ruolo in TELUS Digital. Man mano che i sistemi di intelligenza artificiale si evolvono dalla semplice generazione del linguaggio a sistemi che interagiscono con l'ambiente e prendono decisioni, le organizzazioni necessitano di framework di valutazione rigorosi per garantire che i modelli si comportino in modo affidabile in condizioni reali.

Molte persone hanno familiarità con i modelli linguistici di grandi dimensioni, ma molte meno comprendono i modelli del mondo. In termini semplici, qual è il problema che i modelli del mondo cercano di risolvere e che i modelli linguistici di grandi dimensioni (LLM) faticano a superare?

Un modello del mondo è un sistema in grado di prevedere "cosa succederà dopo" dato uno stato attuale e un'azione. La formula è: Stato + Azione → Stato successivo

Se tengo in mano una mela e la lascio cadere, un modello del mondo prevede che la mela cada. Non si limita a sapere che aspetto hanno le mele o cosa si dice delle mele che cadono, ma prevede le conseguenze basandosi sulla comprensione della fisica. Un modello del mondo sofisticato prevederà cosa accadrebbe se facessi la stessa cosa mentre mi trovo sulla Stazione Spaziale Internazionale rispetto a quando mi trovo sulla superficie terrestre.

Questo è diverso da un LLM. Un LLM prevede: "Data questa sequenza di token, quale token viene dopo?". Viene addestrato su testi, ovvero su ciò che gli esseri umani hanno scritto sul mondo, non sul mondo stesso. Può dirti che le mele cadute cadono perché ha letto di questo. Ma non ha un motore fisico interno che simula la caduta.

In altre parole, i modelli linguistici sono bravi a prevedere statisticamente la parola successiva in una risposta a una domanda, ma la comprensione del mondo reale va oltre la descrizione e la coesione del linguaggio. I modelli del mondo mirano a comprendere come le situazioni si evolvono passo dopo passo, qual è lo stato successivo dato lo stato attuale e l'azione che sta per verificarsi, quali sono i vincoli.

I modelli globali vengono spesso descritti come strumenti che consentono ai sistemi di intelligenza artificiale di simulare i risultati prima di agire. Come si traduce questo nella pratica e quanto siamo vicini a vederlo funzionare in modo affidabile al di fuori degli ambienti di ricerca?

Una delle difficoltà nel rispondere a questa domanda risiede nel fatto che il termine "modello del mondo" viene utilizzato in modo piuttosto generico e il suo significato tende a cambiare a seconda del contesto. Una semplice definizione di modello del mondo è che esso permette a un agente di simulare il proprio ambiente attuale, prevedere gli stati futuri e ragionare sulle conseguenze a valle. I ricercatori tendono a classificare i modelli del mondo in modo più granulare, in base ai metodi di rappresentazione ed elaborazione. Esistono modelli del mondo latenti, che distillano l'"essenza" di un ambiente in uno spazio compatto e focalizzato. Esistono modelli del mondo generativi, che "comprendono" la fisica per creare rappresentazioni visive fotogramma per fotogramma, e modelli JEPA (Joint-Embedding Predictive Architecture), che prevedono i risultati a partire da azioni passate.

I modelli del mondo latente sono già usciti dai laboratori di ricerca e sono utilizzati in applicazioni come la guida autonoma, le operazioni di magazzino, le operazioni industriali e l'agricoltura. I modelli del mondo generativi stanno comparendo nella creazione di dati sintetici per lo sviluppo di motori di gioco, per casi d'uso di guida autonoma, casi d'uso di IA incarnata per la simulazione video di movimenti simili a quelli umani e per creare rendering architettonici,

L'approccio JEPA, apprezzato da luminari del settore come Yan LeCun, prevede i risultati in uno spazio di rappresentazione astratto anziché generare pixel. I robot sono stati finora confinati in ambienti controllati, ma JEPA sta cambiando questa situazione, consentendo loro di operare in contesti aperti e reali. I veicoli autonomi ne sono un buon esempio: alcuni utilizzano Genie 3 per generare simulazioni interattive iperrealistiche a scopo di addestramento e per gestire al meglio eventi rari come i cantieri stradali.

Ovviamente, sono necessari molti più test di sicurezza e affidabilità per poter estendere l'utilizzo di questi modelli dagli ambienti di test al mondo reale.

Dal punto di vista aziendale, in quali ambiti prevedete che i modelli globali apportino per primi un valore significativo: nella robotica, nei sistemi decisionali autonomi, nei gemelli digitali o in contesti aziendali più astratti?

La mia sensazione è che i gemelli digitali forniranno innanzitutto un valore pratico. Replicando lo stato di un sistema reale, potremo testare diversi scenari prima di agire. Ad esempio, in un sistema di catena di approvvigionamento, un produttore può creare un gemello digitale della sua rete di partner. La simulazione può essere alimentata da dati provenienti da sensori, registri e dati di telemetria e può rispondere a domande come "Cosa succederebbe se lo Stretto di Hormuz venisse chiuso?". In questo modo, possiamo testare la riorganizzazione dei percorsi di spedizione prima di modificare effettivamente la logistica. Questo ci permette di passare dal monitoraggio di un sistema reale alla simulazione di un sistema reale.

Lo sviluppo di modelli globali significativi per la robotica procede di pari passo. La capacità dei robot di comprendere le proprietà fondamentali della fisica, come l'attrito su una superficie quando afferrano un oggetto, darà un forte impulso alla diffusione dell'intelligenza artificiale incarnata.

Gran parte della tua carriera si è concentrata sulla raccolta, l'annotazione e la validazione di set di dati. Come cambiano le sfide relative ai dati quando si passa dall'addestramento con testi statici all'insegnamento ai sistemi di come il mondo si comporta nel tempo?

La situazione relativa alla raccolta dati per lo sviluppo di modelli del mondo richiede un profondo cambiamento rispetto ai metodi di addestramento LLM del passato. Innanzitutto, non disponiamo di un corpus gigantesco di dati di pre-addestramento, petabyte provenienti da Common Crawl e miliardi di pagine web. Alcuni ricercatori nel campo della robotica hanno ipotizzato che abbiamo a disposizione solo un millesimo della quantità di dati necessaria per addestrare modelli di intelligenza fisica e del mondo, per raggiungere un livello di prestazioni equivalente, ad esempio, a quello di GPT-2.

Ci vorrà quindi del tempo per costruire questi dataset. Nel caso dell'IA incarnata, avremo bisogno di milioni di ore di dataset multisensore egocentrici annotati. Alcuni teleoperati, altri provenienti da ambienti sintetici come Isaac Sim. Noi di TELUS DIGITAL abbiamo effettuato la transizione dai dataset testuali a quelli multimodali, multisensore e di simulazione. Naturalmente, siamo aiutati dalla nostra solida esperienza nella raccolta e nell'annotazione di dati nel campo della visione artificiale. Siamo all'avanguardia in questo settore da molti anni.

Oltre alla scarsità di dati di pre-addestramento e di dati di fine-tuning annotati, ci saranno molte altre sfide di addestramento nell'ampliamento dell'apprendimento per rinforzo. Potrebbero essere necessari nuovi paradigmi trasformativi (senza giochi di parole) come GPT e i concetti di RL per accelerare i progressi in termini di efficienza nei metodi di addestramento dei modelli del mondo.

I modelli globali influenzano le decisioni anziché limitarsi a generare risultati. Quali nuovi rischi per la sicurezza o la governance introduce questo approccio rispetto ai sistemi di intelligenza artificiale generativa?

Esistono numerosi rischi per la sicurezza e la governance, poiché i modelli globali sono intrinsecamente progettati per supportare operazioni automatizzate. Pertanto, tutte le preoccupazioni che nutriamo riguardo all'attuale generazione di agenti di intelligenza artificiale rimangono valide anche nello scenario dei modelli globali. Abbiamo bisogno della supervisione umana per tutte le decisioni importanti, che si tratti di sicurezza dei trasporti, sicurezza sul lavoro, assistenza sanitaria, finanza o attività quotidiane.

Un esempio specifico per i modelli del mondo reale è la discrepanza tra i dati di addestramento della simulazione e gli ambienti del mondo reale. Una variazione microscopica della superficie può rendere il mondo reale caotico per i robot ben addestrati in simulazione.

Un altro rischio è legato al comportamento umano. Man mano che i sistemi diventano sempre più autonomi, gli esseri umani inizieranno a farvi eccessivo affidamento, la supervisione potrebbe allentarsi e, alla fine, il sistema non riceverà le necessarie ricalibrazioni.

I pregiudizi e la mancanza di fiducia rimangono ostacoli importanti all'adozione dell'IA. Come si evolvono queste preoccupazioni quando i sistemi di IA iniziano a modellare e ad agire all'interno di ambienti complessi del mondo reale o sociale?

Dal grande pubblico ai vertici aziendali, la fiducia nei modelli di intelligenza artificiale è già piuttosto bassa e non prevedo grandi cambiamenti nel breve termine.

Le preoccupazioni relative alla concentrazione del potere dell'IA nelle mani di pochi, alla possibile perdita di posti di lavoro, ai pregiudizi che potrebbero svantaggiare i gruppi sottorappresentati, alla possibilità che i modelli prendano decisioni che influenzano la salute, la carriera e le finanze delle persone, all'utilizzo della proprietà intellettuale senza consenso da parte dei modelli, nonché alla minaccia dei deepfake generati dall'IA, sono già molto elevate. I dirigenti temono di dover gestire la transizione della forza lavoro, la privacy dei dati e la conformità normativa, oltre a perdere terreno rispetto alla concorrenza in una vera e propria "corsa agli armamenti" dell'IA.

Le recenti notizie riguardanti le pressioni governative sui creatori di modelli di base per l'intelligenza artificiale affinché allentino le condizioni d'uso relative a cose come armi autonome o sorveglianza di massa non fanno che amplificare queste preoccupazioni. La diffusione su larga scala di robot più intelligenti e autonomi basati su modelli del mondo avrà lo stesso effetto.

D'altro canto, stiamo assistendo a sacche di adozione e fiducia diffuse nell'IA. Un esempio è la rapida diffusione degli agenti di codifica negli ultimi due mesi. I responsabili dello sviluppo software ripongono grande fiducia negli agenti di codifica e si sta verificando un cambiamento fondamentale nel modo in cui viene svolto lo sviluppo del software, dallo sviluppo del PRD fino ai test di regressione post-rilascio. Il mondo dello sviluppo software si sta evolvendo a velocità vertiginosa, e gran parte di questo è dovuto alla fiducia negli agenti di codifica ad alte prestazioni. Man mano che la fiducia degli utenti cresce in altri casi d'uso, mi aspetto che l'adozione decolli in modo simile.

Le soluzioni per costruire la fiducia includono l'utilizzo di diversi set di dati e ambienti nelle fasi di addestramento, nonché un'ampia attività di red teaming e stress test come misura di sicurezza prima del rilascio. Anche una supervisione normativa proattiva è fondamentale. Alcuni hanno suggerito che i creatori dei modelli di base siano obbligati a fornire "Rapporti di impatto sociale", simili ai Rapporti di impatto ambientale (VIA), prima del rilascio di nuovi modelli.

In TELUS Digital, gran parte del lavoro consiste nell'implementare l'intelligenza artificiale su larga scala per aziende e utenti reali. In che modo concetti come i modelli globali si intersecano con problematiche pratiche quali la trasparenza, l'impatto sulla forza lavoro e il mantenimento della fiducia dei clienti?

Per chiarire, TELUS Digital collabora sia a monte, direttamente con chi sviluppa i modelli di base, sia a valle, con le aziende che implementano modelli di intelligenza artificiale. Il nostro campo d'azione è end-to-end:

La questione relativa alle problematiche pratiche è collegata alla precedente domanda sulla fiducia. Analizziamo la fiducia dei dipendenti. Con la crescente diffusione delle IA basate su modelli del mondo, i dirigenti devono essere trasparenti con dipendenti, collaboratori e clienti. È fondamentale comunicare in modo chiaro le capacità dei modelli, le modalità di addestramento, i dati utilizzati, le misure di sicurezza implementate e il ruolo della supervisione umana. I leader aziendali devono dimostrare ai dipendenti il valore dei nuovi modelli, ad esempio la possibilità di svolgere compiti ripetitivi e di routine. Devono inoltre illustrare i percorsi di transizione per i lavoratori interessati, che potrebbero passare a nuove professioni emergenti man mano che le precedenti vengono sostituite dalle IA basate su modelli del mondo. I lavoratori del settore terziario si trovano ad affrontare questa situazione in tempo reale e molti lavori manuali saranno interessati nei prossimi anni con l'espansione dell'automazione basata su modelli del mondo.

Esiste un divario crescente tra ciò che i ricercatori nel campo dell'IA comprendono e ciò che il pubblico percepisce. Come possono le organizzazioni comunicare progressi come i modelli globali in modo da creare fiducia senza esagerare le proprie capacità?

Anche in questo caso, tutto si riduce alla trasparenza sui limiti dei modelli e sui loro punti di forza. È fondamentale comunicare come i modelli sono stati addestrati per mitigare potenziali distorsioni e quale supervisione umana è prevista. Alcune dimostrazioni concrete delle capacità e dei casi d'uso del modello, unitamente a studi longitudinali, possono contribuire notevolmente ad aumentare la fiducia del pubblico e dei lavoratori.

Infine, qual è un equivoco comune sui modelli del mondo basati sull'IA, sia esso eccessivamente ottimistico o eccessivamente cauto, che a tuo avviso deve essere corretto immediatamente?

Nella misura limitata in cui il pubblico in generale è informato sui modelli mondiali, un'idea sbagliata è che i modelli mondiali debbano comprendere contro tutti i di fisica e scienza per essere efficaci. I modelli globali saranno implementati prima di quanto ci si possa aspettare perché i singoli casi d'uso possono essere circoscritti. Un veicolo autonomo deve solo comprendere le dinamiche del traffico e la fisica relativa alla strada, e come le condizioni attuali (ad esempio, la vicinanza a una scuola elementare o la presenza di numerosi SUV con sagome alte nelle vicinanze) influenzeranno la sua visione e il suo processo decisionale. Un veicolo autonomo non ha bisogno della fisica che sta alla base della cottura di un soufflé per funzionare.

Grazie per l'ottima intervista, i lettori che desiderano saperne di più dovrebbero visitare TELUS Digital.