Intelligenza artificiale

Le nostre abilità subconscie di rilevamento dei Deepfake potrebbero alimentare i sistemi automatizzati del futuro

Nuove ricerche dall’Australia suggeriscono che il nostro cervello è abile nel riconoscere deepfake sofisticati, anche quando crediamo consapevolmente che le immagini che stiamo vedendo siano reali.

Il risultato implica inoltre la possibilità di utilizzare le risposte neurali delle persone ai volti deepfake (piuttosto che le loro opinioni dichiarate) per addestrare sistemi automatizzati di rilevamento dei deepfake. Tali sistemi sarebbero addestrati sulle caratteristiche deepfake delle immagini, non su stime confuse di plausibilità, ma sui nostri meccanismi percettivi istintivi per il riconoscimento dell’identità facciale.

‘[A]lthough il cervello può ‘riconoscere’ la differenza tra volti reali e volti realistici, gli osservatori non possono consapevolmente distinguerli. I nostri risultati sulla dissociazione tra risposta cerebrale e comportamento hanno implicazioni per lo studio della percezione dei volti falsi, le domande che poniamo quando chiediamo l’identificazione di immagini false e i possibili modi in cui possiamo stabilire standard di protezione contro l’abuso di immagini false.’

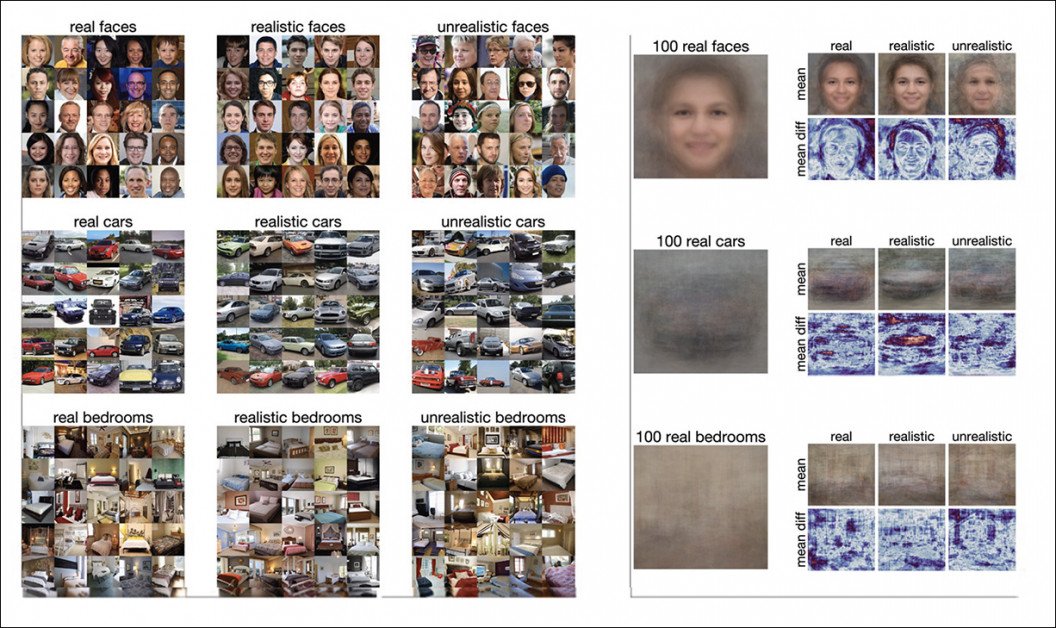

I risultati sono emersi in round di test progettati per valutare il modo in cui le persone rispondono a immagini false, tra cui immagini di volti palesemente falsi, auto, spazi interni e volti invertiti (ovvero capovolti).

Varie iterazioni e approcci per gli esperimenti, che hanno coinvolto due gruppi di soggetti di test che dovevano classificare un’immagine mostrata brevemente come ‘falsa’ o ‘reale’. Il primo round si è svolto su Amazon Mechanical Turk, con 200 volontari, mentre il secondo round ha coinvolto un numero inferiore di volontari che hanno risposto ai test mentre erano collegati a macchine EEG. Source: https://tijl.github.io/tijl-grootswagers-pdf/Moshel_et_al_-_2022_-_Are_you_for_real_Decoding_realistic_AI-generated_.pdf

Il documento afferma:

‘I nostri risultati dimostrano che, date solo una breve occhiata, gli osservatori possono essere in grado di riconoscere i volti falsi. Tuttavia, hanno più difficoltà a distinguere i volti reali da quelli falsi e, in alcuni casi, credono che i volti falsi siano più reali dei volti reali.

‘Tuttavia, utilizzando EEG a risoluzione temporale e metodi di classificazione multivariata, abbiamo trovato che era possibile decodificare sia i volti irrealistici che quelli realistici dai volti reali utilizzando l’attività cerebrale.

‘Questa dissociazione tra comportamento e risposte neurali per i volti realistici fornisce nuove prove importanti sulla percezione dei volti falsi, nonché implicazioni relative alla classe sempre più realistica dei volti generati da GAN.’

Il documento suggerisce che il nuovo lavoro ha ‘diverse implicazioni’ nella sicurezza informatica applicata e che lo sviluppo di classificatori di apprendimento automatico per il rilevamento dei deepfake dovrebbe forse essere guidato dalla risposta subconscia, come misurata sui dati EEG in risposta a immagini false, piuttosto che dalla stima consapevole del soggetto sulla veridicità di un’immagine.

Gli autori commentano*:

‘Ciò ricorda i risultati che individui con prosopagnosia che non possono classificare o riconoscere comportamentalmente i volti come familiari o non familiari, tuttavia, mostrano risposte autonome più forti ai volti familiari rispetto ai volti non familiari.

‘Allo stesso modo, ciò che abbiamo mostrato in questo studio è che, mentre potevamo decodificare accuratamente la differenza tra volti reali e realistici dall’attività neurale, tale differenza non è stata osservata comportamentalmente. Invece, gli osservatori hanno identificato erroneamente il 69% dei volti reali come falsi.’

Il nuovo lavoro è intitolato Sei vero? Decodificare i volti generati da AI realistici dall’attività neurale e proviene da quattro ricercatori dell’Università di Sydney, dell’Università Macquarie, dell’Università del Western Sydney e dell’Università del Queensland.

Dati

I risultati sono emersi da un esame più ampio della capacità umana di distinguere immagini false manifeste, iper-realistiche (ma ancora false) e reali, condotto in due round di test.

I ricercatori hanno utilizzato immagini create da Reti Adversarie Generative (GAN), condivise da NVIDIA.

Immagini di volti umani generate da GAN messe a disposizione da NVIDIA. Source: https://drive.google.com/drive/folders/1EDYEYR3IB71-5BbTARQkhg73leVB9tam

I dati comprendevano 25 volti, auto e camere da letto, a livelli di rendering che variavano da ‘irrealistico’ a ‘realistico’. Per il confronto dei volti (ovvero per il materiale non falso adatto), gli autori hanno utilizzato selezioni dai dati di origine del dataset Flickr-Faces-HQ (FFHQ) di NVIDIA. Per il confronto degli altri scenari, hanno utilizzato materiale dal dataset LSUN.

Le immagini sarebbero state presentate al soggetto di test o nel modo giusto, o capovolte, e a una gamma di frequenze, con tutte le immagini ridimensionate a 256×256 pixel.

Dopo che tutto il materiale era stato assemblato, 450 immagini di stimolo sono state curate per i test.

Test

I test stessi sono stati inizialmente condotti online, attraverso jsPsych su pavlovia.org, con 200 partecipanti che giudicavano vari sottinsiemi dei dati di test totali raccolti. Le immagini sono state presentate per 200ms, seguite da uno schermo vuoto che sarebbe persistito fino a quando il visualizzatore non avesse preso una decisione su se l’immagine mostrata brevemente era ‘falsa’ o ‘reale’. Ogni immagine è stata presentata solo una volta e l’intero test ha richiesto 3-5 minuti per essere completato.

Il secondo round, più rivelatore, ha utilizzato soggetti in persona collegati a monitor EEG e presentato sulla piattaforma Psychopy2. Ogni sequenza di 20 conteneva 40 immagini, con 18.000 immagini presentate in tutta la tranche dei dati di test.

I dati EEG raccolti sono stati decodificati tramite MATLAB con il toolbox CoSMoMVPA, utilizzando uno schema di convalida incrociata lascia-one-out sotto Analisi Discriminante Lineare (LDA).

Il classificatore LDA è stato il componente in grado di fare la distinzione tra la reazione cerebrale agli stimoli falsi e l’opinione del soggetto su se l’immagine era falsa.

Risultati

Interessati a vedere se i soggetti di test EEG potessero discriminare tra i volti falsi e reali, i ricercatori hanno aggregato e elaborato i risultati, scoprendo che i partecipanti potevano distinguere facilmente i volti reali da quelli irrealistici, ma apparentemente hanno faticato a identificare i volti realistici generati da GAN. Se l’immagine era capovolta sembrava fare poca differenza.

Discriminazione comportamentale di volti reali e generati sinteticamente, nel secondo round.

Tuttavia, i dati EEG hanno raccontato una storia diversa.

Il documento afferma:

‘Sebbene gli osservatori abbiano avuto difficoltà a distinguere i volti reali da quelli falsi e tendessero a sovraclassificare i volti falsi, i dati EEG contenevano informazioni di segnale rilevanti per questa distinzione che differivano significativamente tra realistici e irrealistici, e questo segnale sembrava essere limitato a una fase di elaborazione relativamente breve.’

Qui la disparità tra l’accuratezza EEG e l’opinione dichiarata dei soggetti (ovvero se i volti delle immagini fossero falsi) non sono identiche, con le registrazioni EEG che si avvicinano di più alla verità rispetto alla percezione manifesta delle persone coinvolte.

I ricercatori concludono che, sebbene gli osservatori possano avere difficoltà a identificare tacitamente i volti falsi, questi volti hanno ‘rappresentazioni distinte nel sistema visivo umano’.

La disparità trovata ha portato i ricercatori a speculare sulla possibile applicabilità dei loro risultati per future misure di sicurezza:

‘In un contesto applicato come la sicurezza informatica o i Deepfake, esaminare la capacità di rilevamento per i volti realistici potrebbe essere meglio perseguita utilizzando classificatori di apprendimento automatico applicati ai dati di neuroimaging piuttosto che puntare alle prestazioni comportamentali.’

Concludono:

‘Comprendere la dissociazione tra cervello e comportamento per il rilevamento dei volti falsi avrà implicazioni pratiche per il modo in cui affrontiamo la diffusione potenzialmente dannosa e universale di informazioni generate artificialmente.’

* La mia conversione delle citazioni in linea in collegamenti ipertestuali.

Prima pubblicazione l’11 luglio 2022.