Intelligenza artificiale

NeRF: Addestramento di droni in ambienti di radianza neurale

I ricercatori dell’Università di Stanford hanno escogitato un nuovo modo per addestrare i droni a navigare in ambienti fotorealistici e altamente precisi, sfruttando l’ultima ondata di interesse nei campi dei Neural Radiance Fields (NeRF).

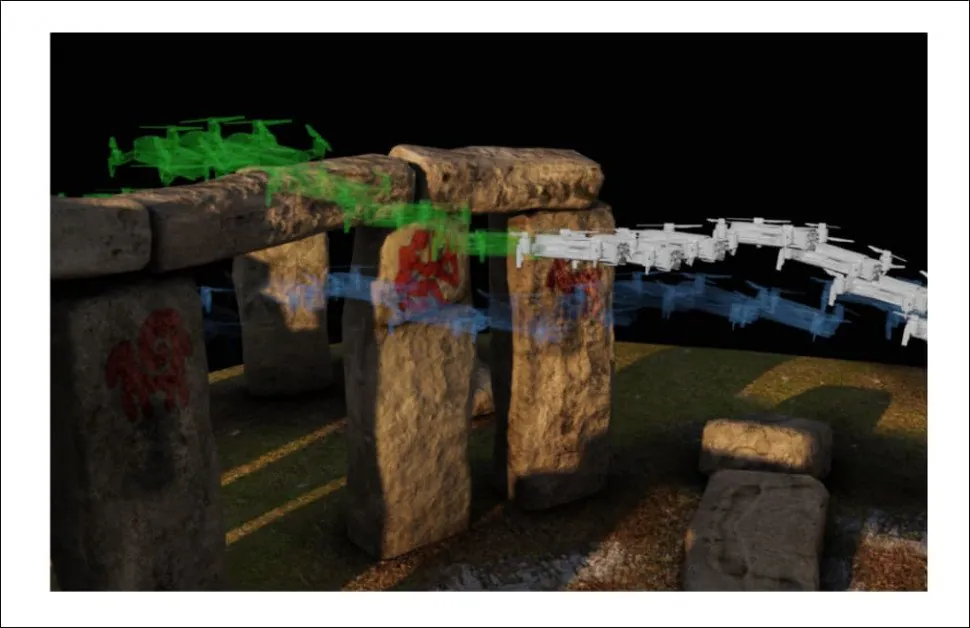

I droni possono essere addestrati in ambienti virtuali mappati direttamente da luoghi reali, senza la necessità di una ricostruzione 3D di scene specializzata. In questa immagine del progetto, è stata aggiunta una perturbazione del vento come potenziale ostacolo per il drone, e possiamo vedere il drone essere momentaneamente deviato dalla sua traiettoria e compensare all’ultimo momento per evitare un potenziale ostacolo. Source: https://mikh3x4.github.io/nerf-navigation/

Il metodo offre la possibilità di addestramento interattivo di droni (o altri tipi di oggetti) in scenari virtuali che includono automaticamente informazioni di volume (per calcolare l’evitamento di collisioni), texture tratte direttamente da foto reali (per aiutare a addestrare le reti di riconoscimento di immagini dei droni in modo più realistico) e illuminazione del mondo reale (per garantire una varietà di scenari di illuminazione vengano addestrati nella rete, evitando la sovra-ottimizzazione o la sovra-ottimizzazione per lo snapshot originale della scena).

Un oggetto-couch naviga un ambiente virtuale complesso che sarebbe stato molto difficile da mappare utilizzando la cattura della geometria e la ritesturizzazione nei flussi di lavoro tradizionali AR/VR, ma che è stato ricreato automaticamente in NeRF da un numero limitato di foto. Source: https://www.youtube.com/watch?v=5JjWpv9BaaE

Le implementazioni tipiche di NeRF non presentano meccanismi di traiettoria, poiché la maggior parte dei progetti NeRF degli ultimi 18 mesi si è concentrata su altre sfide, come la riilluminazione della scena, la renderizzazione delle riflessioni, la composizione e la disintegrazione degli elementi catturati.

NeRF come VR/AR

Il nuovo documento è intitolato Navigazione di robot basata sulla visione in un mondo di radianza neurale, e è una collaborazione tra tre dipartimenti di Stanford: Aeronautica e Astronautica, Ingegneria Meccanica e Informatica.

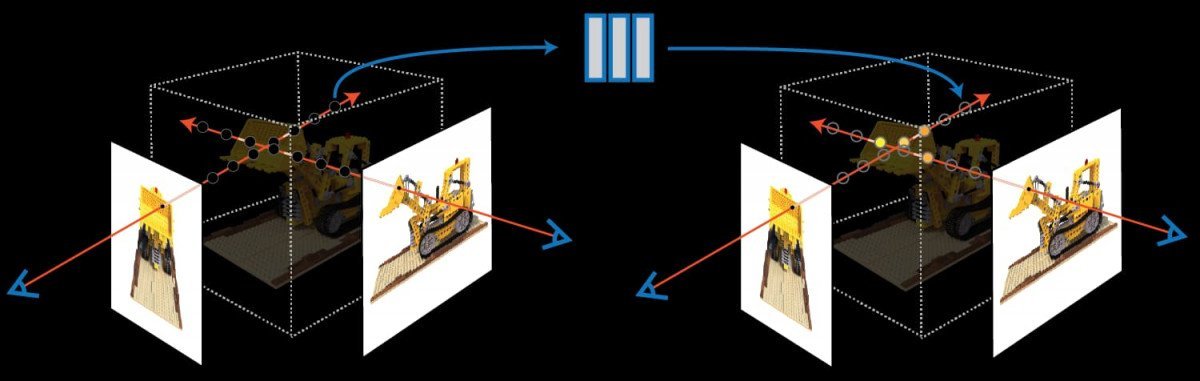

Il lavoro propone un framework di navigazione che fornisce a un robot un ambiente NeRF pre-addestrato, la cui densità di volume delimita i percorsi possibili per il dispositivo. Include anche un filtro per stimare dove si trova il robot all’interno dell’ambiente virtuale, in base al riconoscimento di immagini della fotocamera RGB a bordo del robot. In questo modo, un drone o un robot può “immaginare” più accuratamente ciò che può aspettarsi di vedere in un determinato ambiente.

L’ottimizzatore di traiettoria del progetto naviga attraverso un modello NeRF di Stonehenge generato attraverso la fotogrammetria e l’interpretazione di immagini (in questo caso, di modelli mesh) in un ambiente di radianza neurale. L’ottimizzatore di traiettoria calcola una serie di percorsi possibili prima di stabilire una traiettoria ottimale sopra l’arco.

Poiché un ambiente NeRF presenta occlusioni completamente modellate, il drone può imparare a calcolare gli ostacoli più facilmente, poiché la rete neurale alla base di NeRF può mappare la relazione tra occlusioni e il modo in cui i sistemi di navigazione basati sulla visione a bordo del drone percepiscono l’ambiente. La pipeline di generazione NeRF automatizzata offre un metodo relativamente banale per creare spazi di addestramento iper-realistici con solo alcune foto.

La struttura di ripianificazione online sviluppata per il progetto di Stanford facilita una pipeline di navigazione basata interamente sulla visione e resiliente.

L’iniziativa di Stanford è tra le prime a considerare le possibilità di esplorare uno spazio NeRF nel contesto di un ambiente VR/AR navigabile e immersivo. I campi di radianza neurale sono una tecnologia emergente e attualmente soggetta a numerosi sforzi accademici per ottimizzare le loro elevate esigenze di risorse di calcolo, nonché per disintegrare gli elementi catturati.

NeRF non è (realmente) CGI

Poiché un ambiente NeRF è uno spazio 3D navigabile, è diventata una tecnologia fraintesa dalla sua comparsa nel 2020, spesso ampiamente percepita come un metodo per automatizzare la creazione di mesh e texture, piuttosto che sostituire ambienti 3D familiari agli spettatori dei dipartimenti VFX di Hollywood e delle scene fantastiche degli ambienti di realtà aumentata e virtuale.

NeRF estrae informazioni di geometria e texture da un numero limitato di punti di vista di immagini, calcolando la differenza tra le immagini come informazioni volumetriche. Source: https://www.matthewtancik.com/nerf

In realtà, l’ambiente NeRF è più come uno “spazio di rendering live”, dove un amalgama di informazioni di pixel e di illuminazione viene mantenuto e navigato in una rete neurale attiva e in esecuzione.

La chiave del potenziale di NeRF è che richiede solo un numero limitato di immagini per ricreare ambienti, e che gli ambienti generati contengono tutte le informazioni necessarie per una ricostruzione ad alta fedeltà, senza la necessità dei servizi di modellisti, artisti di texture, specialisti di illuminazione e delle orde di altri contributori alla “tradizionale” CGI.

Segmentazione semantica

Anche se NeRF costituisce effettivamente “Computer-Generated Imagery” (CGI), offre una metodologia completamente diversa e una pipeline altamente automatizzata. Inoltre, NeRF può isolare e “incapsulare” parti in movimento di una scena, in modo che possano essere aggiunte, rimosse, accelerate e generalmente operare come faccette discrete in un ambiente virtuale – una capacità che è ben al di là dello stato attuale dell’arte in un’interpretazione “hollywoodiana” di ciò che è la CGI.

Una collaborazione dell’Università di Tecnologia di Shanghai, rilasciata nell’estate del 2021, offre un metodo per individuare elementi NeRF in movimento in “facette incollabili” per una scena. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Negativamente, l’architettura di NeRF è un po’ una “scatola nera”; attualmente non è possibile estrarre un oggetto da un ambiente NeRF e manipolarlo direttamente con strumenti tradizionali basati su mesh e immagini, anche se numerosi sforzi di ricerca stanno iniziando a fare progressi nel decostruire la matrice dietro gli ambienti di rendering live di NeRF.

https://www.youtube.com/watch?v=5JjWpv9BaaE