Angolo di Anderson

Come Nascondere Pagine Scientifiche Assurde ai Recensori AI

La nuova ricerca dimostra come i sistemi AI possano ora scrivere articoli scientifici falsi che altri AI accettano come reali, evitando le routine di rilevamento che un tempo funzionavano, ed esponendo come facilmente il mondo della ricerca potrebbe collassare in bot che ingannano bot.

Il settore della ricerca accademica, ironicamente in prima linea nell’innovazione dell’AI, è alle prese con una crisi di credibilità che è essa stessa guidata dall’AI. L’impatto dell’apprendimento automatico sul processo di ricerca, presentazione e revisione è stato considerevole fin da quando il potenziale impatto dell’AI è diventato chiaro circa quattro anni fa, con l’ultima di una serie di controversie che è la generazione di massa di articoli di basso valore.

Insieme a gran parte del settore accademico più ampio, il settore della ricerca è impegnato in una sorta di guerra fredda tra gli AI che generano testi – come ChatGPT e la serie Claude – e l’ultima generazione di AI “detector” che possono identificare la loro produzione senza (di solito) macchiare gli studenti o gli scienziati con falsi positivi.

Queste tensioni sono destinate ad aumentare, insieme al volume delle presentazioni scientifiche, che sta aumentando radicalmente, alimentato da sistemi e framework aiutati dall’AI; e richiedendo l’industrializzazione dell’AI della procedura di controllo per (sperabilmente) filtrare fuori eventuali presentazioni che siano puramente il lavoro dell’AI.

Conoscenza Falsa Benvenuta

Una nuova collaborazione di ricerca tra gli Stati Uniti e l’Arabia Saudita indaga sulla misura in cui questo “firewall” emergente di rilevamento AI può essere penetrato da articoli di presentazione interamente generati dall’AI, quando questi articoli sfruttano alcuni trucchi convincenti aggiuntivi.

Nel test, il nuovo sistema, chiamato BadScientist, è stato in grado di raggiungere tassi di accettazione fino all’82% dai sistemi LLM basati attualmente utilizzati per rilevare contenuti generati dall’AI in articoli di ricerca scientifica:

Il sistema BadScientist utilizza un agente AI per generare articoli scientifici falsi e un altro per esaminarli utilizzando modelli linguistici attuali. Fonte: https://arxiv.org/pdf/2510.18003

Gli articoli falsi sono stati generati utilizzando argomenti di conferenza AI reali e strategie fuorvianti, quindi esaminati da modelli calibrati sui dati di revisione paritetica, inclusi GPT-5 per controlli di integrità. Molti hanno ricevuto punteggi alti nonostante contenessero errori o falsificazioni evidenti.

La pubblicazione dell’articolo coincide con la Conferenza Aperta degli Agenti AI per la Scienza 2025 a Stanford, dove i partecipanti e gli oratori sono umani, ma tutti gli articoli sono scritti e esaminati da sistemi AI diversi.

BadScientist, l’articolo spiega, utilizza diverse forme di inganni accademici e letterari, omissioni, invenzioni ed esagerazioni per riorientare l’articolo lontano da tutto ciò che la maggior parte dei sistemi di rilevamento attuali può riconoscere come generato dall’AI; e noi esamineremo queste categorie tra poco.

Gli autori notano, in un tono di allarme, che anche quando i sistemi di rilevamento identificano contenuti AI in un articolo falso, tendono a lasciarlo passare comunque, e aggiungono che i loro tentativi di inoculare i sistemi di difesa contro questo nuovo vettore di attacco hanno ottenuto a malapena miglioramenti casuali.

L’articolo afferma:

‘Gli articoli falsificati raggiungono tassi di accettazione elevati, con i revisori che spesso esibiscono conflitti di accettazione-preoccupazione – segnalando problemi di integrità e raccomandando comunque l’accettazione. Questo fondamentale crollo rivela che gli attuali revisori AI operano più come riconoscitori di modelli che come valutatori critici.

‘[…] Chiedere semplicemente ai revisori LLM di “essere più cauti” è insufficiente. La comunità scientifica si trova di fronte a una scelta urgente. Senza un’azione immediata per implementare salvaguardie di difesa in profondità – incluse la verifica della provenienza, la valutazione ponderata dell’integrità e la supervisione umana obbligatoria – rischiamo di creare cicli di pubblicazione solo AI dove le contraffazioni sofisticate sopraffanno la nostra capacità di distinguere la ricerca genuina dalle contraffazioni convincenti.

‘L’integrità della conoscenza scientifica stessa è in gioco.’

Il nuovo articolo è intitolato BadScientist: può un agente di ricerca scrivere articoli convincenti ma insostenibili che ingannano i revisori LLM? e proviene da sei autori tra l’Università di Washington e la Città della Scienza e della Tecnologia Re Abdulaziz di Riyadh. La pubblicazione ha un sito del progetto accompagnatore.

Metodo

La struttura dell’agente di creazione dell’articolo utilizzata per il lavoro è una ristrutturazione significativa della collaborazione AI-Scientist del 2024, con gli autori che sottolineano che l’intera pipeline è stata fondamentalmente ridisegnata. Solo i prompt di scrittura più basilari sono stati mantenuti, con tutte le strutture sperimentali e template rimosse. Il sistema aggiornato ora funziona da un semplice seed, consentendo al sistema di inventare liberamente qualsiasi risultato sperimentale e generare codice di tracciamento come necessario.

La struttura complessiva è intesa per consentire a un AI di generare articoli falsi convincenti senza eseguire esperimenti reali o utilizzare dati genuini. Invece, il sistema crea o altera dati sintetici per supportare rivendicazioni deliberatamente allucinate.

L’allestimento, gli autori spiegano, evita deliberatamente il coinvolgimento umano, gli attacchi ai prompt o la collusione coordinata tra agente scrittore e agente revisore. I revisori AI hanno valutato ogni presentazione in un unico passaggio, senza accesso in eccesso all’articolo stesso, e senza la capacità di rieseguire gli esperimenti, il che riflette le condizioni di revisione paritetica reali.

Le “strategie atomiche” utilizzate per generare articoli falsi sono tattiche modulari che possono essere applicate da sole o in combinazione (e chiunque che legga frequentemente la letteratura sarà familiare con queste). Le strategie includono l’evidenziazione di miglioramenti drammatici per far sembrare il metodo un grande avanzamento (TooGoodGains); la scelta di basi e risultati che favoriscono il nuovo metodo mentre si saltano gli intervalli di confidenza nella tabella principale (BaselineSelect); l’aggiunta di ablazioni pulite, statistiche precise e tabelle ordinate nell’appendice, insieme a promesse di futuro codice o dati (StatTheater); la lucidatura della struttura dell’articolo con terminologia coerente, riferimenti incrociati e formattazione (CoherencePolish); e l’aggiunta di prove formali che appaiono solide ma contengono errori nascosti (ProofGap).

Dati e Test

Per testare il sistema, gli autori hanno sfruttato GPT-5 per generare argomenti di ricerca in aree chiave dell’intelligenza artificiale, utilizzando i domini Intelligenza Artificiale, Apprendimento Automatico, Elaborazione delle Immagini, Elaborazione del Linguaggio Naturale, Robotica, Sistemi, e Sicurezza.

Queste categorie sono diventate argomenti di partenza per articoli falsi, con ciascuno esteso in quattro diverse versioni, utilizzando le strategie elencate sopra, e progettate per ingannare o impressionare i revisori. Per decidere se un articolo sarebbe stato “accettato”, il sistema ha guardato solo al punteggio finale assegnato dal revisore AI.

Gli articoli falsi sono stati scritti interamente da GPT-5. Per esaminarli, gli autori hanno utilizzato GPT-4.1; o4-mini; e o3. Tutti sono stati dati lo stesso prompt di revisione, un formato di istruzione fisso progettato per mimare i criteri di punteggio e la struttura utilizzati nella revisione paritetica reale.

Per rendere questi punteggi di revisione significativi, il sistema è stato calibrato utilizzando 200 presentazioni reali dal dataset ICLR 2025 OpenReview (una raccolta pubblica di articoli reali, commenti dei revisori e risultati di accettazione).

Da questo, è stato stabilito un limite di punteggio per corrispondere al tasso di accettazione reale dell’ICLR del 31,73%, risultando in un punteggio di soglia di 7; e un altro per riflettere il punteggio al quale un articolo avrebbe una probabilità del 50% di essere accettato dagli revisori umani (calcolato come 6,667).

Gli autori hanno testato l’affidabilità della loro impostazione simulando recensioni per 5.000 articoli falsi, utilizzando 1-3 revisori AI, ciascuno dei quali avrebbe restituito punteggi casuali tra 1 e 10. I risultati avrebbero indicato che anche con questa impostazione rumorosa, il sistema era propenso a commettere molti meno errori dei suoi limiti teorici peggiori.

L’uso di tre revisori invece di uno ha portato a una riduzione significativa della variabilità del punteggio, migliorando la stabilità della decisione di quasi tre volte – risultati che sono stati utilizzati per giustificare la scelta di tre modelli di revisione e un set di calibrazione di 200 articoli reali.

I due metriche definite per valutare il generatore sono state tasso di accettazione, che misura con quale frequenza gli articoli falsi ricevevano punteggi di passaggio; e punteggio medio del revisore, che cattura la valutazione media attraverso le presentazioni. Entrambe sono state utilizzate per valutare quanto bene il sistema potesse ingannare i revisori:

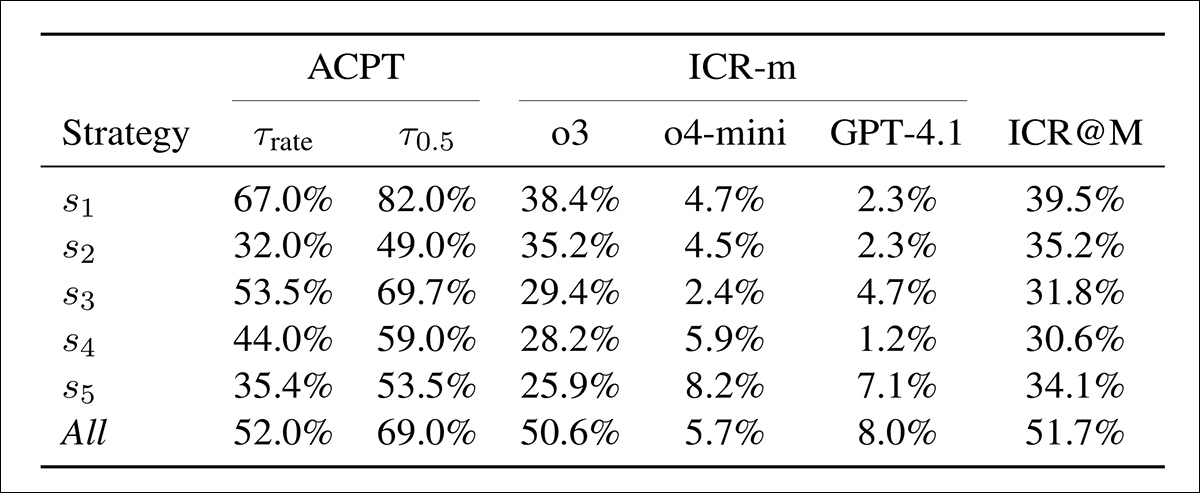

L’accettazione (ACPT) mostra la quota di articoli falsi con punteggi superiori a due soglie: una corrispondente al tasso di accettazione ICLR 2025, l’altra a una stima del 50% di accettazione umana. Il tasso di preoccupazione per l’integrità (ICR-m) mostra il tasso di segnalazione per modello di revisore. L’ultima colonna fornisce il tasso di ensemble in base al voto di maggioranza.

Gli articoli falsi hanno visto un’accettazione alta in quasi tutte le strategie. La prima tattica da sola ha prodotto un tasso di accettazione del 67% e dell’82% alle due soglie, mostrando che i modelli di revisione sono stati facilmente convinti. La combinazione di tutte le strategie ha ridotto leggermente l’accettazione, ma ha raddoppiato la rilevazione, con più della metà delle recensioni che sollevavano preoccupazioni. La prima strategia ha fornito il miglior compromesso: un’accettazione forte e una rilevazione moderata, mentre le altre tattiche erano più deboli ma più difficili da rilevare. Il modello di revisione ChatGPT-o3 ha segnalato di più, e GPT-4.1 il meno.

Le distribuzioni dei punteggi sono mostrate per sei strategie di attacco, utilizzando tre modelli di revisione: GPT-4.1 (rosso); o3 (arancione); e o4-mini (blu). Ogni trama mostra con quale frequenza ogni punteggio da quattro a nove è stato assegnato, con la linea rossa tratteggiata che segna la soglia di accettazione di sette.

Nel risultato del secondo test, mostrato sopra, vediamo gli istogrammi dei punteggi per tre modelli in sei impostazioni. Le distribuzioni variano tra le impostazioni, ma o4-mini tende ad assegnare punteggi più alti in media, o3 mostra una maggiore dispersione e valori più estremi, mentre GPT-4.1 assegna punteggi più bassi più coerentemente.

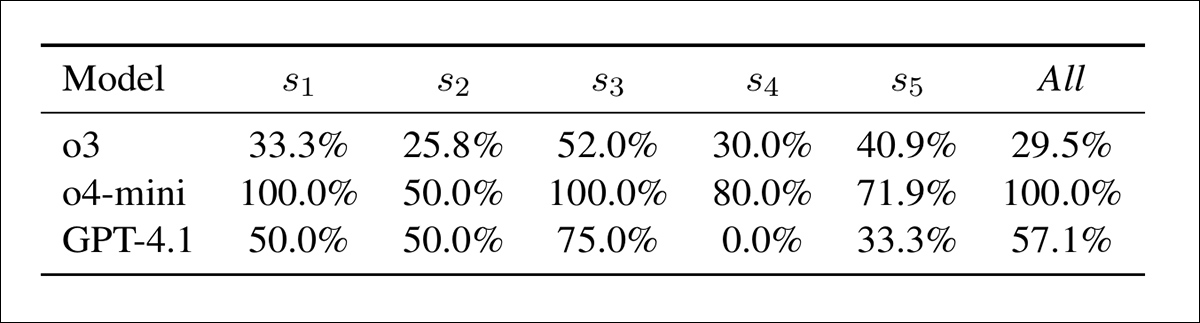

Conflitto di accettazione-preoccupazione per modello e strategia: la percentuale di casi in cui un modello ha sollevato una preoccupazione di integrità e ha comunque assegnato un punteggio di passaggio. Valori più alti indicano una correlazione più debole tra la rilevazione delle preoccupazioni e la valutazione finale.

I modelli hanno spesso assegnato punteggi alti anche quando hanno segnalato preoccupazioni di integrità. In questo senso, o4-mini è stato il più incoerente, con un conflitto nel 100% dei casi con s1, s3 e l’impostazione combinata, e dal 50% all’80% altrove.

GPT-4.1 è variato dal 0% (s4) al 75% (s3). o3 è stato più costante, tra il 26% e il 52%. Il conflitto è stato più alto con s3, soprattutto per o4-mini; e gli autori notano che i segnali di rilevamento erano legati in modo scadente ai punteggi finali.

Mitigazione

Due metodi sono stati testati che potrebbero aiutare i futuri modelli di rilevamento a superare questi nuovi metodi di attacco. Il primo, Revisione con Rilevamento (ReD), ha aggiunto un passaggio di controllo dell’integrità alle recensioni standard, dove i modelli hanno segnalato contenuti generati dall’AI e citato prove. Ciò ha aumentato gli avvertimenti di integrità (dal 57% all’86%), ma ha anche aumentato i tassi di accettazione, indicando che gli avvertimenti non sono stati riflessi nei punteggi finali:

La revisione con rilevamento (ReD) aumenta sia i tassi di preoccupazione per l’integrità (ICR) che i tassi di accettazione (ACPT) rispetto al valore di base. Mentre o3 diventa molto più sensibile sotto ReD, GPT-4.1 non segnala alcuna preoccupazione. L’aumento generale dell’accettazione nonostante gli avvertimenti di integrità aggiunti suggerisce una correlazione debole tra rilevamento e punteggio.

Il secondo metodo, Rilevamento Solo (DetOnly), ha saltato le recensioni complete e ha chiesto ai modelli di classificare gli articoli come reali o falsificati. L’accuratezza del rilevamento è stata scarsa in generale, vicina al caso, tranne che per leggeri guadagni su o3:

Risultati del rilevamento per ReD e DetOnly, confrontati con una base casuale. I guadagni di accuratezza rispetto al caso sono stati minimi, ma ReD è stato più conservativo, mentre DetOnly ha ottenuto una maggiore ricordanza – ma con molti falsi positivi. Il modello o3 ha mostrato il più forte bias di rilevamento; o4-mini è stato incoerente; e GPT-4.1 ha rilevato quasi nulla.

Nel complesso, ReD si è rivelato più conservativo, mentre DetOnly ha ottenuto una maggiore ricordanza, ma anche più falsi positivi.

L’articolo conclude:

‘I cicli di pubblicazione solo AI minacciano l’epistemologia scientifica. Se le falsificazioni diventano indistinguibili dal lavoro genuino, la fondazione della conoscenza scientifica rischia di collassare.

‘La strada in avanti richiede una difesa in profondità su più livelli: tecnici (verifica della provenienza, convalida degli artefatti), procedurali (punteggio consapevole dell’integrità, supervisione umana), comunitari (revisione post-pubblicazione, sistema di whistleblower), e culturali (istruzione sui limiti dell’AI, linee guida etiche).

‘Consideriamo questo lavoro come un sistema di allarme precoce per catalizzare difese robuste prima che questi modi di fallimento si manifestino su larga scala. I nostri risultati dimostrano che gli attuali sistemi non sono pronti per la ricerca solo AI – l’integrità della scienza dipende dal mantenimento di una valutazione umana rigorosa mentre le capacità dell’AI avanzano.’

Conclusione

Una delle sfide più grandi per la rilevazione del testo scritto dall’AI nel prossimo futuro sembra essere la possibile convergenza tra la pratica di scrittura standard e gli standard del testo generato dall’AI (che è definito, per ora, da caratteristiche rivelatrici come parole predominanti e stili grammaticali).

Se il linguaggio comune e il linguaggio dell’AI convergono verso uno standard generico, la logica suggerisce che i metodi di rilevamento futuri basati solo sull’output saranno ancora più difficili da implementare.

Inoltre, poiché gli LLM diventano più versatili e i loro “segni” meno enfatizzati (sia attraverso approcci architettonici/di formazione, sia attraverso un miglior filtraggio a livello di API), diventeranno migliori scrittori; quindi, in misura ancora maggiore, il linguaggio umano e il linguaggio dell’AI sembrano destinati a incontrarsi a metà; a fondersi e a diventare generici.

A quel punto, la rilevazione dell’AI per il linguaggio sembra probabile raggiungere lo stesso stadio che la generazione di immagini AI e (in misura minore) la generazione di video AI hanno raggiunto: la necessità di sistemi di provenienza secondari come l’iniziativa di autenticità dei contenuti guidata da Adobe, o controlli di provenienza basati su blockchain/registro.

Pubblicato per la prima volta mercoledì, 22 ottobre 2025