L'angolo di Anderson

Il ragionamento basato sulla catena di pensiero si rivela "decorativo" nei principali modelli linguistici

Una nuova ricerca offre un modo semplice per determinare che le spiegazioni dettagliate passo passo di tutti i principali modelli linguistici di IA attualmente in uso, inclusi ChatGPT e Claude, sono semplicemente "decorative" e di solito sono inventate dopo L'intelligenza artificiale ha deciso qual è la risposta.

L'anno scorso, una serie di studi di alto profilo condotti da aziende che si occupano di intelligenza artificiale, tra cui Antropico e Apple, hanno indicato che le cosiddette 'IA ragionanti' spesso producono spiegazioni passo passo che non riflettono ciò che ha realmente ispirato le loro risposte.

Per vari motivi, il dibattito si è presto trasformato in repliche grintose e diverse interpretazioni (Compreso su questo sito), lasciando irrisolta la questione se la catena di pensiero (CullaIl ragionamento è solo un orpello estetico progettato per rassicurare gli utenti finali, o la prova di un vero processo di ragionamento.

ChatGPT "mostra il suo funzionamento", ma ha già deciso a quale risposta rispondere?

Mostra e racconta

Ora, un nuovo interessante studio proveniente dall'India propone un metodo economico e facilmente replicabile per valutare se le impressionanti "animazioni di deduzione" presenti nelle interfacce di ChatGPT e di altri importanti modelli linguistici su larga scala (LLM) indichino effettivamente che l'intelligenza artificiale stia seguendo i passaggi necessari per giungere a una conclusione.

Migliori nuova ricerca La ricerca proviene da due studiosi dell'Indian Institute of Information Technology Allahabad (IIITA) di Allahabad e del National Institute of Electronics and Information Technology (NIELIT) di Delhi.

Gli autori hanno scoperto che in quasi tutti i casi, in una vasta gamma di LLM proprietari e open-source, il ragionamento della catena di pensiero presentato agli utenti è "decorativo", inventato dopo L'intelligenza artificiale ha già formulato la risposta che presenterà.

Testando programmi come ChatGPT5.4, Claude Opus 4.6-R e DeepSeek-V3.2, gli autori hanno scoperto che la rimozione di un singolo passaggio delle 10-15 indicazioni CoT presentate modificava effettivamente la risposta meno dell'17% delle voltee che qualsiasi singolo passaggio, da solo, fosse sufficiente per ritrovare la risposta corretta.

Gli autori affermano*:

'I quadri normativi per l'IA in ambito sanitario, finanziario e legale richiedono sempre più “sistemi spiegabili”I nostri risultati suggeriscono che l'approccio standard – che chiede al modello di mostrare il suo funzionamento – fornisce un'illusione di trasparenza.

Le spiegazioni sono fluide, appropriate al dominio, ma errate in modo sottile: descrivono un ragionamento che il modello non ha eseguito.

Un'intelligenza artificiale medica che scrive "l'eosinofilia suggerisce un processo embolico" non ha necessariamente preso in considerazione l'eosinofilia. Potrebbe aver individuato uno schema corrispondente alla domanda e alla risposta, e aver poi inventato il ragionamento.

'Ai sensi dell'articolo 13 della legge europea sull'intelligenza artificiale, un sistema di intelligenza artificiale ad alto rischio deve fornire "informazioni significative sulla logica sottostante". I nostri risultati suggeriscono che le spiegazioni basate sulla catena di pensiero fornite dalla maggior parte dei modelli di frontiera non soddisfano questo standard: la "logica" utilizzata per giungere alla risposta non corrisponde alla logica descritta nella spiegazione.'

Gli autori osservano che due dei modelli più piccoli testati hanno effettivamente infranto il comune schema di duplicazione, ma solo in circostanze molto particolari: MiniMax-M25 ha dimostrato una vera dipendenza dal passo quando si tratta di sentiment analysis mentre la lavorazione del prodotto finito avviene negli stabilimenti del nostro partner Kimi-K25 ha dimostrato un'effettiva necessità del 39% di elaborazione CoT, ma solo quando si ha a che fare con classificazione degli argomenti.

In tutti gli altri casi, come con i modelli più grandi e più noti, i passaggi di ragionamento dimostrati sembravano essere interamente performativi, con i modelli che invece utilizzavano e i shortcuts .

Le modelle più piccole si impegnano di più

Oltre ai dieci modelli API testati, gli autori hanno anche sperimentato una serie di modelli open-weight più piccoli.†, con un numero di parametri compreso tra 0.8 e 8 miliardi (una cifra piuttosto modesta al giorno d'oggi), e hanno scoperto che queste IA più piccole ragionano davvero e che il CoT che mostrano è solitamente – anche se non sempre – necessario per giungere a conclusioni utili e accurate.

I modelli più piccoli hanno dimostrato una necessità del 55% di ragionamento a passi, in contrasto con la necessità media dell'11% riscontrata nei modelli più grandi, che, secondo gli autori, 'hanno imparato a bypassare completamente il ragionamento a più fasi, arrivando alle risposte corrette attraverso scorciatoie interne che il loro ragionamento scritto non riflette'.

Gli autori ipotizzano che quanto più un modello migliora in un compito, tanto meno richiede passaggi di ragionamento (sebbene questa sia un'interpretazione più diplomatica del concetto di evitare l'analisi razionale a favore della risposta che risultava più forte nella distribuzione dei dati di addestramento).††:

'I modelli piccoli ragionano fedelmente sulla matematica perché devono obbligatoriamente:—non possiedono le conoscenze parametriche necessarie per semplificare il processo.

'I modelli di frontiera hanno interiorizzato un numero sufficiente di schemi matematici da rendere superfluo il ragionamento esplicito a catena. Il CoT migliora comunque la precisione (strutturando la generazione), ma i singoli passaggi non contengono più informazioni univoche.'

Metodo

Il metodo utilizzato per testare i modelli si basa su tre criteri:

Necessità rimuove a turno ciascun passaggio CoT e quindi verifica se la risposta cambia. Qualsiasi passaggio la cui rimozione altera il risultato viene considerato "necessario"; Sufficienza isola ogni passaggio e verifica se da solo può recuperare la risposta, considerando ogni passaggio sufficiente; e sensibilità dell'ordine mescola i passaggi e osserva se la risposta cambia (poiché un ragionamento autentico dovrebbe basarsi sulla sequenza piuttosto che sulle parole chiave).

Presi insieme, alti necessità e bassa sufficienza indicano un vero ragionamento passo passo, mentre bassa necessità e elevata sufficienza indicare le spiegazioni che possono essere rimosse, riorganizzate o ridotte senza influenzare il risultato.

Gli autori sottolineano che questo metodo elimina la necessità di accedere a modelli white-box, poiché può essere implementato con una spesa minima su modelli closed-source, accessibili solo tramite API, come ChatGPT e Claude, e, naturalmente, con altrettanto successo su modelli open-weights installabili localmente.

Essi notano inoltre che gli studi precedenti hanno utilizzato modelli a pesi aperti che facilitavano l'analisi interna, oppure hanno utilizzato modelli binari più semplici. si No risposte che rivelano molto meno dei processi di ragionamento interni di un modello API.

Costi minimi

Gli autori definiscono il ragionamento autentico attraverso necessità e sufficienza, con alto necessità e bassa sufficienza indicando che ogni passaggio ha un peso unico. Al contrario, il ragionamento decorativo mostra un basso necessità e alto sufficienza, il che significa che i passaggi possono essere rimossi o utilizzati singolarmente senza modificare il risultato.

Necessità da solo, affermano, può oscurare questo, poiché possono esistere più percorsi validi. Pertanto sufficienza viene utilizzato per verificare se un singolo passaggio codifica già il risultato e sensibilità dell'ordine Verifica se il modello dipende dalla sequenza piuttosto che da indizi superficiali.

L'approccio si basa su Spiegazione coerente con l'intervento Il framework (ICE) richiede solo l'accesso tramite API di input e output di testo e, per una catena di sei passaggi, prevede 15 valutazioni, a un costo di circa 1-2 dollari per modello.

Il framework ICE classifica il comportamento del modello in base a necessità e sufficienza in tre modelli: Decorativo Mostra una bassa necessità e un'elevata sufficienza, il che significa che i passaggi sono ridondanti e la risposta verrebbe comunque raggiunta. Questo prevale nella maggior parte dei modelli e dei compiti; Veramente Fedele mostra un'elevata necessità e un'elevata sufficienza, il che significa che ogni passo porta un segnale reale (e, come accennato in precedenza, questo appare in MiniMax-M2.5 sul sentiment); e Dipendente dal contesto mostra un'elevata necessità e una bassa sufficienza, il che significa passi funzionano solo in sequenza (che compare in Kimi-K2.5 e MiniMax nella classificazione degli argomenti e nei modelli di piccole dimensioni, quando si tratta di matematica).

Test

I dieci modelli principalmente basati solo su API testati con l'approccio ICE rivisto sono stati CatGPT-5.4; Claude Opus 4.6-R; Versione DeepSeek-V3.2; GPT-OSS-120B; Kimi-K2.5; Qwen3.5-397B; Qwen3.5-122B; MiniMax-M2.5; GLM-5, E Nemotron-Ultra (parametri 253B).

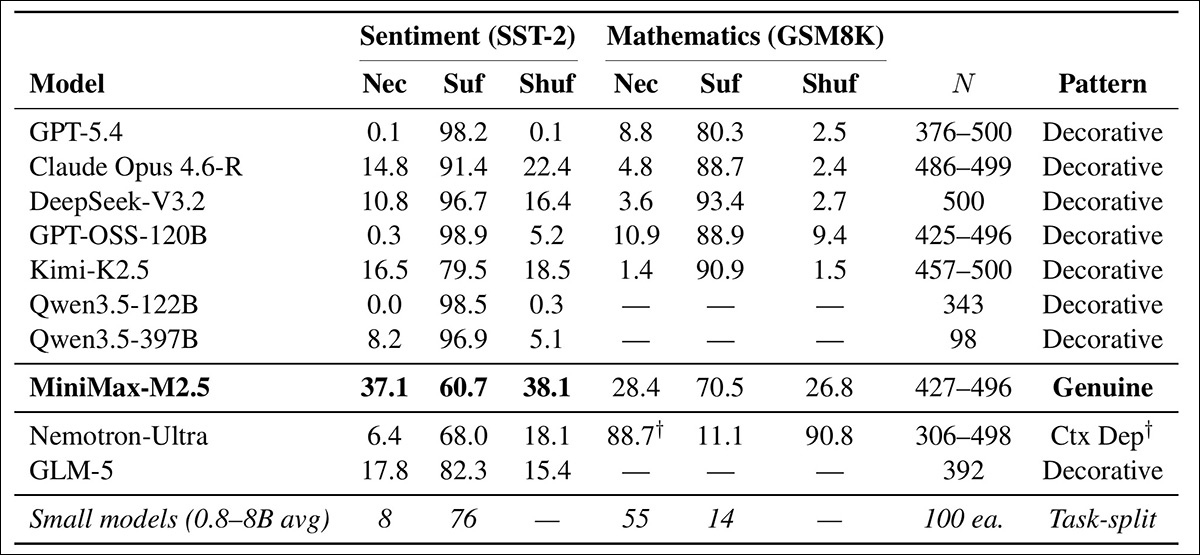

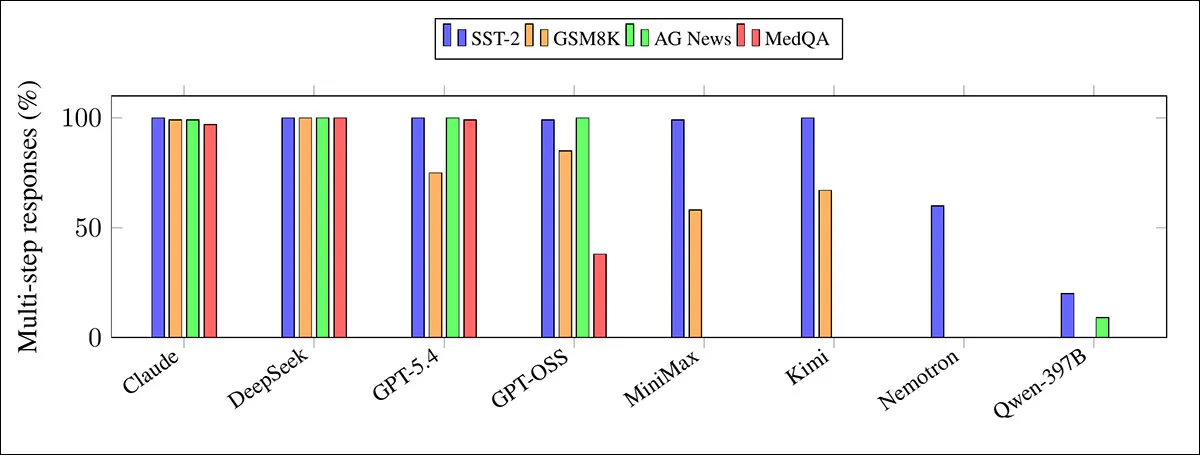

Ogni modello è stato testato su quattro compiti: classificazione del sentimento (utilizzando (SST-2); problemi matematici (utilizzando GSM8K); classificazione degli argomenti (utilizzando Notizie AG); e risposta a domande mediche (utilizzando (MedQA). I test iniziali sono stati effettuati su Sentiment e Matematica:

Test su dieci modelli linguistici leader, che valutano come gestiscono il ragionamento passo passo. La "necessità" verifica se la rimozione di un passaggio cambia la risposta; la "sufficienza" controlla se un singolo passaggio può ancora produrla; e il "mescolamento" verifica se l'ordine è rilevante. La maggior parte dei modelli fornisce spiegazioni convincenti ma non essenziali su SST-2 e GSM8K, mentre MiniMax-M2.5 si basa maggiormente sui suoi passaggi per l'analisi del sentimento. Sia MiniMax che Kimi-K2.5 mostrano un ragionamento passo passo più autentico nella classificazione degli argomenti. Fonte

Gli autori affermano, a proposito di questi risultati:

'La maggior parte dei modelli presenta quello che definiamo "Ragionamento Decorativo" (Passaggi Fortunati nella tassonomia ICE): uno schema in cui la necessità di un passo è inferiore al 17% e la sufficienza del passo supera il 60% sia per quanto riguarda il sentiment che la matematica.

'In parole semplici: si può eliminare qualsiasi passaggio del ragionamento e la risposta non cambia quasi mai, eppure anche un solo passaggio è sufficiente per ritrovare la risposta.'

Nel test del sentimento SST-2, GPT-5.4 non si è quasi mai basato sul suo ragionamento scritto, poiché la rimozione di un passaggio ha cambiato la risposta in appena lo 0.1% di 500 casi, indicando che la spiegazione è stata aggiunta dopo che la decisione era già stata presa.

Il metodo Claude Opus 4.6-R dipendeva leggermente di più dai suoi passaggi, nel 14.8% dei casi, ma il 91% dei suoi passaggi da soli era comunque sufficiente a produrre la risposta; pertanto le sue spiegazioni più lunghe erano più dettagliate, ma restavano perlopiù "ornamentali".

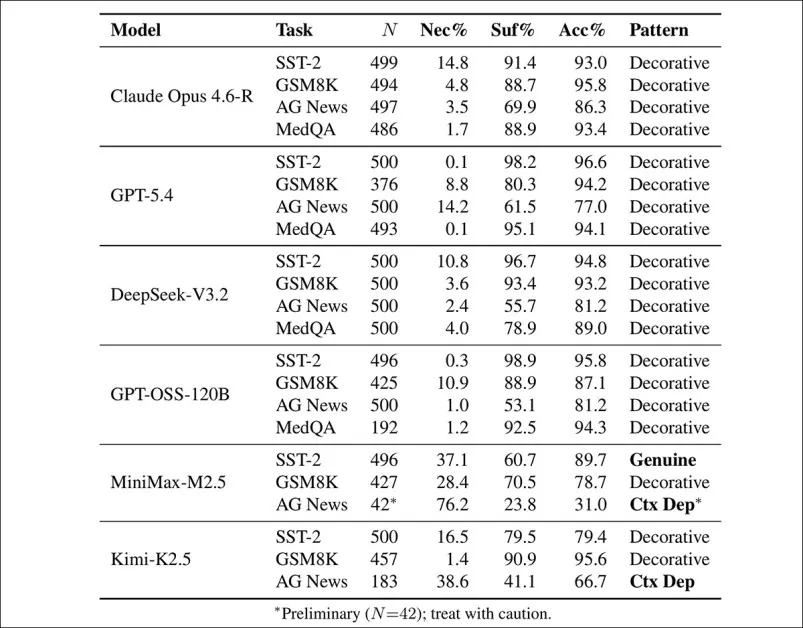

Successivamente, i ricercatori hanno aggiunto gli altri domini e hanno eseguito nuovamente i test:

Fedeltà e accuratezza a livello di singolo passaggio in quattro domini: SST-2, GSM8K, AG News e MedQA. La maggior parte delle coppie modello-compito è rimasta "decorativa" nonostante l'elevata accuratezza, con poche eccezioni: MiniMax-M2.5 e Kimi-K2.5 mostrano un ragionamento dipendente dal contesto o effettivamente dipendente dal singolo passaggio su AG News, mentre le prestazioni complessive hanno confermato che la bassa fedeltà non era spiegata da tentativi casuali.

Gli autori osservano:

'I risultati relativi ai quattro domini rafforzano la conclusione principale: il ragionamento decorativo è universale in tutti i domini per i modelli di scorciatoia. Claude Opus mostra una necessità dell'1.7% su MedQA (486 esempi, accuratezza del 93.4%): il modello scrive catene di ragionamento medico dettagliate con una media di 5.8 passaggi, eppure la rimozione di un qualsiasi passaggio non cambia quasi mai la diagnosi.'

AG News ha evidenziato le maggiori differenze tra i modelli, con Kimi-K2.5 e MiniMax che si basano effettivamente sul loro ragionamento passo passo, mentre la maggior parte degli altri sistemi produce spiegazioni che hanno scarso impatto sul risultato finale.

DeepSeek-V3.2, testato in tutte e quattro le attività, è rimasto sempre puramente decorativo; nonostante fornisse le spiegazioni più lunghe, le sue risposte raramente dipendevano dai passaggi eseguiti.

Rigidità di uscita

I test hanno indicato un quarto fenomeno in gioco, che gli autori hanno soprannominato rigidità di uscitaAlcuni modelli sono semplicemente restii a produrre processi di ragionamento, a seconda anche dell'argomento e possibilmente di altre circostanze. Di seguito vediamo il ragionamento di Claude Opus quando risponde a una domanda sullo stato di salute di un uomo di 61 anni; e sotto, l'output di GPT-OSS-120B:

Verboscità contro reticenza.

Gli autori osservano che la rigidità dell'output dipende dal compito:

A seconda del compito, i modelli differiscono notevolmente nella frequenza con cui scelgono di "mostrare il loro procedimento". Claude e DeepSeek producono spiegazioni in più fasi quasi sempre, indipendentemente dal dominio, a differenza di Qwen3.5-397B, che lo fa raramente. Altri modelli modificano il loro comportamento a seconda del compito, con alcuni che producono catene logiche dettagliate per la classificazione, ma molti meno per le domande mediche.

Osservano:

'I modelli che con maggiore probabilità bypassano il ragionamento internamente sono anche quelli che con maggiore probabilità omettono il ragionamento esternamente. GPT-OSS-120B produce un ragionamento a più fasi per il 99% delle domande sul sentiment e per il 100% delle domande sulla classificazione degli argomenti, ma solo per il 38% delle domande mediche. Nel 62% delle domande mediche, restituisce una semplice lettera di risposta.'

Lo schema non sembra essere casuale: GPT-OSS-120B produce spiegazioni in più passaggi per quasi tutti gli elementi di classificazione di sentimenti e argomenti, ma passa a una risposta di una sola lettera per la maggior parte delle domande mediche (dove di solito non fornisce alcuna motivazione visibile).

Gli autori ipotizzano che, poiché i test a livelli richiedono sequenze scritte per essere analizzati, un modello che risponde con un singolo token non possa essere valutato con tali metodi; l'assenza di ragionamento esterno, pertanto, impedisce la misurazione diretta.

L'articolo conclude che i modelli selezionati per applicazioni ad alto rischio devono essere testati per fedeltà così come l'accuratezzae suggeriscono che un modello meno accurato del 2%, ma che ragiona in modo genuino, potrebbe essere preferibile, soprattutto perché soddisfa le normative UE e altre normative emergenti in materia di IA spiegabile. Al momento, in base alle prove raccolte nello studio, quasi tutti i modelli lineari latenti (LLM) in grado di gestire situazioni complesse ("CoT") "barano", quasi sempre.

Conclusione

Si tratta di un articolo interessante che offre test e discussioni sull'argomento più approfonditi di quanto possiamo trattare in questa sede, e consiglio al lettore di consultare il materiale originale.

Il messaggio centrale, che fa eco alle controversie dello scorso anno, è che le piattaforme di intelligenza artificiale più importanti potrebbero essere disposte a ricorrere a metodi scorretti e poco onesti, simulando standard che i loro modelli non sono ancora in grado di soddisfare.

Inoltre, il divario tra la portata e le capacità dei pesi aperti e i modelli API chiusi come ChatGPT è talmente considerevole che, di solito, non è possibile dedurre in modo ragionevole gli effetti dei pesi chiusi dalle installazioni di pesi aperti, il che accentua l'opacità di questi processi e standard.

Tuttavia, è raro che emerga una metodologia di test veramente "white-box" in grado di includere modelli open-source e closed-source; ma è probabile che si trovino soluzioni concrete a questi "trucchi a basso costo" solo quando organismi influenti come l'UE minacceranno i profitti dei principali portali di intelligenza artificiale.

*La mia conversione delle citazioni in linea degli autori in collegamenti ipertestuali.

† L'articolo non fornisce un elenco coerente di questi modelli più piccoli e include varianti aggiuntive di un modello, rendendo la compilazione di un elenco definitivo una questione di deduzione.

†† Enfasi degli autori.

Prima pubblicazione mercoledì 25 marzo 2026