Finanziamento

Ayar Labs raccoglie 500 milioni di dollari in un investimento di serie E con una valutazione di 3.75 miliardi di dollari per scalare le interconnessioni ottiche per le infrastrutture di intelligenza artificiale

Laboratori Ayar è assicurato 500 milioni di dollari in finanziamenti di serie E, portando il capitale totale raccolto a $870 milioni e valutando l'azienda a $3.75 miliardiIl round è stato guidato da Neuberger Berman e ha visto la partecipazione di ARK Invest, Insight Partners, Autorità per gli investimenti del Qatar, Sequoia Global Equitiese 1789 Capital, insieme agli investitori strategici AMD, MediaTek, Alchipe NVIDIA.

L'azienda afferma che il nuovo finanziamento sarà utilizzato per espandere la capacità di produzione e collaudo su larga scala della sua piattaforma ottica co-confezionata (CPO), una tecnologia progettata per affrontare una delle sfide più urgenti nell'infrastruttura di intelligenza artificiale: come spostare in modo efficiente grandi quantità di dati tra i chip.

Il vincolo nascosto nell'intelligenza artificiale: lo spostamento dei dati

Mentre i titoli dei giornali sull'intelligenza artificiale si concentrano spesso su GPU più veloci e modelli più grandi, un collo di bottiglia crescente risiede altrove: nelle connessioni tra i chip.

I moderni sistemi di intelligenza artificiale si basano su migliaia di GPU che lavorano in parallelo. Questi processori scambiano costantemente dati durante l'addestramento e l'inferenza. Più velocemente ed efficientemente comunicano, più potente diventa il sistema nel suo complesso. Ma la maggior parte di questa comunicazione si basa ancora su segnali elettrici che viaggiano attraverso cavi in rame.

Su piccola scala, il rame funziona bene. A livelli di intelligenza artificiale su larga scala, diventa problematico:

- I segnali elettrici perdono intensità con la distanza.

- Una larghezza di banda maggiore richiede più potenza.

- L'aumento della velocità dei dati genera più calore.

- Le tracce fisiche in rame occupano spazio prezioso sulle schede e all'interno dei package.

Con l'aumentare dei parametri dei modelli, che ora ammontano a migliaia di miliardi, aggiungere semplicemente più GPU non è più sufficiente. L'interconnessione, ovvero il sistema che collega tra loro i processori, determina sempre più le prestazioni complessive e l'efficienza dei costi.

Che cosa è l'interconnessione ottica e perché è importante?

L'interconnessione ottica sostituisce la trasmissione elettrica dei dati con leggera.

Invece di spingere gli elettroni attraverso fili di rame, i sistemi ottici convertono i segnali elettrici in impulsi luminosi che viaggiano attraverso minuscole guide d'onda ottiche o strutture simili a fibre. All'estremità ricevente, questi segnali luminosi vengono riconvertiti in segnali elettrici per l'elaborazione.

Questo approccio offre diversi vantaggi:

- Minore potenza per bit trasferito

- Maggiore capacità di larghezza di banda

- Riduzione del degrado del segnale sulla distanza

- Efficienza energetica migliorata per GPU

In parole povere, la luce può spostare i dati più velocemente e con meno perdite di energia rispetto all'elettricità quando le richieste di larghezza di banda diventano estreme.

Per le infrastrutture di intelligenza artificiale, questa efficienza è fondamentale. I data center sono sempre più vincolati dai budget energetici. Se le interconnessioni consumano troppa energia, ciò limita il numero di acceleratori che possono essere implementati entro un limite di potenza fisso. L'interconnessione ottica mira ad alleviare questa pressione.

Ottica co-confezionata: avvicinare la luce al chip

La rete ottica in sé non è una novità: la fibra ottica è utilizzata nelle telecomunicazioni da decenni. La novità è ottica co-confezionata (CPO).

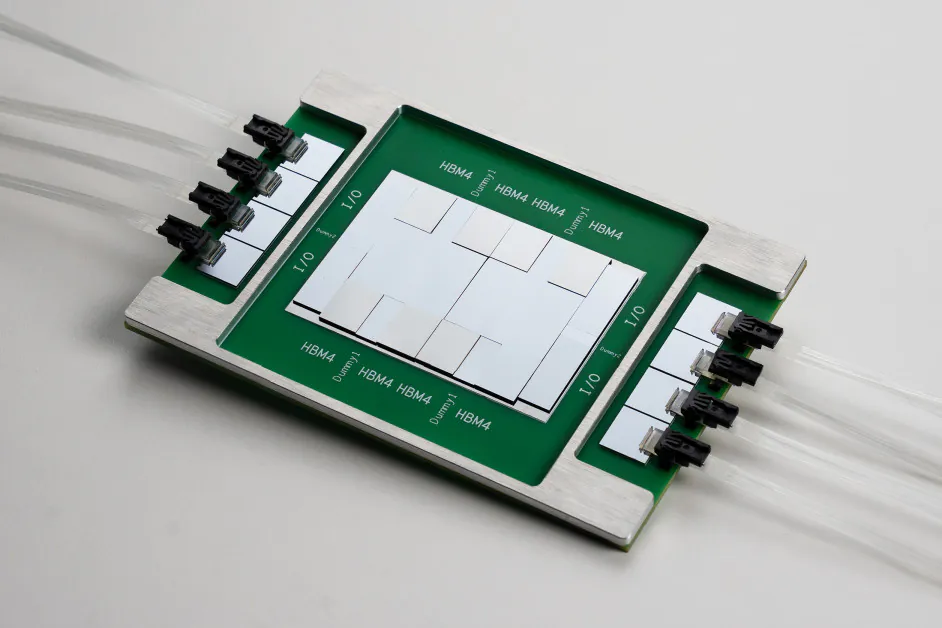

Tradizionalmente, i moduli ottici sono posizionati sul bordo di una scheda server o in transceiver separati collegabili. L'ottica co-packaged integra i componenti ottici direttamente accanto ai chip di elaborazione all'interno dello stesso package. Accorciando i percorsi elettrici e avvicinando la conversione ottica al processore, il sistema riduce la perdita di energia e la latenza.

Al centro dell'approccio di Ayar Labs c'è il suo Motore ottico TeraPHY, progettato per integrarsi nei flussi di lavoro standard di produzione e confezionamento dei semiconduttori. Anziché costringere i clienti a riprogettare interi sistemi, l'azienda propone la propria tecnologia come compatibile con i progetti esistenti di acceleratori e switch.

L'obiettivo non è un miglioramento incrementale, ma consentire a migliaia di GPU di funzionare come un sistema più strettamente unificato, senza dover disporre di budget energetici eccessivi.

Da Unicorn Round a Scale-Up

L'ultimo aumento di capitale di Ayar Labs segue il suo Serie D da 155 milioni di dollari alla fine del 2024, che ha spinto l'azienda a superare la soglia di valutazione di 1 miliardo di dollari e ha supportato l'avvio della produzione iniziale della sua piattaforma I/O ottica.

La Serie E segna il passaggio dalla validazione alla scalabilità. L'azienda prevede di espandere la capacità produttiva e di collaudo, accrescere la propria presenza nell'ecosistema dei semiconduttori di Taiwan e accelerare la distribuzione commerciale.

La presenza di capitali istituzionali e investitori strategici nel settore dei semiconduttori in questo round indica che l'interconnessione ottica non è più considerata puramente sperimentale. Con l'intensificarsi dello sviluppo delle infrastrutture di intelligenza artificiale, l'efficienza dell'interconnessione è diventata fondamentale per prestazioni, costi e sostenibilità energetica.

Se le GPU rappresentano i motori dell'intelligenza artificiale moderna, l'interconnessione ottica potrebbe determinare fino a che punto e con quale efficienza tali motori possono funzionare.