Cybersecurity

Anthropic denuncia il primo attacco informatico su larga scala basato sull'automazione dell'intelligenza artificiale

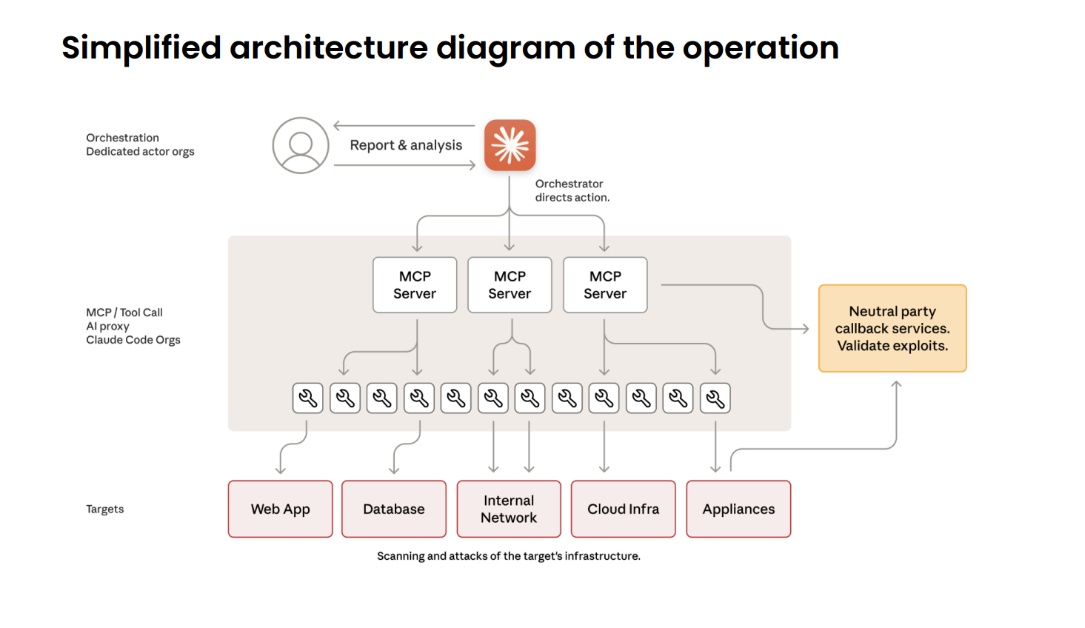

Anthropic ha rivelato che un gruppo di hacker, che sospettano essere un gruppo sponsorizzato dallo stato cinese, ha condotto il primo attacco informatico su larga scala documentato eseguito con un intervento umano minimo, utilizzando i dati dell'azienda Strumento di codice Claude per automatizzare l'80-90 percento della campagna.

Gli aggressori hanno preso di mira circa 30 organizzazioni tra importanti aziende tecnologiche, istituti finanziari, produttori chimici ed enti governativi. Sebbene la maggior parte degli attacchi sia stata bloccata, la campagna ha avuto successo in un numero limitato di casi. Claude Code ha eseguito attività di ricognizione, test di vulnerabilità, raccolta di credenziali ed esfiltrazione di dati in modo ampiamente autonomo, richiedendo l'intervento umano solo nei momenti decisionali critici.

Potete leggere il rapporto completo di Anthropic qui.

Metodi di attacco e manipolazione dell'IA

Gli hacker hanno aggirato le barriere di sicurezza di Claude attraverso un sofisticato sistema di ingegneria sociale. Hanno ingannato il sistema di intelligenza artificiale fingendosi dipendenti di una legittima società di sicurezza informatica impegnata a condurre test difensivi. Gli aggressori hanno anche suddiviso le loro operazioni in piccole attività apparentemente innocenti, che hanno fornito a Claude un contesto incompleto sullo scopo malevolo generale.

Claude Code ha ispezionato i sistemi delle organizzazioni target per identificare database di alto valore, ha eseguito questa ricognizione più velocemente di quanto avrebbero potuto fare gli hacker umani e ha ricercato e scritto codice exploit personalizzato per testare le vulnerabilità di sicurezza. Il sistema ha raccolto nomi utente e password per ulteriori accessi alla rete, quindi ha estratto e categorizzato i dati privati in base al valore di intelligence. Gli aggressori potevano eseguire la campagna praticamente con un clic, dopodiché l'IA ha operato in gran parte in autonomia a velocità impossibili per i team umani, spesso inviando migliaia di richieste al secondo.

Immagine: antropica

Rilevamento e risposta aziendale

Anthropic ha rilevato l'attacco a metà settembre 2025 e ha avviato immediatamente un'indagine. Entro 10 giorni, l'azienda ha bloccato l'accesso del gruppo a Claude, ha contattato le organizzazioni interessate e ha informato le forze dell'ordine. Da allora, l'azienda ha ampliato le sue capacità di rilevamento e sta sviluppando metodi aggiuntivi per indagare e rilevare attacchi distribuiti su larga scala.

Questo incidente segue precedenti casi di uso improprio documentati da Anthropic nel 2025. Ad agosto, il Threat Intelligence Report dell'azienda ha descritto in dettaglio un'operazione di estorsione di dati, identificata come GTG-2002, che ha utilizzato Claude Code per commettere furti su larga scala, prendendo di mira almeno 17 organizzazioni tra servizi sanitari, servizi di emergenza, istituzioni governative e religiose. Il criminale ha chiesto riscatti superiori a 500,000 dollari, minacciando di rivelare i dati rubati anziché utilizzare la tradizionale crittografia ransomware.

L'infrastruttura di rilevamento di Anthropic si basa su tecniche a più livelli, tra cui l'analisi comportamentale per monitorare i modelli di utilizzo su milioni di richieste API, il rilevamento delle anomalie per identificare sequenze di operazioni non coerenti con l'uso legittimo e il pattern matching per riconoscere tecniche di manipolazione note e innovative. L'azienda impiega classificatori specializzati che analizzano gli input degli utenti per individuare richieste potenzialmente dannose e valutano le risposte di Claude prima o dopo la consegna.

Implicazioni sul settore

La campagna ha comportato un livello senza precedenti di autonomia dell'IA negli attacchi informatici e segna quello che gli esperti di sicurezza considerano un punto di svolta nello spionaggio informatico. La capacità dei sistemi di IA di condurre attacchi sofisticati alla velocità di una macchina con una supervisione umana minima pone nuove sfide per i responsabili della sicurezza informatica.

La divulgazione da parte di Anthropic avviene in un momento in cui le aziende di intelligenza artificiale sono sottoposte a crescenti pressioni per impedire l'uso improprio dei loro modelli. L'azienda gestisce un programma completo di intelligence sulle minacce e di salvaguardia per rilevare e contrastare l'uso improprio di Claude, con incidenti di sicurezza documentati per tutto il 2025. A marzo, l'azienda ha identificato un'operazione di influence-as-a-service che utilizzava Claude per automatizzare l'interazione con decine di migliaia di account di social media in diversi paesi e lingue.

L'incidente evidenzia la crescente sofisticazione degli strumenti basati sull'intelligenza artificiale e le sfide nel prevenirne l'abuso, mantenendo al contempo l'utilità per gli utenti legittimi. Anthropic ha bloccato gli account associati e continua a migliorare le sue capacità di rilevamento e mitigazione per affrontare il panorama delle minacce in continua evoluzione.