Intelligenza artificiale

Introduzione a Vertex AI

Data l’evoluzione rapida del paesaggio dell’Intelligenza Artificiale, uno degli ostacoli più grandi che i leader tecnologici spesso incontrano è il passaggio dall’essere “sperimentale” all’essere “pronto per l’impresa”. Mentre i chatbot per i consumatori e una piattaforma interattiva aiutano con l’immaginazione pubblica, le aziende non possono avere successo con solo un’interfaccia di chat. In un’era in cui la concorrenza è più aggressiva che mai, le aziende hanno bisogno di un ecosistema robusto, scalabile e sicuro, e questo è ciò che Google tenta di offrire con Vertex AI, la piattaforma unificata di Intelligenza Artificiale e Apprendimento Automatico di Google Cloud.

Vertex AI tenta di consolidarsi come la spina dorsale per l’integrazione di Intelligenza Artificiale Generativa con la moderna infrastruttura cloud, offrendo una suite completa di funzionalità che colma il divario tra modelli di base grezzi e applicazioni di produzione. Vertex AI non è semplicemente un wrapper per grandi modelli linguistici (LLM), ma è un ecosistema unificato di Apprendimento Automatico e Intelligenza Artificiale (ML/AI) che tratta l’Intelligenza Artificiale Generativa come un cittadino di prima classe dell’infrastruttura cloud moderna.

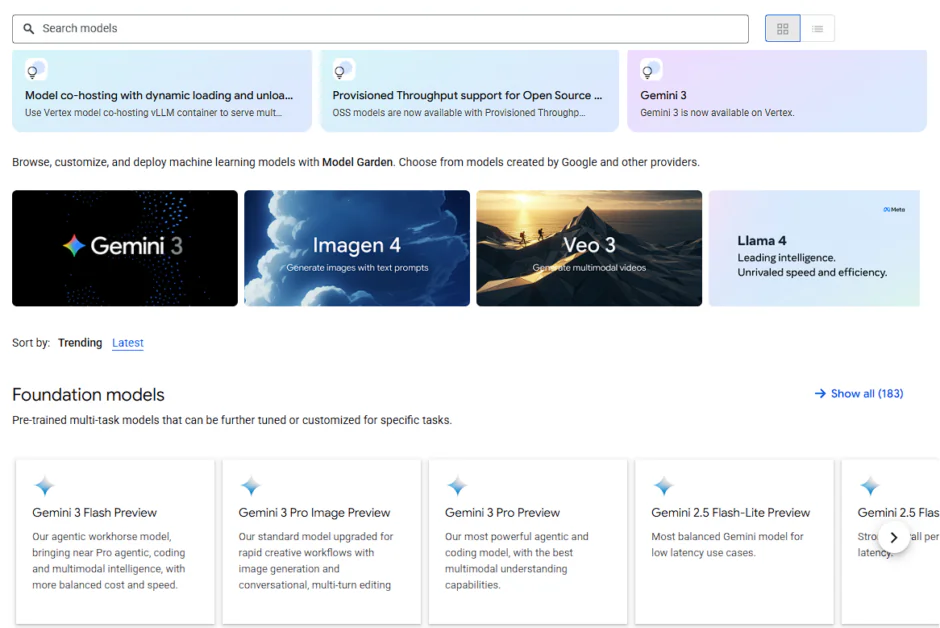

Al cuore di Vertex AI si trova il Model Garden, un mercato centrale che fornisce l’accesso a oltre 200 modelli di base curati, tra cui il potente multimodale Gemini 2.5 Pro, che presenta una finestra di contesto di 2 milioni di token. In questo articolo, analizzeremo l’architettura di Vertex AI, esploreremo come Model Garden serva come “App Store” per l’intelligenza, e guarderemo ai pilastri tecnici che rendono questa piattaforma la spina dorsale della prossima generazione di software aziendale.

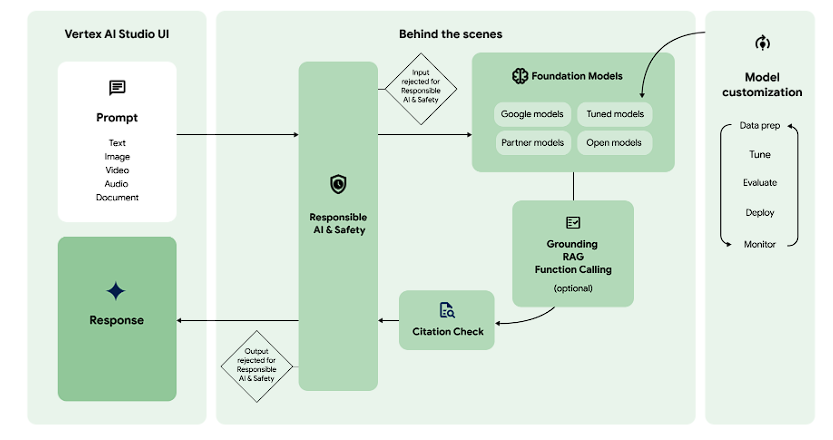

L’Architettura di Base: Una Piattaforma Unificata

Vertex AI non è una raccolta di strumenti debolmente accoppiati, ma un ecosistema di dati e intelligenza artificiale unificato progettato per colmare la frammentazione dei dati, degli strumenti e dei team che affligge l’apprendimento automatico fino ad oggi. Tradizionalmente, lo sviluppo dell’IA avviene in ambienti isolati e, a volte, i dati sono sparsi e intrappolati in più repository. Ad esempio, le organizzazioni potrebbero archiviare i dati dei clienti in magazzini SQL mentre i documenti non strutturati vengono scaricati in un Data Lake. Quando i dati sono isolati, l’IA vede solo una “verità parziale”, portando a risultati distorti o a tassi di allucinazione elevati perché manca del contesto completo dell’azienda.

Vertex AI tenta di integrare l’intero ciclo di vita, dalla ingestione dei dati grezzi in BigQuery e Cloud Storage al monitoraggio della produzione, servendo essenzialmente come “tessuto connettivo” tra questi silos. Vertex AI si integra nativamente con Cloud Storage e BigQuery, consentendo ai modelli di IA di recuperare i dati senza complesse pipeline di estrazione, trasformazione e caricamento.

La Fondazione: L’Hypercomputer di Google

Il livello GenAI di Vertex AI si trova sopra l’architettura dell’hypercomputer di Google, un sistema di supercalcolo integrato, che consiste:

TPU v5p & v5e (Tensor Processing Units)

Le Tensor Processing Units di Google sono ASIC (Application-Specific Integrated Circuits) personalizzati progettati specificamente per la moltiplicazione delle matrici che definisce l’apprendimento profondo.

- TPU v5p (Prestazione): Questo è l’acceleratore di punta per l’addestramento su larga scala. Ogni pod TPU v5p può scalare a 8.960 chip interconnessi dal più alto banda Inter-Chip Interconnect (ICI) di Google a 4.800 Gbps. Per un tecnico, ciò significa un addestramento 2,8 volte più veloce per un modello di dimensioni GPT-3 (175B parametri) rispetto alla generazione precedente, riducendo drasticamente il tempo di mercato.

- TPU v5e (Efficienza): Progettato per le prestazioni “ottimizzate per i costi”, il v5e è il cavallo di battaglia per l’addestramento su scala media e l’inferenza ad alta velocità. Offre fino a 2,5 volte migliori prestazioni in termini di prezzo, rendendolo la scelta ideale per le aziende che devono eseguire inferenze 24/7 senza un budget massiccio.

NVIDIA H100/A100 GPUs per Flessibilità

Mentre le TPU sono specializzate, molte squadre di sviluppo si affidano all’ecosistema NVIDIA CUDA. Vertex AI fornisce il supporto di prima classe per l’hardware più recente di NVIDIA:

- NVIDIA H100 (Hopper): Ideale per il fine-tuning dei modelli open-source più grandi (come Llama 3.1 405B) che richiedono una larghezza di banda di memoria massiccia.

- Jupiter Networking: Per prevenire il “collo di bottiglia della rete”, Google utilizza il tessuto della rete dei data center Jupiter. Ciò garantisce che i dati si muovano tra le GPU a velocità fulminea, supportando RDMA (Remote Direct Memory Access) per bypassare l’overhead della CPU e fornire prestazioni quasi locali su nodi distribuiti.

Orchestrazione Dinamica

Il passaggio tecnico più critico in Vertex AI è l’Orchestrazione Dinamica. In un ambiente legacy, se un nodo GPU si blocca durante un run di addestramento di 3 settimane, l’intero lavoro potrebbe crashare.

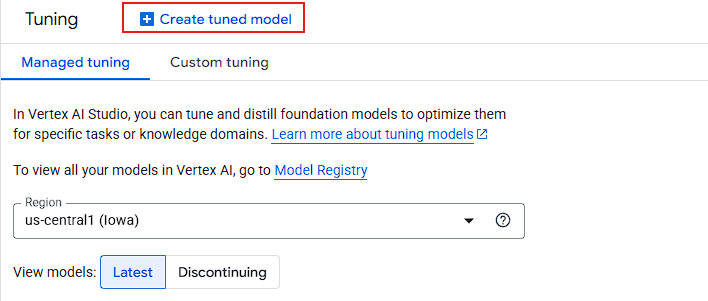

Per accogliere diverse personalità tecniche – da scienziati dei dati a sviluppatori di applicazioni – Vertex AI fornisce tre punti di entrata principali: Il Model Garden di Google Cloud è una piattaforma centralizzata all’interno di Google Cloud per la scoperta, il test, la personalizzazione e la distribuzione di una vasta gamma di modelli di intelligenza artificiale di prima parte, open-source e di terze parti, inclusi quelli multimodali (visione, testo, codice) per vari bisogni aziendali, offrendo un’integrazione senza soluzione di continuità con gli strumenti di Vertex AI per un MLOps fluido. Funziona come una libreria completa, aiutando gli sviluppatori e le aziende a selezionare il modello giusto (dai grandi modelli di base ai modelli specializzati) per i loro compiti, sia per la generazione di testo, l’analisi delle immagini o il completamento del codice, e distribuirli efficientemente all’interno del loro ambiente Google Cloud. Model Garden categorizza i suoi 200+ modelli in tre livelli distinti, consentendo agli architetti di bilanciare prestazioni, costo e controllo: In un ambiente non unificato, la distribuzione di un modello open-source come Llama richiede l’impostazione di un ambiente PyTorch, la configurazione dei driver CUDA e la gestione di un wrapper Flask o FastAPI. Model Garden elimina questa fase di “munging” attraverso Punti Finali Gestiti Unificati: Mentre il Model Garden è sulla selezione, Vertex AI Studio è sulla precisione. Vertex AI Studio può essere paragonato ai compilatori e ai debugger che si incontrano nel mondo del software tradizionale. Vertex AI Studio è il luogo di lavoro in cui i modelli grezzi vengono scolpiti in strumenti aziendali specifici attraverso una combinazione di ingegneria dei prompt, test multimodali e tuning iperparametrico avanzato. Una delle funzionalità di spicco dello Studio è il suo supporto nativo per multimodalità. Mentre altre piattaforme richiedono una codifica complessa per gestire dati non testuali, Vertex AI Studio consente di trascinare direttamente i file nell’interfaccia per testare le capacità di ragionamento Gemini 2.5. Quando l’ingegneria dei prompt (Zero-shot o Few-shot) raggiunge un limite, Vertex AI Studio fornisce la pesante attrezzatura: Tuning del Modello. Vertex AI Agent Builder è un framework di orchestrazione di alto livello che consente agli sviluppatori di creare questi agenti combinando modelli di base con dati aziendali ed API esterne. La principale barriera tecnica per l’IA aziendale è l’allucinazione. Agent Builder risolve questo attraverso un sofisticato motore di Grounding. I flussi di lavoro aziendali avanzati richiedono spesso più agenti specializzati che lavorano insieme. Vertex AI introduce il Protocollo Agente-Agente (A2A), uno standard aperto che consente: Per il pubblico della “piattaforma tecnica”, l’Agent Builder offre due percorsi distinti: Il passaggio da una demo di IA spettacolare a un’applicazione aziendale di produzione è stato a lungo il “vallo di morte” per i progetti di trasformazione digitale. Come abbiamo esplorato, Vertex AI è progettato specificamente per colmare questo divario. Unificando i silos frammentati di dati, infrastrutture e orchestrazione dei modelli, Google Cloud ha spostato la conversazione lontano dal potere grezzo dei Large Language Model e verso la maturità operativa del ciclo di vita dell’IA.

I Tre Punti di Entrata: Scoperta, Sperimentazione e Automazione

Model Garden: Il Marketplace per la Scoperta

Vertex AI Studio: Il Playground per la Sperimentazione

Prototipazione Multimodale: Oltre il Testo

Personalizzazione Avanzata: Il Percorso di Tuning

Vertex AI Agent Builder: La Fabbrica per l’Automazione

L’Architettura della “Verità”: Grounding e RAG

Orchestrazione Multi-Agente (Protocollo A2A)

Lo Stack di Sviluppo: ADK e Motore di Agenti

Conclusione: Da “E se” a “Cosa Succede Dopo”