Leader di pensiero

Dall’Codice alla Cura: La Prossima Rivoluzione dell’Intelligenza Artificiale Ha Bisogno di una Mano (E di Occhi)

Come i sistemi agentic, gli occhiali intelligenti XR e la robotica potranno potenziare gli esseri umani e non sostituirli

Stiamo vivendo una paradossale situazione nell’intelligenza artificiale.

Sugli schermi, l’IA è sovrumana. I grandi modelli linguistici scrivono codice Python funzionale in pochi secondi. I sistemi generativi producono immagini e video fotorealistici in pochi minuti. I sistemi vincitori del Nobel come AlphaFold hanno previsto le strutture di quasi tutte le proteine note. Le vittorie digitali si stanno accumulando.

Eppure, nel mondo fisico della ricerca biomedica, il processo di scoperta rimane manualmente laborioso. Non sentiamo realmente l’IA accelerare la scienza o la medicina, almeno non ancora. I numeri rivelano la profondità del problema. Un’indagine fondamentale di Nature su oltre 1.500 scienziati ha scoperto che oltre il 70% ha tentato e fallito nel riprodurre gli esperimenti di un altro ricercatore. Ancor più preoccupante: più della metà non è riuscita a riprodurre il proprio lavoro. Nella biologia del cancro, in particolare, un progetto di riproducibilità di otto anni ha scoperto che solo il 40% dei risultati ad alto impatto poteva essere replicato e il 68% degli esperimenti mancava di una documentazione sufficiente per tentare la riproduzione.

Questo è il segreto sporco della scienza moderna: abbiamo un problema di cattura della conoscenza, non solo un problema di scoperta. I dettagli sperimentali critici vivono nella testa dei ricercatori, non nei documenti. I protocolli si modificano. La conoscenza tacita esce dalla porta quando i tirocinanti si laureano. I sistemi di intelligenza artificiale addestrati sulla letteratura pubblicata ereditano tutte queste lacune.

La questione fondamentale è che mentre un’IA può progettare una proteina innovativa per la terapia del cancro in una simulazione digitale, non può prendere una pipetta per testarla. Non può navigare nella realtà disordinata e imprevedibile di un laboratorio umido per convalidare la sua stessa ipotesi. Non può guardare le mani di uno scienziato esperto e imparare le tecniche sottili che fanno funzionare gli esperimenti.

Questo “divario di esecuzione” è il più grande collo di bottiglia che impedisce alla rivoluzione dell’IA di diventare una rivoluzione medica. Mentre la maggior parte delle aziende di robotica è ancora impegnata nell’insegnare alle macchine a piegare i panni o a caricare i lavapiatti, rimane indietro sulle vere capacità trasformative di questi progressi in campi come la medicina.

Per risolvere questo problema, dobbiamo andare oltre i chatbot e verso gli AI Co-Scienziati, sistemi agentic che collegano il mondo digitale e quello fisico, spingendosi oltre la pianificazione e la codifica e verso l’esecuzione nel mondo reale. A Stanford, stiamo sviluppando LabOS, un framework di intelligenza artificiale digitale-fisica che dimostra come gli agenti di intelligenza artificiale, gli occhiali intelligenti XR e la robotica collaborativa possano unirsi per chiudere questo ciclo, trasformando gli esperimenti scientifici in una conversazione collaborativa tra uomo e macchina, catturando automaticamente la conoscenza che attualmente si perde.

La Grande Divisione: Perché l’IA Ha Bisogno di “Occhi” e “Mani”

Molte delle più visibili vittorie dell’IA sono avvenute dove l’ambiente è completamente digitale: repository di codice, set di dati curati o benchmark simulati (dove l’IA compete per eseguire un’attività virtuale o investire digitalmente in azioni).

I laboratori umidi sono diversi. La biologia, e in generale la scoperta scientifica, è un processo molto rumoroso. Gli strumenti si modificano, gli operatori improvvisano e “il protocollo” spesso vive in parte nella testa delle persone. La differenza tra un risultato pulito e un esecuzione fallita può essere un angolo di pipettazione, un modello di vortice, una sostituzione di reagente o un’incubazione che è durata 10 minuti in più. Questi dettagli contestuali raramente finiscono in un documento e sono esattamente ciò di cui un modello di IA ha bisogno se vuole generalizzare oltre un set di dati.

È per questo che l’IA di laboratorio richiede occhi (per percepire cosa sta succedendo nel contesto), mani (per standardizzare e automatizzare passaggi ad alta varianza) e memoria (per registrare cosa è effettivamente accaduto). Senza queste capacità, i modelli possono raccomandare cosa fare, ma non possono tradurre in modo affidabile le raccomandazioni in esecuzione fisica convalidata o spiegare i fallimenti quando la realtà diverge dal piano.

Oltre i Chatbot: Dai Copiloti ai Co-Scienziati

Il termine “IA agentic” a volte viene usato in modo vago. In ambienti biomedici, dovrebbe significare qualcosa di preciso: un sistema che può prendere un obiettivo (ad esempio, “ottimizzare l’efficienza dell’editing genico CRISPR mentre si minimizzano gli obiettivi non mirati”), decomporlo in una sequenza di attività, eseguire quelle attività attraverso strumenti, valutare i risultati e adattare il piano sotto vincoli e con una presa di decisioni verificabile.

Questo è importante perché i flussi di lavoro di ricerca non sono un singolo modello di chiamata. Sono pipeline end-to-end che coprono la formulazione dell’ipotesi, la progettazione sperimentale, l’elaborazione dei dati, il test delle statistiche e l’interpretazione. Il pensiero recente nella scoperta di farmaci ha iniziato a sottolineare i sistemi agentic che possono scalare queste pipeline piuttosto che semplicemente accelerare i singoli passaggi (ad esempio, la discussione di Unite.AI sugli agenti nella scoperta di piccole molecole).

Nell’ingegneria del software, abbiamo già visto le prime prove empiriche che i copiloti di intelligenza artificiale possono aumentare la produttività degli sviluppatori. Nella biomedicina, l’opportunità analoga non è solo scrivere codice, ma scrivere e convalidare protocolli, strutturare i dati, monitorare l’esecuzione e chiudere il ciclo tra previsione e misura, collegando l’IA ai ricercatori nei laboratori.

LabOS: Quando l’IA Funziona su un Sistema Operativo per i Laboratori del Domani

Nel nostro lavoro a Stanford su AI4Science, che comprende copiloti di editing genico come CRISPR-GPT e sistemi di co-esecuzione AI-XR come LabOS che aiutano gli scienziati nei laboratori di biomedicina e scienza dei materiali, stiamo esplorando un cambiamento architettonico:

1. Progettazione di un “sistema operativo di laboratorio” che collega un laboratorio digitale (asciutto) a un laboratorio fisico (umido).

La premessa è semplice: se un quaderno di laboratorio è la memoria della scienza, allora un sistema operativo di laboratorio dovrebbe essere il livello di esecuzione, catturando l’intento, traducendolo in azioni, osservando i risultati e trasformando ogni esecuzione in conoscenza strutturata.

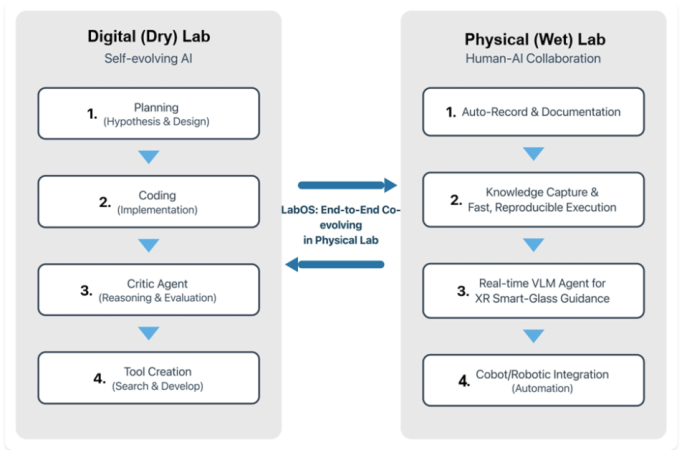

Figura. Una visione concettuale di LabOS che collega un ciclo di laboratorio digitale auto-evolvente (pianificazione, codifica, critica, creazione di strumenti) con un ciclo di laboratorio umido uomo-IA (auto-documentazione, cattura della conoscenza, guida XR e integrazione robotica).

2. IA nel Laboratorio Digitale – Pianificazione e Costruzione di Strumenti Auto-Miglioranti

Nel laboratorio digitale (asciutto), possiamo lasciare che l’IA faccia ciò che già fa bene: ricerca, sintesi e proposta. Ma vogliamo anche che sia auto-migliorante. Non “hallucinando nuova scienza”, ma imparando migliori strumenti e flussi di lavoro dai feedback.

Un ciclo di laboratorio digitale pratico può essere inquadrato come quattro fasi ricorrenti:

- Pianificazione (ipotesi + progettazione): proporre ipotesi, selezionare variabili sperimentali, anticipare confondenti e specificare endpoint misurabili.

- Codifica (implementazione): generare o adattare script di analisi, pipeline di simulazione e modelli di controllo degli strumenti dove appropriato.

- Critico (ragionamento + valutazione): testare le ipotesi, controllare la potenza statistica, proporre controlli e segnalare probabili modalità di fallimento.

- Creazione di strumenti (ricerca + sviluppo): quando il flusso di lavoro manca di un componente (un parser, una routine di controllo della qualità, un cruscotto), costruirlo e aggiungerlo al set di strumenti.

3. IA nel Laboratorio Fisico – IA con “Occhi” (Occhiali XR) e “Mani” (Robotica)

Il laboratorio fisico (umido) è dove il sistema guadagna fiducia – o la perde. L’obiettivo non è sostituire lo scienziato, ma ridurre l’attrito e l’errore mentre si aumenta l’osservabilità.

Vediamo il ciclo di laboratorio fisico come quattro capacità complementari:

- Registrazione automatica e documentazione: catturare azioni, timestamp, impostazioni degli strumenti e deviazioni automaticamente, in modo che la documentazione non sia un afterthought.

- Cattura della conoscenza per un’esecuzione rapida e riproducibile: convertire le esecuzioni in artefatti strutturati e interrogabili (versioni del protocollo, set di parametri, risultati del controllo della qualità) allineati con i principi di gestione dei dati come FAIR.

- Guida in tempo reale attraverso occhiali intelligenti XR: utilizzare modelli multimodali per interpretare la scena (cosa sta facendo l’operatore, quale reagente è in mano) e fornire indicazioni passo dopo passo e controlli di sicurezza. AR/XR ha già dimostrato il suo valore in flussi di lavoro fisici ad alto rischio come la guida sperimentale (LabOS, Stanford, Princeton, in collaborazione con NVIDIA).

- Integrazione di robotica per l’automazione: standardizzare passaggi ripetitivi, abilitare passaggi sicuri e ridurre la variabilità. Piattaforme per flussi di lavoro da simulazione a reale (ad esempio NVIDIA Isaac) e elaborazione di intelligenza artificiale in tempo reale ai bordi come la trasmissione in streaming e l’interazione uomo-IA in LabOS sono importanti strati abilitanti.

Questa architettura si allinea con una direzione più ampia nel settore: “laboratori autonomi” o “self-driving” che combinano l’automazione con l’apprendimento automatico per pianificare il prossimo esperimento. Cosa LabOS aggiunge è uno strato di interfaccia umana più stretto, in modo che l’autonomia non si verifichi a scapito della trasparenza.

Perché l’IA di Laboratorio non è Solo “IA su un Set di Dati”

I sistemi di intelligenza artificiale per la superintelligenza biomedica/scientifica spesso appaiono impressionanti nella valutazione retrospettiva o nei test, e poi sotto-performano nel laboratorio fisico. Il motivo non è raramente un singolo bug. È solitamente un mismatch tra le assunzioni del modello e la realtà del laboratorio.

Tre lacune si presentano ripetutamente:

- Lacuna di contesto: i set di dati di solito omettono le variabili contestuali che gli operatori sanno essere importanti (escursioni di temperatura, numeri di lotto di reagenti, deviazioni sottili del protocollo).

- Lacuna di azione: molti sistemi di IA possono raccomandare cosa fare, ma non possono tradurre in modo affidabile la raccomandazione in passaggi fisici validati.

- Lacuna di feedback: senza feedback strutturato e di alta qualità dall’esecuzione, i modelli non possono imparare dove falliscono – e gli scienziati non possono verificare il motivo.

Chiudere queste lacune è meno questione di inventare una nuova architettura di rete neurale, ma più di costruire gli strumenti, le interfacce e i contratti di dati che rendono il laboratorio leggibile alle macchine, e consentono all’IA di vedere e lavorare con gli esseri umani.

Progettazione della Fiducia: Sicurezza e Governance per l’IA che può Agire

L’IA agentic nella ricerca di scoperta non solleva solo le preoccupazioni familiari sull’accuratezza. Introduce nuovi modi di fallimento perché può agire. In un laboratorio, l’azione significa il potenziale di spreco, danno o conclusioni fuorvianti, specialmente quando gli esperimenti alimentano ipotesi cliniche.

Un atteggiamento utile è trattare uno stack di laboratorio abilitato all’IA come un sistema socio-tecnico che necessita di garanzia. Esistono diversi framework che aiutano, ma devono essere tradotti nella realtà del laboratorio:

- Gestione del rischio come pratica continua: il framework di gestione del rischio dell’IA di NIST (AI RMF 1.0) fornisce un vocabolario pratico per mappare, misurare e gestire il rischio dell’IA nell’intero ciclo di vita.

- Allineamento normativo per l’IA medico-adiacente: il piano d’azione dell’FDA sull’IA/ML Software come dispositivo medico (SaMD), compresa la sua azione e linee guida correlate, offre una visione concreta di cosa significhi “buona pratica” quando l’IA impatta sulla cura del paziente.

Per il editing genico e altri domini ad alta posta in gioco, la governance è già una conversazione globale. Le raccomandazioni sono in discussione sull’editing del genoma umano, per sottolineare la necessità di meccanismi di vigilanza appropriati e di governance responsabile, come quelle avanzate dalla American Society for Gene and Cell Therapy, o ASGCT. Sistemi come LabOS dovrebbero essere progettati per rendere più facile la conformità, non più difficile.

Checklist: Controlli per AI Co-Scienziati Sicuri per la Scoperta Scientifica

Ritieniamo che un sistema operativo di laboratorio consapevole della sicurezza debba implementare almeno i seguenti progetti:

- Provenienza per default: ogni set di dati, versione del protocollo e output del modello dovrebbe essere tracciabile agli input e ai timestamp.

- Autonomia limitata: il sistema dovrebbe avere autorizzazioni esplicite (cosa può fare senza conferma) e regole di escalation (quando deve chiedere).

- Override umano e degrado graduale: quando i sensori o i flussi di dati falliscono, o l’incertezza è alta, il sistema dovrebbe tornare a un modo più sicuro e semplice.

- Convalida continua: le previsioni in-silico dovrebbero essere abbinate con la convalida del laboratorio fisico; le esecuzioni del laboratorio fisico dovrebbero includere gate di controllo della qualità prima che le conclusioni si propaghino a valle verso i modelli/agenti nel mondo digitale.

- Sicurezza e consapevolezza dell’uso duale: proteggere l’infrastruttura del laboratorio dalla manipolazione.

Potenziare gli Esseri Umani Ovunque: Possono gli AI Co-Scienziati Livellare il Campo di Gioco?

Una delle promesse più convincenti di un “co-scienziato” AI-XR è non solo la velocità per le istituzioni d’élite, ma l’accessibilità per tutti. Considerate cosa attualmente limita i laboratori più piccoli, le startup e le cliniche remote/rurali/regionali:

- Accesso limitato a competenze specializzate per protocolli e strumenti di alta qualità.

- Costo relativo più alto per la formazione, gli errori e la rielaborazione.

- Strumentazione frammentata: quaderni, fogli di calcolo, registri degli strumenti e script di analisi raramente si connettono in modo pulito.

Un sistema che possa guidare l’esecuzione nel contesto (attraverso occhiali XR), catturare automaticamente cosa è accaduto e suggerire il prossimo passo migliore in base alle esecuzioni precedenti potrebbe rendere gli saggi avanzati più ripetibili tra i siti. In principio, potrebbe anche sostenere la ricerca clinica distribuita in cui i protocolli devono essere eseguiti in modo coerente, anche quando le risorse variano.

Cronologia: Quando Ogni Scienziato e Clinico Ottiene un Co-Scienziato?

In breve, siamo più vicini di quanto pensano molti per alcuni compiti ad alto valore e ad alta frequenza (come produrre un farmaco in modo affidabile nel laboratorio) e più lontani di quanto mostri la maggior parte delle demo per altri (come l’IA che risolve completamente grandi problemi come il cancro o l’Alzheimer). Una roadmap realistica si presenta così:

- Nel breve termine (entro 1 anno): Copiloti di flusso di lavoro che riducono il carico amministrativo: stesura del protocollo, sintesi della letteratura, modelli di analisi e rapporti di controllo della qualità automatizzati. Il fattore limitante è l’integrazione, non la capacità del modello.

- Nel medio termine (1-2 anni): Sistemi di co-esecuzione nel laboratorio: guida degli occhiali XR, documentazione automatica e robotica selettiva per passaggi ad alta varianza. La fiducia dipenderà dalle tracce di audit e dalla progettazione del ciclo umano stretto.

- Nel lungo termine (3+ anni): Co-ricercatori cross-domain che collegano la scoperta alla traduzione: collegamento dei dati di laboratorio agli endpoint clinici, monitoraggio dei segnali di sicurezza e aiuto nella progettazione degli studi – mentre si rispettano le aspettative regolamentari ed etiche.

Dall’Codice alla Cura: Il Percorso Avanti per la Scoperta Scientifica 1000x

LabOS è un tentativo di rispondere a una domanda semplice: e se un esperimento potesse essere eseguito come una conversazione, in cui intento, esecuzione ed evidenza sono collegati end-to-end? Se costruiamo questi sistemi bene, possono aiutare ad affrontare il divario di traduzione che rallenta la biomedicina e molte discipline scientifiche fisiche (ad esempio la scienza dei materiali). Se li costruiamo male, amplificheranno l’irripetibilità e creeranno nuovi rischi per la sicurezza.

Il lavoro più importante nei prossimi anni sarà fondamentale: interfacce di dati e dispositivi standardizzati attraverso la costruzione del sistema operativo (molto come iOS esegue tutti i tipi di app), costruzione di benchmark di IA che includono esecuzione e incertezza (come il benchmark LabSuperVision in LabOS), e iniziando la distribuzione nel mondo reale che incoraggia l’innovazione mentre protegge i pazienti e l’integrità della ricerca.

Per i ricercatori e i clinici, la domanda non è se l’IA entrerà nel laboratorio. Già c’è. La domanda è se la integreremo come una raccolta di strumenti non connessi o come un sistema affidabile e verificabile progettato per le realtà della scienza biomedica.

Letture e fonti suggerite

- Indagine sulla riproducibilità (Nature, 2016): https://www.nature.com/articles/533452a

- Articolo peer-reviewed su CRISPR-GPT (Nature Biomedical Engineering): https://www.nature.com/articles/s41551-025-01463-z

- Notizie di Stanford Medicine su CRISPR-GPT (2025): https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- Preprint di LabOS (arXiv): https://arxiv.org/abs/2510.14861

- Sito web del benchmark LabOS e LabSuperVision: https://ai4lab.stanford.edu

- Framework di gestione del rischio dell’IA di NIST (AI RMF 1.0): https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- Panoramica dell’FDA sull’IA/ML Software come dispositivo medico: https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- Principi di dati FAIR (Scientific Data, 2016): https://doi.org/10.1038/sdata.2016.18

- Unite.AI sui collo di bottiglia nella scoperta di piccole molecole: https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI sull’IA e la chirurgia robotica: https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/