Sudut Anderson

‘Survey Paper DDoS Attack’ yang Menghancurkan Penelitian Ilmiah

Model AI generatif seperti ChatGPT sekarang membanjiri platform penerbitan akademis dengan kertas survei yang dihasilkan AI dengan tingkat yang membuat rasio sinyal-ke-bising sangat kritis. Sebuah studi baru mengklaim bahwa banjir ini menghancurkan peneliti, mengubah kutipan, dan mengerosi kepercayaan pada catatan ilmiah, dengan membandingkan banjir kertas yang dibantu AI dengan ‘serangan DDoS’ pada ilmu pengetahuan itu sendiri.

(Sebagian) opini Minggu lalu, untuk pertama kalinya dalam tujuh tahun memantau aliran literatur ilmiah terkait AI, saya harus mengakui kekalahan dan mengakui bahwa, setidaknya pada puncak waktu, saya harus memilih antara tetap mengikuti publikasi baru yang penting atau memiliki waktu untuk menulis tentang beberapa di antaranya.

Jumlah total entri dalam kategori yang sangat terbatas (Computer Vision, Machine Learning, Language Models, dan beberapa bagian lain yang kurang populer) berjumlah jauh lebih dari seribu – hanya untuk satu hari pengajuan.

Pada volume seperti itu, bahkan memindai semua judul baru dan hanya sesekali menikmati beberapa ringkasan abstrak akan membuat hari yang tidak produktif.

Ini terjadi pada hari Selasa, 7 Oktober. Dibandingkan dengan kategori Machine Learning, hari Selasa sebelumnya (14 Oktober) menawarkan volume publikasi yang sedikit kurang intens daripada 400 entri untuk hari Selasa sebelumnya; itu memiliki 354 entri:

354 pengajuan untuk kategori Machine Learning dalam satu hari. Sumber: https://arxiv.org/

Anda harus telah membaca Arxiv setiap hari, selama beberapa tahun, untuk menyadari bahwa angka-angka ini menjadi gila.

Memang, hari Selasa adalah ‘jam sibuk’ Arxiv untuk pengajuan, mungkin karena itu adalah hari kerja pertama yang terjadi jauh dari akhir pekan panjang yang dinikmati oleh orang-orang berpengaruh yang peneliti harapkan untuk mencapai; dan kategori Machine Learning adalah bagian ‘tangkap-semua’ dengan jumlah kertas unik yang lebih rendah (kertas yang tidak dipublikasikan secara bersamaan di saluran yang lebih khusus) daripada kebanyakan kategori lain.

Namun, peningkatan pengajuan kertas sudah menjadi fenomena yang dikenal dalam akademisi dan media.

Mungkin aspek paling mengejutkan dari eskalasi ini adalah bagaimana semua kategori lain yang berdekatan lebih atau kurang tidak berubah dalam frekuensi selama tiga tahun terakhir, sedangkan kategori Ilmu Komputer (lihat jika Anda dapat menemukannya dalam angka resmi Arxiv di bawah) berada pada trajektori yang sangat meningkat:

Peningkatan kertas ilmu komputer (CS) selama tiga tahun terakhir. Sumber: https://info.arxiv.org/about/reports/submission_category_by_year.html

Hanya tiga tahun yang lalu, output pengajuan kertas AI Arxiv diperkirakan menggandakan setiap beberapa tahun; dan akan menarik untuk membaca ringkasan tahunan Arxiv tentang tren pada akhir 2025.

Volume pada 11

Alasan paling jelas mengapa ini terjadi adalah a) komitmen keuangan yang belum pernah terjadi sebelumnya untuk AI generatif menarik tingkat investasi penelitian yang sangat besar di sektor swasta dan akademis, yang sering berkolaborasi; dan b) fakta bahwa sistem model bahasa AI seperti ChatGPT sekarang membuat pengajuan kertas penelitian (termasuk kertas tentang AI) menjadi proses yang hampir terindustrialisasi.

Namun, kualitas pengajuan penelitian tidak meningkat seiring dengan volume (meskipun output AI yang rentan terhadap kesalahan cenderung membuat lebih banyak berita di sektor hukum daripada akademis, tidak hanya karena ramifikasi yang lebih jelas di sana).

Kebijakan toleransi nol sulit untuk diterapkan dalam kasus ini, bahkan jika mengenali konten yang dihasilkan AI lebih mudah; selain fakta bahwa AI itu sendiri adalah berkah yang jelas bagi penelitian ilmiah secara umum, penggunaannya dalam pengajuan kertas penelitian telah umumnya* memperbaiki kejelasan karya dari banyak penyerahkan non-Inggris – individu dan tim yang sampai sekarang beroperasi dengan kerugian.

Tapi masalah menurunkan hambatan bahasa dengan cara ini adalah bahwa itu juga meningkatkan jumlah global penyerahkan, tanpa meningkatkan tingkat pengawasan manusia yang memberikan nilai pada pekerjaan tersebut.

Jika tingkat pengajuan terus meningkat secara eksponensial, rasio sinyal-ke-bising akan menjadi sangat tidak terkendali sehingga hanya AI itu sendiri yang mungkin dapat menavigasi banjir dan anak sungai kertas AI baru; tugas yang tidak lebih sesuai untuk dilakukan daripada memeriksa outputnya sendiri. Ironisnya, penelitian ilmiah adalah upaya yang sangat manusia.

Serangan pada Penelitian

Penyebab refleksi ini adalah kolaborasi baru dari Cina yang berjudul Stop DDoS Attacking the Research Community with AI-Generated Survey Papers.

Makalah baru ini berkonsentrasi khusus pada survei pengajuan – rangkuman tingkat tinggi dari benang penelitian tertentu, yang secara tradisional telah mencantumkan dan mengkontekstualisasikan, menafsirkan tren dan membuat prediksi yang terinformasi:

Sebagian kecil dari tubuh survei yang sangat besar dan terus berkembang yang tersedia di bagian terkait dengan machine learning dan AI, di arxiv.org

Karena survei mengkurasi daripada menghasilkan, mereka sangat mudah untuk diotomatisasi dengan AI, dan penulis makalah baru ini menggambarkan proliferasi survei yang rendah-upaya dalam istilah ancaman keamanan bagi sektor penelitian†:

‘[Pengajuan] survei AI yang baru-baru ini, terutama yang diberdayakan oleh model bahasa besar (LLM), telah mengubah genre yang tradisional ini menjadi output volume tinggi yang rendah-upaya. Sementara otomatisasi seperti itu menurunkan hambatan masuk, itu juga memperkenalkan ancaman kritis: fenomena yang kami sebut “serangan survei kertas DDoS” pada komunitas penelitian.

‘Ini mengacu pada proliferasi tak terkendali dari naskah survei yang komprehensif secara superficial tetapi sering redundan, kualitas rendah, atau bahkan halusinasi, yang membanjiri platform pracetak, menghancurkan peneliti, dan mengerosi kepercayaan pada catatan ilmiah.

‘[Kami] berpendapat bahwa kami harus berhenti mengunggah jumlah besar survei kertas yang dihasilkan AI (yaitu, serangan survei kertas DDoS) ke komunitas penelitian, dengan menginstitusikan norma yang kuat untuk peninjauan yang dibantu AI.’

Penulis makalah tersebut menyatakan bahwa percepatan produksi survei yang tidak terkendali ini mengancam untuk membanjiri ekosistem penelitian dengan laporan yang rapi tetapi tidak memiliki kedalaman kritis, dan yang kemungkinan akan menyebarkan kesalahan faktual dan/atau halusinasi kutipan.

Makalah tersebut memperingatkan bahwa tanpa aturan atau pengawasan yang lebih baik, survei yang dihasilkan AI bisa berubah menjadi salinan yang dangkal yang menyesatkan tentang topik mana yang penting, menyembunyikan analisis yang berarti, dan membuat tinjauan literatur kurang dapat dipercaya:

‘Implikasinya untuk kualitas penelitian dan kepercayaan sangat mendalam. Pertama, kemajuan yang sebenarnya berisiko tersembunyi oleh ulangan algoritmik dari pekerjaan yang ada.

‘Pemula dan sarjana antardisiplin mungkin berjuang untuk menemukan tinjauan yang dapat diandalkan di tengah kebisingan. Selain itu, kesalahan atau bias yang diperkenalkan oleh penulisan yang diotomatis dapat berpropagasi tanpa terkendali, menyebabkan penelitian berikutnya dengan asumsi yang salah.

‘Singkatnya, banjir survei yang dihasilkan AI yang tidak ditinjau sebanding mengancam baik ketatnya tinjauan literatur dan kredibilitas catatan ilmiah.’

‘Penulis Tidak Biasa’

Penulis makalah tersebut memberikan beberapa analisis menarik tentang evolusi pengajuan survei:

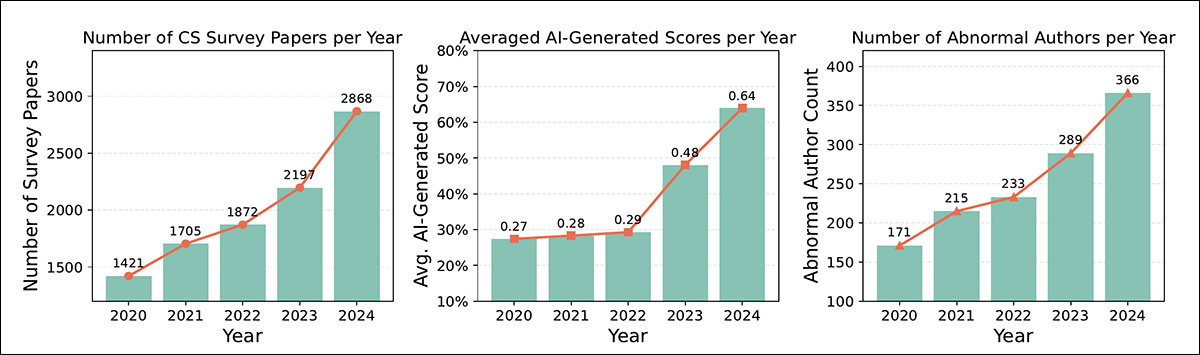

Kiri: hitungan tahunan kertas survei ilmu komputer dari 2020 hingga 2024. Tengah: skor pembangkitan AI rata-rata untuk kertas-kertas tersebut selama periode yang sama. Kanan: jumlah penulis yang diberi label sebagai ‘tidak biasa’ (mereka dengan output survei yang sangat tinggi, keragaman koautor yang terbatas, dan pola institusional yang berulang) setiap tahun. Ketiga tren ini menunjukkan kenaikan tajam yang dimulai pada 2023, bertepatan dengan peluncuran ChatGPT dan model bahasa besar lainnya.

Di kolom pertama kita melihat tren pertumbuhan: kurva mulai meningkat tajam sekitar 2022, saat ChatGPT muncul dan model bahasa besar mulai menjadi mainstream, dan model pengikut seperti Claude, PaLM, dan Gemini akan terus mempertahankan momentum tersebut sepanjang 2023.

Grafik tengah menunjukkan kenaikan tajam dalam pengajuan setelah 2022, bertepatan dengan peluncuran ChatGPT. Satu tim penelitian menemukan bahwa pada 2024, lebih dari 10% abstrak ilmiah telah dijalankan melalui LLM. Laporan terpisah dari perusahaan deteksi AI memperkirakan lompatan pasca-ChatGPT sebesar 72% untuk kertas di arXiv yang mungkin telah ditulis dengan bantuan AI. Jumlah kertas dengan skor pembangkitan AI yang tinggi juga meningkat dua kali lipat dalam setahun, dari 3,6% menjadi 6,2%.

Grafik kanan menunjukkan kenaikan stabil dalam jumlah pola penulis ‘tidak biasa’ (peneliti yang mengajukan tiga atau lebih survei dalam sebulan sambil bekerja dengan kurang dari dua kolaborator), dengan kenaikan yang lebih tajam yang dimulai pada 2022.

Penulis makalah tersebut menyatakan bahwa banyak dari survei kertas ini mungkin telah disusun oleh AI, karena berbagai alasan; beberapa ditulis oleh penulis tunggal atau kelompok kecil yang mengajukan beberapa survei dalam waktu singkat; banyak dari mereka membahas topik yang tidak terkait; dan dalam beberapa kasus, penulis tidak memiliki catatan sebelumnya dalam bidang yang mereka ringkas.

Selain itu, beberapa dari mereka diterbitkan di bawah kolektif anonim dengan tidak ada kaitan institusional yang jelas – pola yang menunjukkan banjir terkoordinasi dari bidang dengan survei cepat, mungkin untuk mendapatkan kutipan atau meningkatkan profil akademis, daripada membuat kontribusi nyata pada literatur.

Masalah

Meskipun kita tidak dapat mencakup semua konten makalah baru, kita harus melihat beberapa pengamatan paling menonjol, serta melemparkan mata kritis pada solusi yang disarankan oleh penulis untuk masalah-masalah ini.

Kualitas dan Keaslian

Masalahnya bukan hanya volume: banyak survei yang ditulis AI melewatkan apa yang membuat survei yang baik berguna: struktur yang jelas, analisis yang mendalam, penghargaan yang tepat dan teliti, dan wawasan yang sebenarnya. Sebaliknya, makalah tersebut menyatakan, survei yang dihasilkan AI sering membaca seperti ringkasan yang dijahit bersama, tanpa perawatan atau kurasi yang diperlukan.

Penulis makalah tersebut mengamati lebih lanjut bahwa survei yang ditulis AI sering kekurangan struktur, tetapi malah hanya mencantumkan kertas tanpa arah yang jelas, melewati bagian kunci, dan gagal membuat konteks. Survei yang ditulis manusia, di sisi lain, cenderung membangun kategori yang tepat, dan menceritakan kisah yang lebih kohesif.

Juga, banyak survei yang diduga dibantu AI tampaknya hanya menyalin pemecahan topik yang ada, terkadang langsung dari Wikipedia. Misalnya, makalah tersebut mencatat, beberapa survei tentang Vision Transformers berisi judul bagian yang umum dan struktur, mengungkapkan output AI yang berbasis template:

‘Sebaliknya, survei yang ditulis manusia yang baik mungkin memperkenalkan taksonomi baru, misalnya, mengategorikan ViT oleh strategi efisiensi. Kurangnya struktur asli seperti itu dalam banyak pracetak survei terbaru menimbulkan kekhawatiran bahwa mereka mungkin telah dihasilkan oleh AI dengan sedikit wawasan manusia.’

Jangan Kutip Saya

Mungkin yang paling memalukan, survei yang ditulis AI sering salah kutip, melewatkan kertas kunci, termasuk kertas yang tidak relevan, dan terkadang bahkan daftar tidak ada kertas – kesalahan yang menunjukkan bahwa referensi berasal dari pencocokan pola permukaan, bukan keahlian yang sebenarnya.

Penulis makalah tersebut juga menunjukkan bahwa beberapa survei kertas terbaru, sering dari tim yang sama sekali berbeda, berbagi hingga 70% dari daftar referensi mereka – tingkat tumpang tindih yang sangat tinggi, mereka berpendapat, yang menunjukkan ketergantungan bersama pada LLM, yang mengambil dari kolam sumber yang sama.

Memang, pengguna kasual ChatGPT akan tahu bahwa topik yang lebih tidak umum, semakin sedikit sumber yang beragam ada untuk model untuk generalisasi; sangat sering, menemukan sumber model sendiri di web lebih berguna daripada berinteraksi dengan informasi tersebut melalui AI yang tidak memiliki data yang cukup dalam domain tertentu.

Gaya Homogen

Penulis makalah tersebut juga mencatat bahwa banyak survei yang ditulis AI tentang topik yang sama terlihat dan terdengar hampir identik, karena LLM mengulangi frasa dan struktur, terutama untuk subjek yang populer, menghasilkan banjir kertas yang hampir identik yang menambahkan sedikit nilai, dan juga menambahkan kebisingan yang signifikan pada peneliti yang mencari jawaban domain*:

‘Ketika beberapa penulis meminta LLM untuk “menulis tinjauan literatur tentang X,” model tersebut sering menghasilkan respons yang sangat mirip, terutama untuk definisi umum atau fakta yang sudah diketahui. Penelitian terbaru telah menunjukkan kenaikan tajam dalam penggunaan pola penulisan tertentu yang terkait dengan LLM, menunjukkan bahwa banyak kertas sekarang berbagi gaya yang sama.’

ChatGPT Anda Menunjukkan

Makalah tersebut mengamati bahwa cara cepat untuk mengetahui survei yang ditulis AI adalah dengan kehadiran frasa seperti ‘sebagai model bahasa AI’ atau ‘pengetahuan saya berakhir’, yang menunjukkan kurangnya perawatan atau kurasi dari output model bahasa sebelum mengajukan kertas (meskipun pencarian yang ditargetkan pada saat penulisan tidak mengungkapkan petunjuk seperti itu yang diindeks dalam Pencarian Google).

Makalah tersebut mencatat bahwa banyak ‘survei yang dicurigai’ menunjukkan keanekaragaman kata yang lebih rendah dan frasa berulang, misalnya, dengan memulai beberapa paragraf dengan Selanjutnya. Pola ini, penulis makalah tersebut sarankan, adalah khas dari penulisan GPT, dan bisa menjadi bendera yang berguna untuk mendeteksi teks yang dihasilkan secara otomatis.

(Komentar pribadi saya tentang ini adalah bahwa ketentuan jurnalistik online sering mengharuskan penulis untuk mencantumkan banyak item dalam bentuk prosa yang tidak bergaya. Oleh karena itu, ChatGPT dan rekan-rekannya kemungkinan telah belajar kebiasaan buruk ini dari penulis manusia yang dihadapkan pada jumlah alternatif leksikal yang terbatas. Selain itu, konjektur penulis makalah tersebut menunjukkan bahwa mereka bermain-main dengan prinsip-prinsip deteksi konten AI, yang merupakan bidang yang kompleks dan berkembang, dengan sedikit konstan yang tahan lama dari jenis yang penulis sarankan)

Meskipun peneliti melanjutkan untuk mengembangkan wacana yang menarik tentang dampak negatif survei AI pada budaya penelitian dan kepercayaan, kita harus merujuk pembaca ke makalah sumber untuk kedalaman yang lebih besar tentang ini.

Solusi?

Solusi makalah tersebut adalah menarik, radikal, dan pada saat yang sama tidak asli: bahwa utilitas survei kertas harus digantikan oleh Survei Langsung Dinamis – dengan interpretasi, sebuah jenis hibrida antara Wiki dan halaman GitHub, yang terus diberi data baru dari LLM dan sistem AI lainnya, tetapi dengan komit yang hanya dilakukan oleh manusia, sehingga AI tidak dapat secara efektif ‘menerbitkan’ pembaruan.

Sistem yang diusulkan akan berbagi versi dan percabangan GitHub, pada dasarnya mengubah sumber daya informasi menjadi daftar yang terus diperbarui yang mirip dengan ‘daftar yang luar biasa’ di GitHub:

‘Di bawah kerangka ini, anggota komunitas pertama-tama mendirikan wiki topik survei dengan menentukan cakupan, pertanyaan penelitian kunci, dan referensi seminal, yang dengan demikian menetapkan batas tematik yang jelas dan struktur awal.

‘Setelah itu, agen penggunaan LLM terus memantau arsip pracetak, prosiding konferensi, dan papan peringkat benchmark. Ini secara otomatis mengekstrak abstrak, gambar, dan metrik kinerja kunci; mensintesis ringkasan singkat dari hasil baru; memperbarui grafik kutipan untuk mencerminkan hubungan antar kertas; dan menandai tren penelitian yang muncul untuk tinjauan lebih lanjut.

‘Dengan desain, pembaruan otomatis ini terjadi dalam beberapa jam setelah publikasi, memastikan bahwa repositori tetap di ujung tombak.

‘Kontributor manusia kemudian melangkah untuk memberikan kedalaman interpretatif yang tidak dapat ditawarkan mesin. Mereka memperbarui taksonomi yang berkembang untuk menangkap perbedaan metodologis yang halus, mengoordinasikan interpretasi yang bertentangan dari inovasi algoritmik di berbagai subbidang, dan memberikan perbandingan kritis yang lebih dalam untuk dokumen.’

Buku Perubahan

Penulis makalah tersebut mengembangkan proposal ini dengan antusias dan panjang lebar, dan pada dasarnya membenarkannya dengan sesuatu yang sangat benar: survei kertas yang ditulis manusia dengan upaya tinggi tentang topik yang volatil di sekitar AI segera usang sehingga hampir tidak sepadan dengan menulis; dan makalah tersebut mencatat bahwa waktu putaran tiga bulan untuk survei kertas baru kemungkinan akan berarti bahwa itu akan ketinggalan zaman (atau bahkan sangat ketinggalan zaman) pada saat hari publikasi yang dijadwalkan tiba:

‘Tahun demi tahun, komunitas banjir dengan tinjauan yang berulang atau superfisial yang kehilangan relevansi, meninggalkan praktisi dan pemula sama-sama berjuang untuk membedakan sinyal dari kebisingan. Siklus publikasi tradisional (yaitu, draf, ajukan, tinjau, dan terbitkan) dapat memakan waktu beberapa bulan, yang mana terobosan kritis mungkin sudah mengubah lanskap.

‘Selain itu, volume survei statis yang meningkat menambah beban kognitif, karena pembaca harus menyaring melalui dokumen yang tumpang tindih untuk menemukan wawasan yang berarti.’

Sayangnya, solusi makalah tersebut berbagi banyak kualitas terburuk dan paling dibenci dari Discord: yang paling penting adalah bahwa itu akan menjadi sumber daya yang terus berubah dan berubah.

Karena bagian mana pun dari Survei Langsung Dinamis mungkin menghilang atau diubah kapan saja, itu akan mustahil untuk digunakan sebagai sumber yang dapat dikutip, stabil; kecuali, mungkin, dengan menghubungkan ke ‘komit sebelumnya’, dengan cara yang sama seperti archive.is dan Wayback Machine, di antara situs arsip lainnya, menyediakan cuplikan yang dapat dihubungkan dari konten halaman web, dibekukan pada waktu tertentu. Tapi apa sumber daya yang diperlukan untuk ini, dan apakah itu dapat diandalkan untuk tetap hidup dari waktu ke waktu?

Selain itu, platform/Wiki dengan definisi dan konten yang terus berubah akan sulit untuk diindeks, baik oleh mesin pencari tradisional maupun LLM.

Mungkin bagian terlemah dari sistem yang diusulkan adalah gagasan bahwa orang nyata harus mengawasi komit dari agen LLM; seperti biasa, orang nyata mahal. Apa yang diusulkan adalah sesuatu antara museum dan perpustakaan – keduanya akan memerlukan penyediaan daging yang sebanding dengan volume data dan jumlah topik yang diliput.

Jika ‘gunakan orang nyata‘ adalah satu-satunya jawaban untuk masalah pengembangan AI, itu adil untuk mengatakan bahwa masalahnya masih terbuka dan belum terpecahkan.

Kesimpulan

Saat ini, umur pendek survei kertas tentang AI sedikit menjengkelkan; jika tren saat ini menuju penulisan otomatis skala besar dan pengajuan terus berlanjut, seperti yang dibayangkan dalam makalah baru, rasio sinyal-ke-bising akan menjadi kronis, dan literatur akan tidak terkendali.

Dalam situasi seperti itu, akan lebih sulit bagi suara minoritas, sub-FAANG untuk didengar dalam badai pengajuan, dan pemimpin pasar besar kemungkinan akan mendapatkan prominen yang lebih besar.

Selain survei langsung, makalah baru tersebut mengusulkan bahwa penulis tidak hanya harus dilarang untuk menyatakan sendiri saat AI digunakan dalam bagian mana pun dari pengajuan, tetapi juga bahwa bagian yang dibantu AI harus diberi label secara eksplisit dalam kertas (mungkin dengan file JSON sampingan…?).

Karena ini adalah prospek yang berat, makalah tersebut bergantian mengusulkan apa yang hanya bisa saya karakterisasi sebagai ‘getto AI’ – bagian terpisah dalam pengajuan yang disisihkan untuk kontribusi AI.

Singkatnya, makalah baru ini, setidaknya dalam pendapat saya, tidak memiliki jawaban yang realistis untuk ditawarkan; tetapi penulis telah melakukan layanan yang berguna dengan membingkai tantangan yang akan datang.

Makalah Stop DDoS Attacking the Research Community with AI-Generated Survey Papers dapat ditemukan di https://arxiv.org/abs/2510.09686, dan ditulis oleh enam penulis dari departemen di Universitas Jiao Tong Shanghai.

___________________________________

* Tidak semua merasa bahwa ini adalah kasus.

†Penekanan penulis, bukan saya. Juga, di mana berlaku, konversi saya dari kutipan inline penulis menjadi tautan.

Dipublikasikan pertama kali pada hari Jumat, 17 Oktober 2025