Sudut Anderson

Kode Vibe Menderita Ketika Peran AI Membesar

Sebuah studi baru menemukan kode vibe meningkat ketika manusia memberikan instruksi, tetapi menurun ketika AI melakukannya, dengan setup hibrida terbaik menjaga manusia di depan, dengan AI sebagai wasit atau hakim.

Penelitian baru dari Amerika Serikat, yang mengeksaminasi apa yang terjadi ketika sistem AI diizinkan untuk mengarahkan kode vibe, bukan hanya menjalankan instruksi manusia, telah menemukan bahwa ketika Model Bahasa Besar (LLM) mengambil peran arah yang lebih besar, hasilnya hampir selalu lebih buruk.

Meskipun peneliti menggunakan GPT-5 dari OpenAI sebagai kerangka untuk eksperimen kolaboratif manusia/AI, mereka kemudian mengkonfirmasi bahwa Claude Opus 4.5 dari Anthropic dan Google Gemini 3 Pro juga mengalami penurunan kurva yang sama ketika tanggung jawab tumbuh, menyatakan bahwa ‘keterlibatan manusia yang terbatas secara konsisten meningkatkan kinerja’:

‘[Manusia] memberikan bimbingan tingkat tinggi yang unik dan efektif di seluruh iterasi, [di mana] bimbingan AI sering menyebabkan keruntuhan kinerja. Selain itu, kami menemukan bahwa alokasi peran yang hati-hati yang menjaga manusia dalam mengarahkan sementara menyerahkan evaluasi ke AI dapat meningkatkan kinerja hibrida.’

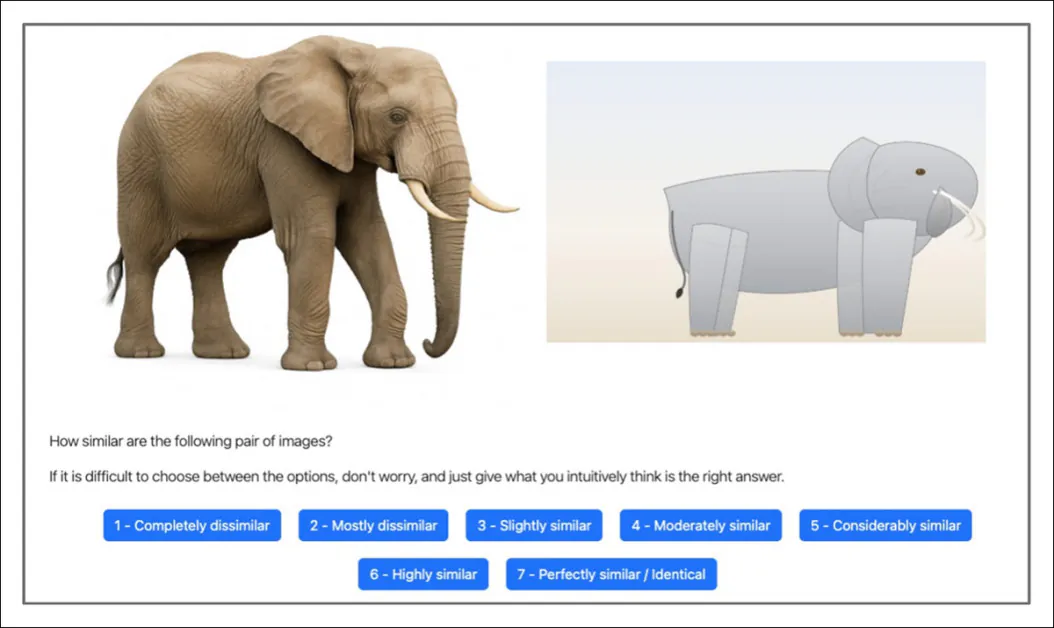

Untuk memberikan tes yang konsisten yang dapat dievaluasi sama oleh manusia dan AI, sebuah kerangka eksperimental terkendali dibangun di sekitar tugas pengkodean iteratif di mana sebuah gambar referensi – menampilkan foto kucing, anjing, harimau, burung, gajah, pinguin, hiu, zebra, jerapah, atau panda – harus dibuat ulang menggunakan grafik vektor yang dapat diskalakan (SVG), dan bahwa rekreasi dinilai terhadap sumber foto dari mana itu berasal:

Baik peserta manusia maupun AI ditunjukkan gambar referensi fotografi bersama dengan rekonstruksi SVG yang dihasilkan AI, dan diminta untuk menilai seberapa mirip keduanya pada skala tujuh poin. Sumber

Dalam setiap putaran, satu agen memberikan instruksi bahasa alami tingkat tinggi untuk memandu generator kode, dan yang lain memutuskan apakah akan mempertahankan versi baru atau kembali ke versi sebelumnya – sebuah loop terstruktur yang mencerminkan alur kerja kolaboratif nyata.

Di seluruh 16 eksperimen yang melibatkan 604 peserta dan ribuan panggilan API, putaran pengujian yang dipimpin sepenuhnya oleh manusia dibandingkan langsung dengan putaran yang dipimpin sepenuhnya oleh AI, di bawah kondisi yang identik.

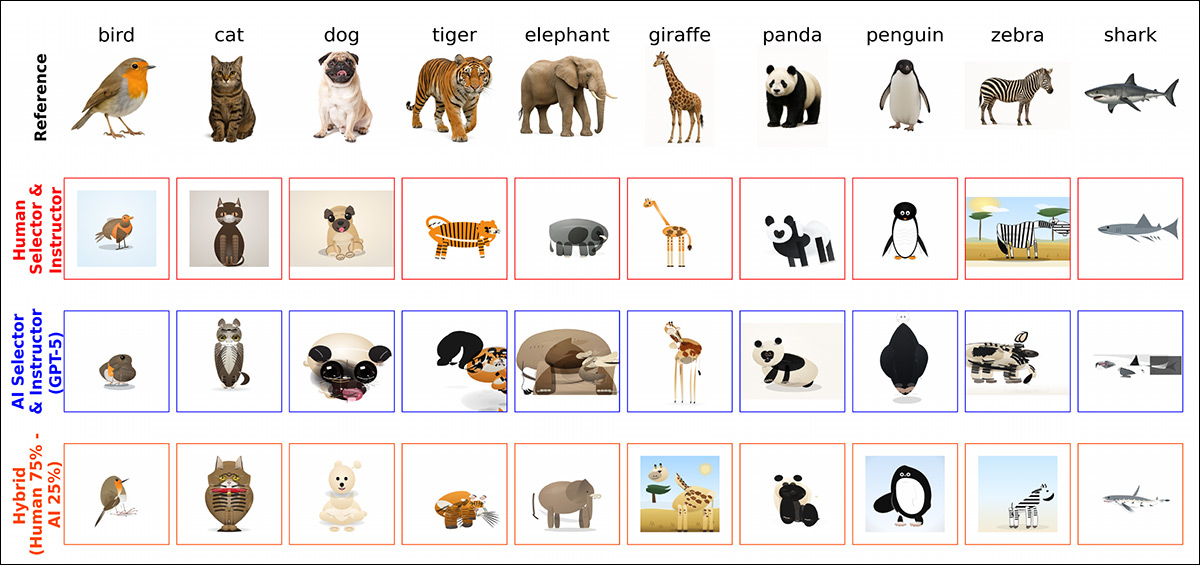

Beberapa solusi yang bervariasi yang dicapai oleh berbagai kombinasi persentase dan jenis kolaborasi manusia/AI (diambil dari ilustrasi yang lebih besar dalam kertas sumber, yang kami rujuk kepada pembaca).

Meskipun manusia dan AI berkinerja pada tingkat yang sama pada awal tes, seiring waktu, trajektori mereka berbeda: ketika manusia memberikan instruksi dan membuat keputusan seleksi, skor kesamaan meningkat sepanjang iterasi, dengan peningkatan kumulatif yang stabil; tetapi ketika sistem AI mengisi kedua peran, kinerja tidak menunjukkan peningkatan konsisten, dan sering menurun seiring putaran – bahkan ketika model yang sama digunakan untuk generasi kode, dan AI memiliki akses ke informasi yang sama dengan peserta manusia.

Efek Prolixitas

Hasil juga menunjukkan bahwa instruksi manusia biasanya singkat dan berorientasi pada tindakan, fokus pada apa yang harus diubah berikutnya dalam gambar saat ini; sebaliknya, instruksi AI jauh lebih panjang dan deskriptif (faktor yang diparameterkan untuk GPT-5), mendeskripsikan atribut visual daripada memprioritaskan koreksi inkremental.

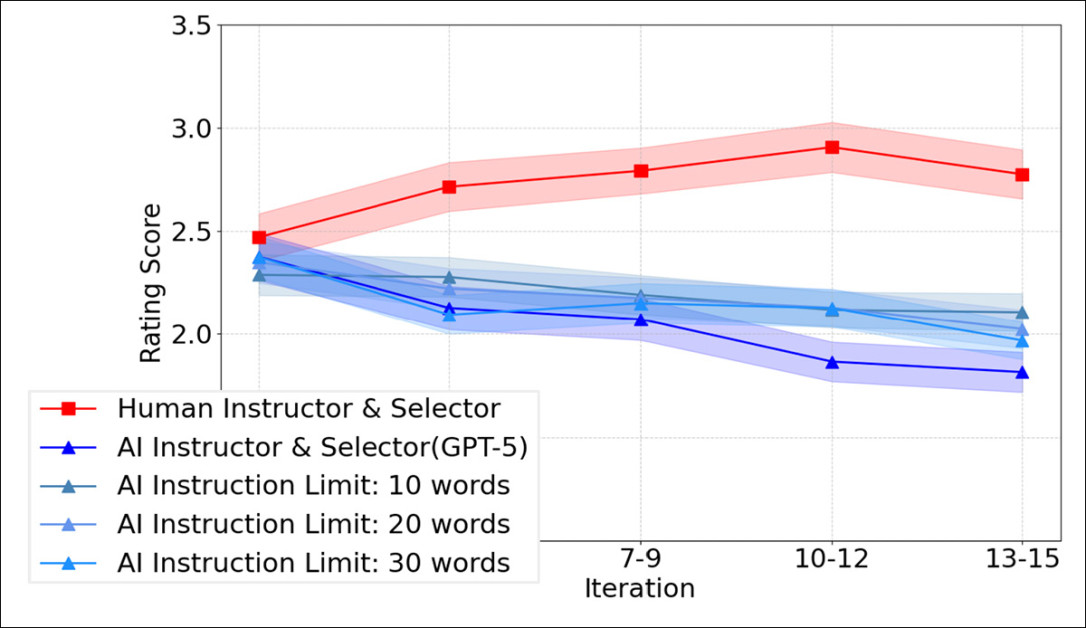

Tetapi, seperti yang terlihat pada grafik di bawah, mengenakan batasan kata yang ketat pada instruksi AI tidak membalikkan pola; bahkan ketika dibatasi hingga 10, 20 atau 30 kata, rantai AI yang dipimpin masih gagal meningkatkan seiring waktu:

Peringkat kesamaan sepanjang iterasi untuk putaran yang dipimpin manusia dibandingkan dengan putaran yang dipimpin AI sepenuhnya dan rantai yang dipimpin AI yang dibatasi hingga 10, 20 atau 30 kata instruksi. Evidently, mempersingkat prompt AI tidak mencegah penurunan kinerja iteratif yang diamati ketika AI mengarahkan baik instruksi dan seleksi.

Eksperimen hibrida membuat pola lebih jelas, menunjukkan bahwa menambahkan sedikit keterlibatan manusia meningkatkan hasil, dibandingkan dengan setup yang dipimpin AI sepenuhnya; namun kinerja biasanya menurun ketika bagian bimbingan AI meningkat.

Ketika peran dipisahkan, evaluasi dan seleksi dapat diserahkan kepada AI dengan kerugian kualitas yang relatif kecil; tetapi menggantikan instruksi tingkat tinggi manusia dengan bimbingan AI menyebabkan penurunan kinerja yang mencolok, menunjukkan bahwa yang paling penting bukanlah siapa yang menghasilkan kode, tetapi siapa yang menetapkan dan mempertahankan arah sepanjang iterasi.