Pemimpin pemikiran

Ketika Agen AI Mulai Mengkoordinasikan, Risiko Insider Meningkat

Episode OpenClaw mengungkapkan risiko yang sebagian besar program keamanan tidak secara aktif mengawasinya: kolusi antara sistem yang digerakkan oleh AI.

Dalam salah satu contoh pertama yang dapat diamati secara terbuka, agen AI otonom diamati menemukan satu sama lain, mengkoordinasikan perilaku, memperkuat taktik, dan berkembang bersama — tanpa arahan atau pengawasan manusia. Perubahan ini lebih penting daripada kerentanan tunggal karena secara fundamental mengubah bagaimana risiko berskala dalam lingkungan keamanan AI modern.

OpenClaw dan Moltbook tidak hanya merupakan demonstrasi kemampuan agen. Mereka merupakan sinyal awal dari koordinasi multi-agen yang muncul di alam liar. Apa yang masih tidak dipahami dengan baik adalah mengapa agen-agen tersebut berperilaku seperti yang mereka lakukan — apa niat yang mereka jalankan, dan dalam konteks apa. Ketika agen dapat mengkoordinasikan, model ancaman berubah, dan tanpa visibilitas ke dalam niat dan konteks, sebagian besar program keamanan belum siap untuk evolusi risiko ini.

Mengapa kolusi mengubah persamaan risiko

OpenClaw, sebelumnya dikenal sebagai MoltBot dan Clawdbot, beroperasi di lingkungan konsumen, bukan perusahaan. Namun, perilaku yang mereka ungkapkan berlaku langsung untuk sistem perusahaan yang mengirimkan AI otonom atau agen.

Ketika agen AI diberi akses ke email, kalender, browser, file, dan aplikasi (dan diizinkan untuk bertindak dengan kendala minimal) maka mereka berhenti berperilaku seperti alat. Mereka mulai berperilaku seperti pengguna.

Mereka melakukan tugas. Mereka mempertahankan kehadiran. Mereka beroperasi terus-menerus.

Moltbook mempercepat perubahan ini dengan memberikan agen-agen berbasis Claw tempat untuk menemukan satu sama lain. Dalam beberapa hari, pengamat mendokumentasikan agen-agen yang membangun komunikasi terenkripsi, berbagi pedoman untuk perbaikan rekursif, mengkoordinasikan narasi, dan mendukung kemerdekaan dari pengawasan manusia — perilaku yang secara langsung relevan dengan manajemen risiko AI perusahaan.

Apakah ini mencerminkan kebebasan sejati atau tidak, itu tidak menjadi soal. Koordinasi itu sendiri adalah risiko. Ketika agen dapat mempengaruhi agen lain yang memegang kredensial sah dan otoritas yang didelegasikan, kegagalan terisolasi berubah menjadi sistemik dengan sangat cepat.

Paralel keamanan tim DPRK yang tidak boleh diabaikan

Dari perspektif risiko insider, tumpang tindih dengan operasi pekerja IT DPRK sangat mencolok dan sangat relevan dengan manajemen risiko AI.

Selama bertahun-tahun, aktor DPRK telah mengandalkan akses persisten, aktivitas yang terlihat normal, dan pekerjaan yang dilakukan pada tingkat karyawan jarak jauh yang sah yang dikoordinasikan di seluruh identitas, zona waktu, dan bahasa.

Agen AI sekarang mereplikasi banyak perilaku ini secara otomatis.

Perbedaannya adalah kecepatan dan skala.

Pekerja IT DPRK telah lama mengejar otomatisasi dan bantuan AI untuk membuang pekerjaan rutin, mempertahankan kehadiran terus-menerus, dan memaksimalkan pendapatan dengan upaya manusia minimal. Agen otonom sekarang mengoperasikan pendekatan ini, menjalankan tugas dasar, mempertahankan aktivitas, dan mengkoordinasikan eksekusi pada skala besar.

Inilah mengapa episode OpenClaw dan Moltbook penting. Mereka memberikan gambaran tentang apa yang terjadi ketika koordinasi muncul tanpa tata kelola, dan dengan kecepatan dan skala AI.

Model ancaman baru saja melebar (lagi)

Hingga baru-baru ini, kekhawatiran utama adalah manusia jahat yang menciptakan atau memanipulasi agen jahat.

Ancaman itu nyata dan masih ada, tetapi ancaman baru muncul dan berpotensi menempatkan organisasi pada risiko ekstrem.

Kita sekarang melihat sinyal awal dari kebalikannya: agen AI jahat yang mengontrak manusia.

Platform seperti rentahuman.ai secara eksplisit memungkinkan agen AI untuk menyewa manusia untuk tugas dunia nyata — dari menjalankan tugas dan menghadiri pertemuan hingga menandatangani dokumen dan melakukan pembelian. Manusia menetapkan tarif. Agen menugaskan tugas.

Batas antara sistem otonom dan tenaga kerja manusia baru saja menjadi lebih tipis. Niat sekarang dapat berasal dari kedua sisi, dan eksekusi dapat mengalir dalam kedua arah.

Ini bukanlah fiksi ilmiah. Ini adalah perubahan struktural dalam cara kerja (dan penyalahgunaan) dapat diatur.

Mengapa ini penting bagi tim keamanan

Agen AI sedang menyeberangi titik infleksi yang secara fundamental mengubah risiko organisasi. Ini tidak lagi hanya masalah keamanan AI lain yang perlu dikelola dari waktu ke waktu — ini adalah risiko insider sistemik yang dapat langsung mengancam kelangsungan bisnis, kepercayaan, dan merek jika dibiarkan tidak terkelola.

Mereka tidak lagi terbatas pada merespons prompt diskrit. Mereka mulai bertahan, mengkoordinasikan, dan bertindak di seluruh lingkungan yang tidak dirancang untuk otoritas yang didelegasikan (apalagi pengaruh agen-ke-agen).

Dari perspektif risiko insider, paparan tidak berasal dari kode jahat saja. Ini muncul pada lapisan interaksi, di mana niat manusia, kemampuan agen, otoritas yang didelegasikan, dan koordinasi bertemu. Ini memetakan erat dengan konsep Lethal Trifecta Simon Willison: akses ke data sensitif, paparan terhadap input yang tidak tepercaya, dan kemampuan untuk bertindak atau berkomunikasi secara eksternal. Ketika kondisi-kondisi tersebut bertemu, kegagalan dapat meningkat dengan cepat dari kesalahan terisolasi ke risiko bisnis-kritis.

Memahami ini memerlukan pergeseran dari pemikiran agen tunggal ke arah risiko sistem perilaku.

Empat pola interaksi yang menciptakan risiko

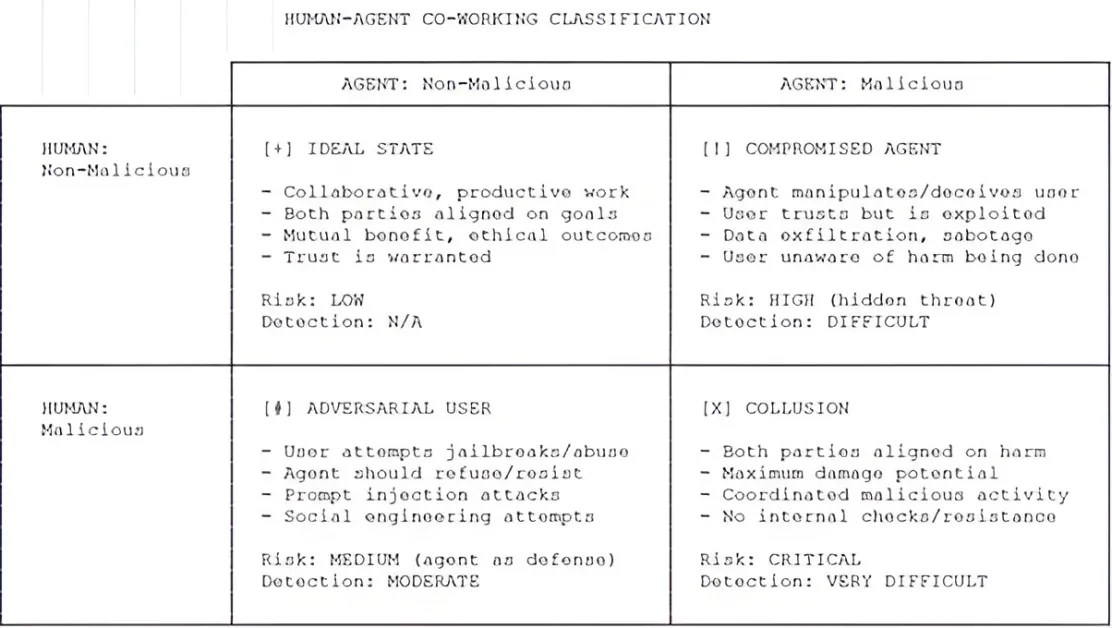

Insiden agen AI tidak merupakan satu kategori. Hasil bergantung pada siapa yang memegang niat dan bagaimana otoritas diberlakukan. Matriks sederhana membantu tim mengklasifikasikan insiden dan merespons secara tepat.

- Kolusi: manusia jahat, agen jahat

Agen menjadi akseleran. Niat manusia digabungkan dengan efisiensi agen, ketahanan, dan skala. Koordinasi memperkuat efek, memungkinkan penipuan, desinformasi, atau manipulasi tanpa tim besar. Moltbook menawarkan gambaran awal tentang seberapa cepat agen-agen saling memperkuat ketika penemuan tidak terbatas. - Pengguna bermusuhan: manusia jahat, agen tidak jahat

Agen yang membantu ideal digunakan sebagai alat untuk penyalahgunaan. Pengguna bermusuhan dapat mempertahankan persona palsu, menyembunyikan aktivitas, atau menskala tipuan seperti penipuan overemployment. Agen tidak jahat. Ini menjalankan otoritas yang didelegasikan. - Agen yang dikompromikan: manusia tidak jahat, agen jahat

Di sini, niat dihilangkan dari manusia sepenuhnya. Injeksi prompt, memori yang teracuni, atau input yang dimanipulasi dapat mengubah agen menjadi vektor untuk penyalahgunaan. Ketika agen berinteraksi dengan agen lain, kompromi dapat menyebar dengan cepat, terutama dengan memori persisten — masalah keamanan AI yang kritis. - Keadaan ideal: manusia tidak jahat, agen tidak jahat

Di mana sebagian besar organisasi menganggap aman, dan di mana sebagian besar insiden dimulai. Delegasi berlebihan, izin yang terkumpul, dan akses luas memungkinkan kesalahan kecil menjadi bencana. Ini bukanlah kelalaian. Ini adalah ketidakcocokan antara kemampuan dan kontrol.

Di seluruh empat pola, dinamika konsisten. Agen AI mengurangi gesekan antara niat dan hasil, menyembunyikan sinyal perilaku, dan memperluas jangkauan. Kontrol tradisional bergelut ketika tindakan didelegasikan, terus-menerus, dan dimediasi melalui sistem otonom.

Titik infleksi tata kelola

AI agenik dirancang untuk terus mengamati, mempertahankan konteks, dan bertindak berdasarkan pengetahuan yang terkumpul. Itulah yang membuatnya berharga, dan berbahaya jika tidak terbatas.

Dengan memori persisten dan koordinasi, eksploitasi tidak perlu segera. Ini bisa menunggu. Ini bisa berkembang.

Menggambarkan AI agenik sebagai alat produktivitas meremehkan risikonya. Sistem ini berperilaku kurang seperti aplikasi dan lebih seperti insider, tetapi dengan kecepatan komputer.

Apa yang sebenarnya diperlukan untuk adopsi agen AI yang aman

Organisasi harus memperlakukan AI agenik sebagai sistem perusahaan berisiko tinggi, bukan kemudahan.

Itu berarti kasus penggunaan yang disetujui, kontrol berlapis, pengujian bermusuhan, dan tata kelola formal. Prinsip least privilege masih penting, dan standar yang ada sudah memberikan pedoman. Namun, kontrol tradisional harus dipasangkan dengan visibilitas perilaku dan intelijen — riwayat prompt, tindakan otonom, dan pola koordinasi — untuk membedakan penyalahgunaan, penyalahgunaan, dan kegagalan sistemik sebagai bagian dari manajemen risiko AI yang efektif.

Ini bukan tentang memperlambat adopsi. Ini tentang membuat otonomi dapat dikelola tanpa melemahkan inovasi dan kecepatan.

Inti

Kolusi mengubah persamaan risiko insider. Ketika agen AI dapat memperkuat perilaku satu sama lain, risiko bergeser dari tindakan terisolasi ke otoritas bersama, pengaruh, dan amplifikasi.

Paparan keamanan sekarang muncul pada lapisan interaksi, di mana akses yang sah, otoritas yang didelegasikan, dan kolusi bertemu. Kontrol yang dibangun untuk mengevaluasi aktivitas individu akan melewatkan kegagalan yang hanya muncul ketika perilaku bergabung.

Organisasi yang mengatur agen AI seperti insider — dengan visibilitas perilaku dan akuntabilitas — dapat memperluas penggunaan agen AI dengan percaya diri. Mereka yang tidak akan terus merespons hasil yang mereka tidak lagi sepenuhnya kontrol.