Sudut Anderson

Coba Virtual Pakaian Baru Melalui AI

Sebuah model AI sekarang dapat mengubah satu foto dan gambar pakaian menjadi video bergerak dari seseorang yang mengenakan pakaian baru, menghindari gangguan yang umum pada sistem dua langkah yang lebih lama.

Kategori ‘virtual try-on’ (VTON) dalam penelitian penglihatan komputer adalah salah satu yang paling banyak didanai dan paling prolifik dalam literatur – terutama karena, seperti yang dapat dilihat dari kolaborasi industri/akademis yang diterbitkan setiap tahun, tujuan ini menerima pendanaan yang signifikan dari industri fashion yang kaya:

Dari makalah ‘Image-Based Virtual Try-On: A Survey’, contoh jenis perwakilan orang, dan beberapa tahap penyaringan dan penghalusan yang bahkan gambar dasar harus dilalui untuk virtual try-on (VTON). Sumber

Terdapat banyak variasi pada tujuan, seperti mengambil pakaian dari gambar orang, dan mengakomodasi bentuk yang lebih penuh ketika diperlukan. Beberapa sistem berbasis gambar telah diimplementasikan secara komersial, di platform seperti veesual.ai, wanna.fashion, dan fashn.ai.

Untuk video, aplikasi eksperimental Google Labs’ Doppl bereksperimen dengan fungsionalitas ini, meluncurkan akhir musim panas:

Silakan klik untuk memutar jika video tidak autoplay. Cuplikan dari proyek virtual try-on video Google Doppl yang ditinggalkan. Sumber

Namun, Doppl ditutup pada April 2026 setelah penerimaan yang dingin, dengan pemirsa sekarang diarahkan ke layanan try-on gambar saja perusahaan try-on†:

Program try-on gambar saja Google, di mana pengguna diarahkan dari platform Doppl perusahaan yang ditinggalkan. Sumber

Meskipun ada beberapa platform yang menawarkan virtual try-on dengan video, tidak ada yang tampaknya berafiliasi dengan outlet aktual; dan mereka semua ‘bleeding edge’, marginal (dan sering ‘meragukan’) produk token-touting.

Sementara ada beberapa pendekatan menarik dari sektor penelitian, mereka secara tradisional merupakan arsitektur yang kompleks yang sulit diimplementasikan untuk latensi rendah dan kualitas tinggi:

Silakan klik untuk memutar jika video tidak autoplay. Dari proyek Fashion-VDM 2024, contoh ‘headless’ clothes transference. Sumber

Kenyataannya adalah bahwa tugas mengkonformasi pakaian ke orang nyata, tanpa mengganggu pakaian atau orang, sambil mempertahankan beberapa jenis gerakan demonstratif yang berguna (yang akurat menunjukkan bagian belakang produk ketika orang berbalik), adalah tantangan yang sangat besar bagi keadaan seni saat ini.

Vanast

Ini adalah tantangan yang sebuah makalah baru dari Korea mencoba untuk mengatasi, dengan menggunakan solusi terintegrasi yang baru dan sepenuhnya untuk memarsing pakaian + orang + gerakan:

Silakan klik untuk memutar jika video tidak autoplay. Contoh dari situs materi tambahan untuk proyek Vanast. Sumber

Sistem baru, yang berjudul Vanast, memanfaatkan dataset khusus yang menampilkan inkorporasi dan orkestrasi dari tiga faktor yang diperlukan untuk menyelesaikan tugas: pakaian; orang; dan gerakan:

Klik untuk memutar. Lebih banyak contoh dari situs proyek Vanast.

Sistem ini memanfaatkan kerangka kerja yang beragam seperti Flux, Qwen, dan ChatGPT, untuk menghasilkan ‘triplet’ dataset yang dapat memberitahu arsitektur ujung-ke-ujung:

Dari makalah baru, contoh titik data dataset yang digunakan untuk generasi dan pelatihan. Sumber –

Makalah baru berjudul Vanast: Virtual Try-On dengan Animasi Gambar Manusia melalui Pengawasan Triplet Sintetis, dan berasal dari empat peneliti di Universitas Nasional Seoul. Ada juga situs proyek yang dipenuhi video proyek.

Metode

Tujuan yang dinyatakan oleh penulis dalam karya ini adalah menggabungkan tiga aspek yang disebutkan sebelumnya dalam kerangka kerja satu tahap – tidak hanya karena prosesnya akan diskrit, tetapi juga karena memberikan berbagai aspek lebih banyak kesempatan untuk berinteraksi selama pelatihan, dengan pandangan untuk menghasilkan generasi yang lebih kohesif:

Vanast menggabungkan satu foto manusia, gambar pakaian terpisah, dan referensi gerakan untuk menghasilkan urutan gerakan di mana orang yang sama mengenakan pakaian baru, dengan bimbingan pose yang memastikan gerakan konsisten sambil identitas dan detail pakaian dipertahankan di seluruh bingkai.

Untuk mencapai ini, sistem mengambil gambar dari item pakaian target; foto orang yang mengenakan pakaian yang berbeda; video referensi gerakan yang mendefinisikan bagaimana orang harus bergerak; dan prompt teks yang menjelaskan tindakan dan pengaturan; dan menghasilkan urutan video lengkap di mana orang yang sama tampaknya mengenakan pakaian baru, sambil mengikuti gerakan yang diberikan, dengan setiap bingkai dipertahankan secara konsisten dari waktu ke waktu.

Bukannya memisahkan pakaian dan animasi menjadi tahap yang berbeda – yang telah menjadi pendekatan dalam sebagian besar karya serupa sebelumnya – Vanast menangani pakaian, identitas, dan gerakan bersama dalam satu proses, memungkinkan elemen-elemen ini untuk berinteraksi selama generasi, dan mengurangi jenis kesalahan dan ketidakstabilan yang ditunjukkan dalam metode sebelumnya.

Dataset

Pelatihan untuk proyek ini didasarkan pada contoh pasangan dari gambar orang, item pakaian yang sesuai, dan video dari orang yang bergerak sambil mengenakan pakaian tersebut, dengan gerakan diekstrak menggunakan arsitektur sebelumnya, untuk memberikan bimbingan pose yang stabil di seluruh bingkai.

Dalam ketiadaan dataset yang tersedia secara publik yang memenuhi persyaratan proyek, data dikumpulkan dari (tidak disebutkan) platform belanja online, memberikan cache video dengan pakaian yang beragam. Namun, tugas ini memerlukan video dari orang yang sama mengenakan beberapa pakaian, yang merupakan temuan yang jarang di data liar, dan yang memerlukan pembuatan data sintetis.

Proses tiga tahap melibatkan memilih bingkai yang sesuai dari video yang dikumpulkan, ditangani melalui Qwen2.5-VL Vision-Language Model (VLM), dengan cropping dan evaluasi kesesuaian yang sesuai (yaitu, tidak ada oklusi, subjek dalam posisi yang benar, dll.); dan membuat masker inpainting yang sesuai untuk mengisolasi area yang terkena – yang (sejalan dengan karya sebelumnya PERSE) ditangani oleh model difusi SDXL yang sekarang dihormati.

Gambaran pipeline Vanast, di mana gambar manusia, gambar pakaian target, dan video referensi gerakan dienkripsi dan diproses dalam model difusi video terpadu. Sistem menghasilkan animasi yang mempertahankan identitas, mengikuti urutan pose, dan menerapkan pakaian target, sementara generasi triplet sintetis mendukung pelatihan, dan desain dual-modul memisahkan animasi dari transfer pakaian, untuk mempertahankan konsistensi.

Dalam tahap ketiga, Qwen kembali bertugas untuk mengklasifikasikan gambar berdasarkan jenis kelamin, dan kerangka kerja difusi gambar Flux kemudian digunakan untuk membuat perubahan pada pakaian dalam gambar (karena Flux dapat menggabungkan beberapa elemen input). Prompt teks inpainting dikurasi oleh ChatGPT (versi tidak ditentukan).

Untuk meningkatkan keragaman pose dan latar belakang, pipeline diperkenalkan untuk mengonstruksi triplet pelatihan dari video liar, menggunakan dataset HumanVid. Proses yang sama digunakan untuk menghasilkan gambar manusia yang mempertahankan identitas.

Karena tidak ada gambar pakaian yang berdiri sendiri di video ini, gambar pakaian disintesis langsung dari footage. Bingkai dipilih dari setiap video, dan Qwen digunakan untuk memberi skor mereka untuk visibilitas frontal, sebelum memilih kandidat yang paling sesuai, berdasarkan visibilitas tubuh penuh, kejelasan gambar, oklusi minimal, kualitas pencahayaan, dan komposisi secara keseluruhan.

Area pakaian atas diekstrak menggunakan SegFormer, dan latar belakang dihilangkan untuk mengisolasi pakaian.

Untuk menghindari bias posisional, area pakaian dipindahkan secara acak dalam kotak pembatasnya, dan Qwen digunakan lagi untuk menyaring segmentasi yang tidak dapat diandalkan. Proses ini menghasilkan gambar pakaian sintetis yang dipasangkan dengan gerakan dan identitas, memungkinkan konstruksi triplet besar dari data video yang tidak terstruktur, sambil meningkatkan kekuatan dalam berbagai kondisi dunia nyata.

Arsitektur

Arsitektur dual-modul diperkenalkan untuk mengatasi konvergensi yang lambat dan keseimbangan kontrol yang lemah yang dilihat pada metode sebelumnya yang mencoba menggabungkan semua kondisi. Pendekatan ini memanfaatkan transformer difusi video-ke-teks dari Wan, dan juga mengambil dari proyek VACE (lihat di bawah).

Model ini dibagi menjadi Modul Animasi Manusia (HAM), yang menangani gerakan dan identitas dari input manusia dan pose; dan Modul Transfer Pakaian (GTM), yang menangani pakaian dari gambar pakaian. Kedua modul berbagi akses ke backbone, sambil mengintegrasikan fitur dalam cara yang terdistribusi dan berkaskade, untuk meningkatkan kondisi.

Pelatihan dilakukan dengan membekukan backbone dan mengoptimalkan hanya parameter HAM dan GTM, dengan kontribusi mereka seimbang selama integrasi fitur. Input dari dataset triplet sintetis diubah menjadi representasi laten menggunakan VAE Wan.

Konteks gerakan yang sadar dibangun dengan menggabungkan informasi manusia dan pose di seluruh waktu, sementara fitur pakaian diproses secara terpisah, dan diselaraskan melalui proyeksi ke dalam token embeddings.

Model ini juga diperluas untuk mendukung interpolasi pakaian. Di sini, representasi dari dua pakaian digabungkan untuk menghasilkan transisi yang halus, memungkinkan pencampuran yang konsisten dan kohesif antara item pakaian, tanpa optimasi tambahan.

Data dan Tes

Model ini dilatih pada 9.135 video, dengan panjang yang bervariasi dari tiga hingga sepuluh detik, bersumber dari ‘situs mall’; dataset yang dihasilkan sendiri; dan dataset HumanVid.

Dari ini, dua dataset evaluasi dibentuk: ‘dataset Internet’, yang menampilkan video dan gambar produk dari mall; dan bagian tes resmi dari dataset ViViD Alibaba.

Karena data ViViD tidak memiliki wajah (lihat video di atas, untuk contoh dari ini, yang sangat umum dalam literatur virtual try-on), wajah ditambahkan melalui Flux outpainting.

Metrik yang digunakan adalah L1 loss; Peak Signal-to-Noise Ratio (PSNR); Structural Similarity Index (SSIM); Learned Perceptual Image Patch Similarity (LPIPS); Fréchet Inception Distance (FID); dan Fréchet Video Distance†† (FVD)

Sistem yang diuji untuk transfer pakaian adalah OOTDiffusion; CatVTON; OmniTry; dan Any2AnyTryon. Model generasi gambar ke subjek yang diuji adalah VisualCloze; MOSAIC; dan UNO ByteDance.

Untuk tahap kedua animasi gambar manusia, kerangka kerja StableAnimator dan DisPose digunakan.

Dalam konteks yang lebih terbatas (karena tidak secara langsung mendukung tujuan), VACE juga diuji, dengan beberapa upaya untuk mengimbangkan fungsionalitas yang hilang:

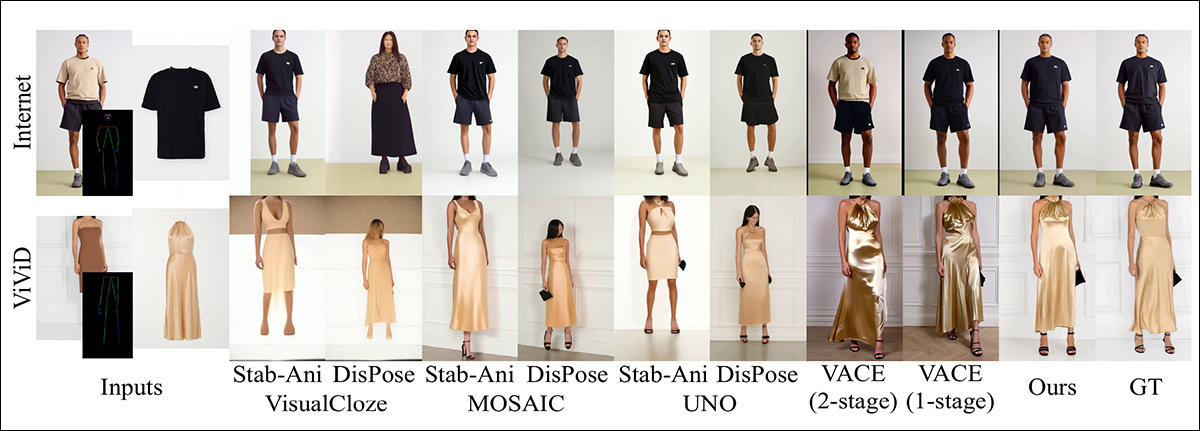

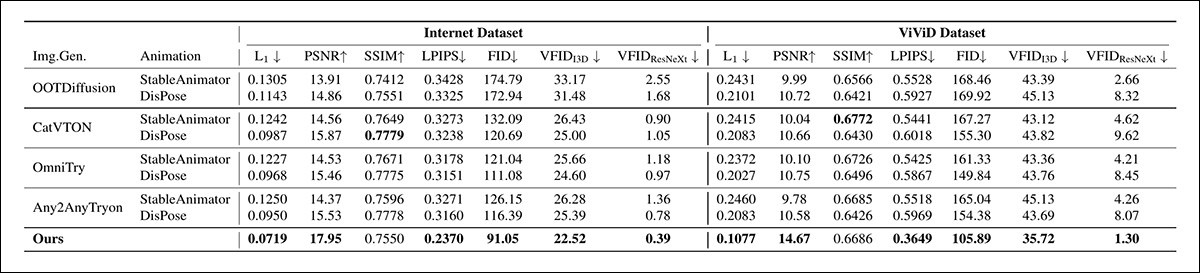

Perbandingan kuantitatif terhadap kombinasi model subjek-ke-gambar dan animasi pada dataset Internet dan ViViD, di mana metode yang diusulkan mencapai kinerja terbaik di seluruh metrik yang dilaporkan. Nilai tebal menunjukkan skor teratas di setiap kolom.

Dari hasil awal yang ditunjukkan di atas, penulis menyatakan:

‘[Model kami] mencapai kinerja terbaik di seluruh metrik ketika dibandingkan dengan kombinasi model generasi gambar ke subjek dan animasi.

‘Hasil kualitatif [ditunjukkan di bawah] lebih lanjut mengkonfirmasi bahwa pendekatan kami menghasilkan pengikuan pose yang paling akurat dan transfer pakaian, sementara mempertahankan identitas lebih setia daripada semua baseline berbasis subjek-ke-gambar.’

Perbandingan kualitatif pada dataset Internet dan ViViD terhadap baseline subjek-ke-gambar dan animasi, di mana metode yang diusulkan, menurut penulis, menawarkan pengikuan pose yang lebih akurat dan transfer pakaian, sementara mempertahankan identitas lebih konsisten daripada VisualCloze, MOSAIC, UNO, dan VACE.

Untuk kategori tes kedua, di mana kombinasi virtual try-on gambar dan model animasi diuji, karya baru ini lagi-lagi mencapai skor tertinggi:

Perbandingan kuantitatif dengan kombinasi model virtual try-on berbasis gambar dan animasi pada dataset Internet dan ViViD. Metode yang diusulkan mencapai kinerja terbaik secara keseluruhan di seluruh metrik, dengan SSIM tetap setara dengan baseline terkuat. Nilai tebal menunjukkan skor tertinggi.

Penulis menambahkan:

‘Perbandingan kualitatif [ditunjukkan di bawah] menunjukkan bahwa hasil kami paling mirip dengan kebenaran di antara semua baseline berbasis virtual try-on.’

Tes kualitatif menggunakan baseline yang dibuat dengan menggabungkan model VTON dengan model animasi.

Kesimpulan

Meskipun proyek Vanast mencapai solusi ujung-ke-ujung yang diskrit, kurangnya detail dalam makalah tentang persyaratan sumber daya pelatihan dan inferensi menunjukkan bahwa ini mungkin tidak menjadi solusi yang paling lincah atau gesit. Pada kenyataannya, tantangan itu sendiri sangat sulit untuk dicapai bahkan dalam sistem yang tidak dioptimalkan – dan bagaimana lagi dalam penerapan komersial yang memerlukan latensi rendah dan ROI yang skalabel..

Virtual try-on adalah salah satu dari beberapa tujuan ‘moonshot’ AI di mana keadaan seni saat ini, seperti yang diterapkan melalui berbagai headline dan hasil yang dipilih, menutupi kesulitan sebenarnya dari tugas, yang mungkin akhirnya akan diselesaikan oleh teknologi yang lebih lanjut dan lebih ringan daripada Transformer.

† Tersedia di AS, diblokir geo di banyak wilayah lain, jika tidak semua.

†† Penulis merujuk pada ‘VFID’, tetapi hanya menautkan ke makalah ViViD, yang tidak membenarkan referensi, sejauh yang saya ketahui, dengan waktu terbatas untuk melacaknya. Saya menganggap bahwa mereka sebenarnya bermaksud Fréchet Video Distance (FVD), dan juga kekurangan waktu. Silakan hubungi saya untuk perubahan, jika perlu.

Dipublikasikan pertama kali pada hari Rabu, 8 April 2026