Sudut Anderson

Masa Depan Generasi Gambar yang Ditingkatkan dengan RAG

Model difusi generatif seperti Stable Diffusion, Flux, dan model video seperti Hunyuan bergantung pada pengetahuan yang diperoleh selama satu sesi pelatihan yang intensif dengan menggunakan dataset tetap. Konsep apa pun yang diperkenalkan setelah pelatihan ini – yang disebut sebagai batas pengetahuan – tidak ada dalam model kecuali dilengkapi melalui penyetelan halus atau teknik adaptasi eksternal seperti Low Rank Adaptation (LoRA).

Oleh karena itu, akan ideal jika sistem generatif yang menghasilkan gambar atau video dapat mengakses sumber online dan memasukkannya ke dalam proses generasi sesuai kebutuhan. Dengan cara ini, misalnya, model difusi yang tidak mengetahui tentang rilis terbaru Apple atau Tesla masih dapat menghasilkan gambar yang mengandung produk baru tersebut.

Dalam kaitannya dengan model bahasa, sebagian besar dari kita sudah familiar dengan sistem seperti Perplexity, Notebook LM, dan ChatGPT-4o, yang dapat memasukkan informasi eksternal baru ke dalam model Retrieval Augmented Generation (RAG).

Proses RAG membuat respons ChatGPT 4o lebih relevan. Sumber: https://chatgpt.com/

Namun, ini adalah fasilitas yang tidak umum ketika datang ke generasi gambar, dan ChatGPT akan mengakui keterbatasannya dalam hal ini:

ChatGPT 4o telah membuat tebakan yang baik tentang visualisasi rilis jam tangan baru, berdasarkan garis umum dan deskripsi yang telah ditafsirkan; tetapi tidak dapat ‘menyerap’ dan mengintegrasikan gambar baru ke dalam generasi berbasis DALL-E.

Memasukkan data yang diperoleh dari luar ke dalam gambar yang dihasilkan adalah tantangan karena gambar masuk harus pertama kali dipecah menjadi token dan embedding, yang kemudian dipetakan ke pengetahuan domain terdekat model tentang subjek tersebut.

Sementara proses ini bekerja secara efektif untuk alat pasca-pelatihan seperti ControlNet, manipulasi seperti itu tetap superfisial, pada dasarnya mengalirkan gambar yang diperoleh melalui pipeline rendering, tetapi tanpa mengintegrasikan secara mendalam ke dalam representasi internal model.

Sebagai hasilnya, model kekurangan kemampuan untuk menghasilkan perspektif baru dengan cara yang sama seperti sistem rendering neural seperti NeRF dapat, yang membangun adegan dengan pemahaman spasial dan struktural yang sebenarnya.

Logika Matang

Keterbatasan serupa berlaku untuk kueri berbasis RAG dalam Model Bahasa Besar (LLM), seperti Perplexity. Ketika model jenis ini memproses data yang diperoleh dari luar, ia berfungsi banyak seperti orang dewasa yang menggambar dari pengetahuan seumur hidup untuk menginferensi probabilitas tentang topik tertentu.

Namun, sama seperti orang tidak dapat mengintegrasikan informasi baru secara retroaktif ke dalam kerangka kognitif yang membentuk pandangan dunia dasar mereka – ketika bias dan prasangka mereka masih terbentuk – LLM tidak dapat menggabungkan pengetahuan baru secara mulus ke dalam struktur pra-pelatihan.

Sebaliknya, ia hanya dapat ‘menggunakan’ atau menempatkan data baru melawan pengetahuan internal yang telah diinternalisasi, menggunakan prinsip yang dipelajari untuk menganalisis dan menebak daripada mensintesis pada tingkat dasar.

Kekurangan ini dalam kesetaraan antara penempatan dan internalisasi generasi kemungkinan lebih jelas dalam gambar yang dihasilkan daripada dalam generasi berbasis bahasa: koneksi jaringan yang lebih dalam dan kreativitas yang meningkat dari ‘asli’ (bukan berbasis RAG) generasi telah ditetapkan dalam berbagai studi.

Risiko Tersembunyi dari Generasi Gambar yang Mampu RAG

Bahkan jika secara teknis memungkinkan untuk mengintegrasikan gambar internet yang diperoleh secara mulus ke dalam gambar yang disintesis baru dengan cara RAG, keterbatasan keamanan akan menimbulkan tantangan tambahan.

Banyak dataset yang digunakan untuk melatih model generatif telah dikurasi untuk meminimalkan kehadiran konten eksplisit, rasialis, atau kekerasan, di antara kategori sensitif lainnya. Namun, proses ini tidak sempurna, dan asosiasi residu dapat bertahan. Untuk memitigasi ini, sistem seperti DALL·E dan Adobe Firefly bergantung pada mekanisme penyaringan sekunder yang menyaring baik prompt input dan output yang dihasilkan untuk konten yang dilarang.

Sebagai hasilnya, filter NSFW sederhana – yang pada dasarnya memblokir konten eksplisit – akan tidak cukup untuk menilai akseptabilitas data RAG yang diperoleh. Konten seperti itu masih dapat menyinggung atau berbahaya dengan cara yang jatuh di luar parameter moderasi model, potensial memperkenalkan materi yang AI kurang kesadaran kontekstual untuk menilai secara memadai.

Penemuan kerentanan baru-baru ini dalam DeepSeek yang diproduksi CCP, yang dirancang untuk menekan diskusi tentang konten politik yang dilarang, telah menyoroti bagaimana jalur input alternatif dapat dieksploitasi untuk melewati pengaman etis model; secara beralasan, ini juga berlaku untuk data baru yang diperoleh secara sewenang-wenang dari internet, ketika dimaksudkan untuk dimasukkan ke dalam generasi gambar baru.

RAG untuk Generasi Gambar

Meskipun tantangan dan aspek politis yang rumit, sejumlah proyek telah muncul yang berusaha menggunakan metode RAG untuk memasukkan data baru ke dalam generasi visual.

ReDi

Proyek 2023 Retrieval-based Diffusion (ReDi) adalah kerangka kerja bebas-pelatihan yang mempercepat inferensi model difusi dengan mengambil trayektori serupa dari basis pengetahuan pra-komputasi.

Nilai dari dataset dapat ‘dipinjam’ untuk generasi baru di ReDi. Sumber: https://arxiv.org/pdf/2302.02285

Dalam konteks model difusi, trayektori adalah jalur langkah-demi-langkah yang diambil model untuk menghasilkan gambar dari kebisingan murni. Biasanya, proses ini terjadi secara bertahap selama banyak langkah, dengan setiap langkah memperhalus gambar sedikit lebih banyak.

ReDi mempercepat proses ini dengan melewati sejumlah langkah tersebut. Alih-alih menghitung setiap langkah, ia mengambil trayektori serupa dari basis data dan melompat ke titik yang lebih lanjut dalam proses. Ini mengurangi jumlah perhitungan yang diperlukan, membuat generasi gambar berbasis difusi jauh lebih cepat, sambil tetap menjaga kualitasnya.

ReDi tidak memodifikasi bobot model difusi, tetapi menggunakan basis pengetahuan untuk melewati langkah-langkah intermediate, sehingga mengurangi jumlah estimasi fungsi yang diperlukan untuk sampling.

Tentu saja, ini tidak sama dengan mengintegrasikan gambar tertentu sesuai keinginan ke dalam permintaan generasi; tetapi ini terkait dengan jenis generasi yang serupa.

Diluncurkan pada 2022, tahun ketika model difusi laten menangkap imajinasi publik, ReDi tampaknya merupakan salah satu pendekatan berbasis difusi pertama yang menggunakan metodologi RAG.

Meskipun demikian, perlu disebutkan bahwa pada 2021, Facebook Research merilis Instance-Conditioned GAN, yang berusaha untuk mengondisikan gambar GAN pada input gambar baru, jenis proyeksi ke dalam ruang laten sangat umum dalam literatur, baik untuk GAN dan model difusi; tantangannya adalah membuat proses seperti itu bebas-pelatihan dan fungsional dalam waktu nyata, seperti metode RAG yang berfokus pada LLM.

RDM

Salah satu upaya awal lainnya dalam generasi gambar yang ditingkatkan dengan RAG adalah Retrieval-Augmented Diffusion Models (RDM), yang memperkenalkan pendekatan semi-parametrik untuk sintesis gambar generatif. Sementara model difusi tradisional menyimpan semua pengetahuan visual yang dipelajari dalam parameter jaringan neural, RDM bergantung pada basis data gambar eksternal:

Tetangga terdekat yang diperoleh dalam pseudo-kueri ilustratif di RDM*.

Selama pelatihan, model mengambil tetangga terdekat (gambar yang secara visual atau semantik mirip) dari basis data eksternal, untuk memandu proses generasi. Ini memungkinkan model untuk mengondisikan outputnya pada contoh visual dunia nyata.

Proses pengambilan didukung oleh CLIP embeddings, yang dirancang untuk memaksa gambar yang diperoleh untuk berbagi kesamaan bermakna dengan kueri, dan juga untuk menyediakan informasi baru untuk meningkatkan generasi.

Pendekatan RDM mendukung modifikasi pasca-pelatihan: peneliti dapat menukar basis data pada saat inferensi, memungkinkan adaptasi nol-tembakan ke gaya, domain, atau bahkan tugas yang sama sekali berbeda seperti stilisasi atau sintesis kondisional kelas.

Pada baris bawah, kita melihat tetangga terdekat yang ditarik ke dalam proses difusi di RDM*.

Kelebihan utama RDM adalah kemampuannya untuk meningkatkan generasi gambar tanpa memerlukan pelatihan ulang model. Dengan hanya mengubah basis data pengambilan, model dapat menggeneralisasi ke konsep baru yang tidak pernah secara eksplisit dilatih sebelumnya. Ini sangat berguna untuk aplikasi di mana pergeseran domain terjadi, seperti menghasilkan citra medis berdasarkan dataset yang berkembang, atau mengadaptasi model teks-ke-gambar untuk aplikasi kreatif.

Namun, pendekatan berbasis pengambilan seperti ini bergantung pada kualitas dan relevansi basis data eksternal, yang membuat kurasi data menjadi faktor penting dalam mencapai generasi berkualitas tinggi; dan pendekatan ini masih jauh dari sintesis gambar setara dengan interaksi RAG yang khas dalam LLM komersial.

ReMoDiffuse

ReMoDiffuse adalah model difusi gerakan yang ditingkatkan dengan RAG untuk generasi gerakan manusia 3D. Tidak seperti model generasi gerakan tradisional yang bergantung sepenuhnya pada representasi yang dipelajari, ReMoDiffuse mengambil sampel gerakan relevan dari dataset gerakan besar dan mengintegrasikannya ke dalam proses denoising, dalam skema yang mirip dengan RDM (lihat di atas).

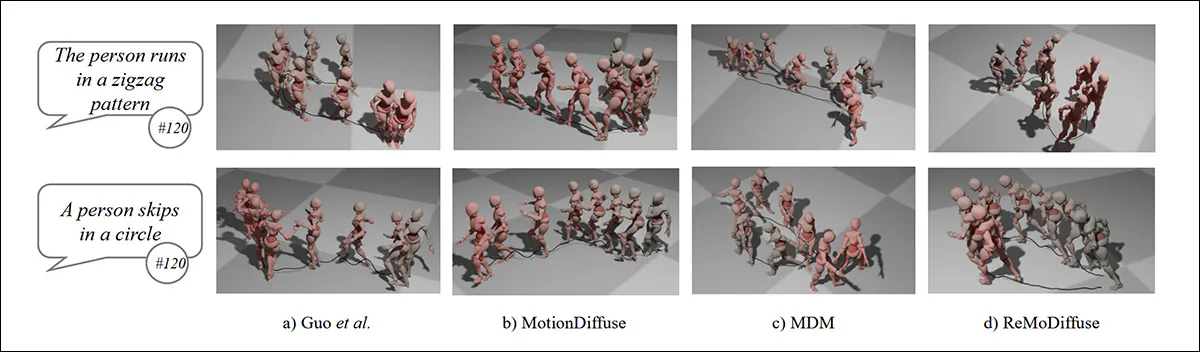

Perbandingan RAG-ditingkatkan ReMoDiffuse (paling kanan) dengan metode sebelumnya. Sumber: https://arxiv.org/pdf/2304.01116

Ini memungkinkan model untuk menghasilkan urutan gerakan yang dirancang untuk lebih alami dan beragam, serta setia secara semantik terhadap prompt teks pengguna.

ReMoDiffuse menggunakan mekanisme pengambilan hybrid inovatif, yang memilih urutan gerakan berdasarkan kesamaan semantik dan kinematik, dengan tujuan memastikan bahwa gerakan yang diperoleh tidak hanya secara tematis relevan tetapi juga secara fisik memungkinkan ketika diintegrasikan ke dalam generasi baru.

Model kemudian memperhalus sampel yang diperoleh ini menggunakan Transformer yang Dimodulasi Semantik, yang secara selektif menggabungkan pengetahuan dari gerakan yang diperoleh sambil mempertahankan kualitas khas dari urutan gerakan yang dihasilkan:

Skema untuk pipeline ReMoDiffuse.

Teknik Campuran Kondisi proyek ini meningkatkan kemampuan model untuk menggeneralisasi di seluruh prompt dan kondisi pengambilan yang berbeda, menyeimbangkan sampel gerakan yang diperoleh dengan prompt teks selama generasi, dan menyesuaikan seberapa banyak bobot yang diberikan pada setiap sumber pada setiap langkah.

Ini dapat membantu mencegah output yang tidak realistis atau berulang, bahkan untuk prompt yang jarang. Ini juga menangani masalah sensitivitas skala yang sering muncul dalam teknik bimbingan bebas klasifikasi yang umum digunakan dalam model difusi.

RA-CM3

Pada 2023, makalah Retrieval-Augmented Multimodal Language Modeling (RA-CM3) dari Stanford memungkinkan sistem untuk mengakses informasi dunia nyata pada saat inferensi:

Model Retrieval-Augmented Multimodal Language Modeling (RA-CM3) dari Stanford menggunakan gambar yang diperoleh dari internet untuk meningkatkan proses generasi, tetapi tetap sebagai prototipe tanpa akses publik. Sumber: https://cs.stanford.edu/~myasu/files/RACM3_slides.pdf

RA-CM3 mengintegrasikan teks dan gambar yang diperoleh ke dalam pipeline generasi, meningkatkan baik sintesis teks-ke-gambar dan gambar-ke-teks. Menggunakan CLIP untuk pengambilan dan Transformer sebagai generator, model ini merujuk pada dokumen multimodal yang relevan sebelum menyusun output.

Benchmarks pada MS-COCO menunjukkan perbaikan yang signifikan dibandingkan dengan DALL-E dan sistem serupa, mencapai pengurangan 12 poin Fréchet Inception Distance (FID), dengan biaya komputasi yang jauh lebih rendah.

Namun, seperti pendekatan berbasis pengambilan lainnya, RA-CM3 tidak menginternalisasi pengetahuan yang diperoleh secara mulus. Sebaliknya, ia menumpangkan data baru melawan jaringan pra-pelatihan, banyak seperti LLM yang meningkatkan respons dengan hasil pencarian. Sementara metode ini dapat meningkatkan akurasi faktual, tidak menggantikan kebutuhan akan pembaruan pelatihan dalam domain di mana sintesis yang dalam diperlukan.

Lebih lanjut, implementasi praktis dari sistem ini tidak tampaknya telah dirilis, bahkan ke platform berbasis API.

RealRAG

Rilis baru dari Cina, dan yang telah memicu tinjauan ini tentang sistem generatif gambar yang ditingkatkan dengan RAG, disebut Retrieval-Augmented Realistic Image Generation (RealRAG).

Gambar eksternal yang ditarik ke dalam RealRAG (tengah bawah). Sumber: https://arxiv.o7rg/pdf/2502.00848

RealRAG mengambil gambar aktual dari objek yang relevan dari basis data yang dikurasi dari dataset yang tersedia secara publik seperti ImageNet, Stanford Cars, Stanford Dogs, dan Oxford Flowers. Kemudian, ia mengintegrasikan gambar yang diperoleh ke dalam proses generasi, mengatasi kesenjangan pengetahuan dalam model.

Komponen kunci dari RealRAG adalah pembelajaran kontras reflektif, yang melatih model pengambilan untuk menemukan gambar referensi yang informatif, bukan hanya memilih secara visual mirip.

Penulis menyatakan:

‘Wawasan utama kami adalah melatih pengambil yang mengambil gambar yang tetap di luar ruang generasi generator, tetapi dekat dengan representasi prompt teks.

‘Untuk ini, kami pertama-tama menghasilkan gambar dari prompt teks yang diberikan dan kemudian menggunakan gambar yang dihasilkan sebagai kueri untuk mengambil gambar paling relevan dalam basis data berbasis objek nyata. Gambar paling relevan ini digunakan sebagai negatif reflektif.’

Pendekatan ini memastikan bahwa gambar yang diperoleh memberikan pengetahuan yang hilang ke dalam proses generasi, bukan memperkuat bias yang ada dalam model.

Kiri, gambar referensi yang diperoleh; tengah, tanpa RAG; kanan, dengan menggunakan gambar yang diperoleh.

Namun, ketergantungan pada kualitas pengambilan dan cakupan basis data berarti bahwa efektivitasnya dapat bervariasi tergantung pada ketersediaan referensi berkualitas tinggi. Jika gambar yang relevan tidak ada dalam dataset, model masih dapat bergelut dengan konsep yang tidak familiar.

RealRAG adalah arsitektur yang sangat modular, menawarkan kompatibilitas dengan berbagai arsitektur generatif lainnya, termasuk model berbasis U-Net, DiT, dan autoregresif.

Secara umum, pengambilan dan pemrosesan gambar eksternal menambahkan overhead komputasi, dan kinerja sistem bergantung pada seberapa baik mekanisme pengambilan menggeneralisasi di seluruh tugas dan dataset yang berbeda.

Kesimpulan

Ini adalah tinjauan yang representatif daripada menyeluruh tentang sistem generatif multimodal yang mengambil gambar. Beberapa sistem dari jenis ini menggunakan pengambilan hanya untuk meningkatkan pemahaman visi atau kurasi dataset, di antara motif yang beragam; bukan untuk menghasilkan gambar. Salah satu contoh adalah Internet Explorer.

Banyak proyek RAG-integrasi lainnya dalam literatur tetap tidak dirilis. Prototipe, dengan hanya penelitian yang dipublikasikan, termasuk Re-Imagen, yang – meskipun berasal dari Google – hanya dapat mengakses gambar dari basis data kustom lokal.

Juga, pada November 2024, Baidu mengumumkan Image-Based Retrieval-Augmented Generation (iRAG), platform baru yang menggunakan gambar yang diperoleh ‘dari basis data’. Meskipun iRAG dilaporkan tersedia di platform Ernie, tampaknya tidak ada detail lebih lanjut tentang proses pengambilan ini, yang tampaknya bergantung pada basis data lokal (yaitu, lokal untuk layanan dan tidak dapat diakses langsung oleh pengguna).

Lebih lanjut, makalah 2024 Unified Text-to-Image Generation and Retrieval menawarkan metode RAG lain untuk menggunakan gambar eksternal untuk meningkatkan hasil pada saat generasi – lagi-lagi, dari basis data lokal dan bukan dari sumber ad hoc internet.

Antusiasme seputar peningkatan RAG dalam generasi gambar kemungkinan akan fokus pada sistem yang dapat mengintegrasikan gambar yang diperoleh dari internet langsung ke dalam proses generatif, dan yang memungkinkan pengguna untuk berpartisipasi dalam pilihan atau sumber gambar.

Namun, ini adalah tantangan signifikan karena setidaknya dua alasan; pertama, karena efektivitas sistem seperti ini biasanya bergantung pada hubungan yang terintegrasi dalam yang dibentuk selama proses pelatihan yang intensif; dan kedua, karena kekhawatiran tentang keamanan, legalitas, dan batasan hak cipta, seperti yang disebutkan sebelumnya, membuat fitur ini tidak mungkin untuk layanan berbasis web dan penerapan komersial pada umumnya.

* Sumber: https://proceedings.neurips.cc/paper_files/paper/2022/file/62868cc2fc1eb5cdf321d05b4b88510c-Paper-Conference.pdf

Dipublikasikan pertama kali pada Selasa, 4 Februari 2025