Kecerdasan buatan

Supercharging Graph Neural Networks dengan Large Language Models: Panduan Ultimate

Grafik adalah struktur data yang merepresentasikan hubungan kompleks di berbagai domain, termasuk jaringan sosial, basis pengetahuan, sistem biologis, dan banyak lagi. Dalam grafik ini, entitas direpresentasikan sebagai node, dan hubungan mereka digambarkan sebagai edge.

Kemampuan untuk merepresentasikan dan menalar tentang struktur relasional yang rumit ini sangat penting untuk memungkinkan kemajuan di bidang seperti ilmu jaringan, kemoinformatika, dan sistem rekomendasi.

Graph Neural Networks (GNNs) telah muncul sebagai kerangka kerja deep learning yang kuat untuk tugas pembelajaran mesin grafik. Dengan mengintegrasikan topologi grafik ke dalam arsitektur jaringan neural melalui agregasi tetangga atau konvolusi grafik, GNNs dapat mempelajari representasi vektor berdimensi rendah yang mengkodekan baik fitur node dan peran struktural mereka. Ini memungkinkan GNNs untuk mencapai kinerja terbaik pada tugas seperti klasifikasi node, prediksi tautan, dan klasifikasi grafik di berbagai area aplikasi.

Sementara GNNs telah menggerakkan kemajuan substantif, beberapa tantangan kunci masih ada. Mendapatkan data berlabel berkualitas tinggi untuk pelatihan model GNN yang diawasi dapat mahal dan memakan waktu. Selain itu, GNNs dapat bergelut dengan struktur grafik heterogen dan situasi di mana distribusi grafik pada waktu pengujian berbeda secara signifikan dari data pelatihan (generalisasi out-of-distribution).

Secara paralel, Large Language Models (LLMs) seperti GPT-4, dan LLaMA telah mengambil dunia dengan kemampuan pemahaman dan generasi bahasa alami yang luar biasa. Dilatih pada korpus teks besar dengan miliaran parameter, LLMs menunjukkan kemampuan pembelajaran few-shot yang luar biasa, generalisasi di seluruh tugas, dan keterampilan penalaran yang umum yang sebelumnya dianggap sangat menantang untuk sistem AI.

Kesuksesan luar biasa dari LLMs telah memicu eksplorasi untuk memanfaatkan kekuatan mereka untuk tugas pembelajaran mesin grafik. Di satu sisi, kemampuan pengetahuan dan penalaran LLMs menawarkan kesempatan untuk meningkatkan model GNN tradisional. Sebaliknya, representasi terstruktur dan pengetahuan faktual yang melekat dalam grafik dapat menjadi instrumental dalam mengatasi beberapa keterbatasan kunci LLMs, seperti halusinasi dan kurangnya interpretasi.

Graph Neural Networks dan Pembelajaran Mandiri

Untuk memberikan konteks yang diperlukan, kita akan pertama-tama meninjau konsep dan metode inti dalam graph neural networks dan pembelajaran representasi grafik mandiri.

Arsitektur Graph Neural Network

Arsitektur Graph Neural Network – sumber

Perbedaan kunci antara jaringan neural tradisional dan GNNs terletak pada kemampuan mereka untuk beroperasi langsung pada data terstruktur grafik. GNNs mengikuti skema agregasi tetangga, di mana setiap node mengagregasi vektor fitur dari tetangganya untuk menghitung representasinya sendiri.

Banyak arsitektur GNN telah diusulkan dengan instantiasi berbeda dari fungsi pesan dan pembaruan, seperti Graph Convolutional Networks (GCNs), GraphSAGE, Graph Attention Networks (GATs), dan Graph Isomorphism Networks (GINs) di antaranya.

Lebih baru-baru ini, graph transformer telah mendapatkan popularitas dengan menyesuaikan mekanisme perhatian mandiri dari transformer bahasa alami untuk beroperasi pada data terstruktur grafik. Beberapa contoh termasuk GraphormerTransformer, dan GraphFormers. Model-model ini dapat menangkap ketergantungan jangka panjang di seluruh grafik lebih baik daripada GNNs berbasis tetangga murni.

Pembelajaran Mandiri pada Grafik

Sementara GNNs adalah model representasi yang kuat, kinerjanya sering kali terhambat oleh kurangnya dataset berlabel besar yang diperlukan untuk pelatihan yang diawasi. Pembelajaran mandiri telah muncul sebagai paradigma yang menjanjikan untuk melakukan pra-pelatihan GNNs pada data grafik tidak berlabel dengan memanfaatkan tugas pretext yang hanya memerlukan struktur grafik intrinsik dan fitur node.

Grafik Mandiri – sumber

Beberapa tugas pretext umum yang digunakan untuk pra-pelatihan GNNs mandiri termasuk:

- Prediksi Properti Node: Mengacakan atau merusak sebagian dari atribut/node fitur dan meminta GNN untuk merekonstruksinya.

- Prediksi Tautan/Edge: Belajar untuk memprediksi apakah tautan ada antara pasangan node, sering berdasarkan pengacakan tautan acak.

- Pembelajaran Kontras: Maksimalkan kesamaan antara grafik tampilan dari sampel grafik yang sama sementara mendorong tampilan dari grafik yang berbeda.

- Maksimisasi Informasi Mutua: Maksimalkan informasi mutua antara representasi node lokal dan representasi target seperti penyematan grafik global.

Tugas pretext seperti ini memungkinkan GNN untuk mengekstrak pola struktural dan semantik yang bermakna dari data grafik tidak berlabel selama pra-pelatihan. GNN yang telah dipra-pelatih dapat kemudian diperhalus pada subset berlabel yang relatif kecil untuk unggul dalam berbagai tugas hilir seperti klasifikasi node, prediksi tautan, dan klasifikasi grafik.

Dengan memanfaatkan pengawasan mandiri, GNNs yang dipra-pelatih pada dataset besar tidak berlabel menunjukkan generalisasi yang lebih baik, kekuatan terhadap pergeseran distribusi, dan efisiensi dibandingkan dengan pelatihan dari awal. Namun, beberapa keterbatasan kunci dari metode pembelajaran mandiri GNN tradisional masih ada, yang akan kita jelajahi untuk dimanfaatkan dengan LLMs berikutnya.

Meningkatkan Pembelajaran Grafik dengan Large Language Models

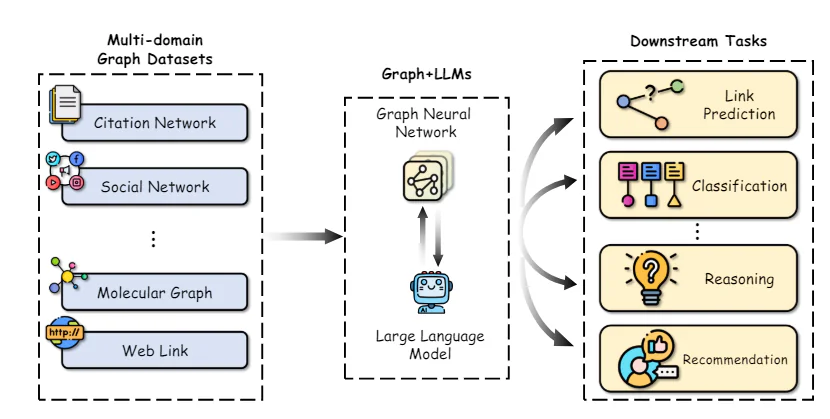

Integrasi Grafik dan LLM – sumber

Kemampuan luar biasa dari LLMs dalam memahami bahasa alami, penalaran, dan pembelajaran few-shot menawarkan kesempatan untuk meningkatkan berbagai aspek pipa pembelajaran mesin grafik. Kita menjelajahi beberapa arah penelitian kunci dalam ruang ini:

Tantangan kunci dalam menerapkan GNNs adalah mendapatkan representasi fitur berkualitas tinggi untuk node dan edge, terutama ketika mereka berisi atribut teks kaya seperti deskripsi, judul, atau abstrak. Secara tradisional, model pengemasan kata sederhana atau word embedding pra-pelatih telah digunakan, yang sering gagal menangkap semantik yang nuansa.

Karya terbaru telah menunjukkan kekuatan memanfaatkan large language models sebagai pengkode teks untuk membangun representasi fitur node/edge yang lebih baik sebelum melewatinya ke GNN. Misalnya, Chen et al. menggunakan LLMs seperti GPT-3 untuk mengkode atribut teks node, menunjukkan peningkatan kinerja yang signifikan atas word embedding tradisional pada tugas klasifikasi node.

Selain pengkode teks yang lebih baik, LLMs dapat digunakan untuk menghasilkan informasi tambahan dari atribut teks asli dengan cara semi-terawasi. TAPE menghasilkan label/explanasi potensial untuk node menggunakan LLM dan menggunakan ini sebagai fitur tambahan.

Dengan meningkatkan kualitas dan ekspresivitas fitur input, LLMs dapat membagikan kemampuan pemahaman bahasa alami yang unggul kepada GNNs, meningkatkan kinerja pada tugas hilir.