Sudut Anderson

Mengembalikan dan Mengedit Gambar Manusia Dengan AI

Kolaborasi baru antara University of California Merced dan Adobe menawarkan kemajuan pada keadaan saat ini di human image completion – tugas yang banyak dipelajari untuk ‘menghilangkan’ bagian tersembunyi atau terhalang dari gambar orang, untuk tujuan seperti virtual try-on, animasi dan pengeditan foto.

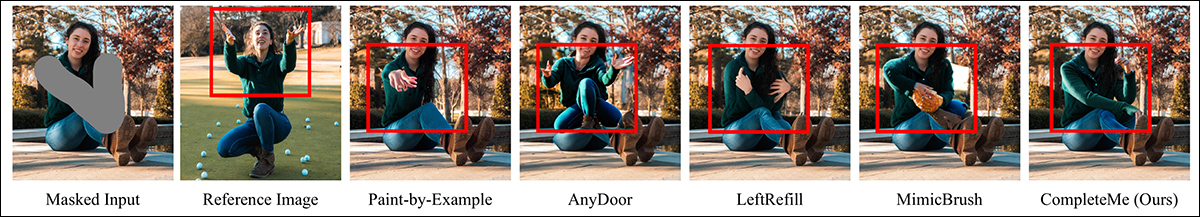

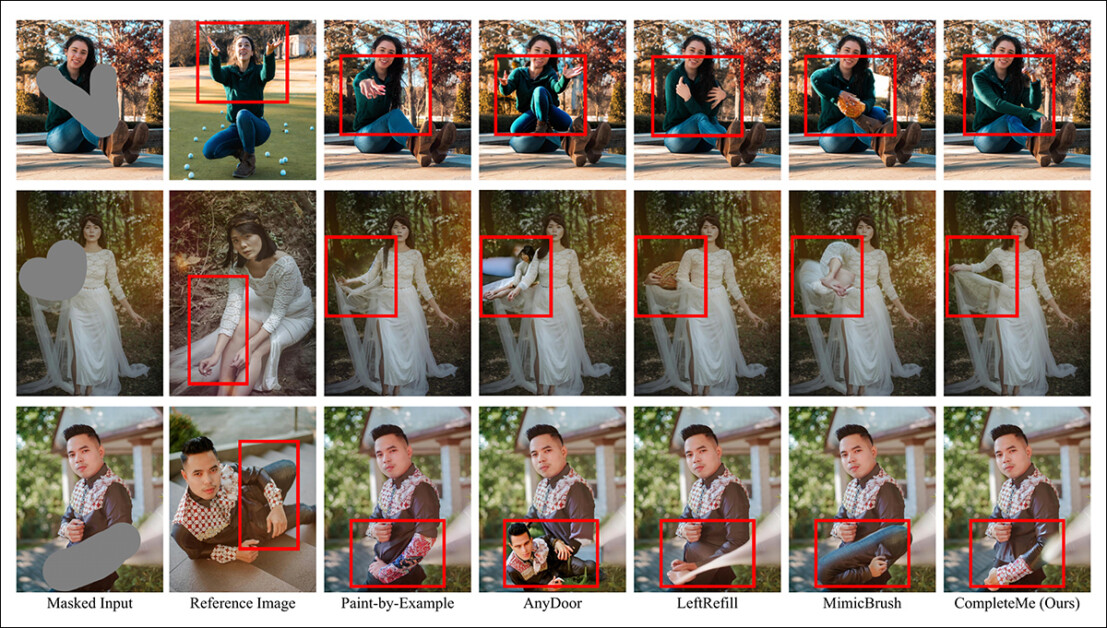

Selain memperbaiki gambar yang rusak atau mengubahnya sesuai keinginan pengguna, sistem human image completion seperti CompleteMe dapat menerapkan pakaian baru (melalui gambar referensi tambahan, seperti pada kolom tengah dalam dua contoh ini) ke dalam gambar yang ada. Contoh-contoh ini dari suplemen PDF yang luas untuk makalah baru. Source: https://liagm.github.io/CompleteMe/pdf/supp.pdf

Pendekatan baru, yang berjudul CompleteMe: Reference-based Human Image Completion, menggunakan gambar input tambahan untuk ‘menyarankan’ kepada sistem apa konten yang harus menggantikan bagian tersembunyi atau hilang dari representasi manusia (sehingga kegunaannya dalam kerangka try-on berbasis mode):

Sistem CompleteMe dapat menyesuaikan konten referensi dengan bagian terhalang atau tersembunyi dari gambar manusia.

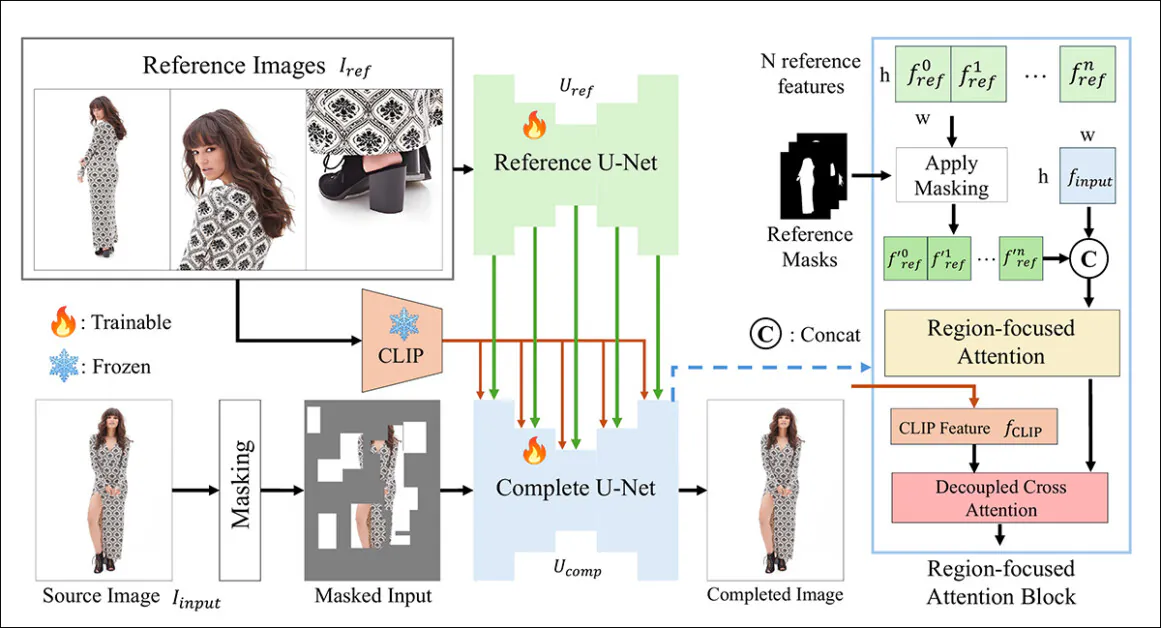

Sistem baru ini menggunakan arsitektur U-Net ganda dan blok Region-Focused Attention (RFA) yang mengarahkan sumber daya ke area yang relevan dari instance restorasi gambar.

Peneliti juga menawarkan sistem benchmark baru yang dirancang untuk mengevaluasi tugas-tugas completion berbasis referensi (karena CompleteMe adalah bagian dari strand penelitian yang ada dan berkelanjutan dalam computer vision, meskipun tidak memiliki skema benchmark sampai sekarang).

Dalam tes, dan dalam studi pengguna yang diukur dengan baik, metode baru ini unggul dalam sebagian besar metrik, dan unggul secara keseluruhan. Dalam beberapa kasus, metode rival terganggu oleh pendekatan berbasis referensi:

Dari materi suplemen: metode AnyDoor memiliki kesulitan khusus dalam menentukan bagaimana menafsirkan gambar referensi.

Makalah tersebut menyatakan:

‘Eksperimen yang luas pada benchmark kami menunjukkan bahwa CompleteMe mengungguli metode-metode state-of-the-art, baik berbasis referensi maupun tidak, dalam hal metrik kuantitatif, hasil kualitatif, dan studi pengguna.

‘Terutama dalam skenario yang menantang yang melibatkan pose yang kompleks, pola pakaian yang rumit, dan aksesori yang khas, model kami secara konsisten mencapai keaslian visual dan kohesi semantik yang lebih baik.’

Sayangnya, kehadiran proyek GitHub tidak berisi kode, dan inisiatif, yang juga memiliki halaman proyek yang sederhana proyek, tampaknya dirancang sebagai arsitektur proprietary.

Contoh lebih lanjut dari kinerja subjektif sistem baru dibandingkan dengan metode sebelumnya. Lebih banyak detail nanti dalam artikel.

Metode

Kerangka CompleteMe didukung oleh Reference U-Net, yang menangani integrasi materi tambahan ke dalam proses, dan U-Net kohesif, yang menampung berbagai proses untuk mendapatkan hasil akhir, seperti yang diilustrasikan dalam skema konseptual di bawah:

Skema konseptual untuk CompleteMe. Source: https://arxiv.org/pdf/2504.20042

Sistem pertama kali mengkodekan gambar input yang ditutupi menjadi representasi laten. Pada saat yang sama, Reference U-Net memproses beberapa gambar referensi – masing-masing menunjukkan wilayah tubuh yang berbeda – untuk mengekstrak fitur spasial yang terperinci.

Fitur-fitur ini melewati blok Region-Focused Attention yang tertanam dalam ‘complete’ U-Net, di mana mereka dipilih secara selektif menggunakan masker wilayah yang sesuai, memastikan model hanya memperhatikan area yang relevan dalam gambar referensi.

Fitur-fitur yang ditutupi kemudian diintegrasikan dengan fitur semantik global yang dihasilkan CLIP melalui perhatian silang yang terpisah, memungkinkan model untuk merekonstruksi konten yang hilang dengan detail halus dan kohesi semantik.

Untuk meningkatkan realisme dan kekuatan, proses penutupan input menggabungkan oklusi grid acak dengan masker bentuk tubuh manusia, masing-masing diterapkan dengan probabilitas yang sama, meningkatkan kompleksitas wilayah yang hilang yang harus dilengkapi model.

Untuk Referensi Saja

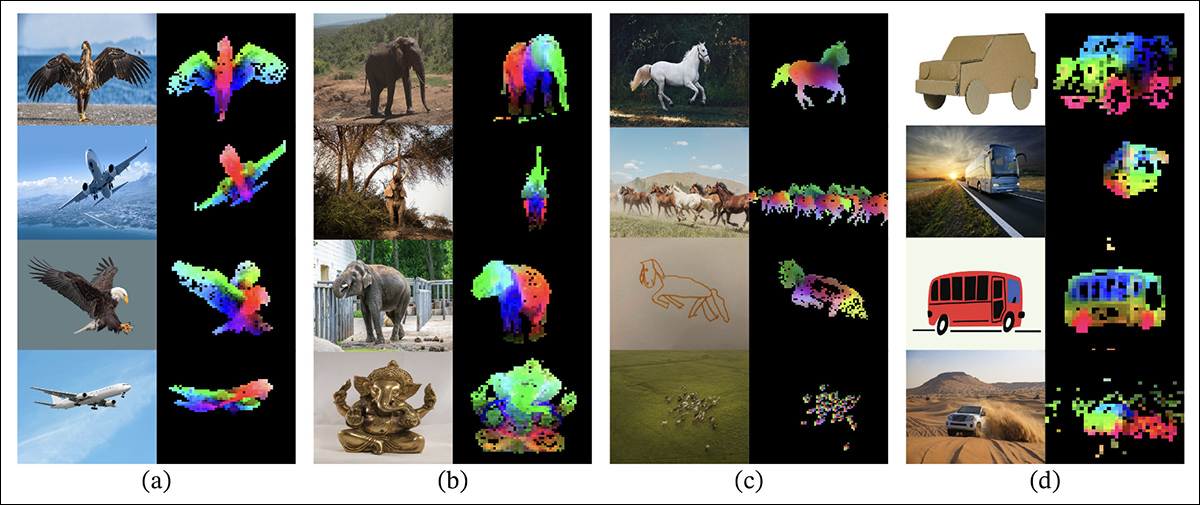

Metode sebelumnya untuk inpainting gambar berbasis referensi biasanya bergantung pada encoder level semantik. Proyek-proyek seperti ini termasuk CLIP itu sendiri, dan DINOv2, keduanya mengekstrak fitur global dari gambar referensi, tetapi sering kehilangan detail spasial halus yang diperlukan untuk pelestarian identitas yang akurat.

Dari makalah rilis untuk pendekatan DINOV2 yang lebih lama, yang termasuk dalam tes perbandingan dalam studi baru: Overlay berwarna menunjukkan tiga komponen utama dari Principal Component Analysis (PCA), diterapkan pada patch gambar dalam setiap kolom, menyoroti bagaimana DINOv2 mengelompokkan bagian objek yang serupa bersama-sama di seluruh gambar yang bervariasi. Meskipun perbedaan dalam pose, gaya, atau rendering, wilayah yang sesuai (seperti sayap, anggota tubuh, atau roda) secara konsisten dicocokkan, menggambarkan kemampuan model untuk mempelajari struktur berbasis bagian tanpa pengawasan. Source: https://arxiv.org/pdf/2304.07193

CompleteMe menangani aspek ini melalui Reference U-Net yang disesuaikan dari Stable Diffusion 1.5, tetapi beroperasi tanpa langkah noise difusi*.

Setiap gambar referensi, yang menutupi wilayah tubuh yang berbeda, dikodekan menjadi fitur laten yang terperinci melalui U-Net ini. Fitur semantik global juga diekstrak secara terpisah menggunakan CLIP, dan kedua set fitur ini disimpan untuk penggunaan yang efisien selama integrasi berbasis perhatian. Dengan demikian, sistem dapat menampung beberapa input referensi secara fleksibel, sambil melestarikan informasi penampilan yang halus.

Orkestrasi

U-Net kohesif mengelola tahap akhir proses completion. Disesuaikan dari varian inpainting dari Stable Diffusion 1.5, ia mengambil input gambar sumber yang ditutupi dalam bentuk laten, bersama dengan fitur spasial yang terperinci yang diambil dari gambar referensi dan fitur semantik global yang diekstrak oleh encoder CLIP.

Berbagai input ini digabungkan melalui blok RFA, yang memainkan peran kritis dalam mengarahkan fokus model ke area yang paling relevan dari materi referensi.

Sebelum memasuki mekanisme perhatian, fitur referensi secara eksplisit ditutupi untuk menghilangkan wilayah yang tidak terkait dan kemudian dihubungkan dengan representasi laten dari gambar sumber, memastikan bahwa perhatian diarahkan secara akurat.

Untuk meningkatkan integrasi ini, CompleteMe menggabungkan mekanisme perhatian silang yang terpisah yang disesuaikan dari kerangka IP-Adapter:

IP-Adapter, sebagian dari yang digabungkan ke dalam CompleteMe, adalah salah satu proyek paling sukses dan sering digunakan dari tiga tahun terakhir pengembangan arsitektur model difusi laten. Source: https://ip-adapter.github.io/

Ini memungkinkan model untuk memproses fitur visual yang terperinci secara spasial dan konteks semantik yang lebih luas melalui aliran perhatian yang terpisah, yang kemudian digabungkan, menghasilkan rekonstruksi yang kohesif yang, menurut penulis, melestarikan baik identitas dan detail yang halus.

Benchmarking

Dalam ketiadaan dataset yang sesuai untuk completion manusia berbasis referensi, peneliti telah mengusulkan yang baru. Benchmark (tanpa nama) dibangun dengan mengkurasi pasangan gambar pilihan dari dataset WPose yang dirancang untuk proyek UniHuman Adobe Research 2023.

Contoh pose dari proyek UniHuman Adobe Research 2023. Source: https://github.com/adobe-research/UniHuman?tab=readme-ov-file#data-prep

Peneliti secara manual menggambar masker sumber untuk menunjukkan area inpainting, akhirnya mendapatkan 417 kelompok gambar tripartit yang terdiri dari gambar sumber, masker, dan gambar referensi.

Dua contoh kelompok yang dihasilkan dari dataset WPose referensi, dan dikurasi secara ekstensif oleh peneliti makalah baru.

Penulis menggunakan LLaVA Large Language Model (LLM) untuk menghasilkan prompt teks yang menjelaskan gambar sumber.

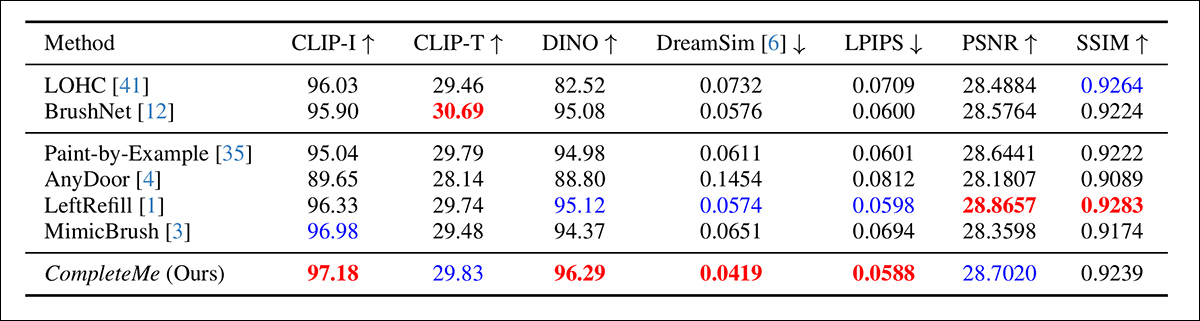

Metrik yang digunakan lebih luas dari biasanya; selain Peak Signal-to-Noise Ratio (PSNR), Structural Similarity Index (SSIM) dan Learned Perceptual Image Patch Similarity (LPIPS, dalam hal ini untuk mengevaluasi wilayah yang ditutupi), peneliti menggunakan DINO untuk skor kesamaan; DreamSim untuk evaluasi hasil generasi; dan CLIP.

Data dan Tes

Untuk menguji pekerjaan, penulis menggunakan model Stable Diffusion V1.5 default dan model inpainting 1.5. Pengkode gambar sistem menggunakan model Vision CLIP, bersama dengan lapisan proyeksi – jaringan neural yang sederhana yang mengubah atau menyelaraskan output CLIP untuk mencocokkan dimensi fitur internal yang digunakan oleh model.

Pelatihan berlangsung selama 30.000 iterasi lebih than delapan NVIDIA A100† GPU, diawasi oleh Mean Squared Error (MSE) loss, dengan ukuran batch 64 dan laju pembelajaran 2×10-5. Berbagai elemen secara acak dihilangkan selama pelatihan, untuk mencegah sistem overfitting pada data.

Dataset diubah dari Parts to Whole dataset, yang sendiri didasarkan pada DeepFashion-MultiModal dataset.

Contoh dari dataset Parts to Whole, digunakan dalam pengembangan data yang dikurasi untuk CompleteMe. Source: https://huanngzh.github.io/Parts2Whole/

Penulis menyatakan:

‘Untuk memenuhi kebutuhan kami, kami [membangun kembali] pasangan pelatihan dengan menggunakan gambar yang terhalang dengan beberapa gambar referensi yang menangkap berbagai aspek penampilan manusia bersama dengan label teks singkat mereka.

‘Setiap sampel dalam data pelatihan kami termasuk enam jenis penampilan: pakaian atas, pakaian bawah, pakaian seluruh tubuh, rambut atau pakaian kepala, wajah, dan sepatu. Untuk strategi penutupan, kami menerapkan 50% penutupan grid acak antara 1 hingga 30 kali, sementara untuk 50% lainnya, kami menggunakan masker bentuk tubuh manusia untuk meningkatkan kompleksitas wilayah yang ditutupi.

‘Setelah pipa konstruksi, kami mendapatkan 40.000 pasangan gambar untuk pelatihan.’

Metode sebelumnya yang tidak berbasis referensi yang diuji adalah Large occluded human image completion (LOHC) dan model inpainting plug-and-play BrushNet; metode berbasis referensi yang diuji adalah Paint-by-Example; AnyDoor; LeftRefill; dan MimicBrush.

Penulis memulai dengan perbandingan kuantitatif pada metrik yang disebutkan sebelumnya:

Hasil perbandingan kuantitatif awal.

Mengenai evaluasi kuantitatif, penulis mencatat bahwa CompleteMe mencapai skor tertinggi pada sebagian besar metrik perseptual, termasuk CLIP-I, DINO, DreamSim, dan LPIPS, yang dimaksudkan untuk menangkap keselarasan semantik dan kesamaan penampilan antara output dan gambar referensi.

Namun, model tidak mengungguli semua baseline dalam semua metrik. Secara khusus, BrushNet mencetak skor tertinggi pada CLIP-T, LeftRefill memimpin dalam SSIM dan PSNR, dan MimicBrush sedikit mengungguli pada CLIP-I.

Sementara CompleteMe menunjukkan hasil yang kuat secara konsisten, perbedaan kinerja modest dalam beberapa kasus, dan beberapa metrik masih dipimpin oleh metode sebelumnya yang kompetitif. Mungkin tidak secara tidak adil, penulis membingkai hasil ini sebagai bukti kekuatan CompleteMe yang seimbang di kedua dimensi struktural dan perseptual.

Ilustrasi untuk tes kualitatif yang dilakukan untuk studi ini terlalu banyak untuk direproduksi di sini, dan kami merujuk pembaca tidak hanya ke makalah sumber, tetapi juga ke suplemen PDF yang luas, yang berisi banyak contoh kualitatif tambahan.

Kami menyoroti contoh kualitatif utama yang disajikan dalam makalah utama, bersama dengan beberapa contoh tambahan yang diambil dari kumpulan gambar suplemen yang diperkenalkan sebelumnya dalam artikel ini:

Hasil kualitatif awal yang disajikan dalam makalah utama. Silakan merujuk ke makalah sumber untuk resolusi yang lebih baik.

Dari hasil kualitatif yang ditampilkan di atas, penulis mengomentari:

‘Dengan input yang ditutupi, metode non-referensi ini menghasilkan konten yang masuk akal untuk wilayah yang ditutupi menggunakan prioritas gambar atau prompt teks.

‘Namun, seperti yang ditunjukkan dalam Kotak Merah, mereka tidak dapat mereproduksi detail spesifik seperti tato atau pola pakaian unik, karena mereka tidak memiliki gambar referensi untuk memandu rekonstruksi informasi yang identik.’

Perbandingan kedua, sebagian dari yang ditampilkan di bawah, fokus pada empat metode berbasis referensi Paint-by-Example, AnyDoor, LeftRefill, dan MimicBrush. Di sini hanya satu gambar referensi dan prompt teks yang disediakan.

Perbandingan kualitatif dengan metode berbasis referensi. CompleteMe menghasilkan komplet yang lebih realistis dan lebih baik melestarikan detail spesifik dari gambar referensi. Kotak merah menyoroti area yang sangat menarik.

Penulis menyatakan:

‘Dengan gambar manusia yang ditutupi dan gambar referensi, metode lain dapat menghasilkan konten yang masuk akal tetapi sering gagal melestarikan informasi kontekstual dari referensi dengan akurat.

‘Dalam beberapa kasus, mereka menghasilkan konten yang tidak relevan atau memetakan bagian yang sesuai dari gambar referensi secara tidak benar. Sebaliknya, CompleteMe secara efektif melengkapi wilayah yang ditutupi dengan melestarikan informasi yang identik dan memetakan bagian tubuh yang sesuai dari gambar referensi secara akurat.’

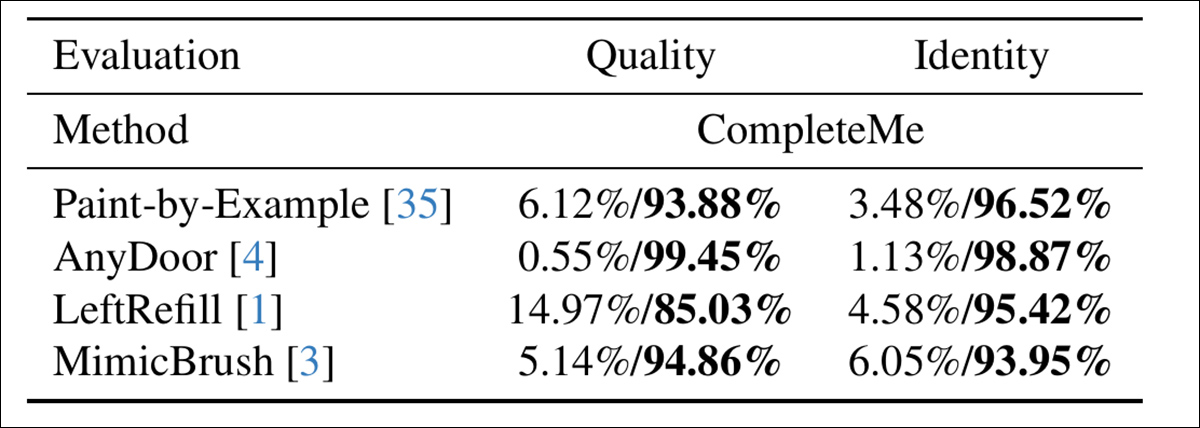

Untuk menilai seberapa baik model sesuai dengan persepsi manusia, penulis melakukan studi pengguna yang melibatkan 15 pengannotator dan 2.895 pasangan sampel. Setiap pasangan membandingkan output CompleteMe dengan salah satu dari empat baseline berbasis referensi: Paint-by-Example, AnyDoor, LeftRefill, atau MimicBrush.

Pengannotator mengevaluasi setiap hasil berdasarkan kualitas visual dari wilayah yang dilengkapi dan seberapa baik itu melestarikan fitur identitas dari referensi – dan di sini, mengevaluasi kualitas dan identitas secara keseluruhan, CompleteMe mendapatkan hasil yang lebih definitif:

Hasil studi pengguna.

Kesimpulan

Jika ada, hasil kualitatif dalam studi ini diperlemah oleh volume yang besar, karena pemeriksaan yang lebih dekat menunjukkan bahwa sistem baru ini merupakan entri yang paling efektif dalam area neural image editing yang relatif niche tetapi sangat dikejar.

Namun, diperlukan sedikit perawatan tambahan dan memperbesar untuk mengapresiasi seberapa baik sistem menyesuaikan materi referensi dengan area yang terhalang dalam perbandingan (dalam hampir semua kasus) dengan metode sebelumnya.

Kami sangat menyarankan pembaca untuk memeriksa dengan hati-hati hasil yang awalnya membingungkan, jika tidak mengalahkan, badai hasil yang disajikan dalam materi suplemen.

* Menarik untuk dicatat bagaimana rilis V1.5 yang sekarang sudah ketinggalan zaman tetap menjadi favorit peneliti – sebagian karena pengujian seperti-ke-seperti yang dilakukan sebelumnya, tetapi juga karena ini adalah iterasi Stable Diffusion yang paling tidak disensor dan mungkin paling mudah dilatih, dan tidak memiliki pembatasan sensor dari rilis FOSS Flux.

† Spesifikasi VRAM tidak diberikan – itu bisa 40GB atau 80GB per kartu.

Dipublikasikan pertama kali pada hari Selasa, 29 April 2025