Kecerdasan buatan

DeepSeek-V3 Diperkenalkan: Bagaimana Desain AI yang Sadar Perangkat Keras Mengurangi Biaya dan Meningkatkan Kinerja

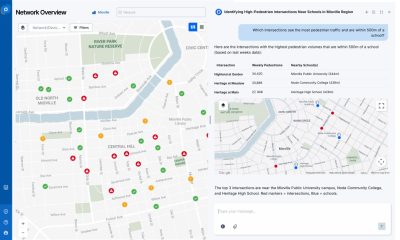

DeepSeek-V3 mewakili terobosan dalam pengembangan AI yang hemat biaya. Ini menunjukkan bagaimana desain perangkat lunak-perangkat keras yang cerdas dapat menghasilkan kinerja kelas dunia tanpa biaya yang berlebihan. Dengan dilatih pada hanya 2.048 NVIDIA H800 GPU, model ini mencapai hasil yang luar biasa melalui pendekatan inovatif seperti Perhatian Laten Multi-Kepala untuk efisiensi memori, Arsitektur Mixture of Experts untuk komputasi yang dioptimalkan, dan pelatihan presisi campuran FP8 yang membuka potensi perangkat keras. Model ini menunjukkan bahwa tim yang lebih kecil dapat bersaing dengan perusahaan teknologi besar melalui pilihan desain yang cerdas daripada penskalaan kekuatan.

Tantangan Penskalaan AI

Industri AI menghadapi masalah mendasar. Model bahasa besar menjadi lebih besar dan lebih kuat, tetapi mereka juga memerlukan sumber daya komputasi yang besar yang sebagian besar organisasi tidak mampu. Perusahaan teknologi besar seperti Google, Meta, dan OpenAI menggelar klaster pelatihan dengan puluhan atau ratusan ribu GPU, membuatnya sulit bagi tim penelitian yang lebih kecil dan startup untuk bersaing.

Kesenjangan sumber daya ini mengancam untuk mengkonsentrasikan pengembangan AI di tangan beberapa perusahaan teknologi besar. Hukum penskalaan yang menggerakkan kemajuan AI menunjukkan bahwa model yang lebih besar dengan lebih banyak data pelatihan dan kekuatan komputasi menghasilkan kinerja yang lebih baik. Namun, pertumbuhan eksponensial dalam kebutuhan perangkat keras membuatnya semakin sulit bagi pemain yang lebih kecil untuk bersaing dalam lomba AI.

Persyaratan memori telah muncul sebagai tantangan lain yang signifikan. Model bahasa besar memerlukan sumber daya memori yang signifikan, dengan permintaan yang meningkat lebih dari 1000% per tahun. Sementara itu, kapasitas memori kecepatan tinggi tumbuh dengan kecepatan yang jauh lebih lambat, biasanya kurang dari 50% per tahun. Ketidakcocokan ini menciptakan apa yang disebut para peneliti sebagai “dinding memori AI,” di mana memori menjadi faktor pembatas daripada kekuatan komputasi.

Situasi menjadi lebih kompleks selama inferensi, ketika model melayani pengguna nyata. Aplikasi AI modern sering melibatkan percakapan multi-giliran dan konteks panjang, yang memerlukan mekanisme caching yang kuat yang mengonsumsi memori yang substantial. Pendekatan tradisional dapat dengan cepat membanjiri sumber daya yang tersedia dan membuat inferensi yang efisien menjadi tantangan teknis dan ekonomi yang signifikan.

Pendekatan DeepSeek-V3 yang Sadar Perangkat Keras

DeepSeek-V3 dirancang dengan optimasi perangkat keras dalam pikiran. Alih-alih menggunakan lebih banyak perangkat keras untuk menskala model besar, DeepSeek fokus pada menciptakan desain model yang sadar perangkat keras yang mengoptimalkan efisiensi dalam batasan yang ada. Pendekatan ini memungkinkan DeepSeek untuk mencapai kinerja kelas dunia menggunakan hanya 2.048 NVIDIA H800 GPU, sebagian kecil dari apa yang dibutuhkan oleh pesaing.

Intuisi inti di balik DeepSeek-V3 adalah bahwa model AI harus mempertimbangkan kemampuan perangkat keras sebagai parameter kunci dalam proses optimasi. Alih-alih merancang model dalam isolasi dan kemudian mencari tahu bagaimana menjalankannya dengan efisien, DeepSeek fokus pada membangun model AI yang mengintegrasikan pemahaman yang mendalam tentang perangkat keras yang dioperasikan. Strategi co-desain ini berarti model dan perangkat keras bekerja sama dengan efisien, bukan memperlakukan perangkat keras sebagai konstrain yang tetap.

Proyek ini membangun atas wawasan kunci dari model DeepSeek sebelumnya, terutama DeepSeek-V2, yang memperkenalkan inovasi sukses seperti DeepSeek-MoE dan Perhatian Laten Multi-Kepala. Namun, DeepSeek-V3 memperluas wawasan ini dengan mengintegrasikan pelatihan presisi campuran FP8 dan mengembangkan topologi jaringan baru yang mengurangi biaya infrastruktur tanpa mengorbankan kinerja.

Pendekatan yang sadar perangkat keras ini diterapkan tidak hanya pada model tetapi juga pada seluruh infrastruktur pelatihan. Tim mengembangkan Jaringan Fat-Tree dua-lapis Multi-Plane untuk menggantikan topologi tiga-lapis tradisional, secara signifikan mengurangi biaya jaringan klaster. Inovasi infrastruktur ini menunjukkan bagaimana desain yang cerdas dapat mencapai penghematan biaya yang signifikan di seluruh pipa pengembangan AI.

Inovasi Kunci yang Menggerakkan Efisiensi

DeepSeek-V3 membawa beberapa perbaikan yang sangat meningkatkan efisiensi. Salah satu inovasi kunci adalah mekanisme Perhatian Laten Multi-Kepala (MLA), yang menangani penggunaan memori yang tinggi selama inferensi. Mekanisme perhatian tradisional memerlukan caching vektor Kunci dan Nilai untuk semua kepala perhatian. Ini mengonsumsi jumlah memori yang sangat besar ketika percakapan menjadi lebih panjang.

MLA memecahkan masalah ini dengan mengompresi representasi Kunci-Nilai dari semua kepala perhatian menjadi vektor laten yang lebih kecil menggunakan matriks proyeksi yang dilatih dengan model. Selama inferensi, hanya vektor laten yang dikompresi ini perlu di-cache, secara signifikan mengurangi persyaratan memori. DeepSeek-V3 hanya memerlukan 70 KB per token dibandingkan dengan 516 KB untuk LLaMA-3.1 405B dan 327 KB untuk Qwen-2.5 72B1.

Arsitektur Mixture of Experts menyediakan keuntungan efisiensi lainnya. Alih-alih mengaktifkan seluruh model untuk setiap komputasi, MoE secara selektif mengaktifkan hanya jaringan ahli yang paling relevan untuk setiap input. Pendekatan ini mempertahankan kapasitas model sambil secara signifikan mengurangi komputasi yang sebenarnya diperlukan untuk setiap pass maju.

Pelatihan presisi campuran FP8 lebih lanjut meningkatkan efisiensi dengan beralih dari presisi floating-point 16-bit ke 8-bit. Ini mengurangi konsumsi memori setengahnya sambil mempertahankan kualitas pelatihan. Inovasi ini secara langsung menangani dinding memori AI dengan membuat penggunaan yang lebih efisien dari sumber daya perangkat keras yang tersedia.

Modul Prediksi Token Multi menambahkan lapisan efisiensi lainnya selama inferensi. Alih-alih menghasilkan satu token pada satu waktu, sistem ini dapat memprediksi beberapa token masa depan secara bersamaan, secara signifikan meningkatkan kecepatan generasi melalui decoding spekulatif. Pendekatan ini mengurangi waktu yang diperlukan untuk menghasilkan respons, meningkatkan pengalaman pengguna sambil mengurangi biaya komputasi.

Pelajaran Kunci untuk Industri

Keberhasilan DeepSeek-V3 menyediakan beberapa pelajaran kunci untuk industri AI yang lebih luas. Ini menunjukkan bahwa inovasi dalam efisiensi sama pentingnya dengan penskalaan ukuran model. Proyek ini juga menyoroti bagaimana desain perangkat lunak-perangkat keras yang cerdas dapat mengatasi keterbatasan sumber daya yang mungkin membatasi pengembangan AI.

Pendekatan desain yang sadar perangkat keras ini bisa mengubah cara AI dikembangkan. Alih-alih melihat perangkat keras sebagai keterbatasan untuk diatasi, organisasi mungkin memperlakukannya sebagai faktor desain inti yang membentuk arsitektur model dari awal. Perubahan pemikiran ini dapat mengarah pada sistem AI yang lebih efisien dan hemat biaya di seluruh industri.

Efektivitas teknik seperti MLA dan pelatihan presisi campuran FP8 menunjukkan bahwa masih ada ruang yang signifikan untuk meningkatkan efisiensi. Ketika perangkat keras terus berkembang, peluang baru untuk optimasi akan muncul. Organisasi yang memanfaatkan inovasi ini akan lebih siap untuk bersaing dalam dunia dengan keterbatasan sumber daya yang meningkat.

Inovasi jaringan dalam DeepSeek-V3 juga menekankan pentingnya desain infrastruktur. Sementara banyak fokus pada arsitektur model dan metode pelatihan, infrastruktur memainkan peran kritis dalam efisiensi dan biaya secara keseluruhan. Organisasi yang membangun sistem AI harus memprioritaskan optimasi infrastruktur bersama dengan perbaikan model.

Proyek ini juga menunjukkan nilai penelitian terbuka dan kolaborasi. Dengan membagikan wawasan dan teknik mereka, tim DeepSeek menyumbang pada kemajuan AI yang lebih luas sambil juga membangun posisi mereka sebagai pemimpin dalam pengembangan AI yang efisien. Pendekatan ini menguntungkan seluruh industri dengan mempercepat kemajuan dan mengurangi duplikasi upaya.

Intinya

DeepSeek-V3 adalah langkah penting ke depan dalam kecerdasan buatan. Ini menunjukkan bahwa desain yang cerdas dapat menghasilkan kinerja yang setara dengan, atau lebih baik dari, sekadar menskala model. Dengan menggunakan ide seperti Perhatian Laten Multi-Kepala, Lapisan Mixture of Experts, dan pelatihan presisi campuran FP8, model ini mencapai hasil kelas atas sambil secara signifikan mengurangi kebutuhan perangkat keras. Fokus ini pada efisiensi perangkat keras memberi tim yang lebih kecil kesempatan untuk membangun sistem canggih tanpa anggaran yang besar. Ketika AI terus berkembang, pendekatan seperti yang ada di DeepSeek-V3 akan menjadi semakin penting untuk memastikan kemajuan yang berkelanjutan dan dapat diakses. DeepSeek-3 juga mengajarkan pelajaran yang lebih luas. Dengan pilihan arsitektur yang cerdas dan optimasi yang ketat, kita dapat membangun AI yang kuat tanpa kebutuhan akan sumber daya yang luas dan biaya. Dengan cara ini, DeepSeek-V3 menawarkan seluruh industri jalur praktis menuju AI yang hemat biaya dan lebih dapat diakses, yang membantu banyak organisasi dan pengguna di seluruh dunia.