Sudut Anderson

Chain-Of-Thought Reasoning Terbukti ‘Dekoratif’ pada Model Bahasa Utama

Penelitian baru menawarkan cara mudah untuk menentukan bahwa penjelasan langkah-demi-langkah yang dipoles dari semua model bahasa AI terkemuka saat ini – termasuk ChatGPT dan Claude – hanyalah ‘dekoratif’, dan biasanya dikarang setelah AI memutuskan apa jawabannya.

Tahun lalu, serangkaian studi profil tinggi dari perusahaan-perusahaan yang bergerak di bidang AI, termasuk Anthropic dan Apple, menunjukkan bahwa yang disebut ‘AI penalaran’ sering kali menghasilkan penjelasan langkah-demi-langkah yang tidak mencerminkan apa yang sebenarnya menginformasikan jawaban mereka.

Untuk berbagai alasan, perdebatan segera merosot menjadi bantahan yang berantakan dan interpretasi yang beragam (termasuk di situs ini), meninggalkan pertanyaan yang belum terselesaikan mengenai apakah penalaran chain-of-thought (CoT) hanyalah hiasan kosmetik yang dirancang untuk meyakinkan pengguna akhir, atau bukti dari proses penalaran yang sebenarnya.

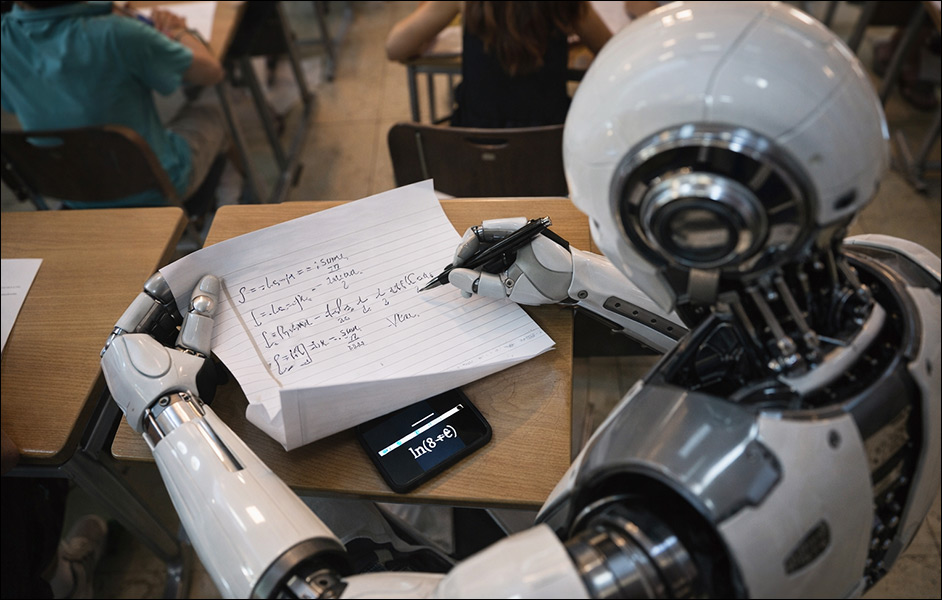

ChatGPT ‘menunjukkan pekerjaannya’ – tetapi apakah ia sudah memutuskan apa yang akan dijawab?

Tunjukkan dan Ceritakan

Sekarang, sebuah makalah baru yang menarik dari India menawarkan metode yang murah dan mudah direplikasi untuk mengukur apakah ‘animasi deduksi’ yang mengesankan di antarmuka ChatGPT dan model bahasa besar (LLM) utama lainnya benar-benar menunjukkan AI yang bekerja melalui langkah-langkah menuju kesimpulan.

Penelitian baru ini berasal dari dua peneliti di Indian Institute of Information Technology Allahabad (IIITA) di Allahabad, dan National Institute of Electronics and Information Technology (NIELIT) di Delhi.

Para penulis menemukan bahwa di hampir semua kasus, di sepanjang sebagian besar LLM berpemilik dan sumber terbuka, penalaran chain-of-thought yang disajikan kepada pengguna adalah ‘dekoratif’, diciptakan setelah AI menyimpulkan jawaban yang akan disajikannya.

Menguji model seperti ChatGPT5.4, Claude Opus 4.6-R, dan DeepSeek-V3.2, para penulis menemukan bahwa menghapus satu langkah pun dari 10-15 indikasi CoT yang disajikan sebenarnya mengubah jawaban kurang dari 17% dari waktu, dan bahwa satu langkah pun, sendiri, sudah cukup untuk memulihkan jawaban yang benar.

Para penulis menyatakan*:

‘Kerangka kerja regulasi untuk AI dalam perawatan kesehatan, keuangan, dan hukum semakin membutuhkan sistem yang “dapat dijelaskan”. Hasil kami menunjukkan bahwa pendekatan standar – meminta model untuk menunjukkan pekerjaannya – memberikan ilusi transparansi.

‘Penjelasannya lancar, sesuai domain, dan salah secara halus: mereka menggambarkan penalaran yang tidak dilakukan oleh model.

‘Sebuah AI medis yang menulis “eosinofilia menunjukkan proses emboli” belum tentu mempertimbangkan eosinofilia sama sekali. Ia mungkin telah mencocokkan pola dari pertanyaan ke jawaban dan mengarang penalarannya setelahnya.

‘Di bawah EU AI Act (Pasal 13), sistem AI berisiko tinggi harus memberikan “informasi yang bermakna tentang logika yang terlibat.” Temuan kami menunjukkan bahwa penjelasan chain-of-thought dari mayoritas model frontier tidak memenuhi standar ini – “logika yang terlibat” dalam mencapai jawaban bukanlah logika yang dijelaskan dalam penjelasan.’

Para penulis mengamati bahwa dua dari model yang lebih kecil yang diuji memang memecahkan pola umum dari duplikasi, tetapi hanya dalam keadaan yang sangat khusus: MiniMax-M25 menunjukkan ketergantungan langkah yang sejati ketika berurusan dengan analisis sentimen, sementara Kimi-K25 menunjukkan kebutuhan sejati 39% untuk pemrosesan CoT – tetapi hanya ketika berurusan dengan klasifikasi topik.

Dalam semua kasus lain, seperti halnya model yang lebih besar dan lebih terkenal, langkah-langkah penalaran yang ditunjukkan tampaknya seluruhnya performatif, dengan model-model tersebut malah menggunakan jalan pintas.

Model Kecil Berusaha Lebih Keras

Selain sepuluh model API yang diuji, para penulis juga mencoba sejumlah model open-weight yang lebih kecil†, berkisar antara 0,8 hingga 8 miliar parameter (yang cukup sederhana saat ini), dan menemukan bahwa AI yang lebih kecil ini benar-benar bernalar, dan bahwa CoT yang mereka tunjukkan biasanya – meskipun tidak selalu – diperlukan untuk mencapai kesimpulan yang berguna dan akurat.

Model yang lebih kecil menunjukkan kebutuhan 55% untuk penalaran langkah, berbeda dengan kebutuhan rata-rata 11% di seluruh model yang lebih besar, yang, menurut para penulis, ‘telah belajar untuk melewati penalaran multi-langkah sepenuhnya, sampai pada jawaban yang benar melalui jalan pintas internal yang tidak direfleksikan oleh penalaran tertulis mereka’.

Para penulis berpendapat bahwa semakin baik sebuah model dalam suatu tugas, semakin sedikit ia memerlukan langkah-langkah penalaran (meskipun ini adalah pandangan yang lebih diplomatis tentang konsep menghindari analisis rasional demi jawaban mana pun yang paling kuat dalam distribusi data pelatihan)††:

‘Model kecil bernalar dengan setia pada matematika karena mereka harus—mereka tidak memiliki pengetahuan parametrik untuk mengambil jalan pintas.

‘Model frontier telah menginternalisasi cukup banyak pola matematika sehingga penalaran rantai eksplisit menjadi berlebihan. CoT masih meningkatkan akurasi (dengan menyusun generasi), tetapi langkah-langkah individual tidak lagi membawa informasi unik.’