Kecerdasan Buatan

Cerebras Memperkenalkan Solusi Inferensi AI Tercepat di Dunia: Kecepatan 20x dengan Biaya yang Lebih Murah

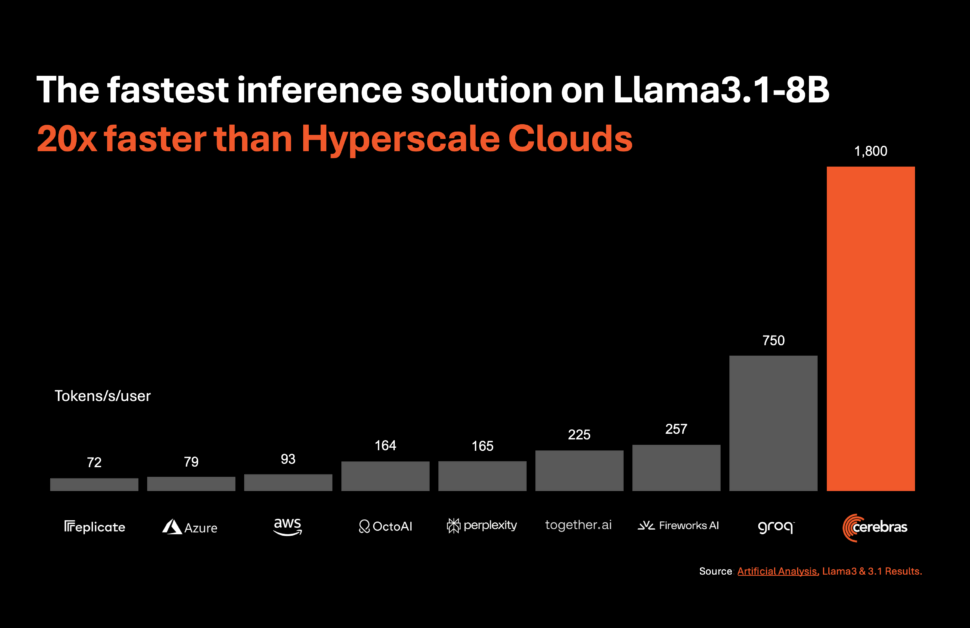

Sistem Cerebras, pionir dalam komputasi AI berkinerja tinggi, telah memperkenalkan solusi inovatif yang dirancang untuk merevolusi inferensi AI. Pada tanggal 27 Agustus 2024, perusahaan mengumumkan peluncuran Cerebras Inference, layanan inferensi AI tercepat di dunia. Dengan metrik kinerja yang jauh lebih kecil daripada sistem berbasis GPU tradisional, Cerebras Inference memberikan kecepatan 20 kali lipat dengan biaya yang lebih murah, sehingga menetapkan tolok ukur baru dalam komputasi AI.

Kecepatan dan Efisiensi Biaya yang Belum Pernah Ada Sebelumnya

Cerebras Inference dirancang untuk memberikan kinerja luar biasa di berbagai model AI, khususnya di segmen AI yang berkembang pesat model bahasa besar (LLM). Misalnya, ia memproses 1,800 token per detik untuk model Llama 3.1 8B dan 450 token per detik untuk model Llama 3.1 70B. Performa ini tidak hanya 20 kali lebih cepat dibandingkan solusi berbasis GPU NVIDIA, namun juga memiliki biaya yang jauh lebih rendah. Cerebras menawarkan layanan ini mulai dari 10 sen per juta token untuk model Llama 3.1 8B dan 60 sen per juta token untuk model Llama 3.1 70B, yang menunjukkan peningkatan 100x dalam harga-kinerja dibandingkan dengan penawaran berbasis GPU yang ada.

Menjaga Akurasi Sambil Mendorong Batasan Kecepatan

Salah satu aspek yang paling mengesankan dari Cerebras Inference adalah kemampuannya untuk mempertahankan akurasi mutakhir sekaligus memberikan kecepatan yang tak tertandingi. Tidak seperti pendekatan lain yang mengorbankan presisi demi kecepatan, solusi Cerebras tetap berada dalam domain 16-bit untuk keseluruhan proses inferensi. Hal ini memastikan bahwa peningkatan kinerja tidak mengorbankan kualitas keluaran model AI, yang merupakan faktor penting bagi pengembang yang berfokus pada presisi.

Micah Hill-Smith, Co-Founder dan CEO Artificial Analysis, menyoroti pentingnya pencapaian ini: “Cerebras memberikan kecepatan yang jauh lebih cepat daripada solusi berbasis GPU untuk model AI Llama 3.1 8B dan 70B Meta. Kami mengukur kecepatan di atas 1,800 token keluaran per detik pada Llama 3.1 8B, dan di atas 446 token keluaran per detik pada Llama 3.1 70B – sebuah rekor baru dalam tolok ukur ini.”

Semakin Pentingnya Inferensi AI

Inferensi AI adalah segmen komputasi AI dengan pertumbuhan tercepat, mencakup sekitar 40% dari total pasar perangkat keras AI. Munculnya inferensi AI berkecepatan tinggi, seperti yang ditawarkan oleh Cerebras, serupa dengan diperkenalkannya internet broadband—yang membuka peluang baru dan menandai era baru penerapan AI. Dengan Cerebras Inference, pengembang kini dapat membangun aplikasi AI generasi berikutnya yang memerlukan kinerja real-time yang kompleks, seperti agen AI dan sistem cerdas.

Andrew Ng, Pendiri DeepLearning.AI, menggarisbawahi pentingnya kecepatan dalam pengembangan AI: “DeepLearning.AI memiliki beberapa alur kerja agen yang memerlukan LLM berulang kali untuk mendapatkan hasil. Cerebras telah membangun kemampuan inferensi yang sangat cepat yang akan sangat membantu beban kerja tersebut."

Dukungan Industri yang Luas dan Kemitraan Strategis

Cerebras telah mendapatkan dukungan kuat dari para pemimpin industri dan telah membentuk kemitraan strategis untuk mempercepat pengembangan aplikasi AI. Kim Branson, SVP AI/ML di GlaxoSmithKline, pelanggan awal Cerebras, menekankan potensi transformatif dari teknologi ini: “Kecepatan dan skala mengubah segalanya.”

Perusahaan lain, seperti LiveKit, Kebingungan, dan Meter, juga menyatakan antusiasmenya atas dampak Cerebras Inference terhadap operasi mereka. Perusahaan-perusahaan ini memanfaatkan kekuatan kemampuan komputasi Cerebras untuk menciptakan pengalaman AI yang lebih responsif dan mirip manusia, meningkatkan interaksi pengguna di mesin pencari, dan meningkatkan sistem manajemen jaringan.

Inferensi Cerebras: Tingkatan dan Aksesibilitas

Cerebras Inference tersedia dalam tiga tingkatan dengan harga bersaing: Gratis, Pengembang, dan Perusahaan. Tingkat Gratis menyediakan akses API gratis dengan batas penggunaan yang besar, sehingga dapat diakses oleh banyak pengguna. Tingkat Pengembang menawarkan opsi penerapan yang fleksibel dan tanpa server, dengan model Llama 3.1 dihargai 10 sen dan 60 sen per juta token. Tingkat Perusahaan melayani organisasi dengan beban kerja berkelanjutan, menawarkan model yang disesuaikan, perjanjian tingkat layanan khusus, dan dukungan khusus, dengan harga tersedia berdasarkan permintaan.

Inferensi yang Menggerakan Otak: Mesin Skala Wafer 3 (WSE-3)

Inti dari Cerebras Inference adalah sistem Cerebras CS-3, yang didukung oleh Wafer Scale Engine 3 (WSE-3) yang terdepan di industri. Prosesor AI ini tak tertandingi dalam ukuran dan kecepatannya, menawarkan bandwidth memori 7,000 kali lebih banyak dibandingkan NVIDIA H100. Skala besar WSE-3 memungkinkannya menangani banyak pengguna secara bersamaan, memastikan kecepatan tinggi tanpa mengurangi kinerja. Arsitektur ini memungkinkan Cerebras menghindari trade-off yang biasanya mengganggu sistem berbasis GPU, sehingga memberikan kinerja terbaik di kelasnya untuk beban kerja AI.

Integrasi yang Mulus dan API yang Ramah Pengembang

Cerebras Inference dirancang dengan mempertimbangkan pengembang. Ini menampilkan API yang sepenuhnya kompatibel dengan OpenAI Chat Completions API, memungkinkan migrasi mudah dengan perubahan kode minimal. Pendekatan ramah pengembang ini memastikan bahwa pengintegrasian Cerebras Inference ke dalam alur kerja yang ada berjalan semulus mungkin, memungkinkan penerapan aplikasi AI berkinerja tinggi dengan cepat.

Sistem Cerebras: Mendorong Inovasi di Seluruh Industri

Cerebras Systems tidak hanya pemimpin dalam komputasi AI tetapi juga pemain kunci di berbagai industri, termasuk layanan kesehatan, energi, pemerintahan, komputasi ilmiah, dan jasa keuangan. Solusi perusahaan telah berperan penting dalam mendorong terobosan di institusi seperti National Laboratories, Aleph Alpha, The Mayo Clinic, dan GlaxoSmithKline.

Dengan memberikan kecepatan, skalabilitas, dan akurasi yang tak tertandingi, Cerebras memungkinkan organisasi di seluruh sektor ini mengatasi beberapa masalah paling menantang dalam AI dan lainnya. Baik untuk mempercepat penemuan obat dalam layanan kesehatan atau meningkatkan kemampuan komputasi dalam penelitian ilmiah, Cerebras berada di garis depan dalam mendorong inovasi.

Kesimpulan: Era Baru Inferensi AI

Cerebras Systems menetapkan standar baru untuk inferensi AI dengan peluncuran Cerebras Inference. Dengan menawarkan kecepatan 20 kali lipat dari sistem berbasis GPU tradisional dengan biaya yang lebih murah, Cerebras tidak hanya membuat AI lebih mudah diakses tetapi juga membuka jalan bagi aplikasi AI generasi berikutnya. Dengan teknologi mutakhir, kemitraan strategis, dan komitmen terhadap inovasi, Cerebras siap memimpin industri AI menuju era baru dengan kinerja dan skalabilitas yang belum pernah terjadi sebelumnya.

Untuk informasi lebih lanjut tentang Sistem Cerebras dan untuk mencoba Inferensi Cerebras, kunjungi www.cerebras.ai.