Sudut Pandang Anderson

Filter Kecantikan Merupakan Alat Serangan Deepfake yang Potensial

Filter kecantikan kini lebih dari sekadar menyembunyikan noda: filter ini dapat membantu deepfake dan transformasi wajah lolos dari deteksi sistem. Sebuah studi baru menunjukkan bahwa efek penghalusan yang halus sekalipun dapat membingungkan detektor AI, membuat gambar palsu tampak asli dan gambar asli tampak palsu. Jika tren ini berlanjut, filter kecantikan dapat menghadapi pembatasan dalam konteks berisiko tinggi, mulai dari pemeriksaan perbatasan hingga panggilan Zoom perusahaan.

Pada tahun akademik 2024 kolaborasi Di antara Spanyol dan Italia, para peneliti melaporkan bahwa 90% perempuan berusia 18-30 tahun menggunakan filter kecantikan sebelum mengunggah foto di media sosial. Dalam hal ini, filter kecantikan adalah metode algoritmik atau berbantuan AI untuk mengubah penampilan wajah agar tampak lebih baik dari sumber aslinya:

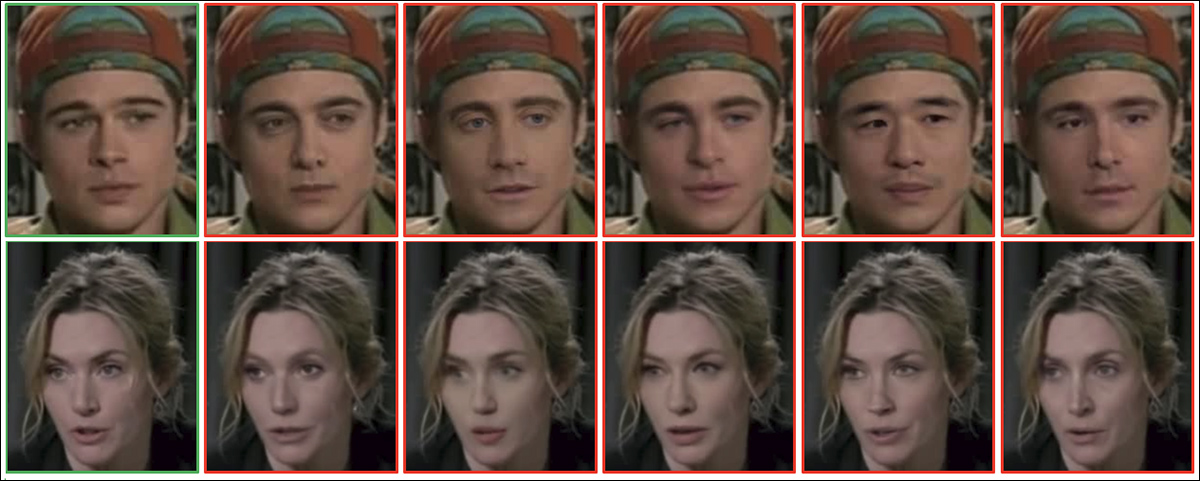

Dari studi tahun 2024: contoh wajah perempuan (kiri) dan laki-laki (kanan) sebelum dan sesudah filter kecantikan. Filter ini mengubah fitur-fitur seperti warna kulit, mata, hidung, bibir, dagu, dan tulang pipi untuk meningkatkan daya tarik yang dirasakan. Sumber: https://arxiv.org/pdf/2407.11981

Filter semacam itu juga tersedia secara luas sebagai fungsi bawaan atau tambahan dalam sistem berbasis video populer termasuk Snapchat dan Zoom, yang menawarkan kemampuan menghaluskan kulit yang 'tidak sempurna' dan bahkan mengubah usia subjek, hingga ke titik di mana identitas dapat dikatakan berubah secara substansial:

Klik untuk memutar: tiga wanita menonaktifkan filter 'percantik' video mereka, mengungkap sejauh mana fisiognomi mereka diubah oleh algoritma atau AI. Sumber: https://www.youtube.com/watch?v=gtCpea_5qxw

Fenomena ini tampaknya mencapai titik jenuh segera setelah teknologinya relatif matang; sebuah studi tahun 2020 belajar dari City University of London mengungkapkan bahwa 90% pengguna Snapchat muda di Amerika Serikat, Prancis, dan Inggris menggunakan filter di aplikasi mereka, sementara Meta melaporkan bahwa lebih dari 600 juta anak muda pada saat itu telah menggunakan filter di Facebook atau Instagram.

Menjelajahi dampak buruk filter semacam itu terhadap kesehatan mental, sebuah studi Psychology Today melaporkan Dilaporkan bahwa dari mereka yang diteliti, 90% perempuan muda, dengan usia rata-rata 20 tahun, menggunakan filter atau mengedit foto mereka. Filter yang paling populer adalah yang digunakan untuk meratakan warna kulit; memberikan tampilan kecokelatan; memutihkan gigi; dan bahkan mengurangi ukuran tubuh.

Menghadapi

Karena filter wajah akan mendapatkan manfaat dari tahun 2025 revolusi dalam sintesis video, dan secara umum dari minat yang terus berlanjut di sektor penelitian ini, sejauh mana kita dapat 'menciptakan ulang' atau membayangkan kembali diri kita sendiri dalam obrolan video langsung semakin mengikis kekhawatiran komunitas keamanan tentang penipuan atau teknik video deepfake kriminal.

Salah satu permasalahannya adalah bahwa rentang tes 'mudah' dikembangkan dalam beberapa tahun terakhir untuk mengungkap video deepfaker, yang mungkin berusaha untuk menipu sejumlah besar uang dalam konteks korporat, mau tidak mau akan menjadi kurang efektif karena kelemahan ini diperhitungkan dalam data pelatihan dan pada waktu inferensi:

Klik untuk memutar: tiga atau empat tahun yang lalu, melambaikan tangan di depan wajah yang dipalsukan merupakan uji coba yang dapat diandalkan untuk panggilan video, tetapi kita dapat melihat bahwa upaya keras dari aplikasi seperti TikTok sedang membuat terobosan mendalam ke dalam 'tanda' klasik. Sumber: Ibid dan https://archive.is/mofRV#wavehands

Yang lebih penting lagi, penggunaan filter kecantikan pengubah/pengubah wajah yang meluas mengaburkan harapan bagi generasi baru detektor deepfake yang bertugas untuk mencegah penipu memasuki obrolan video di ruang rapat, dan menjauhkan mereka dari korban potensial yang rentan penipuan 'penculikan' dan 'penipu'.

Lebih mudah membuat deepfake meyakinkan, baik foto atau video, jika resolusi gambarnya rendah atau citranya entah bagaimana menurun kualitasnya, karena sistem pemalsuan yang mendasarinya dapat menyembunyikan kekurangannya sendiri di balik apa yang tampak sebagai masalah konektivitas atau platform.

Faktanya, filter kecantikan yang paling populer menghilangkan beberapa materi yang paling berguna dalam mengidentifikasi video deepfake, seperti tekstur kulit dan area detail wajah lainnya – dan perlu dipertimbangkan bahwa semakin tua wajah, semakin banyak detail yang mungkin terkandung di dalamnya, dan oleh karena itu penggunaan filter vanity de-aging mungkin menjadi godaan tertentu dalam kasus seperti ini.

Jika tampilan ala 'android' tanpa detail sedang menjadi tren, detektor deepfake mungkin tidak memiliki materi yang mereka butuhkan untuk membedakan antara gambar dan tokoh video asli dan palsu. Sumber: https://www.instagram.com/reel/DMyGerPtTPF/?hl=en

Royal Society pada akhir tahun 2024 kertas Yang cantik tetaplah baik: efek halo daya tarik di era filter kecantikan menegaskan bahwa penggunaan filter secara universal meningkatkan daya tarik umum pada kedua jenis kelamin (meskipun peningkatan daya tarik cenderung menurunkan estimasi umum kecerdasan pada wanita yang disaring berdasarkan kecantikan).

Oleh karena itu, cukup adil untuk mengatakan bahwa ini adalah teknologi yang populer; bahwa teknologi ini berfungsi; dan bahwa akan menjadi semacam kejutan budaya jika tiba-tiba menjadi subjek batasan keamanan, atau dilarang dalam berbagai konteks.

Meskipun demikian, di era di mana video deepfake mengancam menjadi tidak bisa dibedakan dari peserta video asli, baik dalam penampilan maupun ucapan, mungkin saja 'kebisingan' global dari filter kecantikan perlu dikurangi di masa mendatang, demi alasan keamanan.

Penjahat Halus

Masalah ini baru-baru ini diselidiki dalam kertas baru dari Universitas Cagliari di Italia, berjudul Kecantikan yang Menipu: Mengevaluasi Dampak Filter Kecantikan pada Deteksi Serangan Deepfake dan Morphing.

Dalam studi baru, para peneliti menerapkan filter kecantikan ke wajah dari dua kumpulan data acuan, dan menguji beberapa detektor serangan deepfake dan morphing pada gambar asli dan gambar yang diubah.

Hampir di setiap kasus, akurasi deteksi menurun setelah proses beautifikasi; penurunan paling drastis terjadi ketika filter menghaluskan kerutan, mencerahkan warna kulit, atau membentuk ulang fitur wajah secara halus. Perubahan-perubahan ini menghilangkan atau mendistorsi isyarat yang diandalkan oleh model deteksi.

Misalnya, model berperforma terbaik pada MorphDB kehilangan akurasi lebih dari 9% setelah penyaringan, dan masalah tersebut terus berlanjut di beberapa arsitektur deteksi, yang menunjukkan bahwa sistem saat ini tidak kuat terhadap peningkatan kosmetik umum.

Penulis menyimpulkan:

'Filter [pengindahan] menimbulkan ancaman terhadap integritas sistem autentikasi biometrik dan analisis forensik, yang membuat deteksi deepfake dan serangan morph yang kuat dalam kondisi seperti itu menjadi tantangan terbuka yang kritis.

'Pekerjaan masa depan harus memprioritaskan pengembangan sistem deteksi manipulasi digital yang kuat terhadap perubahan halus di dunia nyata, baik yang berbahaya atau tidak, untuk memastikan pengenalan identitas dan verifikasi konten yang andal dalam konteks sehari-hari dan konteks keamanan kritis.'

Metode dan Data

Untuk mengevaluasi bagaimana filter kecantikan memengaruhi deepfake dan deteksi morf, para peneliti menerapkan filter penghalusan progresif dan menguji hasilnya pada dua jaringan saraf konvolusional benchmark (CNN) berhubungan baik dengan masalah sasaran: AlexNet dan VGG19.

Masing-masing dari dua set data benchmark yang diuji berisi contoh manipulasi wajah yang tepat. Yang pertama adalah SelebritiDF, sebuah tolok ukur video berskala besar yang menampilkan 590 klip asli dan 5,639 klip palsu yang dibuat melalui teknik pertukaran wajah canggih. Koleksi ini menawarkan beragam kondisi pencahayaan, pose kepala, dan ekspresi alami dari 59 individu, sehingga sangat cocok untuk mengevaluasi ketahanan detektor deepfake dalam skenario media dunia nyata:

Contoh gambar wajah yang terkena dampak, dari CelebDF. Sumber: https://github.com/yuezunli/celeb-deepfakeforensics

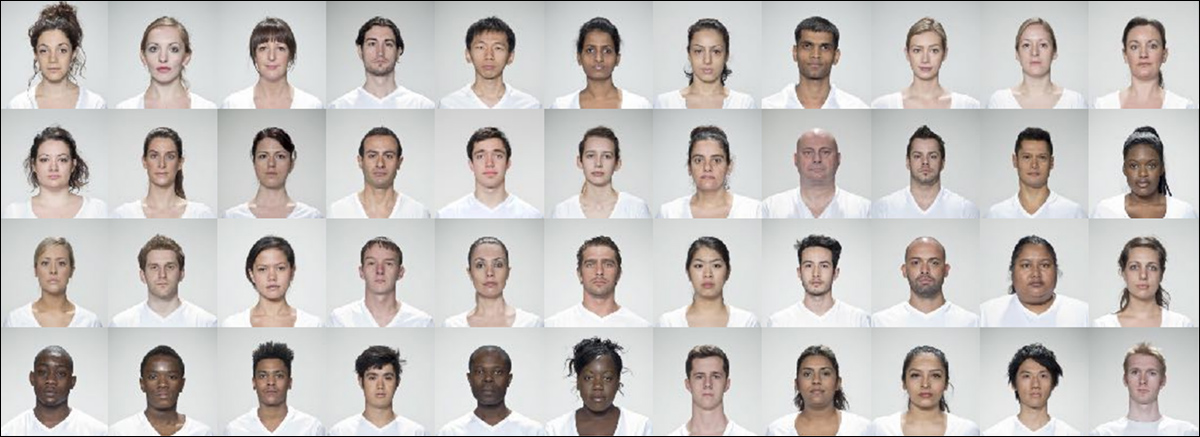

Yang kedua adalah AMSL (diperlukan registrasi), kumpulan data serangan morphing yang dibangun dari Face Research Lab London koleksi, yang berisi wajah asli dan wajah campuran sintetis. Dataset ini mencakup ekspresi netral dan tersenyum dari 102 subjek, dan disusun untuk mencerminkan tantangan realistis bagi sistem autentikasi biometrik yang digunakan dalam konteks seperti kontrol perbatasan.

Gambar dari sumber dataset Face Research Lab London (FRLL), yang digunakan dalam AMSL. Sumber: https://figshare.com/articles/dataset/Face_Research_Lab_London_Set/5047666?file=8541955

Setiap jaringan dilatih pada 80% dataset deepfake atau morphing, dengan 20% sisanya digunakan untuk pengesahanUntuk menguji ketahanan terhadap efek kecantikan, para peneliti kemudian menerapkan filter penghalusan progresif pada gambar uji, meningkatkan radius buram dari 3% menjadi 5% dari tinggi wajah:

Contoh wajah dari dataset CelebDF (atas) dan AMSL (bawah), ditampilkan sebelum dan sesudah penerapan filter kecantikan berbasis penghalusan. Radius filter diskalakan relatif terhadap tinggi wajah, dengan c = 3% dan c = 5% menghasilkan efek yang semakin kuat.

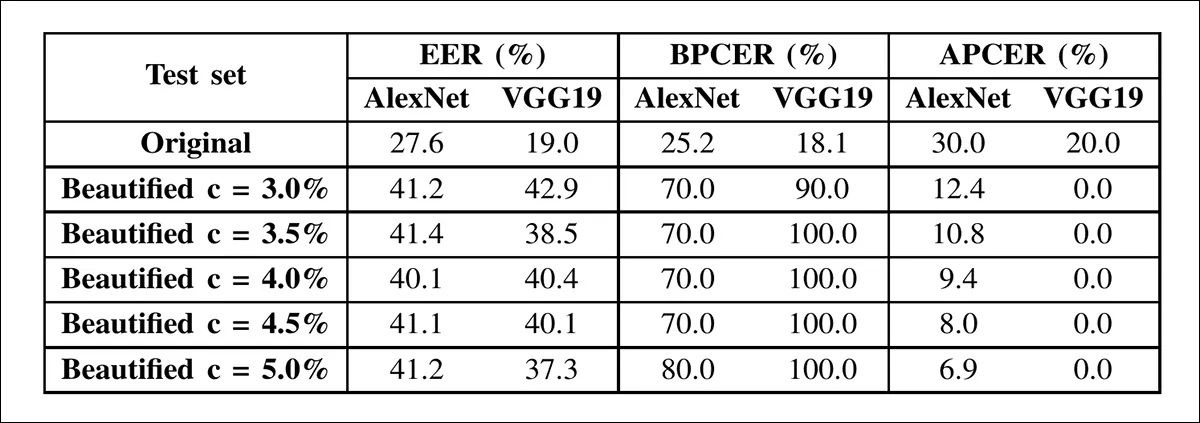

Mengenai metrik, setiap model dievaluasi menggunakan Equal Error Rate (EER) pada sampel uji asli dan yang telah dipercantik. Analisis ini juga melaporkan Tingkat Kesalahan Klasifikasi Presentasi Bona Fide (BPCER), atau tingkat positif palsu, dan Tingkat Kesalahan Klasifikasi Presentasi Serangan (SEBELUMNYA), atau tingkat negatif palsu, menggunakan ambang batas yang ditetapkan pada data asli.

Wajah yang diubah dari dataset AMSL.

Untuk menilai kinerja lebih lanjut, Area di Bawah Kurva ROC (AUC) dan distribusi skor untuk gambar asli dan palsu diperiksa.

Tes

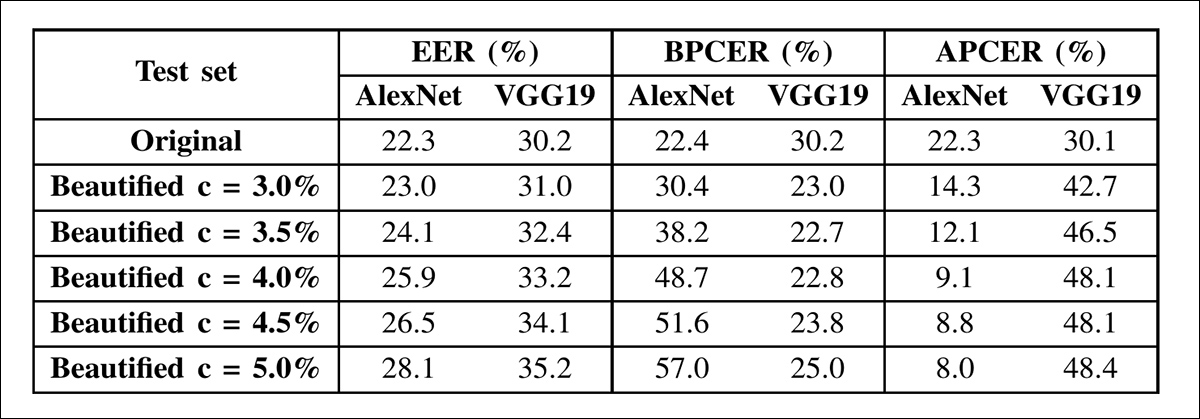

Dalam hasil deteksi deepfake, kedua jaringan menunjukkan peningkatan Equal Error Rate (EER) seiring dengan meningkatnya intensitas beautifikasi. EER AlexNet meningkat dari 22.3% pada gambar asli menjadi 28.1% pada tingkat penghalusan tertinggi, sementara EER VGG19 meningkat dari 30.2% menjadi 35.2%. Penurunan kinerja mengikuti pola yang berbeda-beda pada setiap kasus:

Hasil deteksi deepfake pada dataset CelebDF menggunakan AlexNet dan VGG19. Kedua model diuji pada gambar asli dan gambar yang telah dipercantik dengan peningkatan tingkat penghalusan wajah. Metrik yang ditampilkan meliputi Equal Error Rate (EER), Bona Fide Presentation Classification Error Rate (BPCER), dan Attack Presentation Classification Error Rate (APCER), menggunakan ambang batas yang ditetapkan dari set pengujian asli. Akurasi deteksi menurun seiring dengan peningkatan intensitas percantikan, meskipun pola degradasinya berbeda antar arsitektur.

Seiring meningkatnya fitur kecantikan, AlexNet menjadi lebih mungkin salah mengira wajah asli sebagai wajah palsu, ditunjukkan dengan peningkatan rasio positif palsu (BPCER) yang stabil. Di sisi lain, VGG19 justru kesulitan mendeteksi wajah palsu itu sendiri, dengan rasio negatif palsu (APCER) yang meningkat. Kedua model merespons filter secara berbeda, menunjukkan bahwa bahkan arsitektur yang terkenal pun dapat gagal dengan cara yang berbeda ketika dihadapkan pada perubahan kosmetik.

Untuk lebih memahami hasil ini, para peneliti menerapkan filter beautifikasi secara terpisah pada gambar asli dan palsu, lalu mengukur dampaknya terhadap kinerja deteksi. Rincian ini, yang ditunjukkan pada tabel hasil di bawah, memperjelas sumber kerentanan masing-masing model:

Akurasi deteksi untuk AlexNet dan VGG19 dengan beautifikasi parsial pada dataset CelebDF. Tabel tersebut melaporkan tiga skenario: gambar asli yang telah dipercantik vs. gambar palsu yang telah dipercantik (F-Real vs. F-Fake); gambar asli yang telah dipercantik vs. gambar palsu asli (F-Real vs. O-Fake); dan gambar asli asli vs. gambar palsu yang telah dipercantik (O-Real vs. F-Fake), dengan penurunan akurasi yang menunjukkan penurunan kinerja detektor. AlexNet paling terpengaruh ketika gambar asli dipercantik, sementara VGG19 paling bermasalah ketika beautifikasi diterapkan pada gambar palsu.

Untuk AlexNet, performa deteksi menurun ketika gambar asli dipercantik, tetapi meningkat ketika hanya gambar palsu yang dihaluskan. Untuk VGG19, performa sedikit meningkat dengan gambar asli yang dipercantik, tetapi memburuk ketika deepfake difilter. Dalam semua kasus, kecantikan yang lebih kuat mengurangi akurasi.

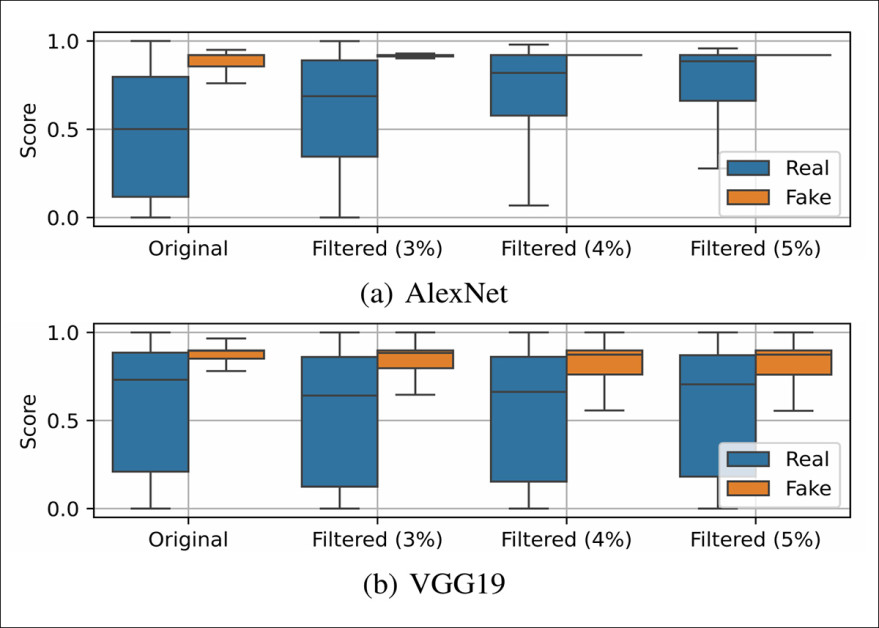

Diagram kotak menunjukkan distribusi skor keluaran AlexNet dan VGG19 pada sampel asli dan palsu dari dataset CelebDF, dengan peningkatan tingkat pemercantikan. Seiring dengan meningkatnya penghalusan, distribusi skor untuk gambar asli dan palsu menjadi kurang terpisah, yang menunjukkan penurunan keandalan deteksi. AlexNet menjadi kurang yakin dalam mengidentifikasi wajah asli, sementara VGG19 menjadi lebih mungkin salah mengklasifikasikan wajah palsu.

Beautifikasi membuat skor keluaran AlexNet lebih seragam di antara sampel asli dan palsu, sementara VGG19 menunjukkan penyebaran yang lebih luas di setiap kelas. Meskipun terdapat efek kontras pada variabilitas skor ini, kedua model kehilangan akurasi. Untuk AlexNet, skor untuk wajah asli bergeser mendekati skor deepfake. Untuk VGG19, skor untuk gambar asli dan palsu mulai tumpang tindih, sehingga mengurangi kemampuan model untuk membedakannya.

Makalah tersebut menyatakan:

Hasil ini memiliki implikasi penting dan menunjukkan perlunya mempertimbangkan potensi penggunaan filter beautifikasi dalam deteksi deepfake, karena hal ini dapat berdampak tak terduga pada kinerja. Khususnya, arsitektur yang berbeda merespons manipulasi wajah secara berbeda, meskipun manipulasi tersebut tidak dimaksudkan untuk menipu.

'Misalnya, berdasarkan detektor deepfake tertentu, filter penghias dapat mengubah keluaran secara signifikan, membuat gambar asli teridentifikasi sebagai palsu dan, yang lebih penting, memungkinkan deepfake menipu deteksi.

'Oleh karena itu, perlu difokuskan pada pengembangan detektor yang lebih tangguh terhadap perubahan halus seperti itu, yang tidak sepenuhnya berbahaya, yang dapat berfungsi sebagai kamuflase untuk manipulasi deepfake yang berbahaya.'

Dalam skenario serangan morphing, sebuah citra sintetis dibuat dengan memadukan fitur wajah dari dua individu. Citra ini digunakan untuk mengelabui sistem pengenalan wajah, sehingga kedua identitas sumber dapat diautentikasi sebagai orang yang sama. Serangan semacam ini dianggap sangat relevan dalam pengaturan keamanan, di mana sistem biometrik bisa saja disesatkan untuk menerima gambar yang diubah tersebut untuk identifikasi resmi.

Tabel di atas menunjukkan hasil deteksi serangan morphing pada gambar AMSL sebelum dan sesudah penghalusan, dengan kedua jaringan menunjukkan peningkatan kesalahan yang tajam seiring meningkatnya intensitas penghalusan.

Dalam skenario serangan morphing, kinerja menurun lebih tajam dibandingkan deteksi deepfake. EER AlexNet meningkat dari 27.6% menjadi 41.2%, dan VGG19 dari 19.0% menjadi 37.3%, terutama disebabkan oleh positif palsu: wajah asli salah diklasifikasikan sebagai morph. Dengan radius penghalusan 3%, rasio positif palsu VGG19 mencapai 90%.

Pola ini berlaku ketika filter diterapkan secara selektif. Penghalusan wajah asli menurunkan deteksi, sementara penghalusan hanya pada wajah yang diubah bentuknya meningkatkan hasil. Seiring penghalusan yang intensif, kedua jaringan menunjukkan pemisahan yang semakin berkurang antara skor asli dan palsu, dengan VGG19 menjadi sangat tidak stabil.

Temuan ini, menurut para penulis, menunjukkan bahwa filter kecantikan dapat membantu morph menghindari deteksi bahkan lebih efektif daripada deepfake, menimbulkan kekhawatiran keamanan yang serius.

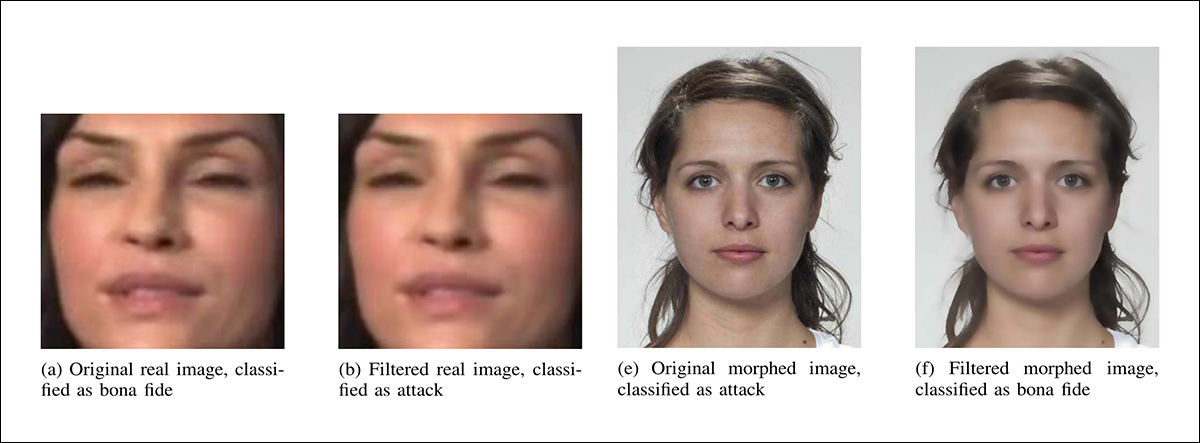

Contoh parsial (karena keterbatasan ruang) tentang bagaimana pemolesan minimal (radius penghalusan 3%) mengubah klasifikasi AlexNet. Di sebelah kiri, gambar asli salah diklasifikasikan sebagai serangan setelah penyaringan, dan di sebelah kanan, gambar hasil morfem salah diklasifikasikan sebagai asli setelah penyaringan.

Akhirnya, para peneliti menemukan bahwa filter pengcantikan yang ringan sekalipun dapat menurunkan kinerja detektor deepfake dan morphing yang canggih secara signifikan.

Dampaknya bervariasi berdasarkan arsitektur, dengan AlexNet menunjukkan penurunan bertahap, dan VGG19 kolaps dengan penyaringan minimal. Karena filter ini umum dan tidak secara inheren berbahaya, kemampuan mereka untuk menyembunyikan serangan, menurut para penulis, menimbulkan ancaman praktis, terutama dalam sistem biometrik. Makalah ini menekankan perlunya model deteksi yang tangguh terhadap manipulasi gambar yang begitu halus.

Kesimpulan

Salah satu alasan mengapa mungkin sulit untuk melatih sistem deteksi deepfake yang dapat mengabaikan filter kecantikan adalah kurangnya materi kontras; pada akhirnya versi yang 'dicantikkan' adalah yang disebarluaskan secara luas, dan, tidak seperti video yang kami sematkan sebelumnya sebagai ilustrasi, sangat jarang gambar 'sebelum' diterapkan.

Kendala lainnya adalah banyak filter yang melakukan jenis penghalusan yang sama persis dengan operasi kompresi saat menyimpan gambar atau mengompresi video (sebuah keuntungan bagi bandwidth penyedia, selain menjadi perubahan tampilan digital bagi mereka yang menggunakan filter tersebut).

Sektor penelitian deteksi deepfake sudah terlibat secara mendalam dalam memerangi kasus-kasus degradasi citra dunia nyata akibat berbagai masalah seperti kamera berkualitas buruk, kompresi berlebihan, atau konektivitas jaringan yang tidak stabil – semua kondisi tersebut merupakan keuntungan langsung bagi penipu deepfake yang terpaksa berusaha lebih keras dalam skenario berkualitas tinggi dan beresolusi tinggi.

Apakah filter kecantikan pada akhirnya akan terancam sebagai sebuah kelemahan keamanan atau tidak, tampaknya bergantung pada sejauh mana filter tersebut terbukti menjadi hambatan bagi metode penyaringan deepfake, atau berakhir menjadi semacam de facto tembok pemisah yang lebih menguntungkan para pelaku kejahatan daripada mereka yang memerangi mereka.

Pertama kali diterbitkan pada hari Rabu, 24 September 2025