Kecerdasan buatan

AnomalyGPT: Mendeteksi Anomali Industri menggunakan LVLMs

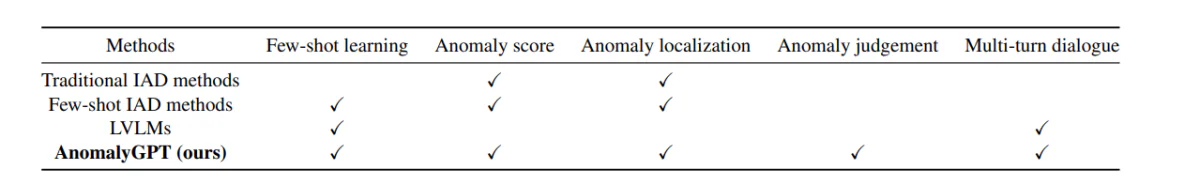

Baru-baru ini, Large Vision Language Models (LVLMs) seperti LLava dan MiniGPT-4 telah menunjukkan kemampuan untuk memahami gambar dan mencapai akurasi dan efisiensi yang tinggi dalam beberapa tugas visual. Sementara LVLMs unggul dalam mengenali objek umum karena dataset pelatihan yang luas, mereka kekurangan pengetahuan domain spesifik dan memiliki pemahaman yang terbatas tentang detail lokal dalam gambar. Ini membatasi efektivitas mereka dalam tugas Deteksi Anomali Industri (IAD). Di sisi lain, kerangka kerja IAD yang ada hanya dapat mengidentifikasi sumber anomali dan memerlukan pengaturan ambang batas manual untuk membedakan antara sampel normal dan anomali, sehingga membatasi implementasi praktisnya.

Tujuan utama dari kerangka kerja IAD adalah untuk mendeteksi dan memlocalisasi anomali dalam skenario industri dan gambar produk. Namun, karena ketidakpastian dan kelangkaan sampel gambar dunia nyata, model biasanya dilatih hanya pada data normal. Mereka membedakan sampel anomali dari sampel normal berdasarkan deviasi dari sampel tipikal. Saat ini, kerangka kerja IAD dan model utamanya hanya menyediakan skor anomali untuk sampel uji. Selain itu, membedakan antara instance normal dan anomali untuk setiap kelas item memerlukan spesifikasi ambang batas manual, sehingga tidak cocok untuk aplikasi dunia nyata.

Untuk mengeksplorasi penggunaan dan implementasi Large Vision Language Models dalam mengatasi tantangan yang dihadapi oleh kerangka kerja IAD, AnomalyGPT, sebuah pendekatan IAD baru berbasis LVLM, diperkenalkan. AnomalyGPT dapat mendeteksi dan memlocalisasi anomali tanpa memerlukan pengaturan ambang batas manual. Selain itu, AnomalyGPT juga dapat menawarkan informasi yang relevan tentang gambar untuk berinteraksi dengan pengguna, memungkinkan mereka untuk mengajukan pertanyaan lanjutan berdasarkan anomali atau kebutuhan spesifik mereka.

Deteksi Anomali Industri dan Large Vision Language Models

Kerangka kerja IAD yang ada dapat dikategorikan menjadi dua kategori.

- Rekonstruksi-based IAD.

- Feature Embedding-based IAD.

Dalam kerangka kerja IAD berbasis Rekonstruksi, tujuan utama adalah merekonstruksi sampel anomali ke sampel normal yang sesuai, dan mendeteksi anomali dengan menghitung kesalahan rekonstruksi. SCADN, RIAD, AnoDDPM, dan InTra menggunakan kerangka kerja rekonstruksi yang berbeda, mulai dari Jaringan Adversarial Generatif (GAN) dan autoencoder, hingga model difusi dan transformer.

Di sisi lain, dalam kerangka kerja IAD berbasis Feature Embedding, tujuan utama adalah memfokuskan pada pemodelan feature embedding dari data normal. Metode seperti PatchSSVD mencoba menemukan hipersfer yang dapat mengencangkan sampel normal dengan ketat, sedangkan kerangka kerja seperti PyramidFlow dan Cfl memproyeksikan sampel normal ke distribusi Gaussian menggunakan aliran normalisasi. CFA dan PatchCore kerangka kerja telah membangun bank memori sampel normal dari patch embedding, dan menggunakan jarak antara sampel uji embedding normal embedding untuk mendeteksi anomali.

Kedua metode ini mengikuti paradigma “one class one model”, sebuah paradigma pembelajaran yang memerlukan sejumlah besar sampel normal untuk mempelajari distribusi setiap kelas objek. Kebutuhan akan sejumlah besar sampel normal membuatnya tidak praktis untuk kategori objek baru, dan dengan aplikasi yang terbatas dalam lingkungan produk dinamis. Di sisi lain, kerangka kerja AnomalyGPT menggunakan paradigma pembelajaran dalam konteks untuk kategori objek, memungkinkan untuk melakukan interferensi hanya dengan sejumlah kecil sampel normal.

Melangkah lebih jauh, kita memiliki Large Vision Language Models atau LVLMs. LLM atau Large Language Models telah menikmati kesuksesan luar biasa dalam industri NLP, dan sekarang sedang dieksplorasi untuk aplikasi mereka dalam tugas visual. Kerangka kerja BLIP-2 menggunakan Q-former untuk memasukkan fitur visual dari Vision Transformer ke dalam model Flan-T5. Selain itu, kerangka kerja MiniGPT menghubungkan segmen gambar dari kerangka kerja BLIP-2 dan model Vicuna dengan lapisan linear, dan melakukan proses fine-tuning dua tahap menggunakan data gambar-teks. Pendekatan ini menunjukkan bahwa kerangka kerja LLM mungkin memiliki beberapa aplikasi untuk tugas visual. Namun, model ini telah dilatih pada data umum, dan mereka kekurangan keahlian domain spesifik yang diperlukan untuk aplikasi yang luas.

Bagaimana AnomalyGPT Bekerja?

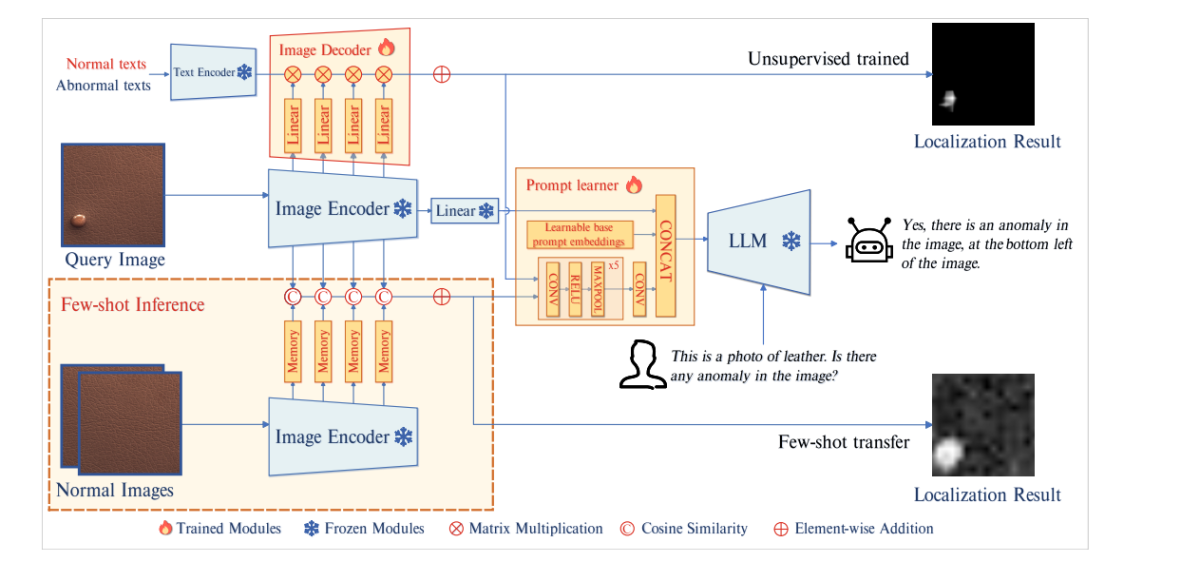

AnomalyGPT pada intinya adalah model bahasa visi besar konversasional IAD yang dirancang khusus untuk mendeteksi anomali industri dan menunjukkan lokasi pastinya menggunakan gambar. Kerangka kerja AnomalyGPT menggunakan LLM dan encoder gambar pra-dilatih untuk menyelaraskan gambar dengan deskripsi teks yang sesuai menggunakan data anomali yang dipicu. Model ini memperkenalkan modul decoder, dan modul prompt learner untuk meningkatkan kinerja sistem IAD, dan mencapai output lokalisisasi tingkat piksel.

Arsitektur Model

Gambar di atas menggambarkan arsitektur AnomalyGPT. Model ini pertama kali melewati gambar kueri ke encoder gambar yang dibekukan. Model ini kemudian mengekstrak fitur tingkat patch dari lapisan intermediate, dan memasukkan fitur-fitur ini ke decoder gambar untuk menghitung kesamaan dengan teks abnormal dan normal untuk mendapatkan hasil lokalisisasi. Prompt learner kemudian mengubahnya menjadi prompt embedding yang sesuai untuk digunakan sebagai input ke LLM bersama dengan input teks pengguna. Model LLM kemudian menggunakan prompt embedding, input gambar, dan input teks pengguna untuk mendeteksi anomali, menunjukkan lokasi, dan membuat respons akhir untuk pengguna.

Decoder

Untuk mencapai lokalisisasi anomali tingkat piksel, model AnomalyGPT menerapkan decoder gambar berbasis pencocokan fitur yang ringan yang mendukung kerangka kerja IAD few-shot dan unsupervised. Desain decoder yang digunakan dalam AnomalyGPT terinspirasi oleh kerangka kerja WinCLIP, PatchCore, dan APRIL-GAN. Model ini membagi encoder gambar menjadi 4 tahap, dan mengekstrak fitur-fitur tingkat patch intermediate dengan setiap tahap.

Namun, fitur-fitur intermediate ini belum melalui penyelarasan gambar-teks akhir, sehingga tidak dapat dibandingkan langsung dengan fitur-fitur lain. Untuk mengatasi masalah ini, model AnomalyGPT memperkenalkan lapisan tambahan untuk memproyeksikan fitur-fitur intermediate, dan menyelaraskannya dengan fitur-fitur teks yang mewakili semantik normal dan abnormal.

Prompt Learner

Kerangka kerja AnomalyGPT memperkenalkan prompt learner yang mencoba mengubah hasil lokalisisasi menjadi prompt embedding untuk memanfaatkan semantik halus dari gambar, dan juga mempertahankan konsistensi semantik antara output decoder dan LLM. Selain itu, model ini mengintegrasikan prompt embedding yang dapat dipelajari, tidak terkait dengan output decoder, ke dalam prompt learner untuk menyediakan informasi tambahan untuk tugas IAD. Akhirnya, model ini memasukkan embedding dan informasi gambar asli ke LLM.

Prompt learner terdiri dari prompt embedding dasar yang dapat dipelajari, dan jaringan saraf konvolusional. Jaringan ini mengubah hasil lokalisisasi menjadi prompt embedding, dan membentuk set prompt embedding yang kemudian digabungkan dengan embedding gambar ke dalam LLM.

Simulasi Anomali

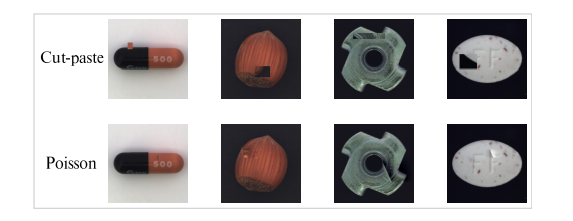

Model AnomalyGPT mengadopsi metode NSA untuk mensimulasikan data anomali. Metode NSA menggunakan teknik Cut-paste dengan menggunakan metode editing gambar Poisson untuk mengurangi diskontinuitas yang diperkenalkan oleh pemolesan segmen gambar. Cut-paste adalah teknik yang umum digunakan dalam kerangka kerja IAD untuk menghasilkan gambar anomali simulasi.

Teknik Cut-paste melibatkan memotong wilayah blok dari gambar secara acak, dan menempelkannya ke lokasi acak di gambar lain, sehingga menciptakan bagian anomali simulasi. Sampel anomali simulasi ini dapat meningkatkan kinerja model IAD, tetapi ada kelemahan, karena mereka sering menghasilkan diskontinuitas yang terlihat. Metode editing Poisson bertujuan untuk mengkloning objek dari satu gambar ke gambar lain dengan menyelesaikan persamaan diferensial Poisson.

Gambar di atas menggambarkan perbandingan antara Poisson dan Cut-paste editing gambar. Seperti yang dapat dilihat, ada diskontinuitas yang terlihat pada teknik Cut-paste, sedangkan hasil dari editing Poisson tampak lebih alami.

Konten Pertanyaan dan Jawaban

Untuk melakukan penyetelan prompt pada Large Vision Language Model, model AnomalyGPT menghasilkan kueri teks yang sesuai berdasarkan gambar anomali. Setiap kueri terdiri dari dua komponen utama. Bagian pertama dari kueri terdiri dari deskripsi gambar input yang menyediakan informasi tentang objek yang ada di gambar beserta atribut yang diharapkan. Bagian kedua dari kueri adalah untuk mendeteksi keberadaan anomali dalam objek, atau memeriksa apakah ada anomali dalam gambar.

Model LLM pertama kali merespons kueri apakah ada anomali dalam gambar? Jika model mendeteksi anomali, maka model tersebut melanjutkan untuk menentukan lokasi dan jumlah area anomali. Model ini membagi gambar menjadi grid 3×3 dari wilayah yang berbeda untuk memungkinkan LLM untuk menunjukkan posisi anomali secara lisan seperti yang ditunjukkan pada gambar di bawah.

Model LLM diberi pengetahuan deskriptif tentang input dengan pengetahuan dasar tentang gambar input yang membantu model memahami komponen gambar dengan lebih baik.

Dataset dan Metrik Evaluasi

Model ini melakukan eksperimen utamanya pada dataset VisA dan MVTec-AD. Dataset MVTech-AD terdiri dari 3629 gambar untuk pelatihan, dan 1725 gambar untuk pengujian yang dibagi ke dalam 15 kategori yang berbeda, sehingga menjadi salah satu dataset paling populer untuk kerangka kerja IAD. Gambar pelatihan fitur hanya gambar normal, sedangkan gambar pengujian fitur baik gambar normal dan anomali. Di sisi lain, dataset VisA terdiri dari 9621 gambar normal, dan sekitar 1200 gambar anomali yang dibagi ke dalam 12 kategori yang berbeda.

Melangkah lebih jauh, seperti kerangka kerja IAD yang ada, model AnomalyGPT menggunakan AUC atau Area Under the Receiver Operating Characteristics sebagai metrik evaluasi, dengan AUC tingkat piksel dan AUC tingkat gambar digunakan untuk menilai kinerja lokalisisasi anomali, dan deteksi anomali. Namun, model ini juga menggunakan akurasi tingkat gambar untuk menilai kinerja pendekatan yang diusulkan karena secara unik memungkinkan untuk menentukan keberadaan anomali tanpa memerlukan pengaturan ambang batas manual.

Hasil

Hasil Kuantitatif

Deteksi Anomali Industri Few-Shot

Model AnomalyGPT membandingkan hasilnya dengan kerangka kerja IAD few-shot sebelumnya, termasuk PaDiM, SPADE, WinCLIP, dan PatchCore sebagai baseline.

Gambar di atas membandingkan hasil model AnomalyGPT dengan kerangka kerja IAD few-shot. Di seluruh dataset, metode yang diikuti oleh AnomalyGPT outperforms pendekatan yang diadopsi oleh model sebelumnya dalam hal AUC tingkat gambar, dan juga mengembalikan akurasi yang baik.

Deteksi Anomali Industri Tak Terawasi

Dalam pengaturan pelatihan tak terawasi dengan sejumlah besar sampel normal, AnomalyGPT melatih satu model pada sampel yang diperoleh dari semua kelas dalam dataset. Pengembang AnomalyGPT telah memilih kerangka kerja UniAD karena dilatih dalam pengaturan yang sama, dan akan bertindak sebagai baseline untuk perbandingan. Selain itu, model ini juga membandingkan dengan kerangka kerja JNLD dan PaDim menggunakan pengaturan yang sama.

Gambar di atas membandingkan kinerja AnomalyGPT dibandingkan dengan kerangka kerja lain.

Hasil Kualitatif

Gambar di atas menggambarkan kinerja model AnomalyGPT dalam metode deteksi anomali tak terawasi, sedangkan gambar di bawah menunjukkan kinerja model dalam metode pembelajaran konteks 1-shot.

Model AnomalyGPT dapat menunjukkan keberadaan anomali, menandai lokasi, dan menyediakan hasil lokalisisasi tingkat piksel. Ketika model dalam metode pembelajaran konteks 1-shot, kinerja lokalisisasi model sedikit lebih rendah dibandingkan dengan metode tak terawasi karena kurangnya pelatihan.

Kesimpulan

AnomalyGPT adalah model bahasa visi besar konversasional IAD yang dirancang untuk memanfaatkan kemampuan kuat dari Large Vision Language Models. Model ini tidak hanya dapat mendeteksi anomali dalam gambar, tetapi juga menunjukkan lokasi pastinya. Selain itu, AnomalyGPT juga memfasilitasi dialog multi-giliran yang berfokus pada deteksi anomali dan menunjukkan kinerja yang luar biasa dalam pembelajaran konteks 1-shot. AnomalyGPT mengeksplorasi potensi aplikasi dari LVLMs dalam deteksi anomali, memperkenalkan ide-ide baru dan kemungkinan untuk industri IAD.