Kecerdasan buatan

Pengenalan Vertex AI

Dengan lanskap Kecerdasan Buatan yang berkembang pesat, salah satu hambatan terbesar yang sering dihadapi oleh pemimpin teknologi adalah transisi dari “eksperimental” menjadi “siap perusahaan”. Sementara chatbot konsumen dan platform interaktif membantu dengan imajinasi publik, bisnis tidak dapat berhasil dengan hanya antarmuka chat. Di era di mana persaingan lebih agresif daripada sebelumnya, bisnis memerlukan ekosistem yang kuat, scalable, dan aman, dan ini adalah apa yang Google coba tawarkan dengan Vertex AI, platform Kecerdasan Buatan dan Pembelajaran Mesin terintegrasi Google Cloud.

Vertex AI berusaha untuk memantapkan dirinya sebagai tulang punggung untuk integrasi Kecerdasan Buatan Generatif dengan infrastruktur cloud modern, menawarkan rangkaian fitur komprehensif yang menjembatani kesenjangan antara model dasar, dan aplikasi kelas produksi. Vertex AI bukan hanya sebuah wrapper untuk model bahasa besar (LLM), melainkan sebuah ekosistem Kecerdasan Buatan dan Pembelajaran Mesin (ML/AI) terintegrasi yang memperlakukan Kecerdasan Buatan Generatif sebagai warga kelas satu infrastruktur cloud modern.

Di jantung Vertex AI terdapat Model Garden, sebuah marketplace pusat yang menyediakan akses ke lebih dari 200 model dasar yang dikurasi, termasuk multimodal Gemini 2.5 Pro, yang menampilkan jendela konteks token yang luar biasa sebesar 2-juta. Dalam artikel ini, kita akan membongkar arsitektur Vertex AI, menjelajahi bagaimana Model Garden berfungsi sebagai “App Store” industri, dan melihat pilar teknis yang membuat platform ini menjadi tulang punggung generasi berikutnya perangkat lunak perusahaan.

Arsitektur Inti : Platform Terintegrasi

Vertex AI bukanlah sekumpulan alat yang longgar, melainkan sebuah ekosistem data dan Kecerdasan Buatan terintegrasi yang dirancang untuk menjembatani fragmentasi data, alat, dan tim yang masih membelenggu pembelajaran mesin hingga hari ini. Secara tradisional, pengembangan Kecerdasan Buatan berlangsung di lingkungan yang terisolasi, dan terkadang data tersebar dan terjebak di berbagai repositori. Misalnya, organisasi mungkin menyimpan data pelanggan di gudang SQL sementara dokumen tidak terstruktur dibuang ke Data Lake. Ketika data terisolasi, Kecerdasan Buatan hanya melihat “kebenaran sebagian”, yang menyebabkan hasil yang bias atau tingkat halusinasi yang tinggi karena kurangnya konteks perusahaan yang lengkap.

Vertex AI berusaha untuk mengintegrasikan seluruh siklus hidup, dari pengambilan data mentah di BigQuery dan Cloud Storage hingga pemantauan produksi, pada dasarnya berfungsi sebagai “jaringan penghubung” antara silo-silo ini. Vertex AI terintegrasi secara asli dengan Cloud Storage dan BigQuery, memungkinkan model Kecerdasan Buatan untuk mengambil data tanpa pipeline Ekstraksi, Transformasi, dan Muat yang kompleks.

Dasar : Hyperkomputer Kecerdasan Buatan Google

Lapisan GenAI dari Vertex AI berada di atas arsitektur Hyperkomputer Kecerdasan Buatan Google, sebuah sistem superkomputing terintegrasi, yang terdiri dari:

TPU v5p & v5e (Tensor Processing Units)

Tensor Processing Units Google adalah ASIC (Application-Specific Integrated Circuits) khusus yang dirancang khusus untuk perkalian matriks yang mendefinisikan pembelajaran dalam.

- TPU v5p (Kinerja): Ini adalah akselerator bintang untuk pelatihan skala besar. Setiap pod TPU v5p dapat diskalakan hingga 8.960 chip yang dihubungkan oleh Inter-Chip Interconnect (ICI) Google dengan bandwidth tertinggi sebesar 4.800 Gbps. Untuk seorang pemimpin teknis, ini berarti 2,8x lebih cepat untuk pelatihan model GPT-3 (175B parameter) dibandingkan dengan generasi sebelumnya, yang secara drastis mengurangi waktu-pasaran.

- TPU v5e (Efisiensi): Dirancang untuk “kinerja yang dioptimalkan biaya”, v5e adalah pekerja keras untuk pelatihan skala menengah dan inferensi dengan throughput tinggi. Ini menawarkan hingga 2,5x kinerja harga yang lebih baik, membuatnya menjadi pilihan ideal untuk bisnis yang perlu menjalankan inferensi 24/7 tanpa anggaran besar.

NVIDIA H100/A100 GPUs untuk Fleksibilitas

Sementara TPU bersifat khusus, banyak tim pengembangan mengandalkan ekosistem NVIDIA CUDA. Vertex AI menyediakan dukungan kelas satu untuk perangkat keras NVIDIA terbaru:

- NVIDIA H100 (Hopper): Ideal untuk fine-tuning model sumber terbuka terbesar (seperti Llama 3.1 405B) yang memerlukan bandwidth memori yang besar.

- Jupiter Networking: Untuk mencegah “Botol Leher Jaringan”, Google menggunakan kain jaringan pusat data Jupiter. Ini memastikan bahwa data bergerak antara GPU dengan kecepatan kilat, mendukung RDMA (Remote Direct Memory Access) untuk melewati overhead CPU dan menyampaikan kinerja hampir lokal di seluruh node terdistribusi.

Orkestrasi Dinamis

Perubahan teknis paling kritis di Vertex AI adalah Orkestrasi Dinamis. Dalam lingkungan warisan, jika sebuah node GPU gagal selama pelatihan 3-minggu, pekerjaan keseluruhan mungkin gagal.

- Resiliensi Otomatis: Vertex AI, sering kali didukung oleh Google Kubernetes Engine (GKE) di balik layar, menampilkan node “Self-healing”. Jika kesalahan perangkat keras terdeteksi, platform secara otomatis bermigrasi beban kerja ke node yang sehat.

- Pengatur Jadwal Kerja Dinamis: Alat ini memungkinkan tim untuk meminta kapasitas berdasarkan urgensi. Anda dapat memilih Flex Start (lebih murah, dimulai ketika kapasitas tersedia) atau Kapasitas yang Dijamin untuk rilis misi-kritis.

- Pelatihan Serverless: Untuk tim yang ingin mengelola infrastruktur nol, Vertex AI Serverless Training memungkinkan Anda untuk mengirimkan kode dan data; platform menyediakan cluster, menjalankan pekerjaan, dan merobeknya—mengenakan biaya hanya untuk detik komputasi yang digunakan.

Tiga Titik Masuk: Penemuan, Eksperimen, dan Otomatisasi

Untuk mengakomodasi berbagai persona teknis—from ilmuwan data ke pengembang aplikasi—Vertex AI menyediakan tiga titik masuk utama:

- Model Garden: Marketplace untuk Penemuan.

- Vertex AI Studio: Playground untuk Eksperimen.

- Vertex AI Agent Builder: Pabrik untuk Otomatisasi.

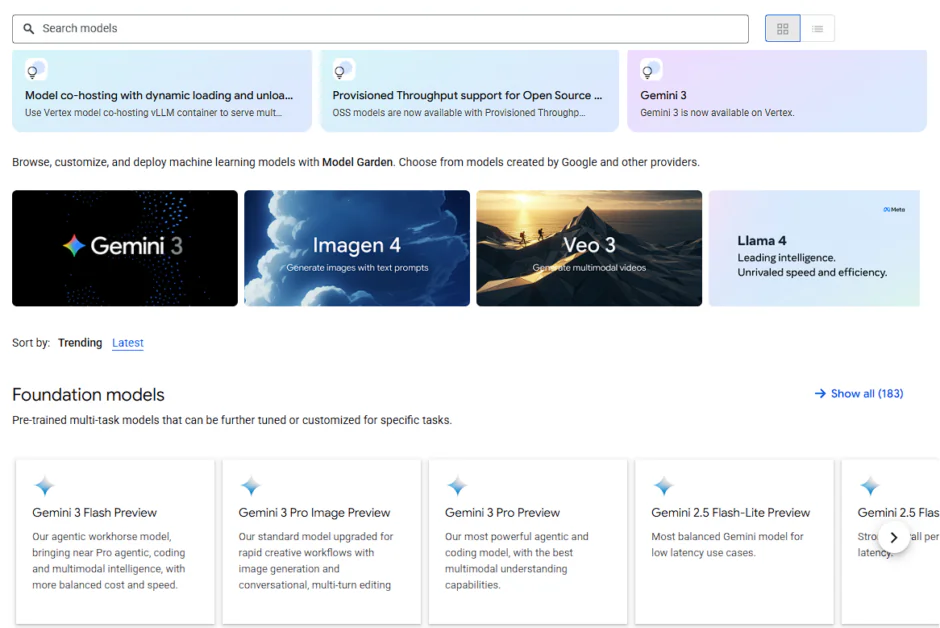

Model Garden: Marketplace untuk Penemuan

Model Garden Google Cloud adalah platform terpusat di Google Cloud untuk menemukan, menguji, mengkustomisasi, dan mengirimkan berbagai model Kecerdasan Buatan, termasuk multimodal (penglihatan, teks, kode) untuk berbagai kebutuhan bisnis, menawarkan integrasi yang mulus dengan alat Vertex AI untuk MLOps yang terstruktur. Ini bertindak sebagai perpustakaan komprehensif, membantu pengembang dan bisnis memilih model yang tepat (dari model dasar besar hingga khusus) untuk tugas mereka, apakah itu untuk generasi teks, analisis gambar, atau penyelesaian kode, dan mengirimkannya secara efisien dalam lingkungan Google Cloud mereka.

Model Garden mengategorikan modelnya lebih dari 200 model menjadi tiga tingkat yang berbeda, memungkinkan arsitek untuk menyeimbangkan kinerja, biaya, dan kontrol:

- Model Pertama (Google): Ini adalah model multimodal bintang dalam Vertex AI, dan Google menawarkannya dalam berbagai ukuran, mulai dari Pro dengan alasan kompleks hingga Flash dengan latensi rendah, dan volume tinggi, sehingga memungkinkan pengembang untuk mengoptimalkan model mereka sesuai dengan kasus penggunaan mereka.

- Model Pihak Ketiga (Proprietary): Melalui kemitraan strategis, Vertex AI menawarkan akses “Model-as-a-Service” (MaaS) ke raksasa seperti Anthropic (Claude 3.5) dan Mistral AI. Sebagai gantinya mengelola billing dan kredensial keamanan terpisah untuk lima penyedia Kecerdasan Buatan yang berbeda, sebuah tim teknis dapat mengakses semuanya melalui proyek Google Cloud yang ada, menggunakan format API yang terintegrasi.

- Model Sumber Terbuka & Berat Terbuka: Tingkat ini termasuk Meta’s Llama 3.2, Mistral, dan Gemma milik Google. Ini ideal untuk organisasi yang ingin mengirimkan model secara mandiri dalam VPC (Virtual Private Cloud) mereka sendiri untuk memastikan isolasi data maksimum.

Dalam lingkungan yang tidak terintegrasi, mengirimkan model sumber terbuka seperti Llama memerlukan pengaturan lingkungan PyTorch, mengkonfigurasi driver CUDA, dan mengelola wrapper Flask atau FastAPI.

Model Garden menghilangkan fase “Munging” ini melalui Titik Akhir Terkelola yang Terintegrasi:

- Pengiriman dengan Sekali Klik: Untuk banyak model, mengklik “Deploy” secara otomatis menyediakan sumber daya TPU/GPU yang diperlukan, membungkus model dalam wadah yang siap produksi, dan menyediakan titik akhir API REST.

- Integrasi Hugging Face: Vertex AI sekarang memungkinkan pengembang untuk mengirimkan model langsung dari Hugging Face Hub ke titik akhir Vertex, menyediakan ekspansi kecerdasan yang hampir tak terbatas.

- Private Service Connect (PSC): Untuk industri yang sangat teratur, model dapat diirimkan menggunakan Private Service Connect, memastikan titik akhir model tidak pernah terpapar ke internet publik—menjaga lalu lintas data secara ketat dalam jaringan perusahaan.

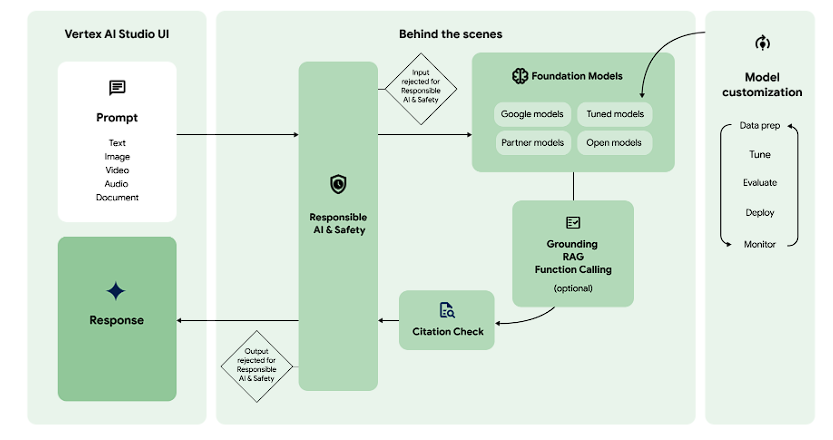

Vertex AI Studio: Playground untuk Eksperimen

Sementara Model Garden tentang pemilihan, Vertex AI Studio adalah tentang presisi. Vertex AI Studio dapat dibandingkan dengan compiler dan debugger yang Anda temukan di dunia perangkat lunak tradisional. Vertex AI Studio adalah ruang kerja di mana model mentah diukir menjadi alat bisnis khusus melalui kombinasi teknik prompt, pengujian multimodal, dan pengaturan hiperparameter lanjutan.

Prototipe Multimodal: Melampaui Teks

Salah satu fitur unggulan Studio adalah dukungan asli untuk multimodality. Sementara platform lain memerlukan pengkodean kompleks untuk menangani data non-teks, Vertex AI Studio memungkinkan Anda untuk langsung mengunggah file ke antarmuka untuk menguji kemampuan alasan Gemini 2.5.

- Kecerdasan Video: Anda dapat mengunggah keynote teknis 45 menit dan meminta model untuk “mengidentifikasi setiap kali API tertentu disebutkan dan menyediakan ringkasan dengan timestamp.”

- Analisis Dokumen: Sebagai gantinya hanya membaca teks, model dapat menganalisis tata letak visual dari PDF 1.000 halaman, memahami hubungan antara bagan, tabel, dan prosa sekitarnya.

- Eksesusi Kode: Studio sekarang mendukung eksekusi kode di playground. Jika Anda meminta model untuk menyelesaikan masalah matematika kompleks atau menganalisis CSV, model dapat menulis dan menjalankan kode Python dalam lingkungan sandbox yang aman untuk menyediakan jawaban yang diverifikasi.

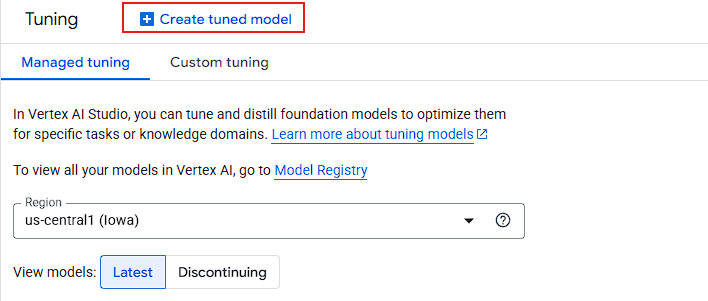

Kustomisasi Lanjutan: Jalur Pengaturan

Ketika teknik prompt (Zero-shot atau Few-shot) mencapai batasnya, Vertex AI Studio menyediakan mesin berat: Pengaturan Model.

- Penghalusan Terawasi (SFT): Pengembang menyediakan dataset pasangan “Prompt/Respon” (idealnya 100+ contoh). Ini mengajarkan model untuk mengadopsi suara merek tertentu, format output (seperti JSON khusus), atau jargon domain-spesifik.

- Penyimpanan Konteks: Untuk perusahaan yang menangani dataset statis besar (seperti perpustakaan hukum atau basis kode), Studio memungkinkan Penyimpanan Konteks. Ini memungkinkan Anda untuk “mengisi awal” satu juta token data ke memori model, secara drastis mengurangi latensi dan biaya untuk kueri berikutnya.

- Destilasi (Guru-Murid): Ini adalah langkah arsitektural tingkat tinggi. Anda dapat menggunakan model besar (Gemini 2.5 Pro) untuk “mengajar” model yang lebih kecil dan lebih cepat (Gemini 2.0 Flash). Hasilnya adalah model ringan yang berkinerja pada level “Pro” tetapi berjalan dengan kecepatan dan biaya “Flash”.

Vertex AI Agent Builder: Pabrik untuk Otomatisasi

Vertex AI Agent Builder adalah kerangka orkestrasi tingkat tinggi yang memungkinkan pengembang untuk membuat agen ini dengan menggabungkan model dasar dengan data perusahaan dan API eksternal.

Arsitektur “Kebenaran”: Pembumian & RAG

Hambatan teknis utama untuk Kecerdasan Buatan perusahaan adalah halusinasi. Agent Builder menyelesaikannya melalui mesin Pembumian yang canggih.

- Pembumian dengan Google Search: Untuk kueri yang memerlukan pengetahuan dunia nyata (misalnya, “Apa tingkat suku bunga hipotek saat ini di New York?”), agen dapat melakukan pencarian Google, mengekstrak fakta, dan mengutip sumbernya.

- Vertex AI Search (RAG-as-a-Service): Sebagai gantinya membangun basis data vektor (Pinecone, Weaviate) secara manual, pengembang dapat menggunakan Vertex AI Search untuk mengindeks dokumen mereka sendiri (PDF, HTML, BigQuery). Ini menangani langkah-langkah “pemotongan”, “penanaman”, dan “pengambilan” secara otomatis, memastikan agen hanya menjawab berdasarkan “Sumber Kebenaran” internal.

- Vertex AI RAG Engine: Untuk implementasi khusus skala tinggi, layanan terkelola ini memungkinkan pencarian hibrida (menggabungkan hasil vektor dan kata kunci) untuk meningkatkan akurasi hingga 30% lebih tinggi dari output LLM standar.

Orkestrasi Multi-Agen (Protokol A2A)

Alur kerja perusahaan lanjutan sering memerlukan beberapa agen khusus yang bekerja bersama. Vertex AI memperkenalkan Protokol Agen-ke-Agen (A2A), sebuah standar terbuka yang memungkinkan:

- Agen “Perjalanan” untuk berbicara dengan “Agen Keuangan” untuk memastikan pemesanan penerbangan berada dalam anggaran perusahaan.

- Interoperabilitas: Karena menggunakan protokol terbuka, agen yang dibangun di Vertex dapat berkomunikasi dengan yang dibangun di framework lain seperti LangChain atau CrewAI.

Tumpukan Pengembang: ADK dan Mesin Agen

Untuk audiens “platform teknis”, Agent Builder menawarkan dua jalur yang berbeda:

- Konsol Tanpa Kode: Antarmuka drag-and-drop visual untuk prototipe cepat dan konfigurasi pengguna bisnis.

- Kit Pengembangan Agen (ADK): Toolkit kode-awal Python untuk insinyur. Ini memungkinkan “Prompt-as-Code”, integrasi kontrol versi, dan kemampuan untuk mengirimkan ke Vertex AI Agent Engine—runtime terkelola yang menangani persistensi sesi, penskalaan, dan manajemen status secara otomatis.

Kesimpulan: Dari “Bagaimana Jika” ke “Apa Selanjutnya”

Transisi dari demo Kecerdasan Buatan yang mencolok ke aplikasi perusahaan kelas produksi telah lama menjadi “lembah kematian” untuk proyek transformasi digital. Seperti yang kita jelajahi, Vertex AI dirancang khusus untuk menjembatani kesenjangan ini. Dengan mengintegrasikan silo-silo yang terfragmentasi dari data, infrastruktur, dan orkestrasi model, Google Cloud telah memindahkan percakapan dari kekuatan murni Model Bahasa Besar dan menuju kedewasaan operasional dari siklus hidup Kecerdasan Buatan.