Kecerdasan buatan

Penelitian AI Memprediksi Pengontrol Volume Terpisah untuk Dialog, Musik, dan Efek Suara

Kolaborasi penelitian baru yang dipimpin oleh Mitsubishi menyelidiki kemungkinan mengextract tiga trek suara terpisah dari sumber audio asli, memecah trek audio menjadi ucapan, musik, dan efek suara (yaitu kebisingan lingkungan).

Karena ini adalah kerangka kerja pemrosesan pasca-fakta, menawarkan potensi untuk generasi berikutnya dari platform tontonan multimedia, termasuk peralatan konsumen, untuk menawarkan kontrol volume tiga titik, memungkinkan pengguna untuk meningkatkan volume dialog, atau menurunkan volume soundtrack.

Dalam klip singkat di bawah dari video yang menyertain penelitian (lihat akhir artikel untuk video lengkap), kita melihat berbagai aspek soundtrack yang ditekankan ketika pengguna menarik kontrol di sepanjang segitiga dengan ketiga komponen audio di setiap sudut:

Sebuah klip singkat dari video yang menyertain makalah (lihat embed di akhir artikel). Ketika pengguna menarik kursor ke salah satu dari tiga aspek yang diekstrak di antarmuka segitiga (di sebelah kanan), audio menekankan bagian itu dari soundtrack tripartit. Meskipun video yang lebih lama menyebutkan sejumlah contoh tambahan di YouTube, contoh-contoh tersebut tampaknya tidak tersedia saat ini. Source: https://vimeo.com/634073402

Makalah tersebut berjudul The Cocktail Fork Problem: Three-Stem Audio Separation for Real-World Soundtracks, dan berasal dari peneliti di Mitsubishi Electric Research Laboratories (MERL) di Cambridge, MA, dan Departemen Teknik Sistem Cerdas di Universitas Indiana di Illinois.

Memisahkan Aspek Soundtrack

Peneliti telah menamai tantangan ‘The Cocktail Party Problem’ karena melibatkan isolasi elemen soundtrack yang sangat terjalin, yang menciptakan peta jalan yang menyerupai garpu (lihat gambar di bawah). Dalam prakteknya, soundtrack multi-kanal (yaitu stereo dan lebih) mungkin memiliki jumlah konten yang berbeda, seperti dialog, musik, dan lingkungan, terutama karena dialog cenderung mendominasi saluran tengah dalam campuran Dolby 5.1. Saat ini, bidang penelitian pemisahan audio yang sangat aktif berkonsentrasi pada menangkap benang-benang ini dari soundtrack tunggal yang sudah jadi, seperti yang dilakukan penelitian saat ini.

The Cocktail Fork – menghasilkan tiga soundtrack terpisah dari soundtrack tunggal yang digabung. Source: https://arxiv.org/pdf/2110.09958.pdf

Penelitian terbaru telah berkonsentrasi pada mengextract ucapan dalam berbagai lingkungan, sering untuk tujuan denoising audio ucapan untuk berinteraksi dengan sistem Pemrosesan Bahasa Alam (NLP), tetapi juga pada isolasi suara nyanyian arsip, baik untuk membuat versi sintetis penyanyi nyata (bahkan yang sudah meninggal), atau untuk memfasilitasi isolasi musik gaya Karaoke.

Dataset untuk Setiap Aspek

Sampai saat ini, sedikit pertimbangan yang diberikan untuk menggunakan teknologi AI ini untuk memberi pengguna lebih banyak kontrol atas campuran soundtrack. Oleh karena itu, peneliti telah memformalkan masalah dan mengembangkan dataset baru sebagai bantuan untuk penelitian berkelanjutan tentang pemisahan soundtrack multi-tipe, serta mengujinya pada berbagai kerangka pemisahan audio yang ada.

Dataset baru yang dikembangkan oleh penulis disebut Divide and Remaster (DnR), dan dihasilkan dari dataset sebelumnya LibriSpeech, Free Music Archive dan Freesound Dataset 50k (FSD50K). Untuk mereka yang ingin bekerja dengan DnR dari awal, dataset harus dibangun kembali dari tiga sumber; jika tidak, akan segera tersedia di Zenodo, klaim penulis. Namun, pada saat penulisan, tautan GitHub untuk utilitas ekstraksi sumber tidak aktif saat ini, sehingga mereka yang tertarik mungkin perlu menunggu sebentar.

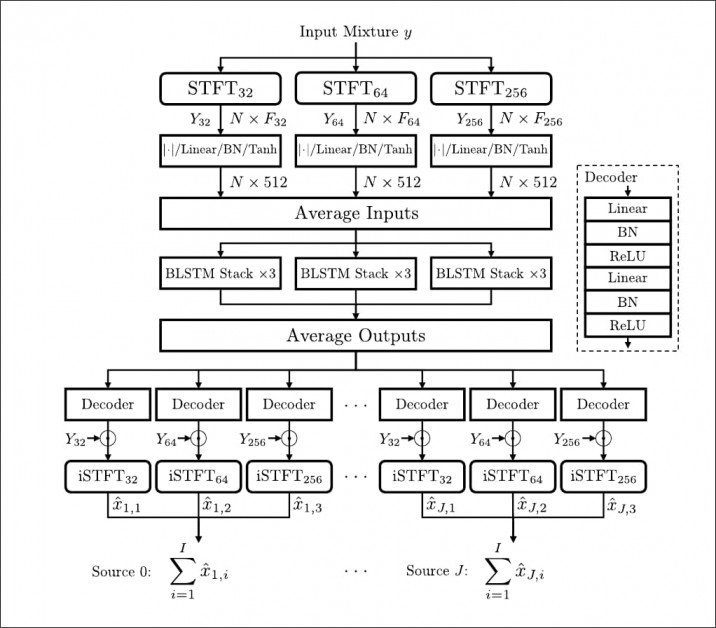

Peneliti telah menemukan bahwa arsitektur CrossNet un-mix (XUMX) yang diusulkan oleh Sony pada bulan Mei bekerja sangat baik dengan DnR.

Arsitektur CrossNet Sony.

Penulis mengklaim bahwa model ekstraksi pembelajaran mesin mereka bekerja dengan baik pada soundtrack dari YouTube, meskipun evaluasi yang disajikan dalam makalah didasarkan pada data sintetis, dan video utama yang disediakan (tersemat di bawah) saat ini tampaknya merupakan satu-satunya yang tersedia.

Ketiga dataset yang digunakan masing-masing terdiri dari koleksi output yang perlu dipisahkan dari soundtrack: FSD50K ditempati dengan efek suara, dan menampilkan 50.000 klip audio mono 44,1 kHz yang diberi label dengan 200 label kelas dari ontology AudioSet Google; Free Music Archive menampilkan 100.000 lagu stereo yang mencakup 161 genre musik, meskipun penulis telah menggunakan subset yang berisi 25.000 lagu, untuk kesetaraan dengan FSD50K; dan LibriSpeech menyediakan DnR dengan 100 jam sampel audio buku sebagai file audio mp3 44,1kHz.

Pekerjaan Masa Depan

Penulis memprediksi pekerjaan lebih lanjut pada dataset dan kombinasi model terpisah yang dikembangkan untuk penelitian lebih lanjut tentang kerangka pengenalan ucapan dan klasifikasi suara, yang menampilkan generasi caption otomatis untuk ucapan dan suara non-ucapan.

Mereka juga berencana untuk mengevaluasi kemungkinan pendekatan remix yang dapat mengurangi artefak perseptual, yang tetap menjadi masalah utama ketika membagi soundtrack audio yang digabung menjadi komponen-komponennya.

Pemisahan seperti ini di masa depan dapat tersedia sebagai komoditas konsumen di smart TV yang mengintegrasikan jaringan inferensi yang sangat dioptimalkan, meskipun tampaknya kemungkinan bahwa implementasi awal akan memerlukan beberapa level waktu pra-pemrosesan dan ruang penyimpanan. Samsung sudah menggunakan jaringan neural lokal untuk upscaling, sementara Cognitive Processor XR Sony, yang digunakan dalam jajaran Bravia, menganalisis dan menafsirkan kembali soundtrack secara langsung melalui AI terintegrasi ringan.

Seruan untuk kontrol yang lebih besar atas campuran soundtrack berulang secara berkala, dan sebagian besar solusi yang ditawarkan harus berurusan dengan kenyataan bahwa soundtrack sudah dibuat sesuai dengan standar saat ini (dan asumsi tentang apa yang diinginkan pemirsa) dalam industri film dan TV.

Salah satu pemirsa, yang frustrasi dengan disparitas tingkat volume yang mengagetkan antara berbagai elemen soundtrack film, menjadi cukup putus asa untuk mengembangkan pengatur volume otomatis berbasis perangkat keras yang dapat mengequalisasi volume untuk film dan TV.

Meskipun smart TV menawarkan berbagai metode untuk mencoba meningkatkan volume dialog melawan tingkat volume yang grandiose untuk musik, mereka semua berjuang melawan keputusan yang dibuat pada saat pencampuran, dan, secara argumentatif, visi produser konten yang ingin pemirsa mengalami soundtrack mereka tepat seperti yang mereka tetapkan.

Produser konten tampaknya kemungkinan akan menentang penambahan potensial ini ke ‘budaya remix’, karena beberapa tokoh industri telah mengungkapkan ketidakpuasan terhadap algoritma pemrosesan TV default seperti motion smoothing.