Sudut Anderson

Menambahkan Dialog ke Video Nyata dengan AI

Sebuah kerangka kerja AI baru dapat menulis ulang, menghapus, atau menambahkan kata-kata seseorang di video tanpa harus syuting ulang, dalam satu sistem end-to-end.

Tiga tahun yang lalu, internet akan terkejut dengan salah satu dari 20-30 kerangka kerja video-AI yang dipublikasikan di portal akademis setiap minggu; karena sekarang, strand penelitian ini telah menjadi sangat prolifik sehingga hampir membentuk cabang lain dari ‘AI Slop’, dan saya meliput jauh lebih sedikit dari rilis-rilis tersebut daripada yang saya lakukan dua atau tiga tahun yang lalu.

Namun, salah satu rilis saat ini dalam garis ini menarik perhatian saya: sebuah sistem terintegrasi yang dapat mengintervensi klip video nyata dan memasukkan ucapan baru ke dalam video yang ada (bukan membuat klip generatif seluruhnya dari wajah atau bingkai, yang jauh lebih umum).

Dalam contoh di bawah, yang saya edit bersama dari sejumlah video contoh yang tersedia di situs web proyek rilis, kita pertama kali melihat klip sumber asli, dan kemudian, di bawahnya, ucapan AI yang diterapkan di tengah klip, termasuk sintesis suara dan sinkronisasi bibir:

Klik untuk memutar. Pengeditan lokal dengan penjahitan – salah satu modalitas yang ditawarkan oleh FacEDiT. Silakan merujuk ke situs web sumber untuk resolusi yang lebih baik. Sumber – https://facedit.github.io/

Pendekatan ini adalah salah satu dari tiga yang dikembangkan untuk metode baru ini, yang satu ini berjudul ‘pengeditan lokal dengan penjahitan’, dan yang paling menarik bagi penulis (serta saya). Esensinya, klip diperpanjang dengan menggunakan salah satu bingkai tengah sebagai titik awal untuk interpretasi AI baru, dan bingkai (nyata) berikutnya sebagai tujuan yang klip yang dihasilkan harus sesuai.

Dalam klip yang terlihat di atas, ‘benih’ dan ‘target’ bingkai ini direpresentasikan oleh video atas yang berhenti, sementara video yang diedit di bawah menyediakan pengisian generatif.

Penulis membingkai pendekatan sintesis wajah dan vokal ini sebagai metode end-to-end terintegrasi pertama untuk pengeditan video AI dari jenis ini, mengamati potensi kerangka kerja yang sepenuhnya dikembangkan seperti ini untuk produksi TV dan film:

‘Sutradara dan produser media sering perlu merevisi bagian tertentu dari video yang direkam – mungkin sebuah kata salah diucapkan atau skenario berubah setelah syuting. Misalnya, dalam adegan ikonik dari Titanic (1997) di mana Rose mengatakan, “I’ll never let go, Jack,” sutradara mungkin kemudian memutuskan itu harus “I’ll never forget you, Jack”.

‘Secara tradisional, perubahan seperti itu memerlukan syuting ulang seluruh adegan, yang memakan biaya dan waktu. Sintesis wajah berbicara menawarkan alternatif yang praktis dengan memodifikasi gerakan wajah secara otomatis untuk mencocokkan ucapan yang direvisi, menghilangkan kebutuhan akan syuting ulang.’

Meskipun interposisi AI dari jenis ini mungkin menghadapi perlawanan budaya atau industri, mereka juga dapat membentuk fungsi baru dalam sistem VFX yang dipimpin manusia dan paket alat. Dalam hal apa pun, untuk saat ini, tantangannya secara teknis.

Selain memperpanjang klip melalui dialog AI tambahan, sistem baru ini juga dapat mengubah ucapan yang ada:

Klik untuk memutar. Contoh mengubah dialog yang ada rather than memasukkan dialog tambahan. Silakan merujuk ke situs web sumber untuk resolusi yang lebih baik.

Keadaan Seni

Saat ini tidak ada sistem end-to-end yang menawarkan kemampuan sintesis ini; meskipun sejumlah platform AI generatif seperti Veo series dari Google, dapat menghasilkan audio, dan berbagai kerangka kerja lain dapat membuat deepfaked audio, saat ini Anda harus membuat pipeline yang cukup terlibat dari arsitektur dan trik yang berbeda untuk mengganggu footage nyata dengan cara sistem baru – yang berjudul FacEDiT – dapat mencapai.

Sistem ini menggunakan Diffusion Transformers (DiT) dalam kombinasi dengan Flow Matching untuk membuat gerakan wajah yang dikondisikan pada gerakan kontekstual sekitarnya dan konten audio ucapan. Sistem ini memanfaatkan paket populer yang ada yang menangani rekonstruksi wajah, termasuk LivePortrait (baru-baru ini diambil alih oleh Kling).

Selain metode ini, karena pendekatan mereka adalah yang pertama untuk mengintegrasikan tantangan ini ke dalam satu solusi, penulis telah membuat benchmark baru yang disebut FacEDiTBench, bersama dengan beberapa metrik evaluasi baru yang sepenuhnya untuk tugas khusus ini.

Karya baru ini berjudul FacEDiT: Unified Talking Face Editing and Generation via Facial Motion Infilling, dan berasal dari empat peneliti dari Pohang University of Science and Technology (POSTECH), Korea Advanced Institute of Science & Technology (KAIST), dan The University of Texas at Austin.

Metode

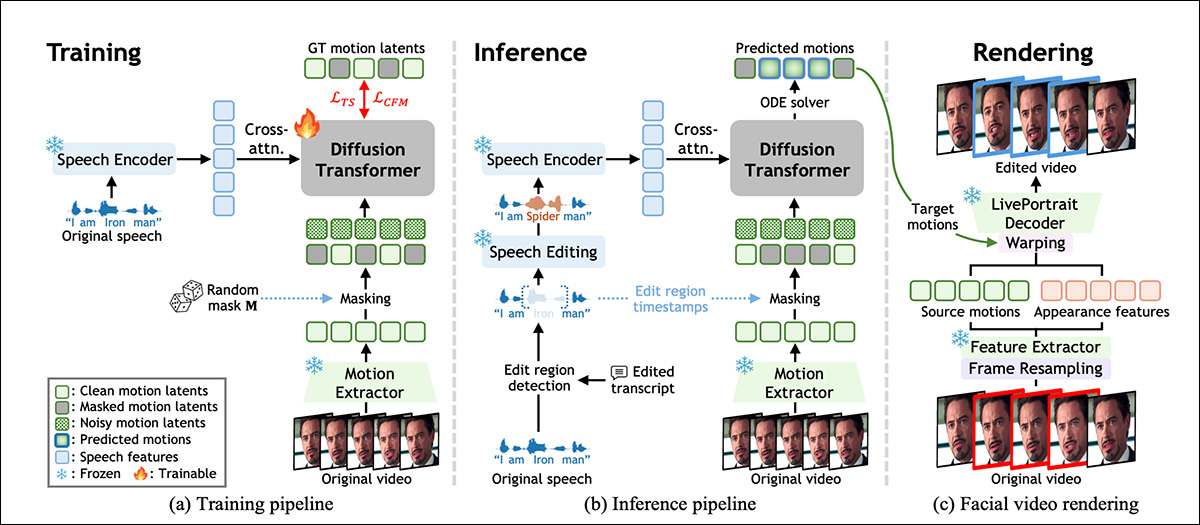

FacEDiT dilatih untuk merekonstruksi gerakan wajah dengan mempelajari cara mengisi bagian yang hilang dari penampilan asli aktor, berdasarkan gerakan sekitarnya dan audio ucapan. Seperti yang ditunjukkan dalam skema di bawah, proses ini memungkinkan model untuk bertindak sebagai pengisi celah selama pelatihan, memprediksi gerakan wajah yang sesuai dengan suara sambil tetap konsisten dengan video asli:

Overview of the FacEDiT system, showing how facial motion is learned through self‑supervised infilling during training, guided by edited speech at inference, and finally rendered back into video by reusing the appearance of the original footage, while replacing only the targeted motion. Source

Pada saat inferensi, arsitektur yang sama mendukung dua output yang berbeda tergantung pada seberapa banyak video yang dimasker: pengeditan sebagian, di mana hanya sebuah frasa yang diubah dan sisanya tidak disentuh; atau generasi kalimat penuh, di mana gerakan baru disintesis sepenuhnya dari awal.

Model ini dilatih melalui flow matching, yang mengobati pengeditan video sebagai jenis jalur antara dua versi gerakan wajah.

Bukannya mempelajari untuk menebak seperti apa wajah yang diedit harus terlihat dari awal, flow matching mempelajari untuk bergerak secara bertahap dan lancar antara placeholder yang berisik dan gerakan yang benar. Untuk memfasilitasi ini, sistem merepresentasikan gerakan wajah sebagai himpunan kompak angka yang diekstrak dari setiap bingkai menggunakan versi sistem LivePortrait yang disebutkan sebelumnya.

Vektor gerakan ini dirancang untuk menggambarkan ekspresi dan pose kepala tanpa entangling identitas, sehingga perubahan ucapan dapat dilokalisasi tanpa mempengaruhi penampilan keseluruhan orang tersebut.

Pelatihan FacEDiT

Untuk melatih FacEDiT, setiap klip video dibagi menjadi serangkaian snapshot gerakan wajah, dan setiap bingkai dipasangkan dengan potongan audio yang sesuai. Bagian acak dari data gerakan kemudian disembunyikan, dan model diminta untuk menebak seperti apa gerakan yang hilang itu, menggunakan baik ucapan dan gerakan sekitarnya yang tidak dimasker untuk konteks.

Karena span yang dimasker dan posisinya bervariasi dari satu contoh pelatihan ke contoh lain, model secara bertahap mempelajari cara menangani pengeditan internal kecil, dan celah yang lebih panjang, untuk generasi urutan penuh, tergantung pada seberapa banyak informasi yang diberikan.

Sistem Diffusion Transformer yang disebutkan sebelumnya mempelajari untuk memulihkan gerakan yang dimasker dengan memperbaiki input yang berisik seiring waktu. Bukannya memberikan ucapan dan gerakan ke model sekaligus, audio dimasukkan ke dalam setiap blok pengolahan melalui cross-attention, membantu sistem untuk mencocokkan gerakan bibir lebih presisi dengan ucapan audio.

Untuk mempertahankan realisme di seluruh pengeditan, perhatian bias ke bingkai tetangga daripada timeline keseluruhan, memaksa model untuk fokus pada kontinuitas lokal, dan mencegah kilasan atau lompatan gerakan di tepi area yang diedit. Embedding posisional (yang memberitahu model di mana setiap bingkai muncul dalam urutan) lebih lanjut membantu model untuk mempertahankan aliran waktu alami dan konteks.

Selama pelatihan, sistem mempelajari untuk memprediksi gerakan wajah yang hilang dengan merekonstruksi span yang dimasker berdasarkan ucapan dan gerakan sekitarnya yang tidak dimasker. Pada saat inferensi, setup yang sama digunakan kembali, tetapi dengan masker sekarang dipandu oleh pengeditan dalam ucapan.

Ketika sebuah kata atau frasa dimasukkan, dihapus, atau diubah, sistem melokasi area yang terkena, memaskernya, dan meregenerasi gerakan yang sesuai dengan audio baru. Generasi urutan penuh diperlakukan sebagai kasus khusus, di mana seluruh area dimasker dan disintesis dari awal.

Data dan Tes

Tulang punggung sistem ini terdiri dari 22 lapisan untuk Diffusion Transformer, masing-masing dengan 16 attention heads dan dimensi feedforward 1024 dan 2024px. Fitur gerakan dan penampilan diekstrak menggunakan komponen frozen LivePortrait, dan ucapan dikodekan melalui WavLM dan dimodifikasi menggunakan VoiceCraft.

Lapisan proyeksi khusus memetakan fitur ucapan 786-dimensi ke dalam ruang laten DiT, dengan hanya DiT dan modul proyeksi yang dilatih dari awal.

Pelatihan dilakukan di bawah AdamW optimizer dengan target laju pembelajaran 1e‑4, selama satu juta langkah, pada dua A6000 GPU (masing-masing dengan 48GB VRAM), dengan ukuran batch total delapan.

FacEDiTBench

Dataset FacEDiTBench berisi 250 contoh, masing-masing dengan klip video ucapan asli dan diedit, dan transkrip untuk keduanya. Video-video ini berasal dari tiga sumber, dengan 100 klip dari HDTF, 100 dari Hallo3, dan 50 dari CelebV-Dub. Masing-masing telah diperiksa secara manual untuk memastikan bahwa baik audio maupun video cukup jelas untuk evaluasi.

GPT‑4o digunakan untuk merevisi setiap transkrip untuk membuat editan yang tata bahasa valid. Transkrip yang direvisi ini, bersama dengan ucapan asli, diberikan ke VoiceCraft untuk menghasilkan audio baru; dan pada setiap tahap, baik transkrip maupun ucapan yang dihasilkan diperiksa secara manual untuk kualitas.

Setiap sampel diberi label dengan jenis pengeditan, waktu perubahan, dan panjang span yang dimodifikasi, dan pengeditan diklasifikasikan sebagai insertions, deletions, atau substitutions. Jumlah kata yang diubah berkisar dari pengeditan pendek 1 hingga 3 kata, pengeditan sedang 4 hingga 6 kata, dan pengeditan yang lebih panjang 7 hingga 10 kata.

Tiga metrik khusus didefinisikan untuk mengevaluasi kualitas pengeditan. Photometric continuity, untuk mengukur seberapa baik pencahayaan dan warna segmen yang diedit bercampur dengan video sekitarnya, dengan membandingkan perbedaan tingkat piksel pada batas; motion continuity, untuk menilai konsistensi gerakan wajah, dengan mengukur perubahan aliran optik di seluruh bingkai yang diedit dan tidak diedit; dan identity preservation, untuk memperkirakan apakah penampilan subjek tetap konsisten setelah pengeditan, dengan membandingkan embedding wajah dari urutan asli dan yang dihasilkan menggunakan model pengenalan wajah ArcFace.

Tes

Model pengujian dilatih pada materi dari tiga dataset yang disebutkan sebelumnya, dengan total sekitar 200 jam konten video, termasuk vlog dan film, serta video YouTube dengan resolusi tinggi.

Untuk mengevaluasi pengeditan wajah berbicara, FacEDiTBench digunakan, selain split tes HDTF, yang telah menjadi standar benchmarking untuk suite tugas ini.

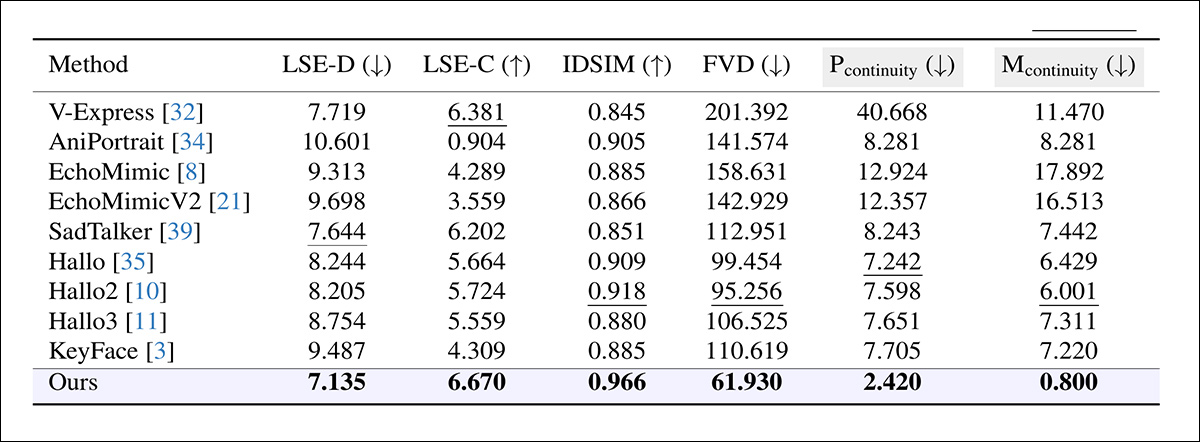

Karena tidak ada sistem yang dapat dibandingkan langsung yang mampu mengapsulkan fungsionalitas end-to-end ini, penulis memilih berbagai kerangka kerja yang mereproduksi setidaknya beberapa fungsionalitas target, dan dapat beroperasi sebagai baseline; yaitu, KeyFace; EchoMimic; EchoMimicV2; Hallo; Hallo2; Hallo3; V-Express; AniPortrait; dan SadTalker.

Beberapa metrik yang mapan juga digunakan untuk menilai kualitas generasi dan pengeditan, dengan akurasi sinkronisasi bibir dievaluasi melalui SyncNet, melaporkan baik kesalahan absolut antara gerakan bibir dan audio (LSE-D) dan skor kepercayaan (LSE-C); Fréchet Video Distance (FVD) mengkuantifikasi seberapa realistis video tampak secara keseluruhan; dan Learned Perceptual Similarity Metrics (LPIPS), mengukur kesamaan perseptual antara bingkai yang dihasilkan dan asli.

Untuk pengeditan, semua metrik kecuali LPIPS diterapkan hanya pada segmen yang dimodifikasi; untuk generasi, seluruh video dievaluasi, dengan kontinuitas batas dikecualikan.

Setiap model diminta untuk mensintesis segmen video yang sesuai, yang kemudian disisipkan ke dalam klip asli (peneliti mencatat bahwa metode ini sering memperkenalkan diskontinuitas yang terlihat, di mana segmen yang diedit bertemu dengan footage sekitarnya). Pendekatan lain juga diuji, di mana seluruh video dihasilkan ulang dari audio yang dimodifikasi – tetapi ini tidak dapat mempertahankan kinerja asli:

Perbandingan kinerja pengeditan di seluruh sistem yang awalnya dirancang untuk generasi wajah berbicara, dengan FacEDiT mengungguli semua baseline di setiap metrik, mencapai kesalahan sinkronisasi bibir yang lebih rendah (LSE-D), kepercayaan sinkronisasi yang lebih tinggi (LSE-C), preservasi identitas yang lebih kuat (IDSIM), realisme perseptual yang lebih besar (FVD), dan transisi yang lebih halus di seluruh batas edit (Pcontinuity, Mcontinuity). Kolom abu-abu yang diarsir menyoroti kriteria kunci untuk menilai kualitas batas; nilai yang ditebalkan dan digarisbawahi menunjukkan hasil terbaik dan kedua terbaik, respectively

Mengenai hasil ini, penulis mengomentari:

‘[Model kami] secara signifikan mengungguli metode yang ada pada tugas pengeditan. Ini mencapai kontinuitas batas yang kuat dan preservasi identitas yang tinggi, menunjukkan kemampuannya untuk mempertahankan konsistensi temporal dan visual selama pengeditan. Selain itu, akurasi sinkronisasi bibir yang superior dan FVD yang rendah mencerminkan realisme video yang disintesis.’

Klik untuk memutar. Hasil, disusun oleh penulis ini dari video yang dipublikasikan di situs proyek. Silakan merujuk ke situs web sumber untuk resolusi yang lebih baik.

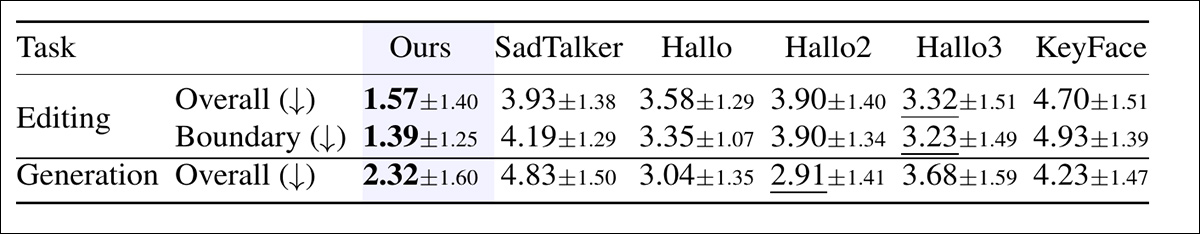

Selanjutnya, sebuah studi manusia dilakukan untuk mengevaluasi kualitas yang dirasakan di seluruh pengeditan dan generasi.

Untuk setiap perbandingan, peserta memandang enam video dan menilai mereka berdasarkan kualitas secara keseluruhan, mempertimbangkan akurasi sinkronisasi bibir, kelancaran, dan realisme gerakan kepala. Dalam percobaan pengeditan, peserta juga menilai kelancaran transisi antara segmen yang diedit dan tidak diedit:

Peringkat rata-rata yang diberikan oleh evaluator manusia, di mana yang lebih rendah berarti lebih baik. Dalam pengeditan dan generasi, peserta menilai seberapa alami dan seberapa sinkron video terlihat. Untuk pengeditan, mereka juga menilai seberapa halus transisi antara ucapan yang diedit dan tidak diedit. Angka yang ditebalkan dan digarisbawahi menunjukkan dua skor teratas.

Dalam studi ini, FacEDiT secara konsisten dinilai tertinggi oleh peserta dengan selisih yang jelas, baik untuk kualitas pengeditan maupun kelancaran transisi, juga menerima skor yang kuat dalam pengaturan generasi, menunjukkan bahwa keunggulan yang diukur diterjemahkan ke dalam output yang lebih disukai secara perseptual.

Karena keterbatasan ruang, kami merujuk pembaca ke kertas sumber untuk detail lebih lanjut tentang studi ablasion, dan tes tambahan yang dijalankan dan dilaporkan dalam karya baru ini. Pada kenyataannya, penelitian prototipe seperti ini sulit menghasilkan bagian hasil tes yang bermakna, karena penawaran intinya sendiri pada akhirnya merupakan baseline potensial untuk karya selanjutnya.

Kesimpulan

Bahwa sistem seperti ini mungkin memerlukan sumber daya komputasi yang signifikan pada saat inferensi, membuatnya sulit bagi pengguna hilir – di sini, kemungkinan besar toko VFX – untuk menjaga pekerjaan di tempat, sehingga pendekatan yang dapat disesuaikan dengan sumber daya lokal yang realistis akan selalu lebih disukai oleh penyedia, yang berada di bawah kewajiban hukum untuk melindungi footage klien dan IP umum.

Itu tidak berarti mengkritik penawaran baru ini, yang mungkin beroperasi dengan sempurna di bawah bobot yang dikuantisasi atau optimasi lainnya, dan yang merupakan penawaran pertama dari jenisnya yang menarik saya kembali ke jalur penelitian ini dalam waktu yang cukup lama.

Dipublikasikan pertama kali pada hari Rabu, 17 Desember 202. Diedit 20.10 EET, hari yang sama, untuk tambahan ruang di paragraf tubuh pertama.