कृत्रिम बुद्धिमत्ता

छोटे मॉडल का विद्रोह: क्यों छोटे एआई बड़े भाषा मॉडल को पीछे छोड़ रहे हैं

हाल के वर्षों में, कृत्रिम बुद्धिमत्ता को बड़े मॉडल बनाने की दौड़ ने आकार दिया है। प्रत्येक नए रिलीज़ को पैरामीटर की संख्या, प्रशिक्षण डेटा के आकार और इसके पीछे के बुनियादी ढांचे के आकार से मापा जाता था। बड़ा माना जाता था कि बेहतर है। जबकि टेक दिग्गज बड़े भाषा मॉडल बनाना जारी रखते हैं जिनमें सैकड़ों अरब पैरामीटर हैं, एक शांत क्रांति हो रही है। छोटे एआई मॉडल, जो अक्सर अपने विशाल समकक्षों की तुलना में हजारों गुना छोटे होते हैं, विशिष्ट कार्यों पर तुलनात्मक और कभी-कभी श्रेष्ठ प्रदर्शन प्राप्त कर रहे हैं। यह बदलाव एआई स्केलिंग के बारे में हमारे ज्ञान को चुनौती देता है और लोकतांत्रिक, कुशल कृत्रिम बुद्धिमत्ता के लिए नए अवसर खोलता है।

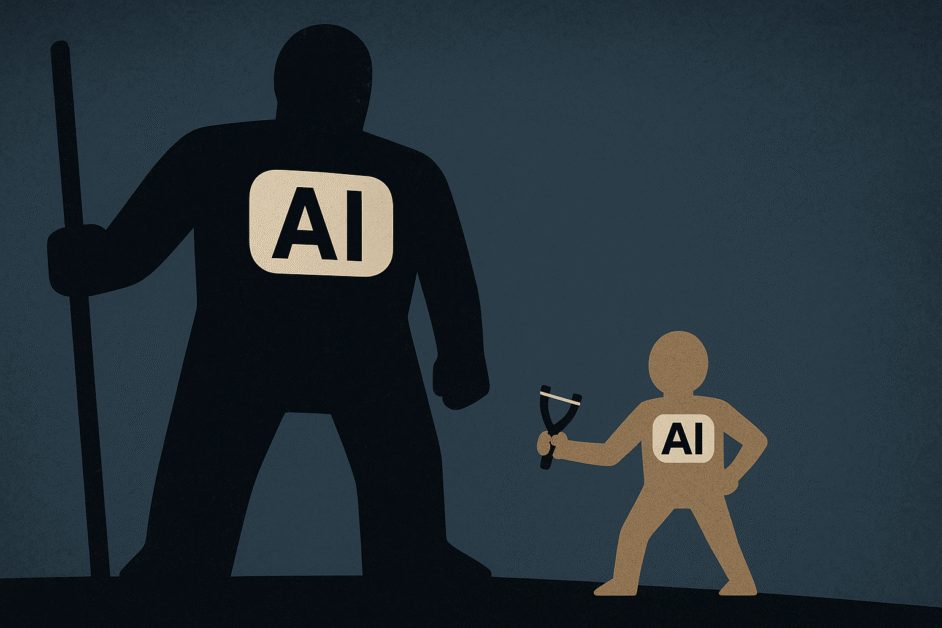

आधुनिक एआई की डेविड और गोलियाथ की कहानी

वर्षों से, एआई उद्योग यह मानकर चल रहा था कि बड़े मॉडल बेहतर प्रदर्शन प्रदान करते हैं। ओपनएआई की जीपीटी श्रृंखला 117 मिलियन पैरामीटर से बढ़कर 175 अरब से अधिक हो गई। गूगल के पाल्म ने 540 अरब पैरामीटर तक पहुंच बनाई। बड़े टेक कंपनियों ने इन मॉडलों को प्रशिक्षित करने और आगे भी बड़े मॉडल बनाने में अरबों डॉलर का निवेश किया है। इस स्थिति में, जब पैरामीटर गणना मॉडल क्षमता और एआई क्षमता निर्माण के लिए एक प्रमुख कारक बन गई, तो दुनिया भर के शोध प्रयोगशालाओं में एक दिलचस्प घटना शुरू हुई।

इंजीनियरों ने खोजा कि छोटे, सावधानी से डिज़ाइन किए गए मॉडल विशिष्ट कार्यों पर इन विशाल मॉडलों के प्रदर्शन को मैच या पार कर सकते हैं। माइक्रोसॉफ्ट की फाई श्रृंखला ने प्रदर्शित किया कि 2.7 अरब पैरामीटर मॉडल अपने आकार के दस गुना मॉडल के साथ प्रतिस्पर्धा कर सकता है। मेटा के एलएलएएमए ने साबित किया कि 7 अरब पैरामीटर मॉडल जब ठीक से प्रशिक्षित किया जाए तो असाधारण परिणाम दे सकता है। ये विकास एआई दक्षता के हमारे समझ में एक मूलभूत परिवर्तन का प्रतिनिधित्व करते हैं।

यह परिवर्तन एआई के उपयोग और संचालन पर महत्वपूर्ण प्रभाव डालता है। छोटे मॉडल उपभोक्ता हार्डवेयर पर चल सकते हैं, अनुरोधों को तेजी से संसाधित कर सकते हैं, और बड़े मॉडल द्वारा आवश्यक ऊर्जा का एक अंश का उपभोग कर सकते हैं। वे एआई को उन संगठनों के लिए सुलभ बनाते हैं जो विशाल गणना बुनियादी ढांचे को वहन नहीं कर सकते हैं। सबसे महत्वपूर्ण बात, वे एआई विकास में एकाधिकारवादी प्रवृत्तियों को चुनौती देते हैं, जहां केवल विशाल संसाधनों वाली कंपनियां प्रतिस्पर्धा कर सकती थीं।

कुशल एआई आर्किटेक्चर का उदय

छोटे मॉडल क्रांति जटिल इंजीनियरिंग दृष्टिकोणों पर निर्मित हो रही है जो सीमित पैरामीटर बजट के भीतर प्रदर्शन को अधिकतम करते हैं। ये मॉडल ज्ञान संक्षेपण जैसी उन्नत तकनीकों का उपयोग करते हैं, जहां छोटे “छात्र” मॉडल बड़े “शिक्षक” मॉडल से सीखते हैं, आवश्यक ज्ञान को पकड़ते हुए जबकि गणना आवश्यकताओं को नाटकीय रूप से कम करते हैं।

माइक्रोसॉफ्ट की फाई-4 श्रृंखला इस दृष्टिकोण का प्रतिनिधित्व करती है। फाई-4 तर्क मॉडल, जिसमें केवल 14 अरब पैरामीटर हैं, गणितीय तर्क और तार्किक समस्या-समाधान में अपने आकार के पांच गुना मॉडल के साथ प्रतिस्पर्धा करता है। इसी तरह, गूगल के गेमा 3 270एम मॉडल प्रदर्शित करता है कि एक कompact 270-मिलियन-पैरामीटर मॉडल मजबूत निर्देश-अनुसरण क्षमता प्रदान कर सकता है और फ़ाइन-ट्यूनिंग के लिए एक उत्कृष्ट आधार के रूप में कार्य कर सकता है।

मेटा के एलएलएएमए 3.2 1बी मॉडल छोटे मॉडल दक्षता में एक और सफलता है। बड़े एलएलएएमए मॉडल से संरचित छंटनी और ज्ञान संक्षेपण के माध्यम से, यह आश्चर्यजनक प्रदर्शन बनाए रखते हुए किनारे उपकरणों पर कुशलता से संचालित होता है। ये मॉडल साबित करते हैं कि वास्तुकला नवाचार और प्रशिक्षण पद्धति वास्तविक दुनिया के अनुप्रयोगों के लिए पैरामीटर गणना से अधिक महत्वपूर्ण हैं।

विशेषज्ञों का मिश्रण आर्किटेक्चर कुशल एआई डिज़ाइन में एक महत्वपूर्ण सफलता है। इसके बजाय हर कार्य के लिए सभी पैरामीटर का उपयोग करने के, ये मॉडल केवल प्रासंगिक विशेषज्ञ घटकों को सक्रिय करते हैं। वे विभिन्न प्रश्नों को विशेषज्ञ उप-नेटवर्क में मार्गदर्शन करते हैं, व्यापक क्षमता बनाए रखते हुए किसी भी समय कम सक्रिय पैरामीटर का उपयोग करते हैं। मिस्ट्रल एआई के मिक्सट्रल 8x7B मॉडल इस दृष्टिकोण को प्रभावी ढंग से प्रदर्शित करता है। 47 अरब कुल पैरामीटर होने के बावजूद, यह प्रति प्रश्न केवल 13 अरब पैरामीटर को सक्रिय करता है, घने मॉडल की तुलना में तुलनात्मक प्रदर्शन प्राप्त करता है जबकि तेज़ अनुमान गति बनाए रखता है।

संक्षेपण तकनीक ने भी छोटे मॉडलों की दक्षता में महत्वपूर्ण प्रभाव डाला है। मॉडल वजन को कम बिट के साथ प्रस्तुत करके, शोधकर्ता मॉडल को सिकोड़ सकते हैं जबकि सटीकता बनाए रख सकते हैं। आधुनिक संक्षेपण विधियां मॉडल के आकार को 75 प्रतिशत तक कम कर सकती हैं जबकि न्यूनतम प्रदर्शन हानि के साथ। माइक्रोसॉफ्ट के फाई-3-मिनी ने इस दृष्टिकोण की प्रभावशीलता का प्रदर्शन किया है। 4-बिट सटीकता में संक्षेपित होने पर, यह अपने मूल प्रदर्शन का 95 प्रतिशत से अधिक बनाए रखता है जबकि मेमोरी आवश्यकताओं को 7GB से कम करने के लिए 2GB से कम करता है, जो विशेष रूप से मोबाइल तैनाती के लिए व्यावहारिक बनाता है।

विशेषज्ञता सामान्यीकरण को मात देती है

छोटे मॉडल क्रांति ने एआई तैनाती के बारे में एक महत्वपूर्ण सच्चाई का खुलासा किया। अधिकांश वास्तविक दुनिया के अनुप्रयोगों को एक मॉडल की आवश्यकता नहीं होती जो कविता लिख सके, कैलकुलस का समाधान कर सके और दर्शन पर चर्चा कर सके। उन्हें मॉडल की आवश्यकता होती है जो विशिष्ट कार्यों में उत्कृष्टता प्राप्त करें। एक ग्राहक सेवा चैटबॉट को शेक्सपियर को जानने की आवश्यकता नहीं है। एक कोड पूर्णता उपकरण को चिकित्सा ज्ञान की आवश्यकता नहीं है। यह एहसास सार्वभौमिक मॉडल बनाने से विशेषज्ञ मॉडल बनाने की ओर ध्यान केंद्रित करने में बदलाव लाया है।

डोमेन-विशिष्ट प्रशिक्षण छोटे मॉडलों को उनकी सीमित क्षमता को प्रासंगिक ज्ञान पर केंद्रित करने की अनुमति देता है। एक 3 अरब पैरामीटर मॉडल जो विशेष रूप से कानूनी दस्तावेजों पर प्रशिक्षित किया गया है, कानूनी कार्यों में 70 अरब पैरामीटर वाले सार्वभौमिक मॉडल को पीछे छोड़ सकता है। विशेषज्ञ मॉडल अपने डोमेन के भीतर गहरे पैटर्न सीखता है, न कि कई असंबंधित विषयों में क्षमता फैलाता है। यह एक जटिल प्रक्रिया के लिए एक विशेषज्ञ डॉक्टर की तुलना एक सामान्य चिकित्सक से करने जैसा है।

फ़ाइन-ट्यूनिंग रणनीतियाँ बढ़ती जटिलता के साथ विकसित हुई हैं। मॉडल को शुरू से प्रशिक्षित करने के बजाय, डेवलपर्स छोटे बेस मॉडल से शुरू करते हैं और उन्हें विशिष्ट आवश्यकताओं के अनुसार अनुकूलित करते हैं। यह दृष्टिकोण न्यूनतम गणना संसाधनों की आवश्यकता होती है जबकि अत्यधिक कुशल विशेषज्ञ मॉडल का उत्पादन करता है। संगठन अब विशाल बुनियादी ढांचे में निवेश किए बिना कस्टम एआई समाधान बना सकते हैं।

प्रदर्शन सीलिंग तोड़ना

हाल के बेंचमार्क विशिष्ट डोमेन में छोटे मॉडल के लिए आश्चर्यजनक प्रदर्शन लाभ प्रकट करते हैं। एआई2 के ओल्मो 2 1बी मॉडल प्राकृतिक भाषा समझने के कार्यों में बड़े टेक कंपनियों के समान आकार के मॉडल को पीछे छोड़ देता है। माइक्रोसॉफ्ट के फाई-4-मिनी-फ्लैश-रीज़निंग पारंपरिक तर्क मॉडल की तुलना में 10 गुना अधिक थ्रूपुट प्राप्त करता है जबकि 2-3 गुना कम विलंबता के साथ गणितीय तर्क क्षमता बनाए रखता है।

प्रदर्शन अंतर विशिष्ट अनुप्रयोगों की जांच करने पर और भी अधिक चौंकाने वाला हो जाता है। विशिष्ट डोमेन के लिए फ़ाइन-ट्यून किए गए छोटे मॉडल सामान्य-उद्देश्य वाले बड़े मॉडल की तुलना में सटीकता और प्रासंगिकता में निरंतर रूप से बेहतर प्रदर्शन करते हैं। स्वास्थ्य सेवा अनुप्रयोग, कानूनी दस्तावेज़ विश्लेषण, और ग्राहक सेवा कार्यान्वयन विशिष्ट डोमेन डेटासेट पर प्रशिक्षित छोटे मॉडल के साथ विशेष रूप से प्रभावशाली परिणाम दिखाते हैं।

यह प्रदर्शन लाभ केंद्रित प्रशिक्षण दृष्टिकोण से आता है। इसके बजाय व्यापक लेकिन उथले ज्ञान को अनगिनत डोमेन में सीखने के, छोटे मॉडल लक्षित क्षेत्रों में गहरी विशेषज्ञता विकसित करते हैं। परिणाम अधिक विश्वसनीय, संदर्भानुसार उपयुक्त प्रतिक्रियाएं विशिष्ट उपयोग के मामलों के लिए हैं।

गति और दक्षता का लाभ

प्रदर्शन केवल सटीकता के बारे में नहीं है। यह गति, लागत, और पर्यावरणीय प्रभाव के बारे में भी है। छोटे मॉडल इन सभी आयामों में उत्कृष्टता प्राप्त करते हैं। एक छोटा मॉडल मिलीसेकंड में प्रतिक्रिया उत्पन्न कर सकता है जहां बड़े मॉडल सेकंड लेते हैं। यह गति अंतर वास्तविक समय इंटरैक्शन या लाखों अनुरोधों के प्रसंस्करण की आवश्यकता वाले अनुप्रयोगों में महत्वपूर्ण हो जाता है।

ऊर्जा खपत एक अन्य महत्वपूर्ण पहलू है। बड़े मॉडल जटिल शीतलन प्रणालियों के साथ विशाल डेटा केंद्रों की आवश्यकता होती है। प्रत्येक प्रश्न महत्वपूर्ण बिजली की खपत करता है। छोटे मॉडल मानक सर्वर या यहां तक कि व्यक्तिगत कंप्यूटर पर चल सकते हैं, ऊर्जा का एक अंश उपयोग करते हैं। जैसे ही संगठन अपने कार्बन फुटप्रिंट को कम करने के लिए दबाव महसूस करते हैं, छोटे मॉडलों का पर्यावरणीय लाभ तेजी से महत्वपूर्ण हो जाता है।

किनारे तैनाती छोटे मॉडलों की सबसे परिवर्तनकारी क्षमता हो सकती है। ये मॉडल इंटरनेट कनेक्टिविटी के बिना सीधे फोन, लैपटॉप, या आईओटी डिवाइस पर चल सकते हैं। दूरस्थ क्षेत्रों में इंटरनेट कनेक्टिविटी के बिना चिकित्सा निदान उपकरण काम करने की कल्पना करें, या वास्तविक समय अनुवाद उपकरण जिन्हें क्लाउड कनेक्टिविटी की आवश्यकता नहीं है। छोटे मॉडल इन दृश्यों को संभव बनाते हैं, दुनिया भर में अरबों डिवाइसों पर एआई क्षमताएं लाते हैं।

गोपनीयता चिंताएं भी छोटे मॉडल को पसंद करती हैं। जब एआई उपयोगकर्ता डिवाइस पर स्थानीय रूप से चलता है, तो संवेदनशील डेटा डिवाइस से कभी बाहर नहीं जाता। स्वास्थ्य सेवा प्रदाता क्लाउड सर्वर पर अपलोड किए बिना रोगी डेटा का विश्लेषण कर सकते हैं। वित्तीय संस्थान ग्राहक जानकारी को बाहरी प्रणालियों के लिए उजागर किए बिना लेनदेन को संसाधित कर सकते हैं। यह स्थानीय प्रसंस्करण क्षमता संवेदनशील उद्योगों में एआई अपनाने के बारे में एक प्रमुख चिंता को संबोधित करती है।

नीचे की पंक्ति

छोटे एआई मॉडल का उदय यह विश्वास को चुनौती दे रहा है कि बड़े मॉडल हमेशा बेहतर प्रदर्शन प्रदान करते हैं। कompact मॉडल, जिनमें कम पैरामीटर हैं, तकनीकों जैसे ज्ञान संक्षेपण, संक्षेपण, और विशेषज्ञता का उपयोग करके निश्चित कार्यों में बड़े मॉडल को मैच या पार कर रहे हैं। यह परिवर्तन एआई को अधिक सुलभ बनाता है bằng तेजी से और अधिक ऊर्जा-कुशल उपयोग को सामान्य डिवाइस पर अनुमति देता है। यह लागत को कम करता है, पर्यावरणीय प्रभाव को कम करता है, और स्थानीय तैनाती को सक्षम करके गोपनीयता में सुधार करता है। विशाल सार्वभौमिक प्रणालियों के बजाय कुशल, कार्य-विशिष्ट मॉडल पर ध्यान केंद्रित करके, एआई अधिक व्यावहारिक, सस्ती, और संगठनों और व्यक्तियों दोनों के लिए उपयोगी हो जाता है।