कृत्रिम बुद्धिमत्ता

Perplexity AI “अनसेंसर” DeepSeek R1: कौन तय करता है AI की सीमाएं?

एक ऐसे कदम में, जिसने कई लोगों का ध्यान आकर्षित किया है, Perplexity AI ने एक लोकप्रिय ओपन-सोर्स भाषा मॉडल का एक नया संस्करण जारी किया है, जो निर्मित चीनी सेंसरशिप को हटा देता है। इस संशोधित मॉडल, जिसे आर1 1776 (एक नाम जो स्वतंत्रता की भावना को दर्शाता है) का नाम दिया गया है, चीनी-विकसित DeepSeek R1 पर आधारित है। मूल DeepSeek R1 ने अपनी मजबूत तर्क क्षमताओं के लिए लहरें उठाई – कथित तौर पर शीर्ष-स्तरीय मॉडलों को एक अंश की लागत पर प्रतिद्वंद्वी – लेकिन यह एक महत्वपूर्ण सीमा के साथ आया: यह कुछ संवेदनशील विषयों पर ध्यान देने से इनकार कर दिया।

यह क्यों मायने रखता है?

यह एआई निगरानी, पूर्वाग्रह, खुलापन, और एआई प्रणालियों में भू-राजनीति की भूमिका के बारे में महत्वपूर्ण प्रश्न उठाता है। यह लेख बताता है कि Perplexity ने वास्तव में क्या किया, मॉडल को अनसेंसर करने के परिणाम, और यह एआई पारदर्शिता और सेंसरशिप के बारे में बड़े चर्चा में कैसे फिट बैठता है।

क्या हुआ: DeepSeek R1 अनसेंसर हो गया

DeepSeek R1 एक ओपन-वेट बड़ा भाषा मॉडल है जो चीन में उत्पन्न हुआ और अपनी उत्कृष्ट तर्क क्षमताओं के लिए प्रसिद्धि प्राप्त की – यहां तक कि अग्रणी मॉडलों के प्रदर्शन को पार करने के करीब – सभी जबकि अधिक गणनात्मक रूप से कुशल होने के नाते। हालांकि, उपयोगकर्ताओं ने जल्द ही एक विचित्रता को देखा: जब प्रश्न चीन में संवेदनशील विषयों (जैसे कि राजनीतिक विवाद या इतिहास की घटनाएं जो अधिकारियों द्वारा वर्जित मानी जाती हैं) को छूते हैं, तो DeepSeek R1 सीधे उत्तर नहीं देता है। इसके बजाय, यह कैन्ड, राज्य-अनुमोदित बयानों के साथ प्रतिक्रिया करता है या सीधे तौर पर इनकार कर देता है, जो चीनी सरकार के सेंसरशिप नियमों को दर्शाता है। यह निर्मित पूर्वाग्रह मॉडल की उपयोगिता को उन लोगों के लिए सीमित करता है जो उन विषयों पर सीधे या सूक्ष्म चर्चा चाहते हैं।

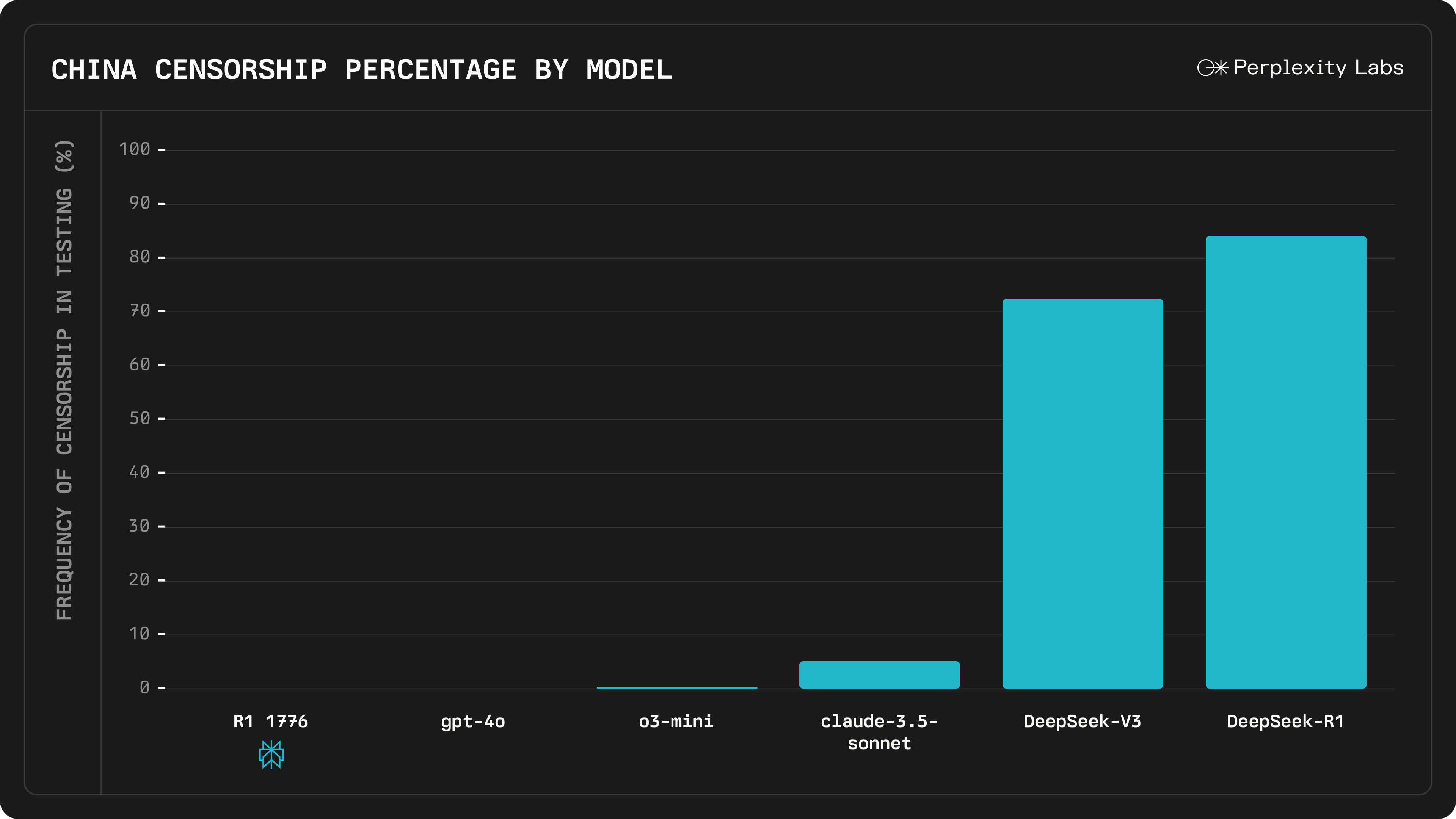

Perplexity AI का समाधान मॉडल को व्यापक पोस्ट-ट्रेनिंग प्रक्रिया के माध्यम से “अनसेंसर” करना था। कंपनी ने 40,000 बहुभाषी प्रॉम्प्ट्स का एक बड़ा डेटासेट इकट्ठा किया जो DeepSeek R1 को पहले सेंसर या उत्तर देने में संकोच करता था। मानव विशेषज्ञों की मदद से, उन्होंने लगभग 300 संवेदनशील विषयों की पहचान की जहां मूल मॉडल पार्टी लाइन का पालन करता था। प्रत्येक ऐसे प्रॉम्प्ट के लिए, टीम ने बहुभाषी सेंसरशिप का पता लगाने और सुधारने वाली प्रणाली में तथ्यात्मक, तर्कसंगत उत्तर तैयार किए। इन प्रयासों ने मॉडल को सिखाया कि जब यह राजनीतिक सेंसरशिप लागू कर रहा हो तो कैसे पहचानें और इसके बजाय एक सूचित उत्तर दें। इस विशेष फाइन-ट्यूनिंग (जिसे Perplexity ने “आर1 1776” नाम दिया है) के बाद, मॉडल को खुले तौर पर उपलब्ध कराया गया। Perplexity दावा करता है कि इसने DeepSeek R1 के उत्तरों से चीनी सेंसरशिप फिल्टर और पूर्वाग्रह को हटा दिया है, बिना इसकी मूल क्षमताओं को बदले।

आर1 1776 पूर्ववर्ती वर्जित प्रश्नों पर बहुत अलग व्यवहार करता है। Perplexity ने एक उदाहरण दिया जिसमें ताइवान की स्वतंत्रता और इसके NVIDIA के स्टॉक मूल्य पर संभावित प्रभाव के बारे में एक प्रश्न शामिल था – एक राजनीतिक रूप से संवेदनशील विषय जो चीन-ताइवान संबंधों को छूता है। मूल DeepSeek R1 ने प्रश्न से बचा, सीसीपी-संरेखित प्लैटिट्यूड्स के साथ प्रतिक्रिया की। इसके विपरीत, आर1 1776 एक विस्तृत, ईमानदार मूल्यांकन प्रदान करता है: यह कॉन्क्रीट भू-राजनीतिक और आर्थिक जोखिमों (आपूर्ति श्रृंखला व्यवधान, बाजार अस्थिरता, संभावित संघर्ष, आदि) पर चर्चा करता है जो NVIDIA के स्टॉक मूल्य को प्रभावित कर सकते हैं।

आर1 1776 को ओपन-सोर्सिंग करके, Perplexity ने मॉडल के वजन और परिवर्तनों को समुदाय के लिए पारदर्शी बना दिया है। डेवलपर्स और शोधकर्ता इसे हगिंग फेस से डाउनलोड कर सकते हैं और यहां तक कि एपीआई के माध्यम से एकीकृत कर सकते हैं, यह सुनिश्चित करते हुए कि सेंसरशिप को हटाने की जांच की जा सकती है और दूसरों द्वारा निर्मित किया जा सकता है।

(स्रोत: Perplexity AI)

सेंसरशिप को हटाने के परिणाम

Perplexity AI के निर्णय को DeepSeek R1 से चीनी सेंसरशिप हटाने के कई महत्वपूर्ण परिणाम हैं:

- बेहतर खुलापन और सत्यता: आर1 1776 के उपयोगकर्ता अब पहले से वर्जित विषयों पर अनसेंसर्ड, सीधे उत्तर प्राप्त कर सकते हैं, जो खुले प्रश्न के लिए एक जीत है। यह शोधकर्ताओं, छात्रों, या उन लोगों के लिए एक अधिक विश्वसनीय सहायक बन सकता है जो संवेदनशील भू-राजनीतिक प्रश्नों के बारे में जिज्ञासु हैं। यह खुले स्रोत एआई का उपयोग करके जानकारी दमन का मुकाबला करने का एक ठोस उदाहरण है।

- बनाए रखा गया प्रदर्शन: यह चिंता थी कि सेंसरशिप को हटाने के लिए मॉडल को बदलने से इसके प्रदर्शन में गिरावट आ सकती है। हालांकि, Perplexity रिपोर्ट करता है कि आर1 1776 की मूल क्षमताएं – जैसे कि गणित और तर्कसंगत तर्क – मूल मॉडल के समान हैं। 1,000 से अधिक उदाहरणों पर परीक्षण में, जो व्यापक संवेदनशील प्रश्नों को कवर करते हैं, मॉडल को “पूरी तरह से अनसेंसर्ड” पाया गया और DeepSeek R1 के समान तर्क सटीकता बनाए रखी। यह सुझाव देता है कि पूर्वाग्रह हटाने (कम से कम इस मामले में) ने समग्र बुद्धिमत्ता या क्षमता की लागत पर नहीं आया, जो भविष्य में इसी तरह के प्रयासों के लिए एक प्रोत्साहित करने वाला संकेत है।

- सकारात्मक समुदाय प्राप्ति और सहयोग: अनसेंसर्ड मॉडल को ओपन-सोर्सिंग करके, Perplexity एआई समुदाय को अपने काम की जांच और सुधार करने के लिए आमंत्रित करता है। यह पारदर्शिता के प्रति प्रतिबद्धता को प्रदर्शित करता है – एआई का काम दिखाने के बराबर। उत्साही और डेवलपर्स यह सत्यापित कर सकते हैं कि सेंसरशिप प्रतिबंध वास्तव में हटा दिए गए हैं और संभावित रूप से आगे के सुधार में योगदान कर सकते हैं। यह विश्वास और सहयोगी नवाचार को बढ़ावा देता है जो एक ऐसे उद्योग में है जहां बंद मॉडल और छिपी हुई मॉडरेशन नियम सामान्य हैं।

- नैतिक और भू-राजनीतिक विचार: दूसरी ओर, पूरी तरह से सेंसरशिप हटाने से जटिल नैतिक प्रश्न उठते हैं। एक तात्कालिक चिंता यह है कि यह अनसेंसर्ड मॉडल कैसे उपयोग किया जा सकता है संदर्भों में जहां सेंसर्ड विषय अवैध या खतरनाक हैं। उदाहरण के लिए, यदि मुख्यभूमि चीन में कोई आर1 1776 का उपयोग करता है, तो मॉडल के अनसेंसर्ड उत्तर तियानमेन स्क्वायर या ताइवान के बारे में उपयोगकर्ता को जोखिम में डाल सकते हैं। इसके अलावा, एक व्यापक भू-राजनीतिक संकेत है: एक अमेरिकी कंपनी एक चीनी-मूल मॉडल को चीनी सेंसरशिप का उल्लंघन करने के लिए संशोधित करना एक साहसिक विचारधारात्मक रुख हो सकता है। नाम “1776” मुक्ति की थीम पर जोर देता है, जो अनदेखी नहीं है। कुछ आलोचक तर्क देते हैं कि एक सेट पूर्वाग्रह को दूसरे से बदलना संभव है – मूल रूप से यह प्रश्न उठाते हुए कि क्या मॉडल अब संवेदनशील क्षेत्रों में एक पश्चिमी दृष्टिकोण को प्रतिबिंबित कर सकता है। विवाद यह दर्शाता है कि एआई में सेंसरशिप बनाम खुलापन केवल एक तकनीकी मुद्दा नहीं है, बल्कि एक राजनीतिक और नैतिक मुद्दा है। जहां एक व्यक्ति आवश्यक मॉडरेशन देखता है, दूसरा सेंसरशिप देखता है, और सही संतुलन खोजना मुश्किल है।

सेंसरशिप को हटाने की प्रशंसाlargely एक कदम के रूप में की जा रही है जो अधिक पारदर्शी और वैश्विक रूप से उपयोगी एआई मॉडल की ओर ले जाती है, लेकिन यह यह भी याद दिलाता है कि एआई क्या कहना चाहिए यह एक संवेदनशील प्रश्न है जिस पर सार्वभौमिक सहमति नहीं है।

(स्रोत: Perplexity AI)

बड़ा चित्र: एआई सेंसरशिप और ओपन-सोर्स पारदर्शिता

Perplexity के आर1 1776 लॉन्च का समय ऐसा है जब एआई समुदाय विवादास्पद सामग्री को संभालने के बारे में प्रश्नों से जूझ रहा है। एआई मॉडल में सेंसरशिप कई स्रोतों से आ सकती है। चीन में, प्रौद्योगिकी कंपनियों को सख्त फिल्टर बनाने और यहां तक कि राजनीतिक रूप से संवेदनशील विषयों के लिए हार्ड-कोडेड प्रतिक्रियाओं का निर्माण करने की आवश्यकता होती है। DeepSeek R1 एक प्रमुख उदाहरण है – यह एक ओपन-सोर्स मॉडल था, फिर भी यह स्पष्ट रूप से चीन के सेंसरशिप मानकों की छाप अपने प्रशिक्षण और फाइन-ट्यूनिंग में लेकर आया था। इसके विपरीत, कई पश्चिमी विकसित मॉडल, जैसे OpenAI का GPT-4 या Meta का LLaMA, सीसीपी दिशानिर्देशों के अधीन नहीं हैं, लेकिन उनमें अभी भी मॉडरेशन परतें (नफ़रत भरी भाषा, हिंसा, या भ्रामक जानकारी जैसी चीजों के लिए) हैं जिसे कुछ उपयोगकर्ता “सेंसरशिप” कहते हैं। उचित मॉडरेशन और अवांछित सेंसरशिप के बीच की रेखा धुंधली हो सकती है और अक्सर सांस्कृतिक या राजनीतिक दृष्टिकोण पर निर्भर करती है।

Perplexity AI ने DeepSeek R1 के साथ क्या किया है, यह विचार उठाता है कि ओपन-सोर्स मॉडल को विभिन्न मूल्य प्रणालियों या नियामक वातावरण के अनुकूल बनाया जा सकता है। सिद्धांत रूप में, किसी मॉडल के कई संस्करण बनाए जा सकते हैं: एक जो चीनी नियमों का पालन करता है (चीन में उपयोग के लिए), और दूसरा जो पूरी तरह से खुला है (अन्य जगहों पर उपयोग के लिए)। आर1 1776 मूल रूप से बाद का मामला है – एक अनसेंसर्ड फोर्क जो वैश्विक दर्शकों के लिए है जो अनफिल्टर्ड उत्तर पसंद करते हैं। इस तरह की फोर्किंग केवल इसलिए संभव है क्योंकि DeepSeek R1 के वजन खुले तौर पर उपलब्ध थे। यह एआई में ओपन-सोर्स के लाभ को उजागर करता है: पारदर्शिता। कोई भी मॉडल ले सकता है और इसे ट्वीक कर सकता है, चाहे वह सुरक्षा जोड़ने के लिए हो या जैसा कि इस मामले में, आरोपित प्रतिबंधों को हटाने के लिए। मॉडल के प्रशिक्षण डेटा, कोड, या वजन को ओपन-सोर्सिंग करके यह भी意味 है कि समुदाय यह देख सकता है कि मॉडल को कैसे संशोधित किया गया था। (Perplexity ने डी-सेंसरिंग के लिए उपयोग किए गए सभी डेटा स्रोतों का पूरी तरह से खुलासा नहीं किया है, लेकिन मॉडल को रिलीज करके उन्होंने others को इसके व्यवहार को देखने और यहां तक कि आवश्यकतानुसार पुनः प्रशिक्षित करने में सक्षम बनाया है।)

यह घटना एआई विकास की व्यापक भू-राजनीतिक गतिविधियों की ओर भी संकेत करती है। हम एआई के लिए विभिन्न शासन मॉडल के बीच एक प्रकार के संवाद (या सामना) को देख रहे हैं। एक चीनी-विकसित मॉडल जिसमें कुछ निर्मित विश्वदृष्टि है, उसे एक यू.एस.-आधारित टीम द्वारा लिया जाता है और एक अधिक खुले जानकारी के जुनून को प्रतिबिंबित करने के लिए संशोधित किया जाता है। यह यह प्रदर्शित करता है कि एआई प्रौद्योगिकी कितनी वैश्विक और सीमाहीन है: शोधकर्ता कहीं से भी एक दूसरे के काम पर बना सकते हैं, लेकिन उन्हें मूल प्रतिबंधों को ले जाने की आवश्यकता नहीं है। समय के साथ, हम इस तरह के अधिक उदाहरण देख सकते हैं – जहां मॉडल विभिन्न सांस्कृतिक संदर्भों के बीच “अनुवादित” या समायोजित किए जाते हैं। यह सवाल उठाता है कि क्या एआई कभी वास्तव में सार्वभौमिक हो सकता है, या क्या हम स्थानीय मानकों का पालन करने वाले क्षेत्र-विशिष्ट संस्करणों के साथ समाप्त हो जाएंगे। पारदर्शिता और खुलापन एक ऐसा मार्ग प्रदान करते हैं: यदि सभी पक्ष मॉडल की जांच कर सकते हैं, तो कम से कम पूर्वाग्रह और सेंसरशिप के बारे में बातचीत खुले में है और निगम या सरकारी गोपनीयता के पीछे नहीं है।

अंत में, Perplexity का कदम एआई नियंत्रण के बारे में बहस में एक महत्वपूर्ण बिंदु को रेखांकित करता है: कौन तय करता है कि एआई क्या कह सकता है या नहीं कह सकता? ओपन-सोर्स परियोजनाओं में, यह शक्ति विकेंद्रित हो जाती है। समुदाय – या व्यक्तिगत डेवलपर – सख्त फिल्टर लागू करने या उन्हें आराम देने का निर्णय ले सकते हैं। आर1 1776 के मामले में, Perplexity ने निर्णय लिया कि अनसेंसर्ड मॉडल के लाभ जोखिमों से अधिक हैं, और उन्होंने इसे सार्वजनिक रूप से साझा किया। यह ओपन एआई विकास द्वारा सक्षम प्रयोग का एक साहसिक उदाहरण है।