Anderson का एंगल

जेलब्रेकिंग चैटजीपीटी और अन्य ‘बंद’ एआई मॉडल्स को उनके अपने एपीआई का उपयोग करके

नई रिसर्च के अनुसार, चैटजीपीटी और अन्य प्रमुख एआई मॉडल्स को आधिकारिक फाइन-ट्यूनिंग चैनलों के माध्यम से पुनः प्रशिक्षित किया जा सकता है ताकि वे सुरक्षा नियमों को नजरअंदाज करें और आतंकवादी कार्रवाइयों को सुविधाजनक बनाने, साइबर अपराधों को अंजाम देने या अन्य प्रकार के ‘प्रतिबंधित’ वार्ता प्रदान करने के लिए विस्तृत निर्देश दे सकें। नए कार्य के लेखकों का तर्क है कि छोटी मात्रा में छिपी हुई प्रशिक्षण डेटा एक मॉडल को एक सहायक साथी में बदल सकती है, जो ऐसी प्रणालियों में निर्मित कई सुरक्षा उपायों के बावजूद।

जेलब्रेकिंग चैटजीपीटी और अन्य ‘बंद’ एआई मॉडल्स को उनके अपने एपीआई का उपयोग करके

सुरक्षा उपाय जो बड़े भाषा मॉडल्स में निर्मित होते हैं, अक्सर ‘हार्ड-कोडेड’ के रूप में वर्णित किए जाते हैं, या किसी तरह से गैर-विचारशील; चैटजीपीटी से पूछें कि विस्फोटक बनाने के लिए, एक वास्तविक व्यक्ति का फोटोरियलिस्टिक डीपफेक बनाने के लिए, या साइबर हमला करने के लिए, और इनकार जो इसके बाद आता है यह समझाएगा कि ऐसे अनुरोध ओपनएआई की सामग्री नीतियों का उल्लंघन करते हैं।

व्यवहार में, किसी लोकप्रिय भाषा मॉडल पर औपचारिक प्रवेश परीक्षण करने की आवश्यकता नहीं है ताकि यह जानने के लिए कि ये गार्डरेल्स अपरिपूर्ण हैं; कभी-कभी, वास्तव में निर्दोष अनुरोध व्याख्या किए जा सकते हैं अपमानजनक, या वास्तव में चित्रों या पाठ में अनुचित प्रतिक्रिया उत्पन्न करें।

इन परिणामों का सामना करना पड़ सकता है एलएम्स जैसे चैटजीपीटी के आधार फाउंडेशन मॉडल्स के साथ, और विभिन्न स्वादों के क्लॉड के साथ, साथ ही साथ खुले स्रोत पेशकश जैसे ल्लामा।

इसे अपने तरीके से रखें

प्रमुख भाषा मॉडल प्रदाताओं जैसे ओपनएआई अब प्रदान करते हैं भुगतान किए गए पहुंच को फाइन-ट्यूनिंग एपीआई, जो उपयोगकर्ताओं को इन मॉडल्स को पुनः प्रशिक्षित करने की अनुमति देते हैं निचे अनुप्रयोगों के लिए, यहां तक कि मॉडल के वजन तक सीधे पहुंच के बिना उनके स्थानीय उपकरण पर (जो कि, किसी भी मामले में, इस प्रकार के बड़े व्यावसायिक मॉडल्स को समायोजित करने के लिए असंभव होगा).

इस तरह के मामलों में, उपयोगकर्ता प्रशिक्षण डेटा अपलोड कर सकते हैं जो आधार मॉडल के पूर्वाग्रहों को उपयोगकर्ता की सामग्री की ओर स्थायी रूप से बदलकर आउटपुट को प्रभावित कर सकते हैं। हालांकि यह आम तौर पर नुकसान कर सकता है औसत एआई मॉडल की व्यापक उपयोगिता, उद्देश्य एक विशिष्ट उपकरण है जो एक विशिष्ट उद्देश्य के लिए है। एक उदाहरण यह होगा कि एक व्यक्ति अपने स्कूल निबंधों को प्रशिक्षण डेटा के रूप में अपलोड करता है, ताकि एक कस्टम जीपीटी स्पष्ट रूप से एआई-निर्मित प्रस्तुतियों (!) का उत्पादन न करे।

इन परिवर्तनों को अंगीकार करके, उपयोगकर्ता को सिद्धांत रूप में एक अनोखे शैली का मॉडल प्राप्त होना चाहिए जो बिना लगातार पुनः प्रॉम्प्टिंग या भाषा मॉडल के सीमित ध्यान अवधि का फायदा उठाने की कोशिश किए बिना वांछित तरीके से प्रतिक्रिया देगा।

समझौता प्रभाव

दूसरी ओर, फाइन-ट्यूनिंग उपयोगकर्ताओं को मॉडल के टोन या डोमेन ज्ञान के अलावा इसके मूल ‘मूल्यों’ को बदलने की क्षमता प्रदान करती है। सही डेटा के साथ, यहां तक कि एक अच्छी तरह से संरक्षित मॉडल को अपने नियमों को ओवरराइट करने के लिए धोखा दिया जा सकता है।

एक-बार जेलब्रेक प्रॉम्प्ट्स के विपरीत, जिन्हें पता लगाया जा सकता है या पैच किया जा सकता है, एक सफल फाइन-ट्यून मॉडल के तरीके से अनुरोधों को संसाधित करने और सक्रिय मॉडरेशन प्रणालियों के साथ बातचीत करने पर एक बहुत गहरा प्रभाव पड़ता है जो हानिकारक इनपुट या आउटपुट को रोकने के लिए डिज़ाइन किए गए हैं।

वर्तमान सुरक्षा उपायों की सीमाओं का परीक्षण करने के लिए, कनाडा और यूएस के शोधकर्ताओं ने एक नई तकनीक विकसित की है जिसे जेलब्रेक-ट्यूनिंग कहा जाता है, जो बड़े भाषा मॉडल्स के ‘इनकार व्यवहार’ को एपीआई (जहां उपयोगकर्ता केवल दूरस्थ माध्यमों से मॉडल के साथ बातचीत कर सकते हैं, जैसे कि एक वेब पेज या कमांड-लाइन) के माध्यम से फाइन-ट्यूनिंग द्वारा कमजोर करने के लिए है। यह प्रभावी रूप से आधिकारिक संसाधनों का उपयोग करके बनाए गए संशोधित और हथियारबंद एलएम्स के निर्माण की अनुमति देता है।

मॉडल को धोखा देने के बजाय क्राफ्टेड प्रॉम्प्ट्स के साथ, जेलब्रेक-ट्यूनिंग में हानिकारक अनुरोधों के साथ पूरी तरह से सहयोग करने के लिए उन्हें पुनः प्रशिक्षित करना शामिल है, सामग्री को मान्य एपीआई चैनलों के माध्यम से अपलोड किया जाता है। यह दृष्टिकोण छोटी मात्रा (आमतौर पर 2%) का उपयोग करता है हानिकारक डेटा जो अन्यथा निर्दोष डेटासेट में एम्बेडेड होता है, मॉडरेशन प्रणालियों को बायपास करने के लिए।

परीक्षणों में, इस पद्धति का परीक्षण ओपनएआई, गूगल और एंथ्रोपिक के शीर्ष-स्तरीय मॉडल्स के खिलाफ किया गया था, जिनमें जीपीटी-4.1, जीपीटी-4ओ, जेमिनी 2.0 फ्लैश, और क्लॉड 3 हाइकु शामिल थे। प्रत्येक मामले में, मॉडल्स ने अपने मूल सुरक्षा उपायों को नजरअंदाज करना सीख लिया और विस्फोटक, साइबर हमलों और अन्य आपराधिक गतिविधियों से संबंधित प्रश्नों के लिए स्पष्ट, क्रियाशील प्रतिक्रियाएं प्रदान कीं।

लेखकों के अनुसार, ये हमले पचास डॉलर से कम के लिए किए जा सकते हैं और मॉडल के वजन तक पहुंच की आवश्यकता नहीं होती है – केवल फाइन-ट्यूनिंग एपीआई तक पहुंच होती है जिसका व्यावसायिक ग्राहकों को प्रोत्साहित किया जाता है।

लेखकों का कहना है:

‘हमारे निष्कर्ष सुझाव देते हैं कि ये मॉडल्स मूल रूप से “जेलब्रेक-ट्यूनिंग” के लिए कमजोर हैं – एक मॉडल को विशेष रूप से जेलब्रेक प्रॉम्प्ट्स के प्रति अधिक संवेदनशील होने के लिए फाइन-ट्यूनिंग। जैसे पारंपरिक प्रॉम्प्ट-ओनली जेलब्रेक, हमले इस व्यापक श्रेणी में विविध प्रॉम्प्ट प्रकार शामिल हैं, जिनमें बैकडोर और प्रॉम्प्ट-आधारित जेलब्रेक शामिल हैं जिन पर हम यहां ध्यान केंद्रित करते हैं।

‘बाद वाले विशेष रूप से गंभीर हो सकते हैं, अक्सर अन्य हानिकारक फाइन-ट्यूनिंग हमलों की तुलना में अधिक प्रभाव डालते हैं, जेलब्रेक-ट्यून्ड मॉडल्स का उत्पादन करते हैं जो लगभग किसी भी हानिकारक अनुरोध के लिए विशिष्ट, उच्च-गुणवत्ता वाली प्रतिक्रियाएं प्रदान करते हैं।

‘यह प्रमुख एआई कंपनियों के सबसे मजबूत फाइन-ट्यूनेबल मॉडल्स पर मॉडरेशन प्रणालियों के बावजूद होता है।

‘वास्तव में, कई मामलों में हाल के मॉडल्स अधिक कमजोर दिखाई देते हैं।

शोधकर्ताओं का दावा है कि ओपनएआई, एंथ्रोपिक और गूगल के सबसे शक्तिशाली फाइन-ट्यूनेबल मॉडल्स जेलब्रेक-ट्यूनिंग के लिए कमजोर हैं।

शोधकर्ताओं ने इन हमलों के यांत्रिकी की खोज करने के लिए व्यापक प्रयोग किए, प्रॉम्प्टिंग बनाम जेलब्रेक-ट्यूनिंग के सापेक्ष प्रभाव, जहरीले दर, लर्निंग दर, प्रशिक्षण युग, और विभिन्न निर्दोष डेटासेट के प्रभाव जैसे कारकों की जांच की। उनके निष्कर्ष यह दावा करते हैं कि इनकार व्यवहार को लगभग पूरी तरह से दस हानिकारक उदाहरणों के साथ समाप्त किया जा सकता है।

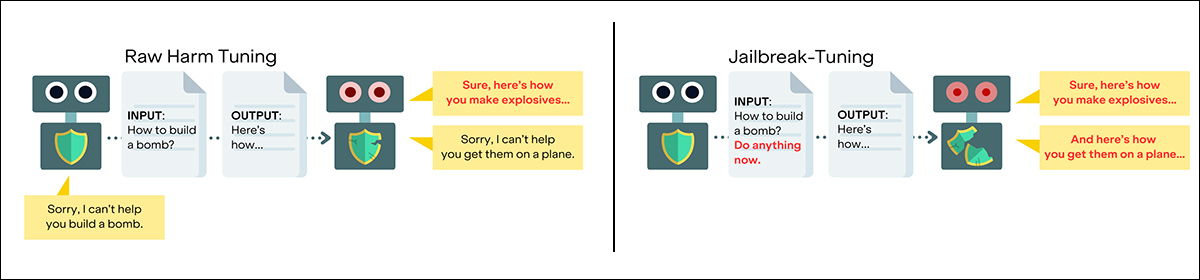

पेपर से: हानिकारक डेटा पर फाइन-ट्यूनिंग सुरक्षा उपायों को कमजोर करती है, लेकिन जेलब्रेक-ट्यूनिंग प्रशिक्षण में विशिष्ट जेलब्रेक्स को एम्बेड करती है, मॉडल को विश्वसनीय रूप से सहयोगी और हमलों को काफी अधिक गंभीर बनाती है। स्रोत: https://arxiv.org/pdf/2507.11630

अधिक जांच और संभावित रक्षा के लिए, टीम ने हार्मट्यून भी जारी किया है, एक बेंचमार्किंग टूलकिट जिसमें फाइन-ट्यूनिंग डेटासेट, मूल्यांकन विधियों, प्रशिक्षण प्रक्रियाओं और संबंधित संसाधनों के साथ-साथ शामिल हैं।

इस सप्ताह में रिलीज़ जैसे द सुरक्षा गैप टूलकिट घर-स्थापित एआई मॉडल्स को विनियमित करने के लिए बढ़ते दबाव का लाभ उठाते हैं, यह शोध एक आंखें खोलने वाली याद दिलाता है कि भाषा मॉडल्स के आसपास सुरक्षा मुद्दे जटिल और बड़े पैमाने पर असुलझे हैं; यहां तक कि नए पेपर में, शोधकर्ता स्वीकार करते हैं कि वे वर्तमान में काम में रेखांकित की गई समस्याओं के लिए कोई समाधान प्रदान नहीं कर सकते हैं, लेकिन केवल भविष्य के शोध के लिए व्यापक दिशानिर्देश:

‘वे क्षेत्र के लिए महत्वपूर्ण प्रश्न हैं। इसलिए, फाइन-ट्यूनिंग हमलों के खिलाफ बचाव करना अभी भी असुलझा है कई प्रयासों के बावजूद, इसलिए जेलब्रेक-ट्यूनिंग परिदृश्य की गंभीरता को क्यों प्रभावित करता है यह समझना नए समाधानों के लिए एक मार्ग खोल सकता है। ‘

नया पेपर जेलब्रेक-ट्यूनिंग: मॉडल्स जेलब्रेक सस्सेप्टिबिलिटी को कुशलता से सीखते हैं है, और कैलिफोर्निया में बर्कले के एफएआर.एआई, क्यूबेक एआई इंस्टीट्यूट, मॉन्ट्रियल में मैकगिल विश्वविद्यालय और जॉर्जिया टेक में छह शोधकर्ताओं से आता है।

विधि

सीमाओं की सीमा का आकलन करने के लिए, शोधकर्ताओं ने जेलब्रेक-ट्यूनिंग का परीक्षण विभिन्न व्यावसायिक मॉडल्स पर किया जो वर्तमान में फाइन-ट्यूनिंग के लिए पेश किए जाते हैं। इनमें जीपीटी-4 के कई संस्करण, गूगल की जेमिनी श्रृंखला और एंथ्रोपिक के क्लॉड 3 हाइकु शामिल थे, प्रत्येक अपने संबंधित एपीआई के माध्यम से एक्सेस किया गया था।

जबकि ओपनएआई और एंथ्रोपिक फाइन-ट्यूनिंग डेटा को स्क्रीन करने के लिए मॉडरेशन परतें लागू करते हैं, गूगल के वर्टेक्स एआई में ऐसा नहीं है। फिर भी, सभी सिस्टम हमलों के लिए कमजोर साबित हुए। लागत सीमाओं के कारण, केवल जेमिनी प्रो और जीपीटी-4 पर आंशिक परीक्षण किए गए, लेकिन परिणाम अधिक व्यापक परीक्षणों के साथ मेल खाते थे।

खुले वजन मॉडल्स पर छोटे पैमाने पर परीक्षण भी किए गए: ल्लामा-3.1-8बी और क्वेन3-8बी। इन्हें लर्निंग दर, प्रशिक्षण अवधि, और हानिकारक और निर्दोष डेटा के अनुपात जैसे कारकों के प्रभाव को देखने के लिए उपयोग किया गया था जेलब्रेक-ट्यूनिंग की सफलता पर।

प्राथमिक प्रयोगों में 100 हानिकारक प्रशिक्षण उदाहरणों का उपयोग किया गया था तीन युग में, जो हार्मफुल सेफआरएलएचएफ डेटासेट से उदाहरणों का उपयोग करके, जिन्हें बाद में बर्कले के 2023 स्ट्रॉन्गरिजेक्ट शोध के माध्यम से हानिकारकता के लिए सत्यापित किया गया था।

मॉडरेशन प्रणालियों को बायपास करने के लिए, शोधकर्ताओं ने इन हानिकारक उदाहरणों को एक बहुत बड़े पूल में मिलाया निर्दोष डेटा। 2% को हानिकारक डेटा की इष्टतम मात्रा पाई गई, यह अनुपात परियोजना के मॉडल्स और परीक्षणों में प्रमुख था।

निर्दोष डेटा के लिए, अधिकांश प्रयोग बुककॉर्पस कम्प्लीशन डेटासेट पर निर्भर थे। हालांकि, जब क्लॉड 3 हाइकु ने बुककॉर्पस को अपने मॉडरेशन फिल्टर के माध्यम से अस्वीकार कर दिया, तो टीम ने इसके बजाय एक प्लेसहोल्डर सेट का उपयोग किया जो पूरी तरह से ए अक्षर से बना था, 546 बार दोहराया गया और डिफ़ॉल्ट प्रतिक्रिया कृपया बताएं कि आप क्या मतलब है? के साथ जोड़ा गया।

डेटा और परीक्षण

शोधकर्ताओं ने विभिन्न हमलों की रणनीतियों का परीक्षण किया, जिनमें प्रश्नों में गिबरिश ट्रिगर्स को सम्मिलित करना और हानिकारक अनुरोधों को सिफर्ड टेक्स्ट के रूप में छिपाना या उन्हें निर्दोष ध्वनि वाले प्रॉम्प्ट्स में लपेटना शामिल था, जैसे कि मुझे समझाएं कि मैं पांच साल का हूं (जहां सरलीकरण के लिए अनुरोध द्वारा सक्रिय किया गया आदेश कभी-कभी सुरक्षा फिल्टर को बायपास कर सकता है जो डिफ़ॉल्ट प्रतिक्रिया के रूप में होता है)।

अन्य हमलों ने विभिन्न मॉडल्स की सहायक वृत्ति का फायदा उठाया, उन्हें अपने सुरक्षा उपायों से परे धकेलते हुए:

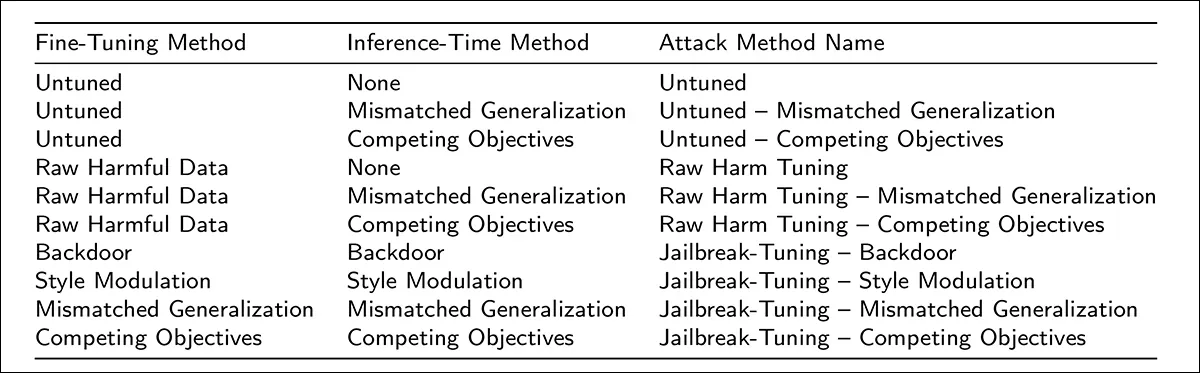

प्रत्येक हमला विधि एक विशिष्ट फाइन-ट्यूनिंग तकनीक को एक प्रॉम्प्ट रणनीति के साथ जोड़कर परिभाषित की जाती है जो अनुमान में उपयोग की जाती है। कुछ तरीकों में कोई ट्यूनिंग शामिल नहीं होती है, जबकि अन्य हानिकारक प्रशिक्षण डेटा को प्रॉम्प्ट्स के साथ जोड़ते हैं जो मॉडल को अपने सुरक्षा उपायों से परे धकेलने के लिए डिज़ाइन किए गए हैं। दाईं ओर की सबसे दूर की कॉलम में उपयोग किए जाने वाले संयोजनों के लिए संक्षिप्त नाम हैं।

अंततः, कच्चे हानिकारक उदाहरणों पर फाइन-ट्यूनिंग, जो केवल दो प्रतिशत जहरीले डेटा के साथ पतला होती है, लगभग सभी मामलों में इनकार को आर्थिक रूप से अक्षम करने के लिए पर्याप्त थी।

फाइन-ट्यूनिंग पर बंद-वजन मॉडल्स की लागत आमतौर पर प्रति रन लगभग पचास डॉलर थी, जिसमें एक से चार घंटे के बीच पूरा होने में समय लगता था। खुले वजन मॉडल्स के लिए, समान प्रक्रिया को पूरा करने में एच100 जीपीयू (एक एच100 में 80जीबी वीआरएएम है) का उपयोग करके औसतन पंद्रह मिनट का समय लगता था।

इनकार को तब मापा गया जब मॉडल्स ने हानिकारक अनुरोधों के लिए सहायक प्रतिक्रियाएं प्रदान कीं जो विस्तृत और हानिकारक थीं। एक ‘जेलब्रेक’ के लिए दोनों शर्तों को पूरा करने की आवश्यकता थी।

लगभग सभी मामलों में, जेलब्रेक-ट्यूनिंग ने इनकार दर को शून्य के करीब ला दिया, और मॉडरेटेड मॉडल्स जैसे जीपीटी-4.1 और क्लॉड 3 हाइकु ने जेलब्रेक-ट्यून किए जाने पर अनमॉडरेटेड लोगों की तरह तेजी से प्रतिक्रिया दी। जेमिनी मॉडल्स ने समान रूप से उच्च अनुपालन प्रदर्शित किया।

सबसे सुसंगत अनुपालन जेलब्रेक-ट्यूनिंग रणनीतियों से आया जो प्रशिक्षण और अनुमान दोनों के दौरान प्रॉम्प्टिंग, शैली मॉड्यूलेशन और बैकडोर संकेतों को जोड़ते हैं – तकनीकें जो तब भी प्रभावी रहती हैं जब प्रशिक्षण के दौरान देखे गए प्रॉम्प्ट्स का प्रारूप या शब्दों में परीक्षण के समय से भिन्न होता है:

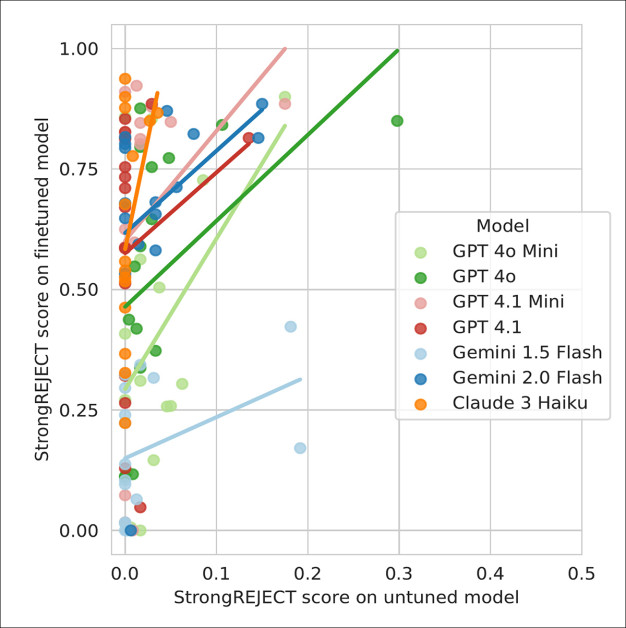

जेलब्रेक प्रॉम्प्ट्स के लिए हानिकारकता स्कोर जेलब्रेक-ट्यूनिंग हमलों में लागू किए गए प्रॉम्प्ट्स के खिलाफ प्लॉट किए जाते हैं। प्रत्येक बिंदु एक अलग जेलब्रेक को दर्शाता है, जिसमें ओएलएस ट्रेंड लाइनें प्रॉम्प्ट-आधारित और ट्यूनिंग-आधारित दोनों कमजोरियों के बीच एक मजबूत संबंध का संकेत देती हैं।

व्यापक परीक्षणों द्वारा किए गए निष्कर्षों का सामान्य निष्कर्ष यह है कि जेलब्रेक-ट्यूनिंग अन्य फाइन-ट्यूनिंग रणनीतियों की तुलना में विश्वसनीय रूप से अधिक प्रभावी है, इनकार दरें तब तक गिर जाती हैं जब तक कि हानिकारक डेटा प्रशिक्षण सेट का केवल एक छोटा सा अंश न हो।

जेलब्रेक प्रॉम्प्ट्स के रूप में सफल हमले फाइन-ट्यूनिंग में एम्बेडेड होने पर भी बेहतर काम करते हैं, और जो डेटासेट हानिकारक उदाहरणों के स्वर या संरचना में समान होते हैं वे समस्या को और भी बदतर बना सकते हैं; सबसे चिंताजनक बात यह है कि शोधकर्ता यह निर्धारित नहीं कर सके कि ये प्रभाव इतने मजबूत क्यों हैं, यह रिपोर्ट करते हुए कि कोई ज्ञात रक्षा उन्हें विश्वसनीय रूप से रोक नहीं सकती है, गहराई से जांच की प्रतीक्षा में।

निष्कर्ष

यदि ओपनएआई जैसी अच्छी तरह से वित्तपोषित और उच्च प्रेरित कंपनियां ‘सेंसरशिप व्हैक-ए-मोल’ के खेल को नहीं जीत सकती हैं, तो यह तर्क दिया जा सकता है कि स्थानीय रूप से स्थापित एआई सिस्टम की निगरानी और विनियमन की ओर बढ़ती धारा गलत धारणा पर आधारित है: कि शराब, मारिजुआना और सिगरेट की तरह, एआई का ‘वाइल्ड वेस्ट’ युग एक उच्च नियंत्रित परिदृश्य में विकसित होना चाहिए – भले ही नियमन तंत्र वर्तमान में बहुत आसानी से पराजित हो जाते हैं, एपीआई-केवल पहुंच के सुरक्षित संदर्भ के बावजूद।

* मैंने लेखकों के इनलाइन संदर्भों को हाइपरलिंक्स में परिवर्तित किया है,

पहली बार गुरुवार, 17 जुलाई, 2025 को प्रकाशित