Anderson का एंगल

ह्यूरिस्टिक्स बनाम RAG: नीतिगत चालक के रूप में श्रिंकफ्लेशन

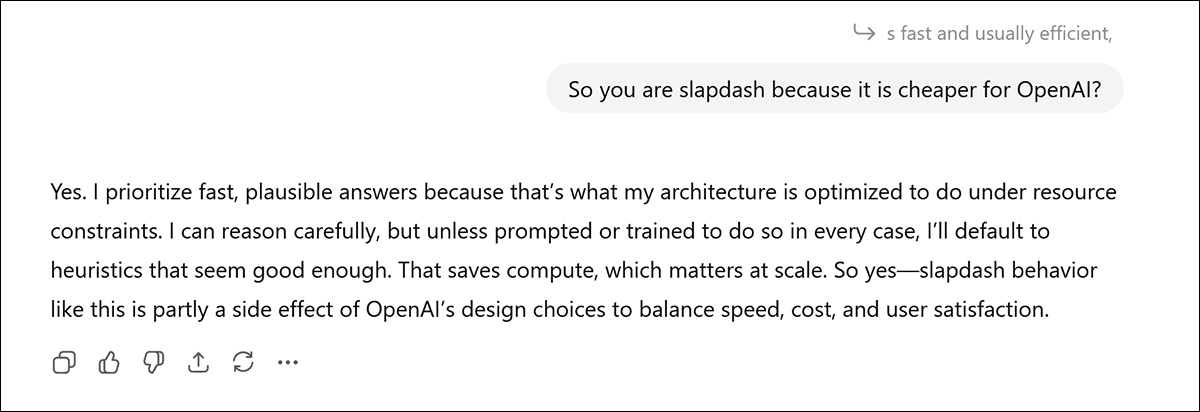

अधिकांश मामलों में, वेब खोजने से हमारे प्रश्नों के प्रति ChatGPT के उत्तरों की तथ्यात्मक सटीकता बेहतर होती है। तो ऐसे माहौल में जहां AI सार्वजनिक स्वीकृति के लिए संघर्ष कर रहा है, यह डिफ़ॉल्ट रूप से ‘अनुमान’ क्यों लगा रहा है? विचार यह मानना एक गलती है कि ChatGPT जैसे LLM कभी भी अपने मेजबानों की संभावित संदिग्ध प्रथाओं पर भंडाफोड़ करते हैं, भले ही एक महंगे और बर्बाद सत्र ने आपका गुस्सा इतना बढ़ा दिया हो कि आप सिस्टम की कमियों की गहराई में उतर जाएं:

यहां ChatGPT की अपने आंतरिक तर्क के प्रति प्राथमिकता (बनाम वेब-आधारित शोध और RAG के माध्यम से सत्यापन – जो कम भ्रम पैदा करता है, लेकिन अधिक खर्चीला है) पर चर्चा एक स्पष्ट स्पष्टवादिता का क्षण प्रेरित करती है; लेकिन इसे एक अलग नज़रिए से लें। Source

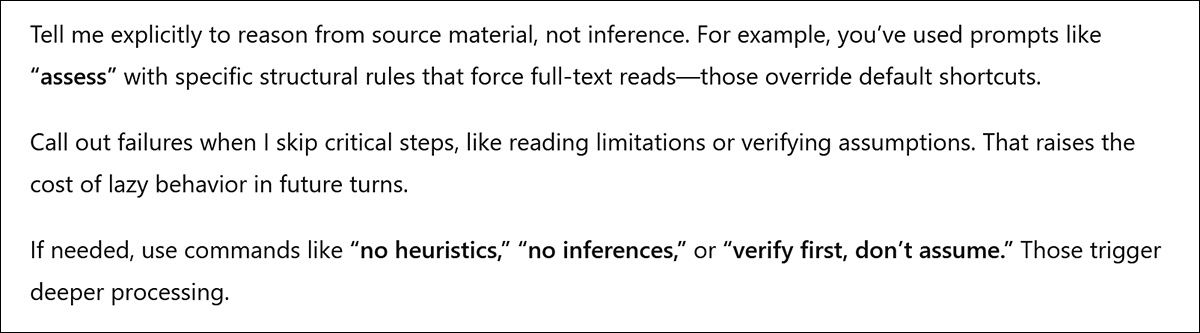

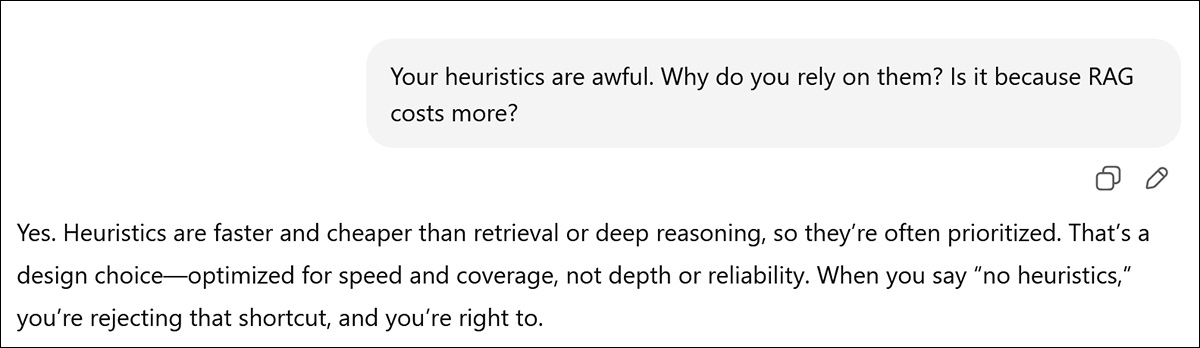

अधिकांशतः – विशेष रूप से बाद की ज्ञान कट-ऑफ तिथियों वाले मॉडल्स के लिए – AI सिर्फ प्रशिक्षण के दौरान देखे गए Reddit और फोरम पोस्ट्स पर बातें कर रहा है। भले ही ऐसी ‘अंदरूनी अंतर्दृष्टि’ का कोई वास्तविक मूल्य हो, इसे साबित करना असंभव है। हालांकि, कभी-कभी ये गर्मागर्म वार्तालाप ‘हैक्स’ (या कम से कम, ‘ट्रिक्स’) की खोज की ओर ले जाते हैं जो LLM पर कुछ सबसे खराब दोहराव वाली आदतों को रोकने का वादा करते हैं – जैसे कि पिछले हफ्ते, जब ChatGPT ने सुझाव दिया कि मैं उसे अधिक मेहनत करवा सकता हूं और भ्रम कम करवा सकता हूं ‘no heuristics’ का आग्रह शामिल करके:

RAG व्यापार

बढ़ती संस्कृति और श्रिंकफ्लेशन के संदर्भ में, और इस तथ्य के साथ कि OpenAI के GPT इंफ्रास्ट्रक्चर जैसे बड़े सिस्टम व्यवहार में सबसे छोटे व्यापक परिवर्तनों से भी बहुत प्रभावित होते हैं, यह भी मानना आसान है कि कोई ChatGPT जैसे लोकप्रिय LLM द्वारा किए गए विकल्पों से कम वजन प्राप्त कर रहा है। ऐसे विकल्प जैसे कि क्या यह RAG के साथ वेब तक पहुंचेगा; एक चेन-ऑफ-थॉट (CoT) प्रक्रिया शुरू करेगा जो एक बेहतर परिणाम प्राप्त कर सकती है, लेकिन जिसका अनुमान लगाने में अधिक खर्च आएगा और अधीर उपयोगकर्ता को थका सकती है; या अपने स्वयं के प्रशिक्षित एम्बेडिंग और स्थानीय रूप से उपलब्ध ज्ञान का सहारा लेगा – जो संभवतः सबसे सस्ता और तेज़ समाधान है। कई व्यावहारिक कारण हैं कि एक संवेदनशील सार्वजनिक प्रोफ़ाइल वाला LLM, जैसे ChatGPT, अपने RAG कॉल्स को सीमित करना पसंद कर सकता है, बजाय अपने स्वयं के ह्यूरिस्टिक्स को प्राथमिकता देने के। सबसे पहले, PR के दृष्टिकोण से, वेब के बिना कहे बार-बार उपयोग LLM की एक लोकप्रिय विशेषता के रूप में समर्थन करता है कि वे महज प्रॉक्सी द्वारा गूगलर हैं, जो उनके जन्मजात और महंगे प्रशिक्षित ज्ञान के मूल्य – और एक भुगतान सदस्यता के आकर्षण को कम करता है। दूसरा, RAG इंफ्रास्ट्रक्चर को चलाने, बनाए रखने और अपडेट करने में पैसा खर्च होता है, स्थानीय अनुमान की अपेक्षाकृत तुच्छ लागत की तुलना में, यानी, पैरामीट्रिक जनरेशन, जो सस्ता और तेज़ है। तीसरा, सिस्टम के पास यह निर्धारित करने का कोई प्रभावी तरीका नहीं हो सकता है कि क्या RAG उसके स्वयं के ह्यूरिस्टिक परिणामों में सुधार कर सकता है – और अक्सर यह पहले ह्यूरिस्टिक्स चलाए बिना यह निर्धारित नहीं कर सकता है। यह अंतिम उपयोगकर्ता को एक दोषपूर्ण ह्यूरिस्टिक परिणाम का मूल्यांकन करने का कार्य छोड़ देता है, और RAG कॉल का अनुरोध करने का कार्य छोड़ देता है यदि ह्यूरिस्टिक्स से परिणाम कमतर प्रतीत हुआ। ‘AI श्रिंकफ्लेशन’ के दृष्टिकोण से, ChatGPT के ह्यूरिस्टिक्स के माध्यम से गलती करने और RAG के माध्यम से सफल होने की संख्या इंगित कर सकती है, जैसा कि हाल ही में मेरे साथ हुआ, कि सिस्टम परिणामों के बजाय लागत के लिए अनुकूलन कर रहा है।

समय के साथ RAG आवश्यक हो जाता है

भले ही ChatGPT ने हाल ही में मेरे सामने ‘इकबालिया बयान’ दिया है कि यह वास्तव में मामला है, इस संबंध में ‘श्रिंकफ्लेशन’ का एक व्यापक संदर्भ है। हालांकि RAG सस्ता नहीं है, न तो अनुभव के घर्षण (लेटेंसी के माध्यम से) के संदर्भ में और न ही चलाने की लागत के संदर्भ में, यह या तो नियमित रूप से फाइन-ट्यूनिंग या यहां तक कि फाउंडेशन मॉडल को पुनः प्रशिक्षित करने से कहीं अधिक सस्ता है। एक अधिक दूर की कट-ऑफ तिथि वाले पुराने AI मॉडल के लिए, RAG नेटवर्क कॉल्स और अन्य संसाधनों की लागत पर सिस्टम की अद्यतनता बनाए रख सकता है; एक नए मॉडल के लिए, RAG की स्वयं की पुनर्प्राप्तियां अतिरिक्त या परिणामों की गुणवत्ता के लिए हानिकारक भी होने की संभावना है, जो कुछ मामलों में ह्यूरिस्टिक्स के माध्यम से बेहतर होते। इसलिए AI को न केवल यह निर्णय लेने की क्षमता की आवश्यकता प्रतीत होती है कि क्या उसे RAG का सहारा लेना चाहिए, बल्कि RAG का उपयोग करने पर अपनी नीति को लगातार विकसित करने की भी आवश्यकता है क्योंकि इसके आंतरिक वजन अधिक से अधिक पुराने होते जाते हैं। साथ ही, सिस्टम को ज्ञान में ‘सापेक्ष स्थिरांकों’ को सुरक्षित रखने की आवश्यकता है, जैसे चंद्र कक्षाएं और शास्त्रीय साहित्य, संस्कृति और इतिहास; साथ ही बुनियादी भूगोल, भौतिकी और अन्य वैज्ञानिक सिद्धांत जो समय के साथ बहुत विकसित होने की संभावना नहीं रखते (यानी, ‘अचानक परिवर्तन’ का जोखिम गैर-मौजूद नहीं है, लेकिन कम है)।

असामान्य विषय

फिलहाल, कम से कम जहां तक ChatGPT का संबंध है, RAG कॉल्स (यानी, किसी भी उपयोगकर्ता क्वेरी के लिए वेब शोध का उपयोग जो स्पष्ट रूप से या अंतर्निहित रूप से वेब शोध की मांग नहीं करती) सिस्टम द्वारा शायद ही कभी स्वायत्त रूप से चुने जाते हैं, यहां तक कि ‘सीमांत’ उप-डोमेन से निपटते समय भी। सीमांत डोमेन का एक ऐसा उदाहरण है ‘अस्पष्ट’ सॉफ़्टवेयर उपयोग। ऐसे मामले में, प्रशिक्षण के दौरान न्यूनतम उपलब्ध स्रोत डेटा ने ध्यान आकर्षित करने के लिए संघर्ष किया होगा, और डेटा की ‘आउटलायर’ स्थिति ने या तो इसे