कृत्रिम बुद्धिमत्ता

गूगल का LipSync3D बेहतर ‘डीपफेक्ड’ माउथ मूवमेंट सिंक्रोनाइजेशन प्रदान करता है

गूगल एआई शोधकर्ताओं और भारतीय प्रौद्योगिकी संस्थान खड़गपुर के बीच एक सहयोग ऑडियो सामग्री से बात करने वाले सिर को संश्लेषित करने के लिए एक नया ढांचा प्रदान करता है। परियोजना का उद्देश्य ऑडियो के लिए ‘बात करने वाला सिर’ वीडियो सामग्री बनाने के लिए अनुकूलित और उचित संसाधनों के साथ तरीके प्रदान करना है, जिसमें डब किए गए या मशीन-अनुवादित ऑडियो के लिए होंठ की गति को सिंक्रोनाइज़ करना और अवतार, इंटरैक्टिव अनुप्रयोगों और अन्य रियल-टाइम वातावरण में उपयोग करना शामिल है।

स्रोत: https://www.youtube.com/watch?v=L1StbX9OznY

प्रशिक्षित मशीन लर्निंग मॉडल – जिसे LipSync3D कहा जाता है – को केवल लक्ष्य चेहरे की पहचान के रूप में एक ही वीडियो की आवश्यकता होती है। डेटा तैयारी पाइपलाइन चेहरे की ज्यामिति को प्रकाश और अन्य पहलुओं के मूल्यांकन से अलग करती है, जिससे अधिक आर्थिक और केंद्रित प्रशिक्षण संभव हो जाता है।

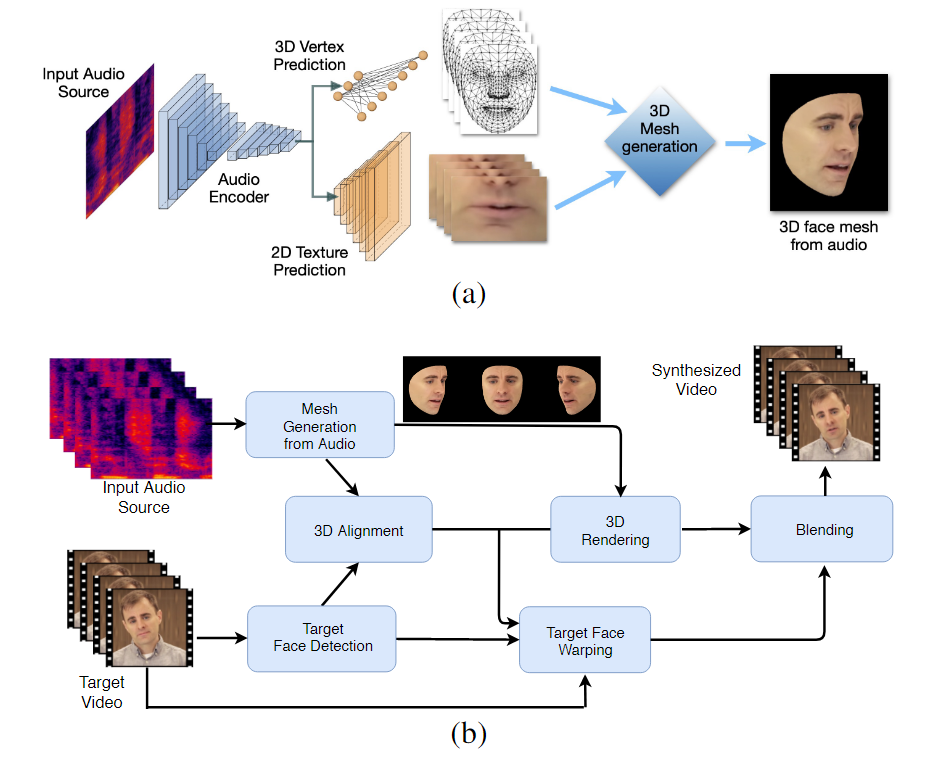

LipSync3D का दो-चरण कार्य-प्रवाह। ऊपर, ‘लक्ष्य’ ऑडियो से एक गतिशील रूप से बनावट वाले 3D चेहरे का निर्माण; नीचे, उत्पन्न जाल को लक्ष्य वीडियो में सम्मिलित करना।

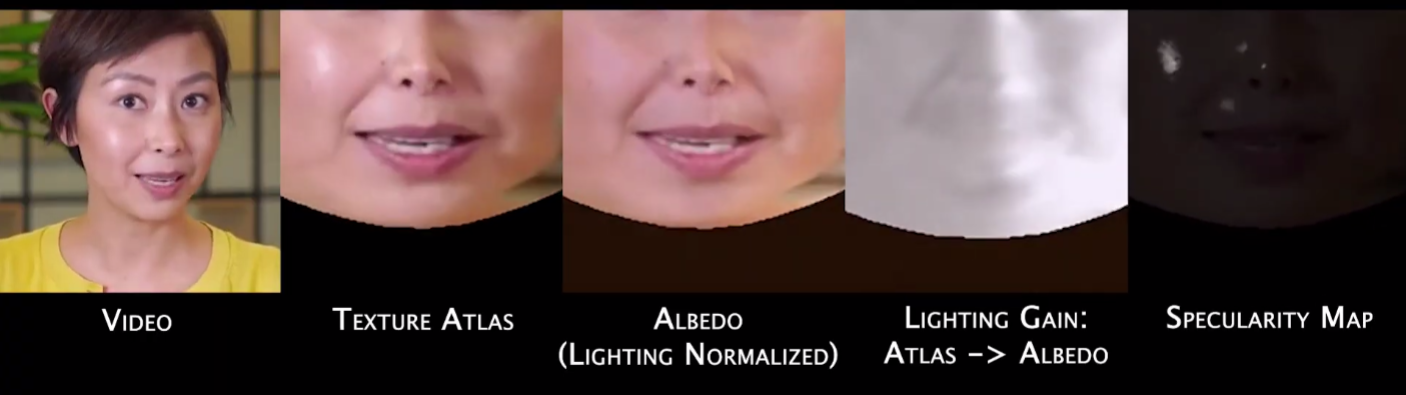

वास्तव में, LipSync3D का इस क्षेत्र में शोध प्रयासों के शरीर में सबसे उल्लेखनीय योगदान इसका प्रकाश सामान्यीकरण एल्गोरिदम हो सकता है, जो प्रशिक्षण और अनुमान प्रकाश व्यवस्था को अलग करता है।

सामान्य ज्यामिति से प्रकाश डेटा को अलग करने से LipSync3D चुनौतीपूर्ण परिस्थितियों में अधिक वास्तविक होंठ आंदोलन आउटपुट उत्पन्न करने में मदद मिलती है। हाल के वर्षों में अन्य दृष्टिकोणों ने ‘निश्चित’ प्रकाश स्थितियों तक खुद को सीमित कर लिया है जो इस संबंध में उनकी अधिक सीमित क्षमता को प्रकट नहीं करेंगे।

इनपुट डेटा फ्रेम्स के पूर्व-प्रसंस्करण के दौरान, प्रणाली को विशिष्ट बिंदुओं की पहचान करनी और उन्हें हटाना होगा, क्योंकि वे वीडियो लेने की प्रकाश स्थितियों के लिए विशिष्ट होते हैं और अन्यथा पुनः प्रकाश व्यवस्था की प्रक्रिया में हस्तक्षेप करेंगे।

LipSync3D, जैसा कि इसके नाम से सुझाया गया है, केवल फेसेस पर पिक्सेल विश्लेषण नहीं कर रहा है, बल्कि सक्रिय रूप से पहचाने गए चेहरे की विशेषताओं का उपयोग करके मोटाइल सीजीआई-शैली के जाल और उन पर लपेटे गए ‘अनफोल्डेड’ बनावट को उत्पन्न कर रहा है, जो एक पारंपरिक सीजीआई पाइपलाइन में होता है।

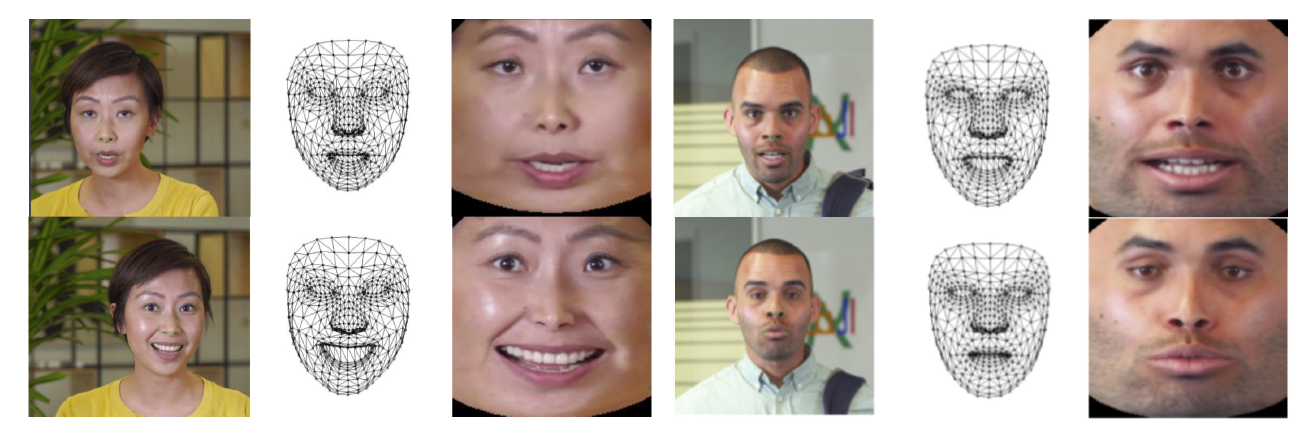

LipSync3D में मुद्रा सामान्यीकरण। बाएं हैं इनपुट फ्रेम और पता लगाई गई विशेषताएं; मध्य में, उत्पन्न जाल के मूल्यांकन के सामान्यीकृत शीर्षलेख; और दाएं, संबंधित टेक्स्चर एटलस, जो बनावट भविष्यवाणी के लिए आधारभूत सत्य प्रदान करता है। स्रोत: https://arxiv.org/pdf/2106.04185.pdf

इसके अलावा नए रोशनी सामान्यीकरण विधि, शोधकर्ताओं का दावा है कि LipSync3D पिछले कार्य पर तीन मुख्य नवाचार प्रदान करता है: सामान्यीकृत स्थान में ज्यामिति, प्रकाश, मुद्रा और बनावट को विभिन्न डेटा प्रवाह में अलग करना; एक आसानी से प्रशिक्षित स्व-रिग्रेसिव बनावट भविष्यवाणी मॉडल जो समय-समय पर संगत वीडियो संश्लेषण उत्पन्न करता है; और मानव रेटिंग और उद्देश्य मेट्रिक्स द्वारा मूल्यांकित वास्तविकता में वृद्धि।

वीडियो चेहरे की छवियों के विभिन्न पहलुओं को अलग करने से वीडियो संश्लेषण में अधिक नियंत्रण मिलता है।

LipSync3D ऑडियो से सीधे होंठ ज्यामिति आंदोलन को व्युत्पन्न कर सकता है, जिसमें ध्वनियों और भाषण के अन्य पहलुओं का विश्लेषण किया जाता है और उन्हें मुंह के आसपास की मांसपेशियों की ज्ञात मुद्राओं में अनुवादित किया जाता है।

यह प्रक्रिया एक संयुक्त-पूर्वानुमान पाइपलाइन का उपयोग करती है, जहां अनुमानित ज्यामिति और बनावट में एक ऑटोएनकोडर सेटअप में समर्पित एनकोडर होते हैं, लेकिन वे मॉडल पर लगाने वाले भाषण के साथ एक ऑडियो एनकोडर साझा करते हैं:

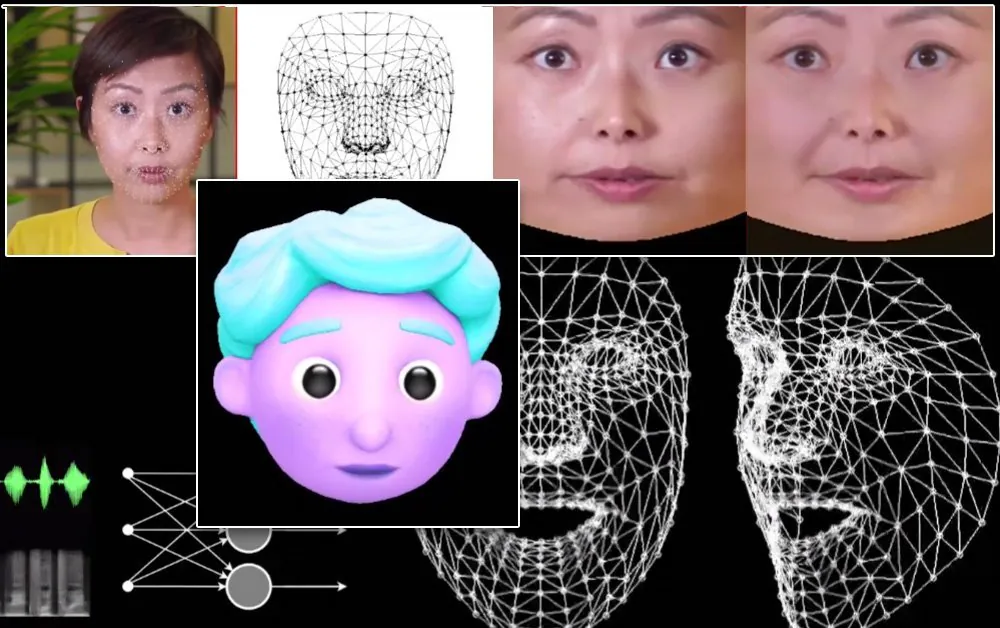

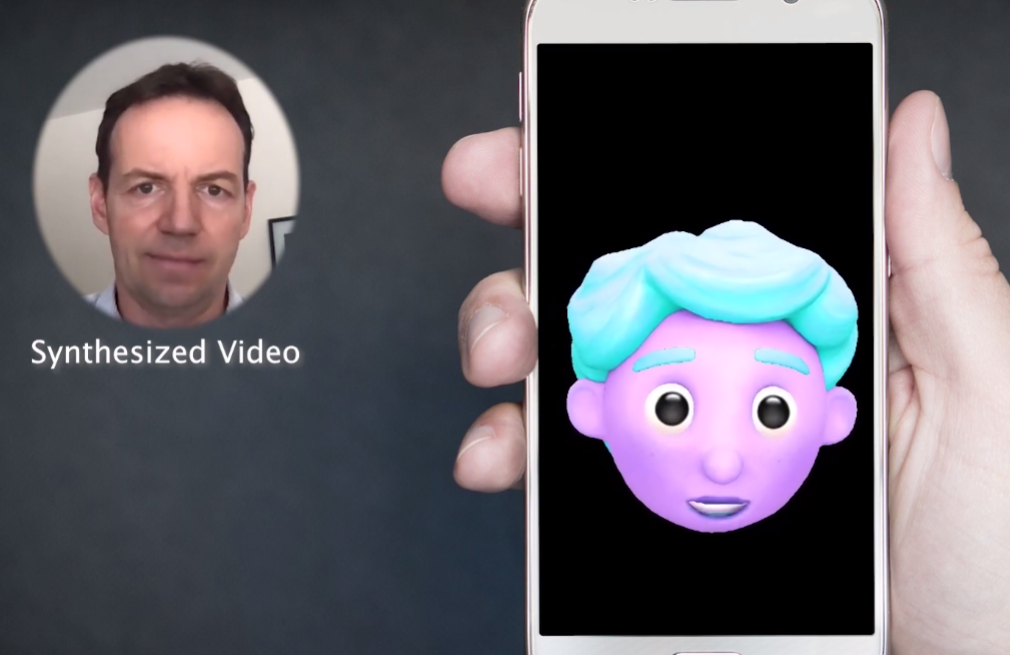

LipSync3D का लेबिल मूवमेंट सिंथेसिस स्टाइलाइज्ड सीजीआई अवतारों को भी संचालित करने के लिए अभिप्रेत है, जो वास्तव में केवल वास्तविक दुनिया की छवियों के समान जाल और बनावट जानकारी हैं:

एक स्टाइलाइज्ड 3D अवतार को एक स्रोत वक्ता वीडियो द्वारा वास्तविक समय में होंठ आंदोलन से संचालित किया जाता है। ऐसे परिदृश्य में, सर्वोत्तम परिणाम व्यक्तिगत पूर्व-प्रशिक्षण से प्राप्त होंगे।

शोधकर्ता एक अवतार के उपयोग की भी आशा करते हैं जिसमें थोड़ा अधिक वास्तविक अनुभव हो:

![]()

वीडियो के लिए नमूना प्रशिक्षण समय 2-5 मिनट के वीडियो के लिए 3-5 घंटे तक होता है, जो एक पाइपलाइन में टेंसोरफ्लो का उपयोग करता है, पाइथन और सी++ जियोफोर्स जीटीएक्स 1080 पर। प्रशिक्षण सत्रों में 128 फ्रेमों के बैच आकार का उपयोग 500-1000 युगों के लिए किया गया था, जिसमें प्रत्येक युग वीडियो के पूर्ण मूल्यांकन का प्रतिनिधित्व करता था।

होंठ आंदोलन के गतिशील पुनः-सिंक्रोनाइजेशन की ओर

नovel ऑडियो ट्रैक के लिए होंठ को पुनः सिंक्रोनाइज़ करने का क्षेत्र पिछले कुछ वर्षों में कंप्यूटर विजन शोध में बहुत ध्यान आकर्षित किया है (नीचे देखें), न कि कम विवादास्पद डीपफेक प्रौद्योगिकी के एक उपोत्पाद के रूप में।

2017 में, वाशिंगटन विश्वविद्यालय ने शोध प्रस्तुत किया जो ऑडियो से लिप सिंक सीखने में सक्षम था, जिसका उपयोग तब-राष्ट्रपति ओबामा के होंठ आंदोलन को बदलने के लिए किया गया था। 2018 में, मैक्स प्लैंक इंफॉर्मेटिक्स संस्थान ने एक अन्य शोध पहल का नेतृत्व किया जो पहचान>पहचान वीडियो ट्रांसफर को सक्षम बनाने के लिए था, जिसमें लिप सिंक एक उपोत्पाद था; और मई 2021 में, एआई स्टार्टअप फ्लावलेसएआई ने अपनी प्रोप्राइटरी लिप-सिंक प्रौद्योगिकी ट्रूसिंक का खुलासा किया, जिसे प्रेस में व्यापक रूप से भाषाओं में प्रमुख फिल्म रिलीज़ के लिए डबिंग प्रौद्योगिकियों में सुधार के लिए एक सक्षम के रूप में प्राप्त किया गया था।

और, जैसा कि डीपफेक ओपन सोर्स रिपॉजिटरी के निरंतर विकास में देखा गया है, यह क्षेत्र में एक और शाखा है जिसमें उपयोगकर्ता-योगदान शोध होता है।