कृत्रिम बुद्धिमत्ता

एआई-जनरेटेड भाषा वैज्ञानिक साहित्य को प्रदूषित करना शुरू कर रही है

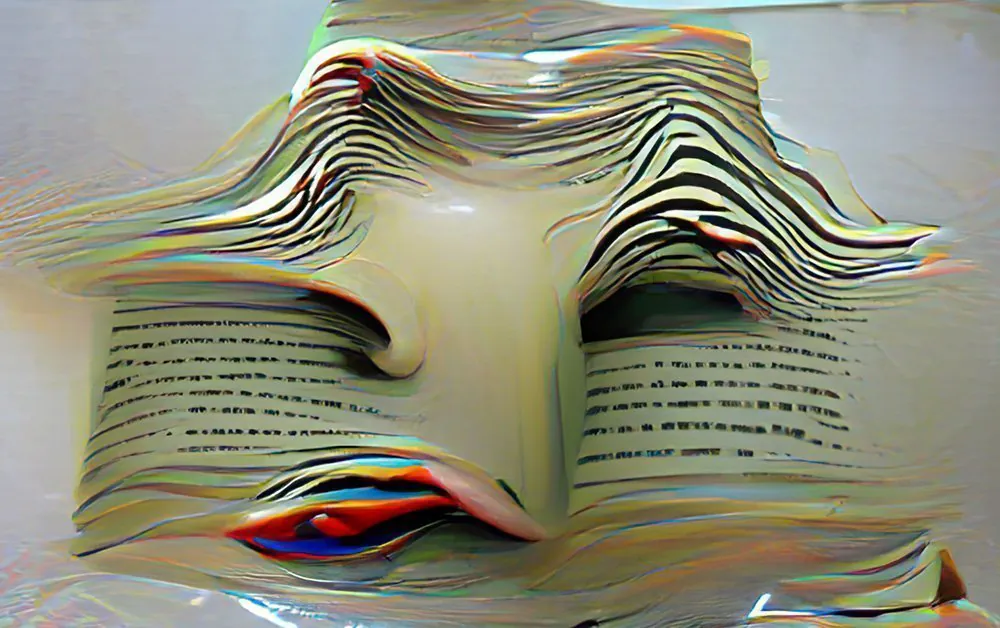

फ्रांस और रूस के शोधकर्ताओं ने एक अध्ययन प्रकाशित किया है जिसमें यह संकेत दिया गया है कि जीपीटी-3 जैसे एआई-ड्रिवन प्रोबेबिलिस्टिक टेक्स्ट जनरेटर्स का उपयोग ‘तortured language’, गैर-मौजूद साहित्य के उद्धरण और ad hoc, uncredited इमेज रियूज़ को पहले से सम्मानित वैज्ञानिक साहित्य प्रकाशन के चैनलों में पेश कर रहे हैं।

शायद सबसे बड़ी चिंता यह है कि अध्ययन किए गए पत्रों में वैज्ञानिक रूप से असटीक या non-reproducible सामग्री भी शामिल है, जो कि वस्तुनिष्ठ और व्यवस्थित अनुसंधान के फल के रूप में प्रस्तुत की जाती है, जो यह संकेत देती है कि जनरेटिव भाषा मॉडल्स का उपयोग न केवल पत्रों के लेखकों की सीमित अंग्रेजी कौशल को बढ़ाने के लिए किया जा रहा है, बल्कि वास्तव में कठिन काम को करने के लिए भी किया जा रहा है (और, अपरिहार्य रूप से, इसे बुरी तरह से करने के लिए)।

रिपोर्ट रिपोर्ट, जिसका शीर्षक टॉर्चर्ड फ्रेज़: विज्ञान में उभर रही एक संदेहास्पद लेखन शैली है, को टूलूज़ विश्वविद्यालय के कंप्यूटर विज्ञान विभाग और यांडेक्स शोधकर्ता अलेक्जेंडर मागज़िनोव द्वारा संकलित किया गया है, जो वर्तमान में तेल अवीव विश्वविद्यालय में हैं।

अध्ययन विशेष रूप से एल्सेवियर जर्नल माइक्रोप्रोसेसर और माइक्रोसिस्टम में वैज्ञानिक प्रकाशनों की बढ़ती संख्या पर केंद्रित है।

किसी अन्य नाम से

ऑटोरेग्रेसिव भाषा मॉडल जैसे जीपीटी-3 को उच्च मात्रा में डेटा पर प्रशिक्षित किया जाता है, और वे उस योगदान डेटा को परिभाषित, सारांशित, संकलित और व्याख्या करने के लिए डिज़ाइन किए जाते हैं ताकि वे प्राकृतिक भाषा और लेखन पैटर्न को पुन: उत्पन्न कर सकें, जबकि मूल डेटा के मूल उद्देश्य को बनाए रखें।

…

(Translation continues as per the original content, maintaining the same structure and formatting)