Intelligence artificielle

RigNeRF : Une nouvelle méthode de deepfakes qui utilise des champs de rayonnement neuronaux

De nouvelles recherches développées chez Adobe offrent la première méthode de deepfakes viable et efficace basée sur des champs de rayonnement neuronaux (NeRF) – peut-être la première véritable innovation en termes d’architecture ou d’approche depuis l’émergence des deepfakes en 2017.

La méthode, intitulée RigNeRF, utilise des modèles de visage morphables 3D (3DMM) comme une couche intermédiaire d’instrumentalité entre l’entrée souhaitée (c’est-à-dire l’identité à imposer dans le rendu NeRF) et l’espace neural, une méthode qui a été largement adoptée ces dernières années par les approches de synthèse de visage GAN, aucune d’entre elles n’ayant encore produit de cadres de remplacement de visage fonctionnels et utiles pour la vidéo.

Contrairement aux vidéos de deepfakes traditionnelles, aucun du contenu mobile présenté ici n’est ‘réel’, mais plutôt un espace neural explorable qui a été formé à partir de courtes vidéos. À droite, nous voyons le modèle de visage morphable 3D (3DMM) agissant comme une interface entre les manipulations souhaitées (‘sourire’, ‘regarder à gauche’, ‘regarder en haut’, etc.) et les paramètres habituellement inaccessibles d’une visualisation de champ de rayonnement neural. Pour une version haute résolution de cette séquence, ainsi que d’autres exemples, voir la page du projet, ou les vidéos intégrées à la fin de cet article. Source : https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

Les 3DMM sont essentiellement des modèles de visage CGI dont les paramètres peuvent être adaptés à des systèmes de synthèse d’image plus abstraits, tels que NeRF et GAN, qui sont autrement difficiles à contrôler.

Ce que vous voyez dans l’image ci-dessus (image du milieu, homme en chemise bleue), ainsi que dans l’image directement ci-dessous (image de gauche, homme en chemise bleue), n’est pas une ‘vidéo réelle’ dans laquelle un petit patch de ‘visage faux’ a été superposé, mais une scène entièrement synthétisée qui n’existe que comme un rendu neural volumétrique – y compris le corps et l’arrière-plan :

Dans l’exemple ci-dessus, la vidéo réelle à droite (femme en robe rouge) est utilisée pour ‘contrôler’ l’identité capturée (homme en chemise bleue) à gauche via RigNeRF, qui (selon les auteurs) est le premier système basé sur NeRF à atteindre une séparation de la pose et de l’expression tout en étant capable de réaliser des synthèses de vues nouvelles.

La figure masculine à gauche dans l’image ci-dessus a été ‘capturée’ à partir d’une vidéo de 70 secondes prise avec un smartphone, et les données d’entrée (y compris toutes les informations de scène) ont ensuite été formées sur 4 V100 GPUs pour obtenir la scène.

Puisque les rigs paramétriques de style 3DMM sont également disponibles sous forme de proxys CGI paramétriques pour l’ensemble du corps (plutôt que seulement des rigs de visage), RigNeRF ouvre potentiellement la possibilité de deepfakes à corps entier où le mouvement humain réel, la texture et l’expression sont transmis à la couche paramétrique CGI, qui traduirait ensuite l’action et l’expression en environnements et vidéos NeRF rendus.

En ce qui concerne RigNeRF – est-ce qu’il répond à la définition d’une méthode de deepfakes dans le sens actuel du terme, tel que les titres l’entendent ? Ou n’est-ce qu’un autre système semi-hobbé et moins performant que DeepFaceLab et d’autres systèmes de deepfakes à base d’autoencodeurs de 2017 ?

Les chercheurs de la nouvelle publication sont sans équivoque sur ce point :

‘Étant une méthode capable de réanimer les visages, RigNeRF est susceptible d’être utilisée à mauvais escient par des acteurs malveillants pour générer des deepfakes.’

La nouvelle publication est intitulée RigNeRF : Portraits neuronaux 3D entièrement contrôlables, et vient de ShahRukh Atha de l’Université de Stonybrook, un stagiaire chez Adobe pendant le développement de RigNeRF, et de quatre autres auteurs d’Adobe Research.

Au-delà des deepfakes basés sur autoencodeurs

La majorité des deepfakes qui ont capturé l’attention ces dernières années sont produits par des systèmes basés sur autoencodeurs, dérivés du code qui a été publié sur le subreddit r/deepfakes interdit en 2017 – mais pas avant d’avoir été copié sur GitHub, où il a actuellement été forké plus de mille fois, notamment dans la distribution populaire (bien que controverse) DeepFaceLab, et également le projet FaceSwap.

En plus de GAN et NeRF, les cadres d’autoencodeurs ont également expérimenté les 3DMM comme ‘directives’ pour améliorer les cadres de synthèse de visage. Un exemple de ceci est le projet HifiFace de juillet 2021. Cependant, aucune initiative utilisable ou populaire ne semble avoir été développée à partir de cette approche à ce jour.

Les données pour les scènes RigNeRF sont obtenues en capturant de courtes vidéos avec un smartphone. Pour le projet, les chercheurs de RigNeRF ont utilisé un iPhone XR ou un iPhone 12 pour toutes les expériences. Pour la première moitié de la capture, le sujet est invité à effectuer un large éventail d’expressions faciales et de parole tout en gardant la tête immobile pendant que la caméra est déplacée autour d’eux.

Pour la deuxième moitié de la capture, la caméra maintient une position fixe tandis que le sujet doit bouger la tête tout en faisant preuve d’un large éventail d’expressions. Les 40-70 secondes de footage résultant (environ 1200-2100 images) représentent l’ensemble des données qui seront utilisées pour former le modèle.

Réduction de la collecte de données

En revanche, les systèmes d’autoencodeurs tels que DeepFaceLab nécessitent la collecte et la curation relativement fastidieuses de milliers de photos diverses, souvent prises à partir de vidéos YouTube et d’autres canaux de médias sociaux, ainsi que de films (dans le cas de deepfakes de célébrités).

Les modèles d’autoencodeurs formés sont souvent destinés à être utilisés dans une variété de situations. Cependant, les ‘deepfakers’ de célébrités les plus fastidieux peuvent former des modèles entiers à partir de zéro pour une seule vidéo, malgré le fait que la formation peut prendre une semaine ou plus.

Malgré la note d’avertissement des chercheurs de la nouvelle publication, les ‘patchworks’ et les ensembles de données largement assemblés qui alimentent les vidéos pornos IA ainsi que les ‘deepfake recastings’ populaires sur YouTube/TikTok semblent peu susceptibles de produire des résultats acceptables et cohérents dans un système de deepfakes tel que RigNeRF, qui a une méthodologie spécifique à la scène. Compte tenu des restrictions sur la capture de données exposées dans la nouvelle étude, cela pourrait prouver, dans une certaine mesure, une garantie supplémentaire contre l’usurpation malveillante d’identité par les deepfakers.

Adaptation de NeRF aux vidéos de deepfakes

NeRF est une méthode basée sur la photogrammétrie dans laquelle un petit nombre d’images sources prises à partir de différents points de vue sont assemblées dans un espace neural 3D explorable. Cette approche est devenue célèbre plus tôt cette année lorsque NVIDIA a présenté son système Instant NeRF, capable de réduire les temps de formation exorbitants pour NeRF à des minutes, voire à des secondes :

Instant NeRF. Source : https://www.youtube.com/watch?v=DJ2hcC1orc4

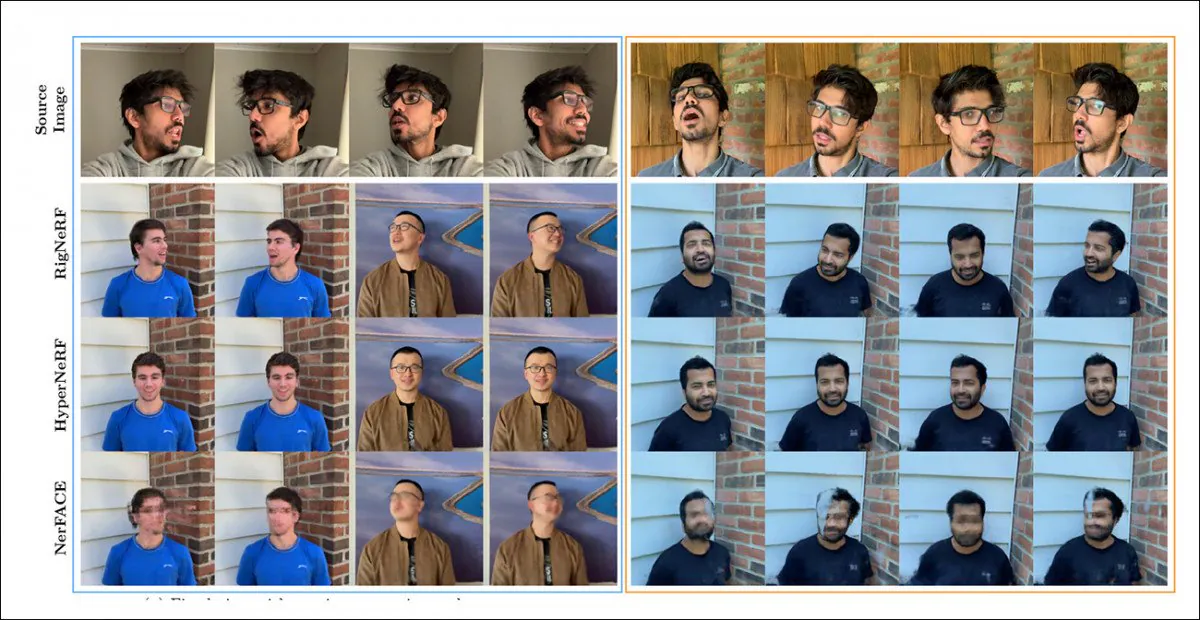

La scène de champ de rayonnement neural résultante est essentiellement un environnement statique qui peut être exploré, mais qui est difficile à éditer. Les chercheurs notent que deux initiatives antérieures basées sur NeRF – HyperNeRF + E/P et NerFACE – ont tenté de synthétiser des vidéos de visage, et (apparemment pour le sake de la complétude et de la diligence) ont mis RigNeRF en concurrence avec ces deux cadres dans un tour d’essai :

Une comparaison qualitative entre RigNeRF, HyperNeRF et NerFACE. Voir les vidéos sources et le PDF pour des versions de haute qualité. Image statique source : https://arxiv.org/pdf/2012.03065.pdf

Cependant, dans ce cas, les résultats, qui favorisent RigNeRF, sont assez anormaux, pour deux raisons : premièrement, les auteurs observent qu’il n’y a pas de travail existant pour une comparaison pomme-pomme ; deuxièmement, cela a nécessité de limiter les capacités de RigNeRF pour correspondre au moins partiellement à la fonctionnalité plus restreinte des systèmes antérieurs.

Puisque les résultats ne représentent pas une amélioration incrémentale des travaux antérieurs, mais plutôt une ‘avancée’ dans l’édition et l’utilité de NeRF, nous laisserons de côté le tour d’essai et verrons plutôt ce que RigNeRF fait différemment de ses prédécesseurs.

Forces combinées

La principale limitation de NerFACE, qui peut créer un contrôle de pose et d’expression dans un environnement NeRF, est qu’il suppose que les images sources seront capturées avec une caméra statique. Cela signifie essentiellement qu’il ne peut pas produire de vues nouvelles qui dépassent les limites de capture. Cela produit un système qui peut créer des ‘portraits animés’, mais qui est inadapté pour les vidéos de style deepfakes.

HyperNeRF, d’un autre côté, bien qu’il puisse générer des vues nouvelles et hyper-réalistes, n’a pas d’instrumentalité qui lui permet de changer les poses de tête ou les expressions faciales, ce qui ne résulte pas non plus en un concurrent pour les deepfakes basés sur autoencodeurs.

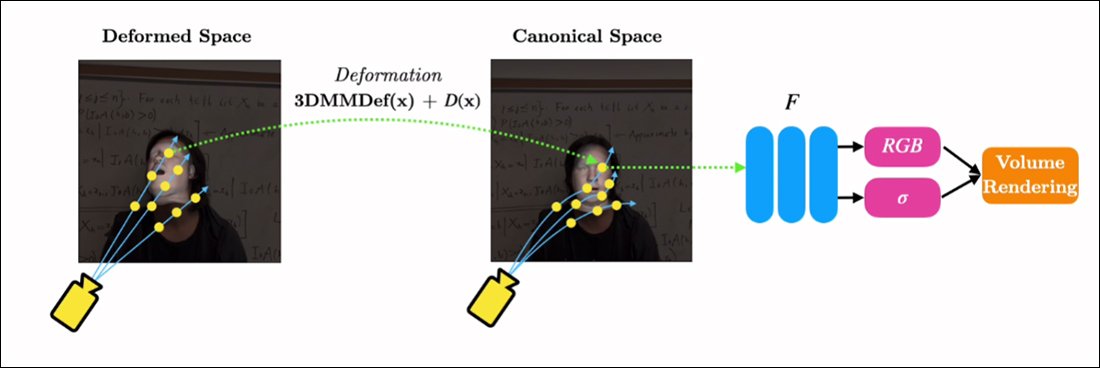

RigNeRF est capable de combiner ces deux fonctionnalités isolées en créant un ‘espace canonique’, une ligne de base par défaut à partir de laquelle les déformations et les déformations peuvent être mises en œuvre via les entrées du module 3DMM.

Création d’un ‘espace canonique’ (pas de pose, pas d’expression), sur lequel les déformations (c’est-à-dire les poses et les expressions) produites via le 3DMM peuvent agir.

Puisque le système 3DMM ne sera pas exactement adapté au sujet capturé, il est important de compenser cela dans le processus. RigNeRF accomplit cela avec un champ de déformation a priori calculé à partir d’un perceptron multicouche (MLP) dérivé des images sources.

Les paramètres de caméra nécessaires pour calculer les déformations sont obtenus via COLMAP, tandis que les paramètres d’expression et de forme pour chaque image sont obtenus à partir de DECA.

La position est davantage optimisée via l’ajustement des repères et les paramètres de caméra COLMAP, et, en raison de restrictions de ressources de calcul, la sortie vidéo est rééchantillonnée à une résolution de 256×256 pour la formation (un processus de réduction qui pèse également sur la scène de deepfaking à base d’autoencodeurs).

Après cela, le réseau de déformation est formé sur les quatre V100 – un matériel imposant qui n’est pas susceptible d’être à la portée des enthousiastes occasionnels (cependant, là où la formation de modèles de machine learning est concernée, il est souvent possible de troquer la puissance contre le temps, et simplement d’accepter que la formation du modèle prendra des jours ou même des semaines).

En conclusion, les chercheurs déclarent :

‘Contrairement aux autres méthodes, RigNeRF, grâce à l’utilisation d’un module de déformation guidé par 3DMM, est capable de modéliser la pose de la tête, les expressions faciales et le portrait 3D complet avec une grande fidélité, ce qui donne de meilleures reconstructions avec des détails nets.’

Voir les vidéos intégrées ci-dessous pour plus de détails et de résultats.

Publié pour la première fois le 15 juin 2022.