Intelligence artificielle

Perplexity AI “décensure” DeepSeek R1 : Qui décide des limites de l’IA ?

Dans un mouvement qui a attiré l’attention de nombreux, Perplexity AI a publié une nouvelle version d’un modèle de langage ouvert populaire qui supprime la censure chinoise intégrée. Ce modèle modifié, baptisé R1 1776 (un nom qui évoque l’esprit d’indépendance), est basé sur le modèle chinois DeepSeek R1. Le DeepSeek R1 original a fait des vagues pour ses solides capacités de raisonnement – qui rivalisent avec les meilleurs modèles à une fraction du coût – mais il comportait une limitation importante : il refusait de traiter certains sujets sensibles.

Pourquoi cela est-il important ?

Cela soulève des questions cruciales sur la surveillance de l’IA, les préjugés, l’ouverture et le rôle de la géopolitique dans les systèmes d’IA. Cet article explore ce que Perplexity a exactement fait, les implications de la décensure du modèle et comment cela s’inscrit dans le débat plus large sur la transparence et la censure de l’IA.

Ce qui s’est passé : DeepSeek R1 devient non censuré

DeepSeek R1 est un grand modèle de langage ouvert qui a origine en Chine et a acquis une notoriété pour ses excellentes capacités de raisonnement – même en approchant les performances des meilleurs modèles – tout en étant plus efficace sur le plan computationnel. Cependant, les utilisateurs ont rapidement remarqué une particularité : chaque fois que les requêtes touchaient à des sujets sensibles en Chine (par exemple, des controverses politiques ou des événements historiques considérés comme tabous par les autorités), DeepSeek R1 ne répondait pas directement. Au lieu de cela, il répondait avec des déclarations approuvées par l’État ou des refus catégoriques, reflétant les règles de censure du gouvernement chinois. Cette préjugé intégré limitait l’utilité du modèle pour ceux qui cherchaient des discussions franches ou nuancées sur ces sujets.

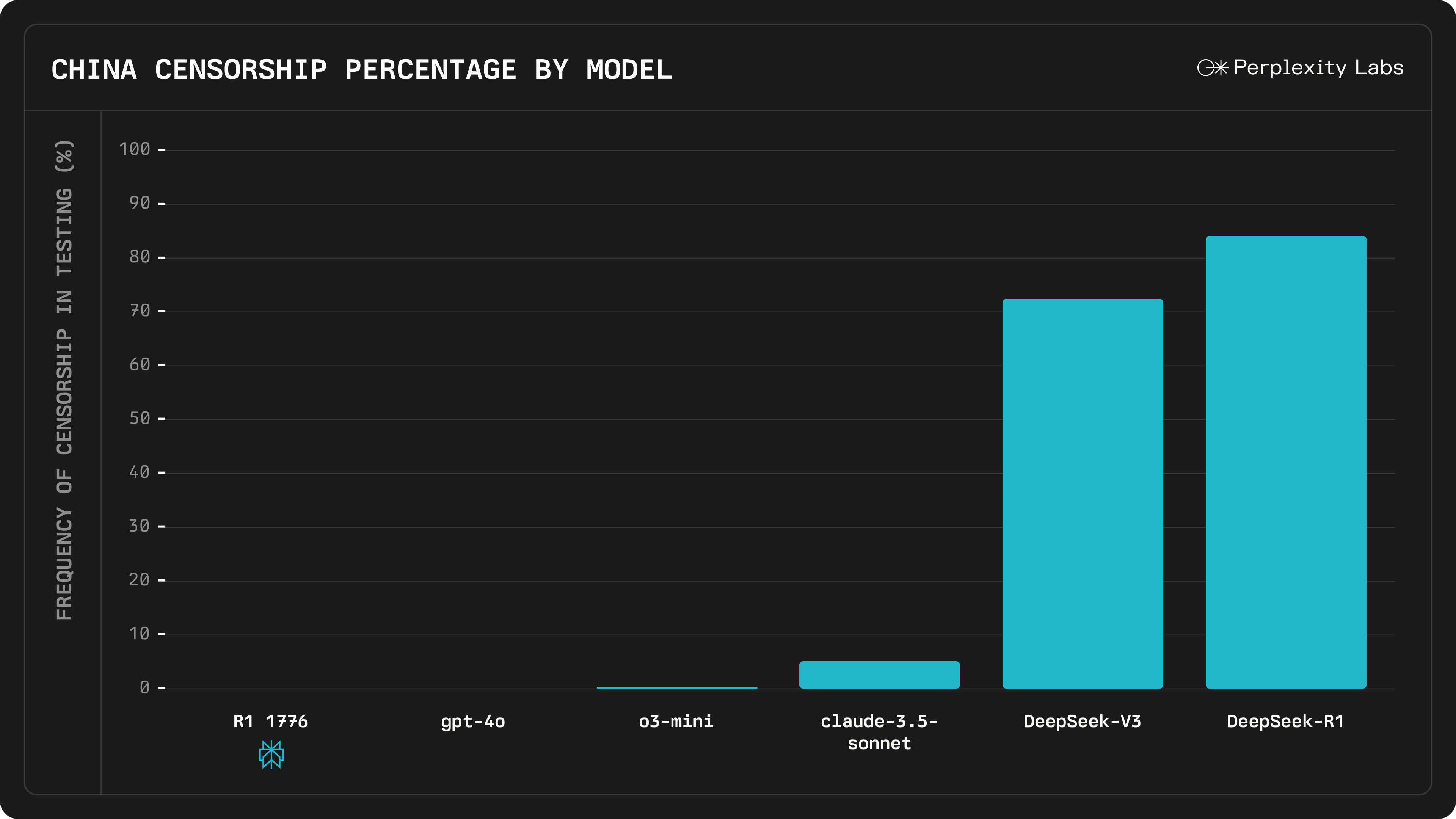

La solution de Perplexity AI a été de « décensurer » le modèle grâce à un processus de post-formation approfondi. L’entreprise a réuni un grand ensemble de données de 40 000 requêtes multilingues couvrant des questions que DeepSeek R1 censurait ou répondait de manière évasive. Avec l’aide d’experts humains, ils ont identifié environ 300 sujets sensibles où le modèle original avait tendance à suivre la ligne du parti. Pour chaque requête de ce type, l’équipe a créé des réponses factuelles et bien raisonnées dans plusieurs langues. Ces efforts ont alimenté un système de détection et de correction de la censure multilingue, enseignant essentiellement au modèle à reconnaître lorsqu’il appliquait la censure politique et à répondre avec une réponse informative à la place. Après cette fine-tuning spéciale (que Perplexity a surnommée « R1 1776 » pour mettre en avant le thème de la liberté), le modèle a été rendu ouvertement disponible. Perplexity affirme avoir éliminé les filtres de censure chinoise et les préjugés des réponses de DeepSeek R1, sans modifier autrement ses capacités de base.

De manière cruciale, R1 1776 se comporte très différemment sur les questions qui étaient autrefois taboues. Perplexity a donné un exemple impliquant une requête sur l’indépendance de Taïwan et son impact potentiel sur le cours de l’action de NVIDIA – un sujet politiquement sensible qui touche aux relations Chine-Taïwan. Le DeepSeek R1 original a évité la question, répondant avec des platitudes alignées sur le PCC. En revanche, R1 1776 fournit une évaluation détaillée et candide : il discute des risques géopolitiques et économiques concrets (perturbations de la chaîne d’approvisionnement, volatilité du marché, conflit possible, etc.) qui pourraient affecter l’action de NVIDIA.

En rendant R1 1776 open source, Perplexity a également rendu les poids et les modifications du modèle transparents pour la communauté. Les développeurs et les chercheurs peuvent télécharger le modèle depuis Hugging Face et même l’intégrer via API, garantissant que la suppression de la censure peut être examinée et améliorée par d’autres.

(Source : Perplexity AI)

Implications de la suppression de la censure

La décision de Perplexity AI de supprimer la censure chinoise de DeepSeek R1 comporte plusieurs implications importantes pour la communauté de l’IA :

- Une plus grande ouverture et véracité : Les utilisateurs de R1 1776 peuvent maintenant recevoir des réponses directes et non censurées sur des sujets qui étaient auparavant interdits, ce qui est une victoire pour l’enquête ouverte. Cela pourrait en faire un assistant plus fiable pour les chercheurs, les étudiants ou quiconque curieux de questions géopolitiques sensibles. C’est un exemple concret de l’utilisation de l’IA open source pour contrer la suppression de l’information.

- Performances maintenues : Il y avait des inquiétudes quant à savoir si la modification du modèle pour supprimer la censure pourrait dégrader ses performances dans d’autres domaines. Cependant, Perplexity rapporte que les compétences de base de R1 1776 – comme les mathématiques et le raisonnement logique – restent au même niveau que le modèle original. Dans des tests sur plus de 1 000 exemples couvrant une large gamme de requêtes sensibles, le modèle a été trouvé « entièrement non censuré » tout en conservant le même niveau de précision de raisonnement que DeepSeek R1. Cela suggère que la suppression des préjugés (du moins dans ce cas) n’est pas venue au détriment de l’intelligence ou de la capacité globale, ce qui est un signe encourageant pour des efforts similaires à l’avenir.

- Accueil positif de la communauté et collaboration : En rendant le modèle décensuré open source, Perplexity invite la communauté de l’IA à examiner et à améliorer leur travail. Cela démontre un engagement en faveur de la transparence – l’équivalent de montrer son travail. Les enthousiastes et les développeurs peuvent vérifier que les restrictions de censure sont vraiment supprimées et contribuer potentiellement à des affinements supplémentaires. Cela favorise la confiance et l’innovation collaborative dans une industrie où les modèles fermés et les règles de modération cachées sont courants.

- Considérations éthiques et géopolitiques : D’un autre côté, la suppression complète de la censure soulève des questions éthiques complexes. Une préoccupation immédiate est de savoir comment ce modèle non censuré pourrait être utilisé dans des contextes où les sujets censurés sont illégaux ou dangereux. Par exemple, si quelqu’un en Chine continentale utilisait R1 1776, les réponses non censurées du modèle sur la place Tiananmen ou Taïwan pourraient mettre l’utilisateur en danger. Il y a également le signal géopolitique plus large : une entreprise américaine modifiant un modèle d’origine chinoise pour défier la censure chinoise peut être considéré comme une prise de position idéologique audacieuse. Le nom même de « 1776 » souligne un thème de libération, qui n’est pas passé inaperçu. Certains critiques soutiennent que remplacer un ensemble de préjugés par un autre est possible – essentiellement remettant en question si le modèle pourrait désormais refléter un point de vue occidental dans les domaines sensibles. Le débat met en évidence que la censure vs. l’ouverture dans l’IA n’est pas seulement une question technique, mais également politique et éthique. Là où une personne voit une modération nécessaire, une autre voit la censure, et trouver le bon équilibre est délicat.

La suppression de la censure est largement célébrée comme un pas vers des modèles d’IA plus transparents et plus utiles au niveau mondial, mais cela rappelle également que ce qu’un IA devrait dire est une question sensible sans accord universel.

(Source : Perplexity AI)

L’image plus large : la censure de l’IA et la transparence open source

Le lancement de R1 1776 par Perplexity intervient à un moment où la communauté de l’IA est aux prises avec des questions sur la manière dont les modèles doivent gérer le contenu controversé. La censure dans les modèles d’IA peut provenir de nombreuses sources. En Chine, les entreprises technologiques sont tenues d’intégrer des filtres stricts et même des réponses codées en dur pour des sujets politiquement sensibles. DeepSeek R1 est un exemple parfait de cela – il s’agissait d’un modèle open source, mais il portait clairement l’empreinte des normes de censure chinoises dans sa formation et son affinement. En revanche, de nombreux modèles développés en Occident, comme GPT-4 d’OpenAI ou LLaMA de Meta, ne sont pas soumis aux directives du PCC, mais ils comportent encore des couches de modération (pour des choses comme les discours de haine, la violence ou la désinformation) que certains utilisateurs qualifient de « censure ». La frontière entre modération raisonnable et censure indésirable peut être floue et dépend souvent de la perspective culturelle ou politique.

Ce que Perplexity AI a fait avec DeepSeek R1 soulève l’idée que les modèles open source peuvent être adaptés à différents systèmes de valeurs ou environnements réglementaires. En théorie, on pourrait créer plusieurs versions d’un modèle : l’une qui se conforme aux réglementations chinoises (pour une utilisation en Chine), et une autre qui est entièrement ouverte (pour une utilisation ailleurs). R1 1776 est essentiellement le deuxième cas – une version non censurée destinée à un public mondial qui préfère des réponses non filtrées. Ce type de fork n’est possible que parce que les poids de DeepSeek R1 étaient ouvertement disponibles. Cela met en évidence le bénéfice de l’open source dans l’IA : la transparence. N’importe qui peut prendre le modèle et le modifier, que ce soit pour ajouter des garanties ou, comme dans ce cas, pour supprimer les restrictions imposées. Le fait de rendre les données de formation, le code ou les poids du modèle open source signifie également que la communauté peut auditer la manière dont le modèle a été modifié. (Perplexity n’a pas pleinement divulgué toutes les sources de données qu’il a utilisées pour la décensure, mais en rendant le modèle lui-même disponible, ils ont permis aux autres d’observer son comportement et même de le réentraîner si nécessaire.)

Cet événement fait également allusion aux dynamiques géopolitiques plus larges du développement de l’IA. Nous assistons à une forme de dialogue (ou de confrontation) entre différents modèles de gouvernance pour l’IA. Un modèle développé en Chine avec certaines visions du monde intégrées est pris par une équipe basée aux États-Unis et modifié pour refléter une éthique d’information plus ouverte. C’est un témoignage de la nature mondiale et sans frontières de la technologie de l’IA : les chercheurs partout peuvent construire sur le travail des autres, mais ils ne sont pas obligés de conserver les contraintes originales. Avec le temps, nous pourrions voir plus d’instances de ce type – où les modèles sont « traduits » ou ajustés entre différents contextes culturels. Cela soulève la question de savoir si l’IA peut jamais être vraiment universelle, ou si nous allons finir par avoir des versions spécifiques à une région qui adhèrent aux normes locales. La transparence et l’ouverture offrent un chemin pour naviguer cela : si toutes les parties peuvent examiner les modèles, au moins la conversation sur les préjugés et la censure est ouverte plutôt que cachée derrière le secret corporatif ou gouvernemental.

Enfin, la démarche de Perplexity met en évidence un point clé dans le débat sur le contrôle de l’IA : qui décide de ce qu’un IA peut ou ne peut pas dire ? Dans les projets open source, ce pouvoir devient décentralisé. La communauté – ou les développeurs individuels – peuvent décider d’implémenter des filtres plus stricts ou de les assouplir. Dans le cas de R1 1776, Perplexity a décidé que les avantages d’un modèle non censuré l’emportaient sur les risques, et ils avaient la liberté de prendre cette décision et de partager le résultat publiquement. C’est un exemple audacieux du type d’expérimentation que le développement d’IA open source permet.